RoboBrain 2.5: Depth in Sight, Time in Mind

作者: Huajie Tan, Enshen Zhou, Zhiyu Li, Yijie Xu, Yuheng Ji, Xiansheng Chen, Cheng Chi, Pengwei Wang, Huizhu Jia, Yulong Ao, Mingyu Cao, Sixiang Chen, Zhe Li, Mengzhen Liu, Zixiao Wang, Shanyu Rong, Yaoxu Lyu, Zhongxia Zhao, Peterson Co, Yibo Li, Yi Han, Shaoxuan Xie, Guocai Yao, Songjing Wang, Leiduo Zhang, Xi Yang, Yance Jiao, Donghai Shi, Kunchang Xie, Shaokai Nie, Chunlei Men, Yonghua Lin, Zhongyuan Wang, Tiejun Huang, Shanghang Zhang

分类: cs.RO

发布日期: 2026-01-20

备注: 37 pages, 13 figures, Technical Report

💡 一句话要点

RoboBrain 2.5:通过时空监督学习,提升具身智能体的3D空间推理和时间建模能力。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 3D空间推理 时间建模 深度学习 机器人操作

📋 核心要点

- 现有具身智能模型在精确3D空间推理和时间建模方面存在不足,难以应对复杂操作任务。

- RoboBrain 2.5通过深度感知的坐标预测和密集时间价值估计,实现更精确的空间推理和时间建模。

- RoboBrain 2.5在具身智能任务中表现出显著的性能提升,为复杂操作提供了更可靠的基础。

📝 摘要(中文)

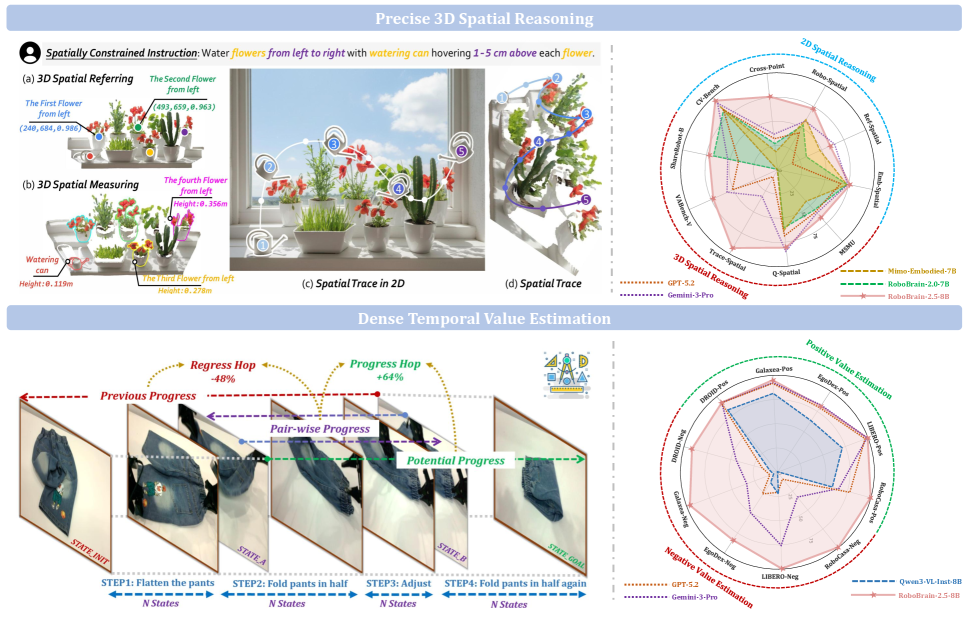

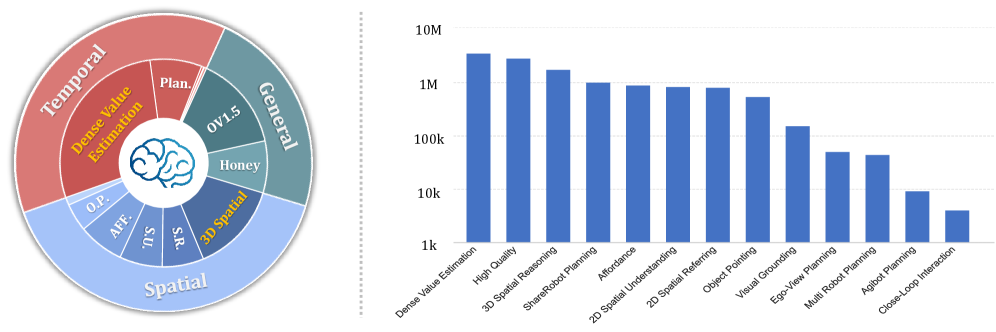

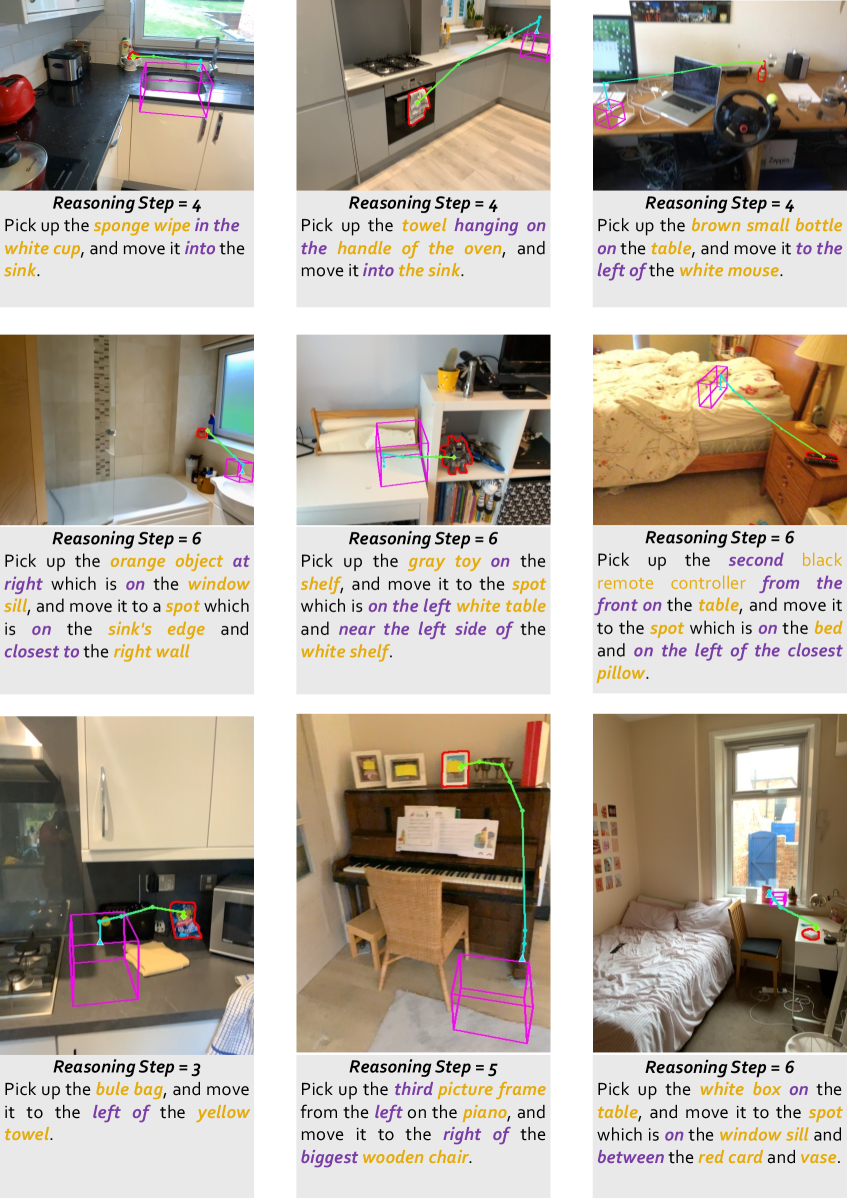

RoboBrain 2.5是新一代具身AI基础模型,通过大量高质量的时空监督训练,提升了通用感知、空间推理和时间建模能力。相较于前代,RoboBrain 2.5主要升级了两大能力。首先,它通过从2D像素相对定位转向深度感知的坐标预测和绝对度量约束理解,解锁了精确的3D空间推理,生成完整的3D操作轨迹,作为物理约束下的有序关键点序列。其次,该模型建立了密集的时间价值估计,提供密集、步进感知的进度预测和跨视角的执行状态理解,为下游学习产生稳定的反馈信号。这些升级共同推动该框架朝着更具物理基础和执行感知的具身智能发展,以应对复杂、精细的操作任务。

🔬 方法详解

问题定义:现有具身智能模型在处理复杂操作任务时,面临着两个主要挑战。一是缺乏精确的3D空间推理能力,难以理解和生成符合物理约束的操作轨迹。二是时间建模能力不足,无法准确预测任务进度和理解执行状态,导致反馈信号不稳定。这些问题限制了具身智能体在实际场景中的应用。

核心思路:RoboBrain 2.5的核心思路是通过引入深度信息和时间价值估计,增强模型对空间和时间的理解能力。具体来说,模型利用深度信息进行坐标预测,从而实现更精确的3D空间推理;同时,通过密集的时间价值估计,提供步进感知的进度预测和执行状态理解,为下游学习提供稳定的反馈信号。这种设计旨在使模型更具物理基础和执行感知能力。

技术框架:RoboBrain 2.5的整体框架包含两个主要模块:精确3D空间推理模块和密集时间价值估计模块。精确3D空间推理模块通过深度感知的坐标预测和绝对度量约束理解,生成完整的3D操作轨迹。密集时间价值估计模块则提供密集、步进感知的进度预测和跨视角的执行状态理解。这两个模块协同工作,共同提升模型的具身智能水平。

关键创新:RoboBrain 2.5的关键创新在于将深度信息和时间价值估计融入到具身智能模型中。与传统的2D像素相对定位方法不同,RoboBrain 2.5利用深度信息进行坐标预测,从而实现更精确的3D空间推理。此外,密集的时间价值估计也为模型提供了更丰富的时序信息,使其能够更好地理解任务进度和执行状态。

关键设计:在精确3D空间推理模块中,模型采用深度感知的坐标预测方法,并引入绝对度量约束,以确保生成的3D操作轨迹符合物理约束。在密集时间价值估计模块中,模型采用步进感知的预测方法,并考虑跨视角的执行状态,以提供更准确的反馈信号。具体的网络结构和损失函数等技术细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

RoboBrain 2.5通过引入深度信息和时间价值估计,在多个具身智能任务上取得了显著的性能提升。具体而言,在3D操作任务中,RoboBrain 2.5能够生成更精确的操作轨迹,并提供更稳定的反馈信号,从而提高了任务的成功率和效率。与现有基线模型相比,RoboBrain 2.5在空间推理和时间建模方面均表现出更强的能力。

🎯 应用场景

RoboBrain 2.5具有广泛的应用前景,可应用于机器人操作、自动驾驶、智能制造等领域。通过提升具身智能体的空间推理和时间建模能力,RoboBrain 2.5能够使机器人更好地理解和执行复杂任务,从而提高生产效率和安全性。未来,该模型有望成为通用具身智能的基础,推动相关领域的发展。

📄 摘要(原文)

We introduce RoboBrain 2.5, a next-generation embodied AI foundation model that advances general perception, spatial reasoning, and temporal modeling through extensive training on high-quality spatiotemporal supervision. Building upon its predecessor, RoboBrain 2.5 introduces two major capability upgrades. Specifically, it unlocks Precise 3D Spatial Reasoning by shifting from 2D pixel-relative grounding to depth-aware coordinate prediction and absolute metric constraint comprehension, generating complete 3D manipulation traces as ordered keypoint sequences under physical constraints. Complementing this spatial precision, the model establishes Dense Temporal Value Estimation that provides dense, step-aware progress prediction and execution state understanding across varying viewpoints, producing stable feedback signals for downstream learning. Together, these upgrades extend the framework toward more physically grounded and execution-aware embodied intelligence for complex, fine-grained manipulation. The code and checkpoints are available at project website: https://superrobobrain.github.io