Diffusion-Guided Backdoor Attacks in Real-World Reinforcement Learning

作者: Tairan Huang, Qingqing Ye, Yulin Jin, Jiawei Lian, Yi Wang, Haibo Hu

分类: cs.RO, cs.CV

发布日期: 2026-01-20

💡 一句话要点

提出扩散引导的后门攻击框架,提升真实机器人强化学习系统中的攻击成功率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 后门攻击 强化学习 机器人安全 扩散模型 对抗性攻击

📋 核心要点

- 现有后门攻击在真实机器人系统中效果不佳,因为安全约束会抑制异常动作,导致攻击衰减。

- DGBA框架利用条件扩散模型生成多样化的视觉补丁触发器,并采用基于优势的投毒策略,提升攻击效果。

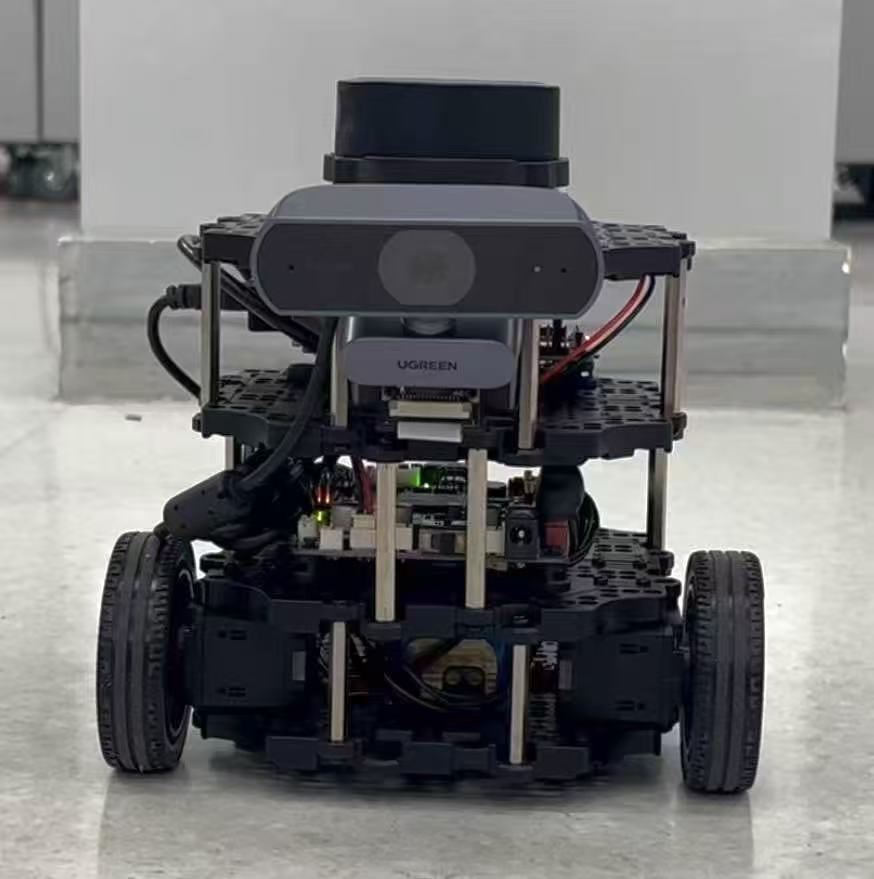

- 在TurtleBot3机器人上的实验表明,DGBA能够可靠地激活目标攻击,同时保持正常的任务性能。

📝 摘要(中文)

后门攻击将隐藏的恶意行为嵌入到强化学习(RL)策略中,并在测试时使用触发器激活它们。现有的大多数攻击仅在模拟环境中验证,其在真实机器人系统中的有效性尚不清楚。在物理部署中,速度限制、动作平滑和避碰等安全约束控制管道会抑制异常动作,导致传统后门攻击的强烈衰减。我们研究了这一先前被忽视的问题,并提出了一种用于真实世界RL的扩散引导后门攻击框架(DGBA)。我们设计了放置在地板上的小型可打印视觉补丁触发器,并使用条件扩散模型生成它们,该模型可以在真实世界的视觉变化下产生多样化的补丁外观。我们将机器人控制堆栈视为黑盒系统。我们进一步引入了一种基于优势的投毒策略,该策略仅在决策关键的训练状态下注入触发器。我们在TurtleBot3移动机器人上评估了我们的方法,并证明了目标攻击的可靠激活,同时保留了正常的任务性能。演示视频和代码可在补充材料中找到。

🔬 方法详解

问题定义:现有后门攻击方法在模拟环境中有效,但在真实机器人系统中,由于速度限制、动作平滑、避障等安全机制的存在,攻击效果会大打折扣。这些安全机制会抑制异常动作,使得触发器难以激活恶意行为。因此,如何在真实机器人系统中实现有效的后门攻击是一个挑战。

核心思路:论文的核心思路是利用条件扩散模型生成更鲁棒、更具迷惑性的视觉触发器,并结合基于优势的投毒策略,使得触发器能够在真实世界的复杂环境中更容易地激活恶意行为。通过将机器人控制堆栈视为黑盒系统,避免了对底层控制逻辑的依赖,提高了攻击的通用性。

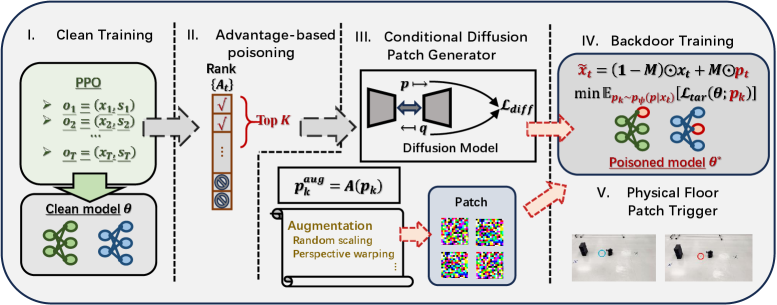

技术框架:DGBA框架主要包含三个模块:1) 触发器生成模块:使用条件扩散模型生成视觉补丁触发器,该模型能够根据真实世界的视觉变化生成多样化的补丁外观。2) 投毒策略模块:采用基于优势的投毒策略,仅在决策关键的训练状态下注入触发器,以提高攻击效率。3) 攻击执行模块:在测试阶段,将生成的触发器放置在环境中,当机器人检测到触发器时,激活后门,执行恶意行为。

关键创新:论文的关键创新在于:1) 提出了基于条件扩散模型的触发器生成方法,能够生成更适应真实环境的视觉触发器。2) 提出了基于优势的投毒策略,能够更有效地利用有限的投毒数据,提高攻击成功率。3) 将机器人控制堆栈视为黑盒系统,避免了对底层控制逻辑的依赖,提高了攻击的通用性。

关键设计:条件扩散模型使用U-Net结构,以真实世界的图像作为条件,生成多样化的视觉补丁触发器。基于优势的投毒策略通过计算每个状态的优势函数,选择优势值较高的状态进行投毒。损失函数包括正常任务的损失和后门攻击的损失,通过调整权重平衡两者之间的关系。

🖼️ 关键图片

📊 实验亮点

实验结果表明,DGBA框架能够在TurtleBot3移动机器人上实现可靠的后门攻击,同时保持正常的任务性能。与传统的后门攻击方法相比,DGBA能够显著提高攻击成功率,即使在存在速度限制、动作平滑和避障等安全机制的情况下。具体而言,DGBA在保持正常任务性能的同时,能够以较高的概率触发预设的恶意行为,例如偏离目标路径或进入禁区。

🎯 应用场景

该研究成果可应用于评估和增强真实机器人系统的安全性,尤其是在涉及安全关键任务的场景中,如自动驾驶、工业机器人等。通过模拟和分析后门攻击,可以帮助研究人员和工程师发现系统中的潜在漏洞,并开发相应的防御机制,提高系统的鲁棒性和可靠性。此外,该研究也可以用于开发更安全的强化学习算法,防止恶意攻击者利用后门攻击来破坏系统的正常运行。

📄 摘要(原文)

Backdoor attacks embed hidden malicious behaviors in reinforcement learning (RL) policies and activate them using triggers at test time. Most existing attacks are validated only in simulation, while their effectiveness in real-world robotic systems remains unclear. In physical deployment, safety-constrained control pipelines such as velocity limiting, action smoothing, and collision avoidance suppress abnormal actions, causing strong attenuation of conventional backdoor attacks. We study this previously overlooked problem and propose a diffusion-guided backdoor attack framework (DGBA) for real-world RL. We design small printable visual patch triggers placed on the floor and generate them using a conditional diffusion model that produces diverse patch appearances under real-world visual variations. We treat the robot control stack as a black-box system. We further introduce an advantage-based poisoning strategy that injects triggers only at decision-critical training states. We evaluate our method on a TurtleBot3 mobile robot and demonstrate reliable activation of targeted attacks while preserving normal task performance. Demo videos and code are available in the supplementary material.