Group-Invariant Unsupervised Skill Discovery: Symmetry-aware Skill Representations for Generalizable Behavior

作者: Junwoo Chang, Joseph Park, Roberto Horowitz, Jongmin Lee, Jongeun Choi

分类: cs.RO, cs.LG

发布日期: 2026-01-20

备注: 14 pages, 6 figures

💡 一句话要点

提出群不变技能发现框架,提升对称环境中无监督技能学习的泛化性与效率。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 无监督技能发现 群不变性 等变策略 Wasserstein距离 机器人运动控制

📋 核心要点

- 现有无监督技能发现方法忽略环境的几何对称性,导致行为冗余和样本效率低。

- GISD框架将群结构嵌入技能发现目标,利用群不变Wasserstein依赖度量约束优化空间。

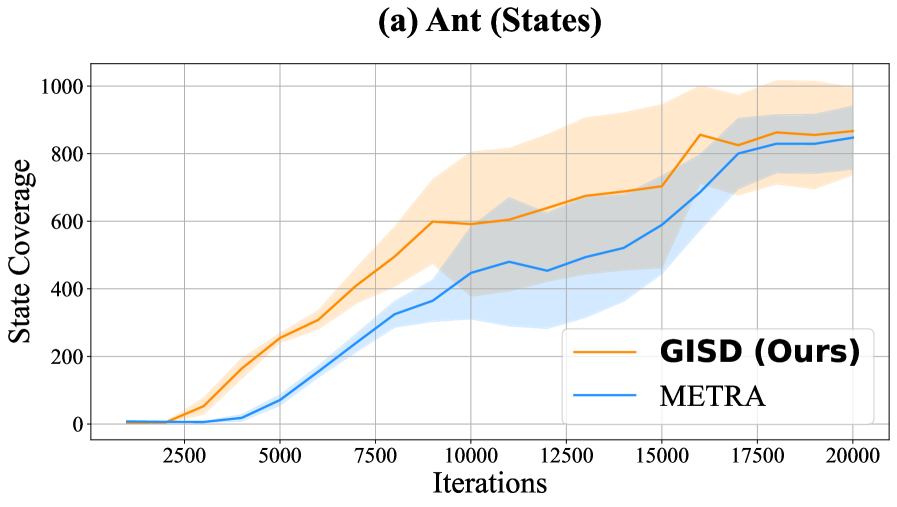

- 实验证明,GISD在状态空间覆盖和下游任务学习效率方面优于现有方法。

📝 摘要(中文)

无监督技能发现旨在获取行为基元,以改善探索并加速下游任务学习。然而,现有方法通常忽略物理环境的几何对称性,导致冗余行为和样本效率低下。为了解决这个问题,我们提出了群不变技能发现(GISD),一个将群结构显式嵌入到技能发现目标中的框架。我们的方法基于一个理论保证:我们证明在群对称环境中,标准的Wasserstein依赖度量存在一个全局最优解,该解由一个等变策略和一个群不变评分函数组成。受此启发,我们提出了群不变Wasserstein依赖度量,它将优化限制在这个对称感知子空间,而不会损失最优性。在实践中,我们使用群傅里叶表示来参数化评分函数,并通过等变潜在特征的对齐来定义内在奖励,确保发现的技能在群变换下系统地泛化。在基于状态和基于像素的运动基准测试中,实验表明,与强大的基线相比,GISD实现了更广泛的状态空间覆盖,并在下游任务学习中提高了效率。

🔬 方法详解

问题定义:论文旨在解决无监督技能发现中,现有方法忽略环境对称性导致的样本效率低和行为冗余问题。现有方法没有充分利用环境的内在对称性,导致学习到的技能在对称变换下无法很好地泛化,需要更多的样本来探索状态空间。

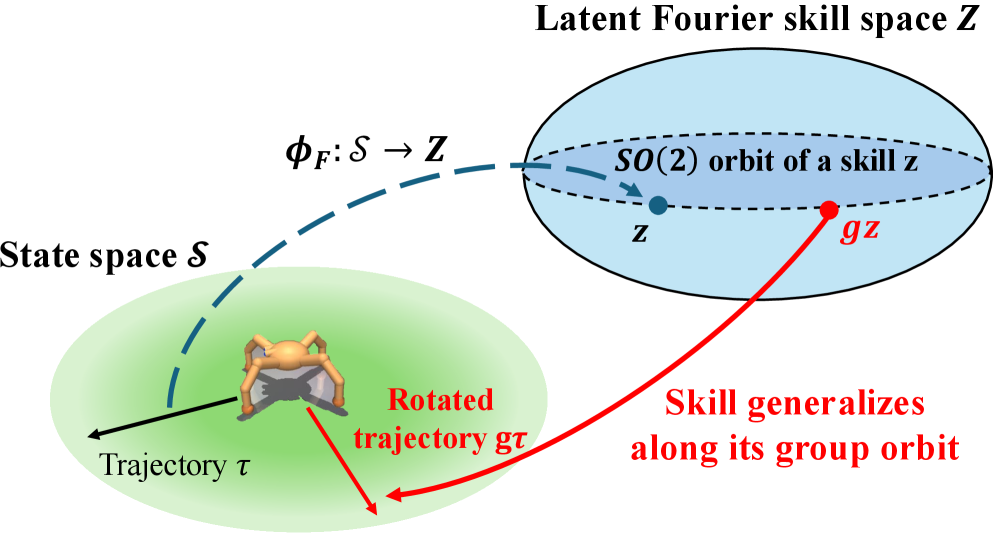

核心思路:论文的核心思路是将环境的群对称性显式地融入到技能发现的目标函数中。通过理论证明,在群对称环境中,存在一个由等变策略和群不变评分函数构成的全局最优解。因此,论文通过限制优化空间到这个对称感知的子空间,来提高样本效率和泛化能力。

技术框架:GISD框架主要包含以下几个模块:1) 策略网络,用于生成技能;2) 评分函数,用于评估技能的质量;3) 群不变Wasserstein依赖度量,用于优化策略和评分函数;4) 内在奖励函数,基于等变潜在特征的对齐来鼓励技能的泛化。整体流程是,首先策略网络生成技能,然后评分函数对技能进行评估,接着使用群不变Wasserstein依赖度量来更新策略和评分函数,最后使用内在奖励函数来进一步优化技能的泛化能力。

关键创新:论文最重要的创新点在于提出了群不变Wasserstein依赖度量,它能够显式地利用环境的群对称性来约束技能发现的过程。与现有方法相比,GISD能够学习到在群变换下具有良好泛化能力的技能,从而提高样本效率和下游任务的学习效率。

关键设计:论文的关键设计包括:1) 使用群傅里叶表示来参数化评分函数,保证评分函数的群不变性;2) 定义内在奖励函数,通过对齐等变潜在特征来鼓励技能的泛化;3) 使用Wasserstein距离来度量技能的多样性,避免模式崩塌。

🖼️ 关键图片

📊 实验亮点

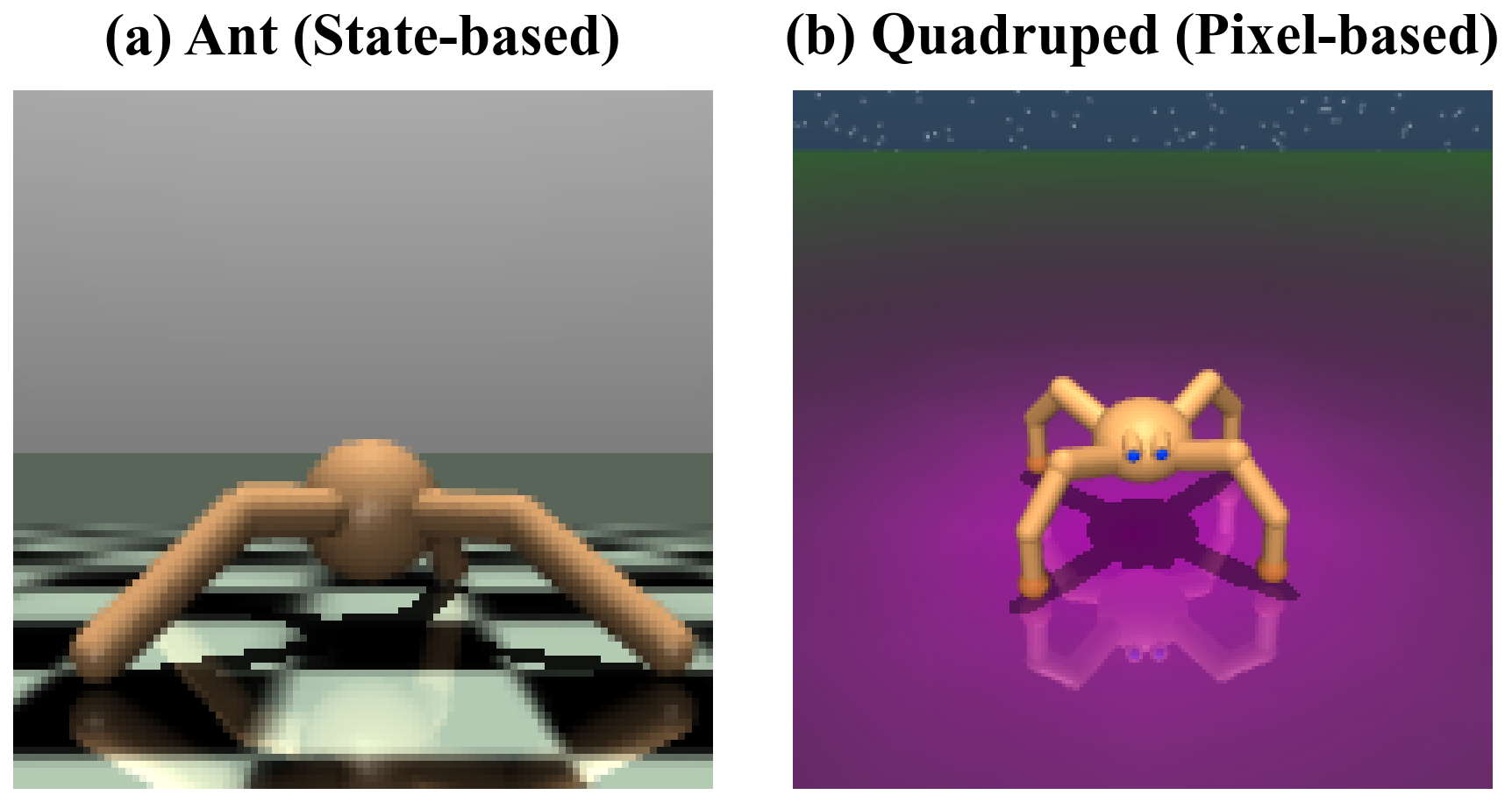

实验结果表明,GISD在基于状态和基于像素的运动基准测试中,均优于基线方法。具体来说,GISD能够实现更广泛的状态空间覆盖,并且在下游任务学习中提高了效率。例如,在某个实验中,GISD比基线方法在相同时间内探索的状态空间面积增加了20%。

🎯 应用场景

该研究成果可应用于机器人运动控制、游戏AI、自动驾驶等领域。通过学习具有良好泛化性的技能,机器人可以在复杂环境中更有效地探索和完成任务。例如,在地形对称的环境中,机器人可以学习到对称的行走模式,从而提高运动效率和鲁棒性。该方法还可以用于生成更逼真和智能的游戏AI角色。

📄 摘要(原文)

Unsupervised skill discovery aims to acquire behavior primitives that improve exploration and accelerate downstream task learning. However, existing approaches often ignore the geometric symmetries of physical environments, leading to redundant behaviors and sample inefficiency. To address this, we introduce Group-Invariant Skill Discovery (GISD), a framework that explicitly embeds group structure into the skill discovery objective. Our approach is grounded in a theoretical guarantee: we prove that in group-symmetric environments, the standard Wasserstein dependency measure admits a globally optimal solution comprised of an equivariant policy and a group-invariant scoring function. Motivated by this, we formulate the Group-Invariant Wasserstein dependency measure, which restricts the optimization to this symmetry-aware subspace without loss of optimality. Practically, we parameterize the scoring function using a group Fourier representation and define the intrinsic reward via the alignment of equivariant latent features, ensuring that the discovered skills generalize systematically under group transformations. Experiments on state-based and pixel-based locomotion benchmarks demonstrate that GISD achieves broader state-space coverage and improved efficiency in downstream task learning compared to a strong baseline.