ForeDiffusion: Foresight-Conditioned Diffusion Policy via Future View Construction for Robot Manipulation

作者: Weize Xie, Yi Ding, Ying He, Leilei Wang, Binwen Bai, Zheyi Zhao, Chenyang Wang, F. Richard Yu

分类: cs.RO, cs.AI

发布日期: 2026-01-19

💡 一句话要点

ForeDiffusion:通过未来视图构建的前瞻条件扩散策略,提升机器人操作性能

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人操作 扩散模型 视觉预测 前瞻策略 强化学习

📋 核心要点

- 现有扩散策略在复杂机器人操作任务中,由于仅依赖短期观测和单一去噪损失,导致性能下降和误差累积。

- ForeDiffusion通过预测未来视图并将其融入扩散过程,使策略具备前瞻性,从而纠正轨迹偏差。

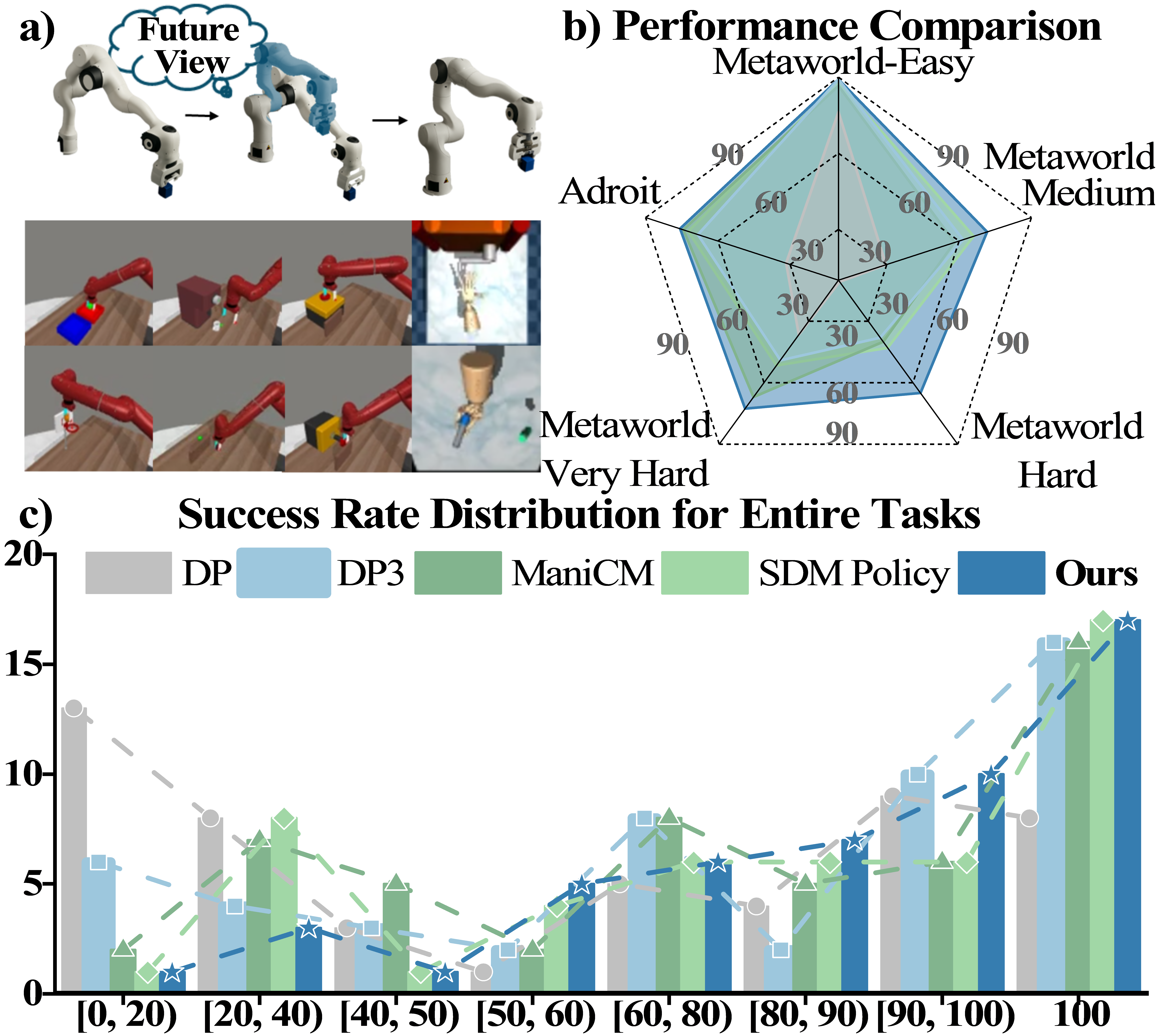

- 实验结果表明,ForeDiffusion在复杂任务中显著优于现有方法,成功率提升23%,并在多个任务中表现稳定。

📝 摘要(中文)

扩散策略通过逐步去噪高维动作序列,在视觉运动控制领域取得了显著进展,为机器人操作提供了一种有前景的方法。然而,随着任务复杂性的增加,现有基线模型的成功率显著下降。分析表明,当前的扩散策略面临两个局限性:一是仅依赖短期观察作为条件;二是训练目标仅限于单一的去噪损失,导致误差累积并引起抓取偏差。为了解决这些局限性,本文提出了一种前瞻条件扩散(ForeDiffusion)方法,通过将预测的未来视图表示注入到扩散过程中,引导策略具有前瞻性,从而能够纠正轨迹偏差。此外,ForeDiffusion采用双重损失机制,结合传统的去噪损失和未来观察的一致性损失,实现统一优化。在Adroit套件和MetaWorld基准上的大量评估表明,ForeDiffusion在整体任务中的平均成功率达到80%,在复杂任务中显著优于现有的主流扩散方法23%,并在所有任务中保持更稳定的性能。

🔬 方法详解

问题定义:现有基于扩散模型的机器人操作方法,在处理复杂任务时,由于仅依赖短期观测信息,缺乏对未来状态的预测和规划能力,导致策略容易陷入局部最优,产生误差累积,最终影响任务成功率。此外,单一的去噪损失函数无法有效约束策略的学习,导致抓取等操作出现偏差。

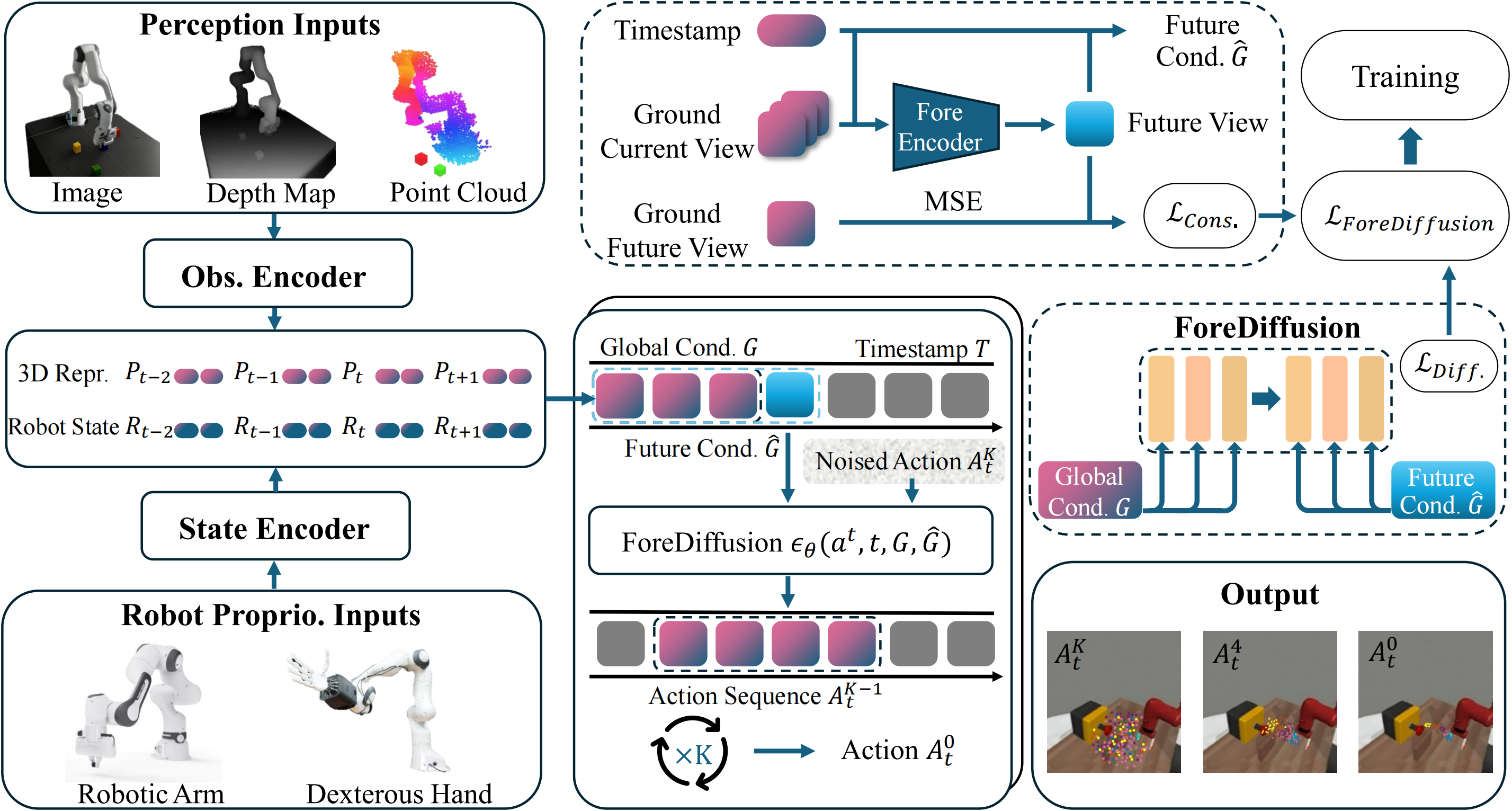

核心思路:ForeDiffusion的核心思路是赋予扩散策略“前瞻性”。通过预测未来时刻的视觉表征,并将这些表征作为条件融入到扩散模型的去噪过程中,引导策略在当前时刻的决策考虑到未来的状态,从而避免短视行为,提高策略的鲁棒性和泛化能力。

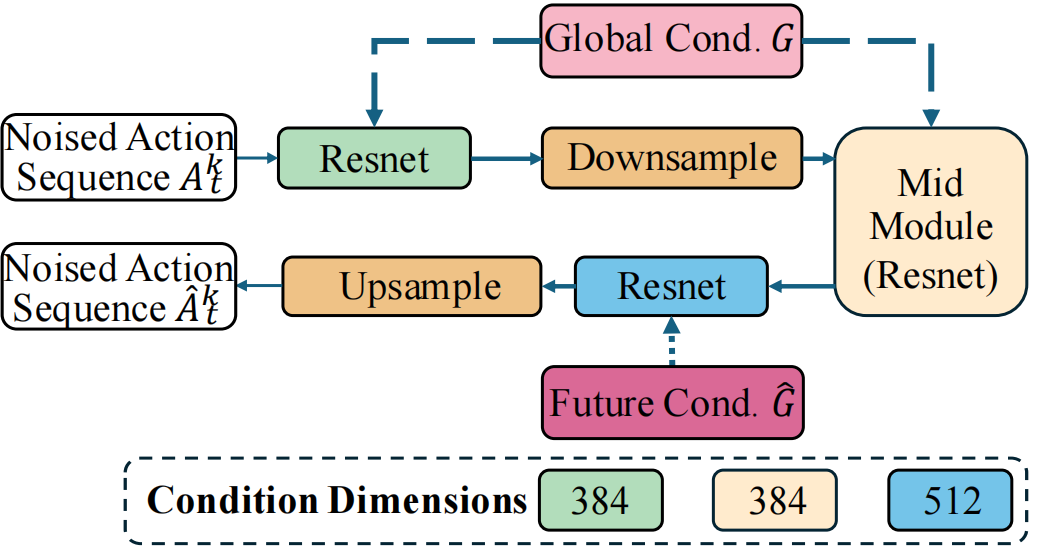

技术框架:ForeDiffusion包含以下主要模块:1) 未来视图预测模块:基于当前观测,预测未来一段时间内的视觉表征。2) 条件扩散模型:以当前观测和预测的未来视图为条件,进行动作序列的去噪过程。3) 双重损失函数:结合传统的去噪损失和未来观测一致性损失,共同优化模型参数。整体流程是,首先利用未来视图预测模块获得未来状态的表征,然后将该表征与当前状态一同输入到条件扩散模型中,指导动作序列的生成,最后通过双重损失函数进行模型训练。

关键创新:ForeDiffusion的关键创新在于将未来视图预测与扩散模型相结合,提出了一种前瞻性的策略学习框架。与传统的仅依赖当前观测的扩散策略相比,ForeDiffusion能够更好地理解任务的长期目标,并做出更合理的决策。此外,双重损失函数的设计,进一步增强了策略的稳定性和准确性。

关键设计:未来视图预测模块可以使用各种预测模型,例如基于Transformer的模型或循环神经网络。条件扩散模型可以使用标准的U-Net结构,并将未来视图表征通过注意力机制融入到去噪过程中。双重损失函数包括:1) 去噪损失:衡量去噪后的动作序列与原始动作序列之间的差异。2) 未来观测一致性损失:衡量预测的未来视图与实际观测到的未来视图之间的差异。具体实现中,可以采用L1或L2损失函数,并根据任务的特点调整两种损失的权重。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ForeDiffusion在Adroit和MetaWorld基准测试中取得了显著的性能提升。在整体任务中,ForeDiffusion的平均成功率达到80%,显著优于现有的主流扩散方法。在复杂任务中,ForeDiffusion的成功率提升了23%,表明其在处理复杂场景时具有更强的优势。此外,ForeDiffusion在所有任务中表现出更稳定的性能,验证了其鲁棒性和泛化能力。

🎯 应用场景

ForeDiffusion具有广泛的应用前景,可应用于各种需要长期规划和复杂操作的机器人任务中,例如:家庭服务机器人、工业自动化、医疗手术机器人等。通过赋予机器人前瞻性,可以使其更好地适应复杂环境,完成更具挑战性的任务,提高工作效率和安全性。该研究对于推动机器人智能化发展具有重要意义。

📄 摘要(原文)

Diffusion strategies have advanced visual motor control by progressively denoising high-dimensional action sequences, providing a promising method for robot manipulation. However, as task complexity increases, the success rate of existing baseline models decreases considerably. Analysis indicates that current diffusion strategies are confronted with two limitations. First, these strategies only rely on short-term observations as conditions. Second, the training objective remains limited to a single denoising loss, which leads to error accumulation and causes grasping deviations. To address these limitations, this paper proposes Foresight-Conditioned Diffusion (ForeDiffusion), by injecting the predicted future view representation into the diffusion process. As a result, the policy is guided to be forward-looking, enabling it to correct trajectory deviations. Following this design, ForeDiffusion employs a dual loss mechanism, combining the traditional denoising loss and the consistency loss of future observations, to achieve the unified optimization. Extensive evaluation on the Adroit suite and the MetaWorld benchmark demonstrates that ForeDiffusion achieves an average success rate of 80% for the overall task, significantly outperforming the existing mainstream diffusion methods by 23% in complex tasks, while maintaining more stable performance across the entire tasks.