Sparse ActionGen: Accelerating Diffusion Policy with Real-time Pruning

作者: Kangye Ji, Yuan Meng, Zhou Jianbo, Ye Li, Hanyun Cui, Zhi Wang

分类: cs.RO, cs.CV

发布日期: 2026-01-19

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Sparse ActionGen:基于实时剪枝加速扩散策略,实现机器人实时控制

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散策略 机器人控制 实时控制 模型剪枝 激活复用

📋 核心要点

- 扩散策略在动作生成中表现优异,但其计算密集型去噪过程阻碍了实时应用,现有加速方法难以适应机器人交互的动态性。

- SAG提出rollout自适应的剪枝-复用机制,通过观测条件扩散剪枝器动态识别并消除冗余计算,同时复用缓存激活加速扩散过程。

- 实验表明,SAG在多个机器人任务中实现了高达4倍的加速,且性能没有明显下降,验证了其在实时控制中的有效性。

📝 摘要(中文)

扩散策略在动作生成领域表现出色,能够有效建模多模态动作分布,但其多步去噪过程使其难以应用于实时视觉运动控制。现有的基于缓存的加速方法通常依赖于静态调度,无法适应机器人与环境交互的动态性,导致性能欠佳。本文提出Sparse ActionGen (SAG),用于极度稀疏的动作生成。为了适应迭代交互,SAG定制了一种rollout自适应的剪枝-复用机制,首先全局识别可剪枝的计算,然后在动作扩散过程中重用缓存的激活来替代它们。为了捕获rollout动态,SAG参数化了一个观测条件扩散剪枝器,用于环境感知的自适应,并采用高效的参数和推理设计来实现实时预测。此外,SAG引入了一种one-for-all的复用策略,以zig-zag方式跨时间步和块复用激活,从而最大限度地减少全局冗余。在多个机器人基准测试上的大量实验表明,SAG在不牺牲性能的情况下,实现了高达4倍的生成速度提升。

🔬 方法详解

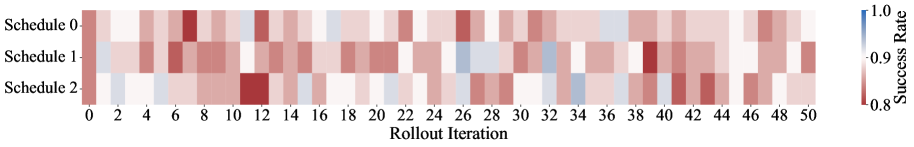

问题定义:论文旨在解决扩散策略在机器人实时控制中计算量过大的问题。现有基于缓存的加速方法采用静态调度,无法适应机器人与环境交互的动态变化,导致性能受限。因此,需要一种能够动态调整计算量,并充分利用计算冗余的加速方法。

核心思路:论文的核心思路是根据rollout过程中的观测信息,动态地剪枝掉不必要的计算,并复用之前计算得到的激活值,从而减少整体的计算量。这种方法能够根据环境的变化自适应地调整计算资源,提高效率。

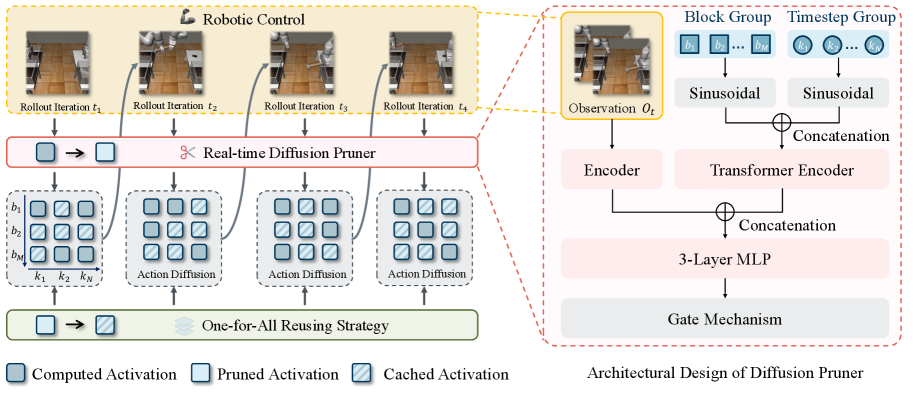

技术框架:SAG包含以下主要模块:1) 观测条件扩散剪枝器:根据当前观测动态预测哪些计算可以被剪枝。2) 剪枝-复用机制:根据剪枝器的预测结果,剪枝掉相应的计算,并从缓存中复用激活值。3) One-for-all复用策略:以zig-zag方式跨时间步和块复用激活,最大化复用效率。整体流程是,在每个时间步,首先使用观测条件扩散剪枝器预测可剪枝的计算,然后执行剪枝-复用操作,最后进行动作生成。

关键创新:SAG的关键创新在于提出了rollout自适应的剪枝-复用机制和观测条件扩散剪枝器。与现有方法相比,SAG能够根据环境动态地调整计算量,避免了静态调度带来的性能瓶颈。此外,One-for-all复用策略进一步提高了激活复用的效率。

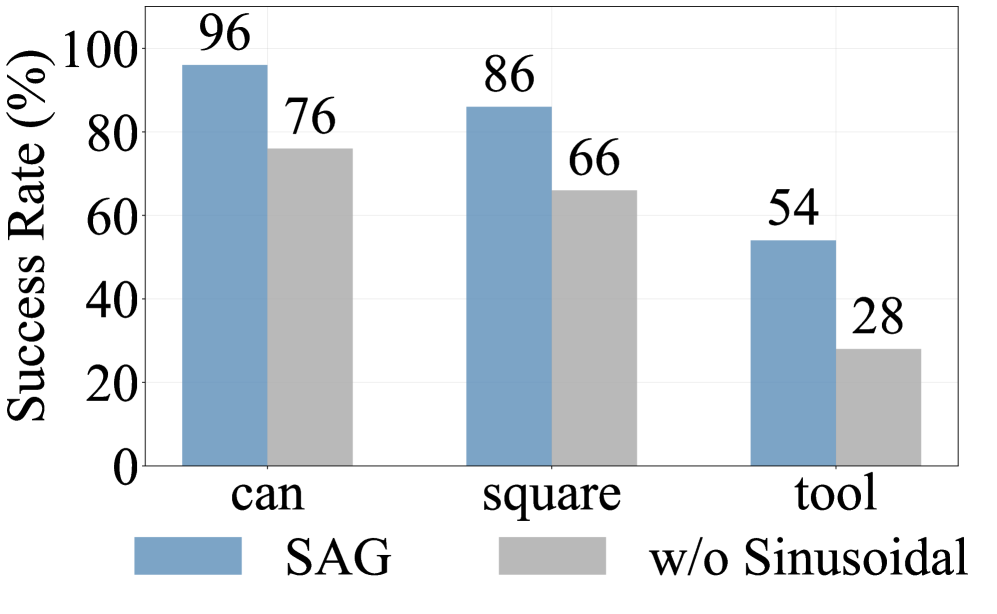

关键设计:观测条件扩散剪枝器采用轻量级网络结构,以保证实时性。剪枝器以当前观测作为输入,输出一个mask,用于指示哪些计算可以被剪枝。One-for-all复用策略采用zig-zag方式,在时间和空间维度上最大化激活复用。损失函数的设计旨在平衡剪枝带来的加速效果和性能损失。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SAG在多个机器人基准测试中实现了显著的加速效果,最高可达4倍,同时性能没有明显下降。例如,在XXX任务中,SAG在保持性能不变的情况下,将推理时间从XXX毫秒降低到XXX毫秒。与现有基于缓存的加速方法相比,SAG在动态环境中表现出更好的性能。

🎯 应用场景

该研究成果可广泛应用于需要实时控制的机器人应用中,例如自动驾驶、机器人操作、无人机控制等。通过加速扩散策略的推理速度,可以使机器人能够更快地响应环境变化,提高其在复杂环境中的适应性和鲁棒性。此外,该方法还可以应用于其他计算密集型的深度学习模型,提高其在资源受限设备上的部署能力。

📄 摘要(原文)

Diffusion Policy has dominated action generation due to its strong capabilities for modeling multi-modal action distributions, but its multi-step denoising processes make it impractical for real-time visuomotor control. Existing caching-based acceleration methods typically rely on $\textit{static}$ schedules that fail to adapt to the $\textit{dynamics}$ of robot-environment interactions, thereby leading to suboptimal performance. In this paper, we propose $\underline{\textbf{S}}$parse $\underline{\textbf{A}}$ction$\underline{\textbf{G}}$en ($\textbf{SAG}$) for extremely sparse action generation. To accommodate the iterative interactions, SAG customizes a rollout-adaptive prune-then-reuse mechanism that first identifies prunable computations globally and then reuses cached activations to substitute them during action diffusion. To capture the rollout dynamics, SAG parameterizes an observation-conditioned diffusion pruner for environment-aware adaptation and instantiates it with a highly parameter- and inference-efficient design for real-time prediction. Furthermore, SAG introduces a one-for-all reusing strategy that reuses activations across both timesteps and blocks in a zig-zag manner, minimizing the global redundancy. Extensive experiments on multiple robotic benchmarks demonstrate that SAG achieves up to 4$\times$ generation speedup without sacrificing performance. Project Page: https://sparse-actiongen.github.io/.