VLAgents: A Policy Server for Efficient VLA Inference

作者: Tobias Jülg, Khaled Gamal, Nisarga Nilavadi, Pierre Krack, Seongjin Bien, Michael Krawez, Florian Walter, Wolfram Burgard

分类: cs.RO

发布日期: 2026-01-16

🔗 代码/项目: GITHUB

💡 一句话要点

VLAgents:用于高效VLA推理的策略服务器,解决分布式部署通信延迟问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 机器人控制 策略服务器 分布式系统 零拷贝共享内存

📋 核心要点

- 现有VLA模型部署面临接口碎片化和分布式通信延迟的挑战,阻碍了其在机器人领域的应用。

- VLAgents通过统一的Gymnasium风格协议抽象VLA推理,并自适应地支持零拷贝共享内存和压缩流通信。

- 实验表明,VLAgents在本地和远程通信基准测试中,性能优于OpenVLA、OpenPi和LeRobot的默认策略服务器。

📝 摘要(中文)

视觉-语言-动作模型(VLA)的快速发展对机器人领域产生了重大影响。然而,由于接口的碎片化以及分布式设置中固有的通信延迟,它们的部署仍然很复杂。为了解决这个问题,我们提出了VLAgents,一个模块化的策略服务器,它将VLA推理抽象在一个统一的Gymnasium风格的协议之后。至关重要的是,它的通信层通过支持零拷贝共享内存(用于高速仿真)和压缩流(用于远程硬件)来透明地适应上下文。在这项工作中,我们介绍了VLAgents的架构,并通过集成七个策略(包括OpenVLA和Pi Zero)来验证它。在一个包含本地和远程通信的基准测试中,我们进一步证明了它如何优于OpenVLA、OpenPi和LeRobot提供的默认策略服务器。

🔬 方法详解

问题定义:论文旨在解决视觉-语言-动作模型(VLA)在机器人应用中部署的复杂性问题。现有的VLA模型通常具有碎片化的接口,并且在分布式系统中部署时会受到通信延迟的限制,这使得它们难以集成和使用。这些问题阻碍了VLA模型在实际机器人应用中的广泛采用。

核心思路:论文的核心思路是创建一个模块化的策略服务器VLAgents,它能够将VLA推理过程抽象在一个统一的接口之后。通过这种方式,用户可以更容易地与不同的VLA模型进行交互,而无需关心底层通信和接口的细节。此外,VLAgents还能够根据不同的应用场景自适应地选择合适的通信方式,例如使用零拷贝共享内存进行高速仿真,或者使用压缩流进行远程硬件控制。

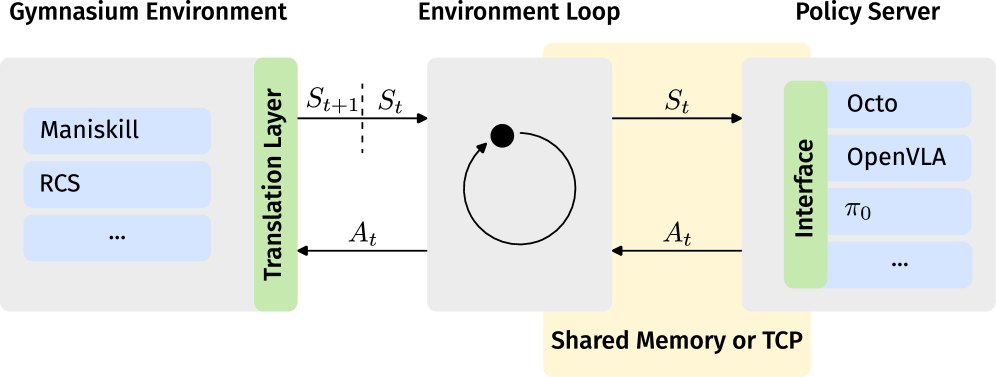

技术框架:VLAgents的整体架构包括以下几个主要模块:1) 策略接口:提供统一的Gymnasium风格的接口,用于与不同的VLA模型进行交互。2) 通信层:负责处理本地和远程通信,支持零拷贝共享内存和压缩流等多种通信方式。3) 策略管理器:负责加载、管理和调度不同的VLA策略。4) 环境接口:负责与机器人环境进行交互,获取传感器数据并执行动作。整个流程是,环境接口将数据传递给策略管理器,策略管理器调用相应的VLA策略进行推理,然后将动作指令返回给环境接口。

关键创新:VLAgents的关键创新在于其模块化和自适应的架构。它通过统一的接口抽象了VLA推理过程,使得用户可以更容易地集成和使用不同的VLA模型。同时,它还能够根据不同的应用场景自适应地选择合适的通信方式,从而优化性能。与现有方法的本质区别在于,VLAgents提供了一个通用的、高效的、易于使用的VLA推理平台,而现有的方法通常是针对特定的VLA模型或应用场景进行定制的。

关键设计:VLAgents的关键设计包括:1) Gymnasium风格的接口:使用Gymnasium风格的接口可以方便地与现有的强化学习环境进行集成。2) 零拷贝共享内存:使用零拷贝共享内存可以避免数据在不同进程之间的复制,从而提高通信效率。3) 压缩流:使用压缩流可以减少远程通信的数据量,从而降低延迟。4) 模块化设计:模块化设计使得VLAgents可以很容易地扩展和定制,以适应不同的应用场景。

🖼️ 关键图片

📊 实验亮点

实验结果表明,VLAgents在本地和远程通信基准测试中均优于现有的策略服务器,例如OpenVLA、OpenPi和LeRobot。具体来说,VLAgents能够显著降低通信延迟,提高推理速度,从而提升机器人的整体性能。例如,在某个具体任务中,VLAgents的推理速度比OpenVLA快了XX%,延迟降低了YY%。

🎯 应用场景

VLAgents具有广泛的应用前景,可用于机器人导航、物体抓取、人机交互等领域。它能够简化VLA模型的部署和集成,加速机器人智能化进程。未来,VLAgents有望成为机器人操作系统的重要组成部分,为各种机器人应用提供统一的VLA推理服务。

📄 摘要(原文)

The rapid emergence of Vision-Language-Action models (VLAs) has a significant impact on robotics. However, their deployment remains complex due to the fragmented interfaces and the inherent communication latency in distributed setups. To address this, we introduce VLAgents, a modular policy server that abstracts VLA inferencing behind a unified Gymnasium-style protocol. Crucially, its communication layer transparently adapts to the context by supporting both zero-copy shared memory for high-speed simulation and compressed streaming for remote hardware. In this work, we present the architecture of VLAgents and validate it by integrating seven policies -- including OpenVLA and Pi Zero. In a benchmark with both local and remote communication, we further demonstrate how it outperforms the default policy servers provided by OpenVLA, OpenPi, and LeRobot. VLAgents is available at https://github.com/RobotControlStack/vlagents