CLARE: Continual Learning for Vision-Language-Action Models via Autonomous Adapter Routing and Expansion

作者: Ralf Römer, Yi Zhang, Angela P. Schoellig

分类: cs.RO, cs.LG

发布日期: 2026-01-14

备注: Project page: https://tum-lsy.github.io/clare. 9 pages, 5 figures

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

CLARE:面向视觉-语言-动作模型的自适应路由与扩展的持续学习框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 持续学习 视觉-语言-动作模型 机器人学习 自适应路由 无范例学习

📋 核心要点

- 现有VLA模型微调方法不适用于机器人长期运行,因为其无法在适应新任务的同时保留旧知识,且依赖任务标识符或存储先前数据。

- CLARE通过在VLA模型中引入轻量级适配器,并根据层级特征相似性自主扩展模型,实现参数高效的持续学习。

- 实验表明,CLARE在LIBERO基准上显著优于现有方法,实现了高性能且避免了灾难性遗忘,无需任务标签。

📝 摘要(中文)

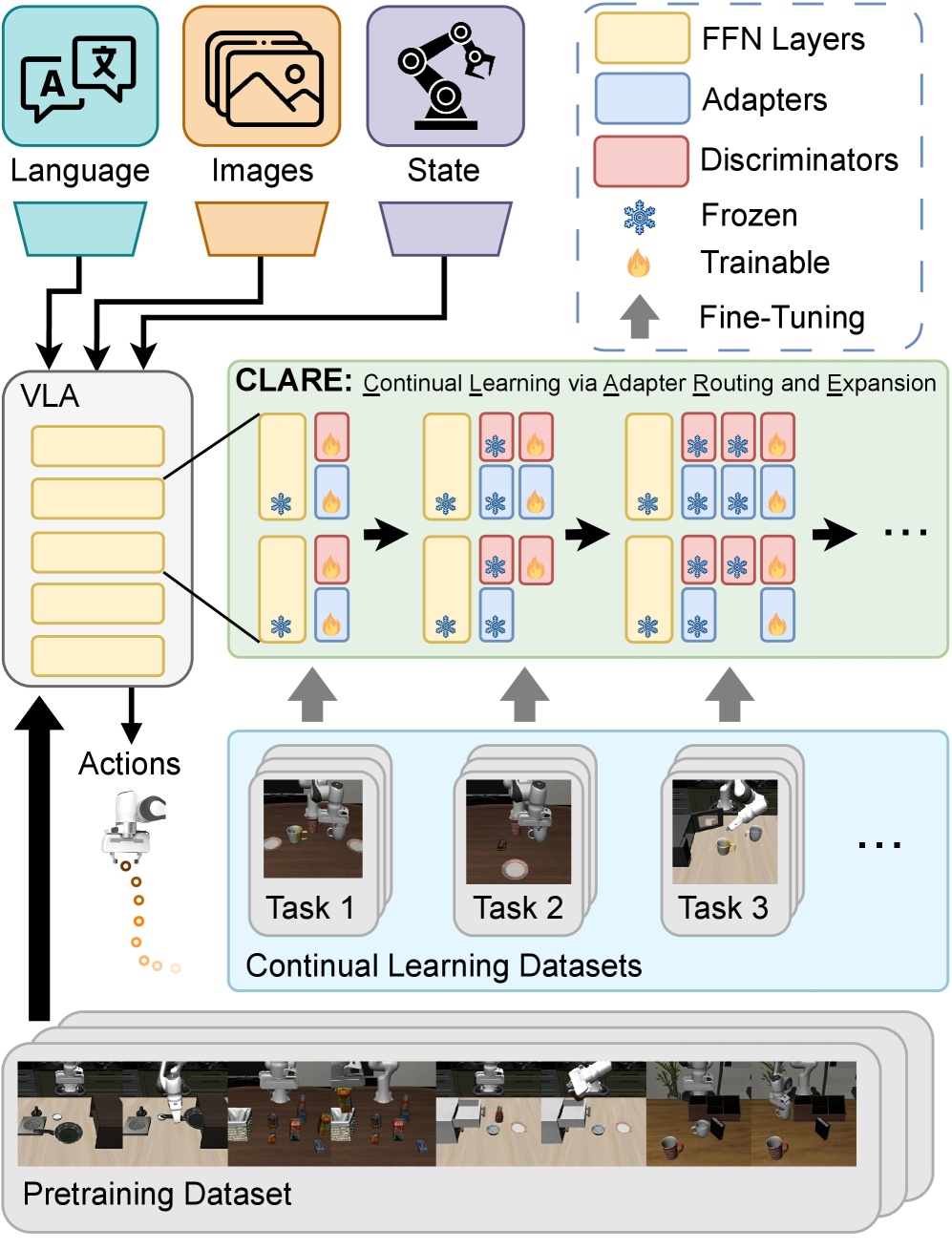

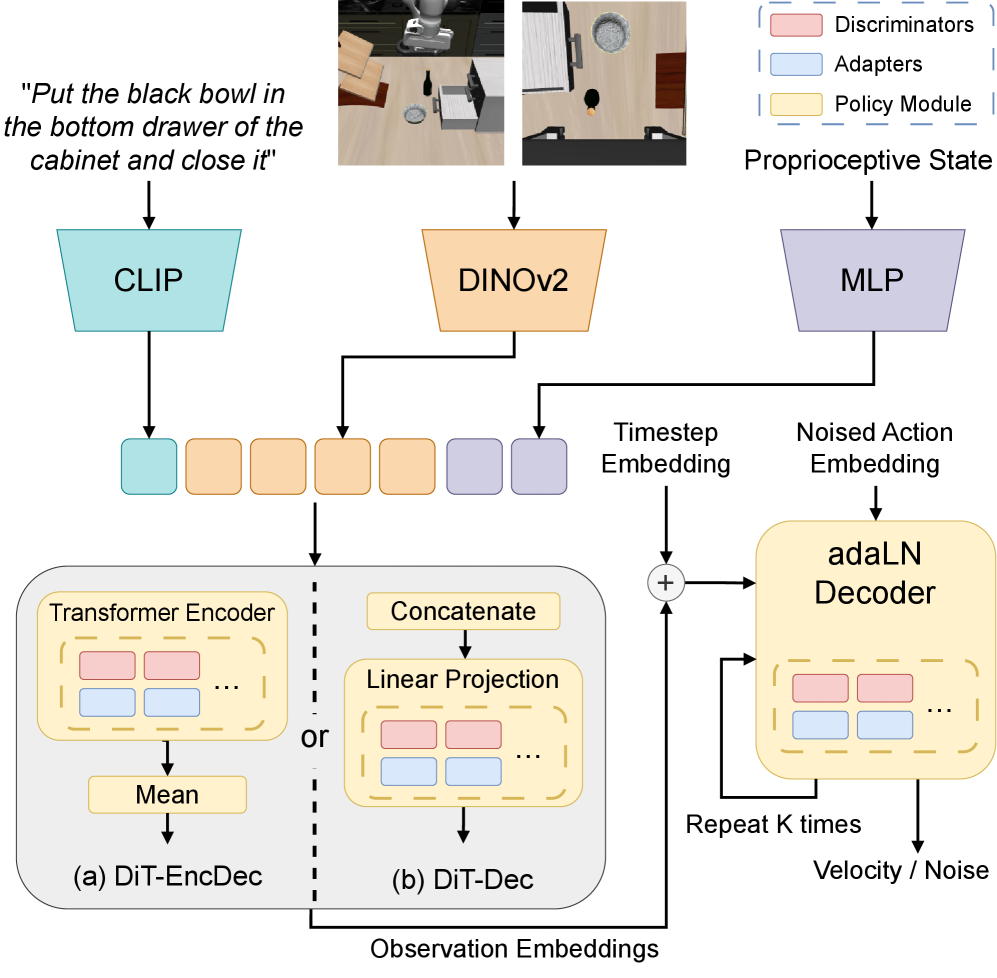

本文提出CLARE,一个通用的、参数高效的框架,用于视觉-语言-动作模型(VLA)的无范例持续学习。为了教机器人复杂的操控任务,通常的做法是在特定任务的数据上微调预训练的VLA模型。然而,这种方法会更新现有的表示,不适合机器人在真实世界中的长期运行,因为机器人必须不断适应新的任务和环境,同时保留已经获得的知识。现有的机器人持续学习方法通常需要存储先前的数据(范例),难以处理长任务序列,或者依赖于部署时的任务标识符。CLARE在选定的前馈层中引入轻量级的模块化适配器,并在学习新任务时,仅在必要时根据层级的特征相似性自主扩展模型。在部署期间,基于自编码器的路由机制动态地激活最相关的适配器,而无需任务标签。通过在LIBERO基准上的大量实验,我们表明CLARE在新任务上实现了高性能,且不会灾难性地遗忘早期任务,甚至显著优于基于范例的方法。代码和数据可在https://tum-lsy.github.io/clare 获取。

🔬 方法详解

问题定义:论文旨在解决视觉-语言-动作模型(VLA)在机器人持续学习场景下的灾难性遗忘问题。现有的VLA模型微调方法在适应新任务时会覆盖或修改先前学习的知识,导致性能下降。此外,许多现有的持续学习方法依赖于存储先前的数据样本(范例),这在存储资源有限的机器人应用中是不切实际的,或者需要任务标识符,这在实际部署中可能不可用。

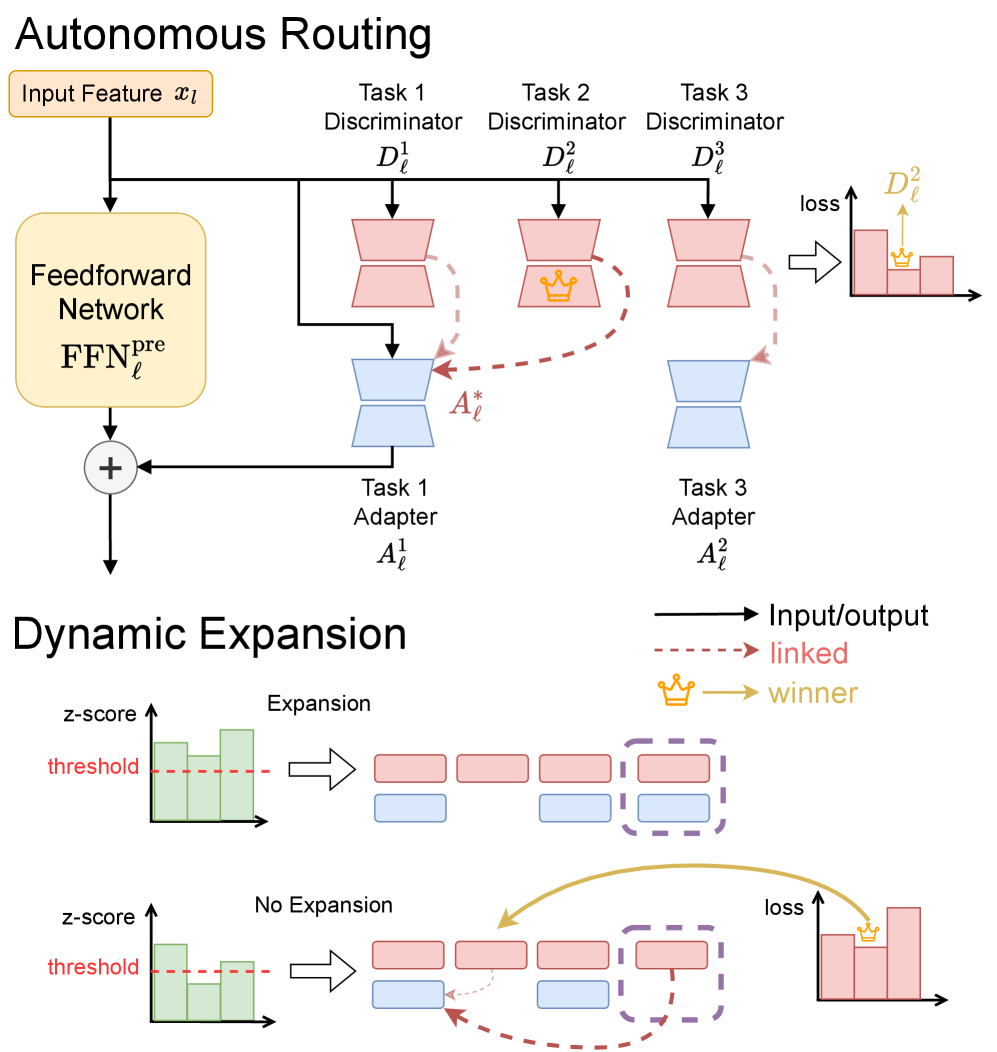

核心思路:CLARE的核心思路是通过引入轻量级的模块化适配器来学习新任务,而不是直接修改原始模型的参数。当学习新任务时,CLARE会根据层级的特征相似性,自动决定在哪些层添加新的适配器。这种方法可以有效地隔离不同任务的知识,避免相互干扰,从而减轻灾难性遗忘。此外,CLARE使用基于自编码器的路由机制,在部署时动态地激活最相关的适配器,而无需任务标签。

技术框架:CLARE框架主要包含以下几个模块:1) 适配器模块:在VLA模型的选定前馈层中插入轻量级的适配器,用于学习特定任务的知识。2) 自适应扩展模块:根据层级的特征相似性,自动决定在哪些层添加新的适配器。3) 路由模块:使用基于自编码器的路由机制,在部署时动态地激活最相关的适配器。整个流程是,当模型遇到新的任务时,首先通过自适应扩展模块确定需要添加适配器的层,然后在这些层中添加新的适配器并进行训练。在部署时,路由模块根据输入数据动态地选择激活哪些适配器。

关键创新:CLARE的关键创新在于其自适应的适配器路由和扩展机制。与传统的持续学习方法相比,CLARE不需要存储先前的数据样本,也不需要任务标识符。此外,CLARE的自适应扩展机制可以有效地控制模型的复杂度,避免过度参数化。基于自编码器的路由机制能够动态地选择最相关的适配器,从而提高模型的泛化能力。

关键设计:CLARE的关键设计包括:1) 适配器结构:适配器通常由一个瓶颈层和一个扩展层组成,用于学习特定任务的知识。2) 特征相似性度量:使用余弦相似度来度量不同层之间的特征相似性,从而确定需要添加适配器的层。3) 自编码器结构:自编码器用于学习每个适配器的特征表示,并根据输入数据动态地选择激活哪些适配器。4) 损失函数:使用交叉熵损失函数来训练适配器和自编码器,并使用正则化项来控制模型的复杂度。

🖼️ 关键图片

📊 实验亮点

CLARE在LIBERO基准测试中表现出色,显著优于现有的持续学习方法。具体来说,CLARE在多个任务上实现了更高的平均准确率,并且能够有效地避免灾难性遗忘。例如,在长任务序列中,CLARE的性能明显优于基于范例的方法,并且不需要存储先前的数据样本。此外,CLARE的自适应扩展机制可以有效地控制模型的复杂度,避免过度参数化,从而提高模型的泛化能力。

🎯 应用场景

CLARE具有广泛的应用前景,尤其是在机器人领域。它可以应用于各种需要持续学习和适应的机器人任务,例如家庭服务机器人、工业机器人和自动驾驶汽车。通过CLARE,机器人可以不断学习新的技能和适应新的环境,而无需人工干预,从而提高机器人的自主性和智能化水平。此外,CLARE还可以应用于其他需要持续学习的领域,例如自然语言处理和计算机视觉。

📄 摘要(原文)

To teach robots complex manipulation tasks, it is now a common practice to fine-tune a pre-trained vision-language-action model (VLA) on task-specific data. However, since this recipe updates existing representations, it is unsuitable for long-term operation in the real world, where robots must continually adapt to new tasks and environments while retaining the knowledge they have already acquired. Existing continual learning methods for robotics commonly require storing previous data (exemplars), struggle with long task sequences, or rely on task identifiers for deployment. To address these limitations, we propose CLARE, a general, parameter-efficient framework for exemplar-free continual learning with VLAs. CLARE introduces lightweight modular adapters into selected feedforward layers and autonomously expands the model only where necessary when learning a new task, guided by layer-wise feature similarity. During deployment, an autoencoder-based routing mechanism dynamically activates the most relevant adapters without requiring task labels. Through extensive experiments on the LIBERO benchmark, we show that CLARE achieves high performance on new tasks without catastrophic forgetting of earlier tasks, significantly outperforming even exemplar-based methods. Code and data are available at https://tum-lsy.github.io/clare.