CEI: A Unified Interface for Cross-Embodiment Visuomotor Policy Learning in 3D Space

作者: Tong Wu, Shoujie Li, Junhao Gong, Changqing Guo, Xingting Li, Shilong Mu, Wenbo Ding

分类: cs.RO

发布日期: 2026-01-14

💡 一句话要点

CEI:用于三维空间跨具身视觉运动策略学习的统一接口

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 跨具身学习 机器人策略迁移 功能相似性 定向Chamfer距离 机器人操作 机器人基础模型 视觉运动策略

📋 核心要点

- 现有机器人基础模型易过拟合特定机器人形态,缺乏跨具身泛化能力。

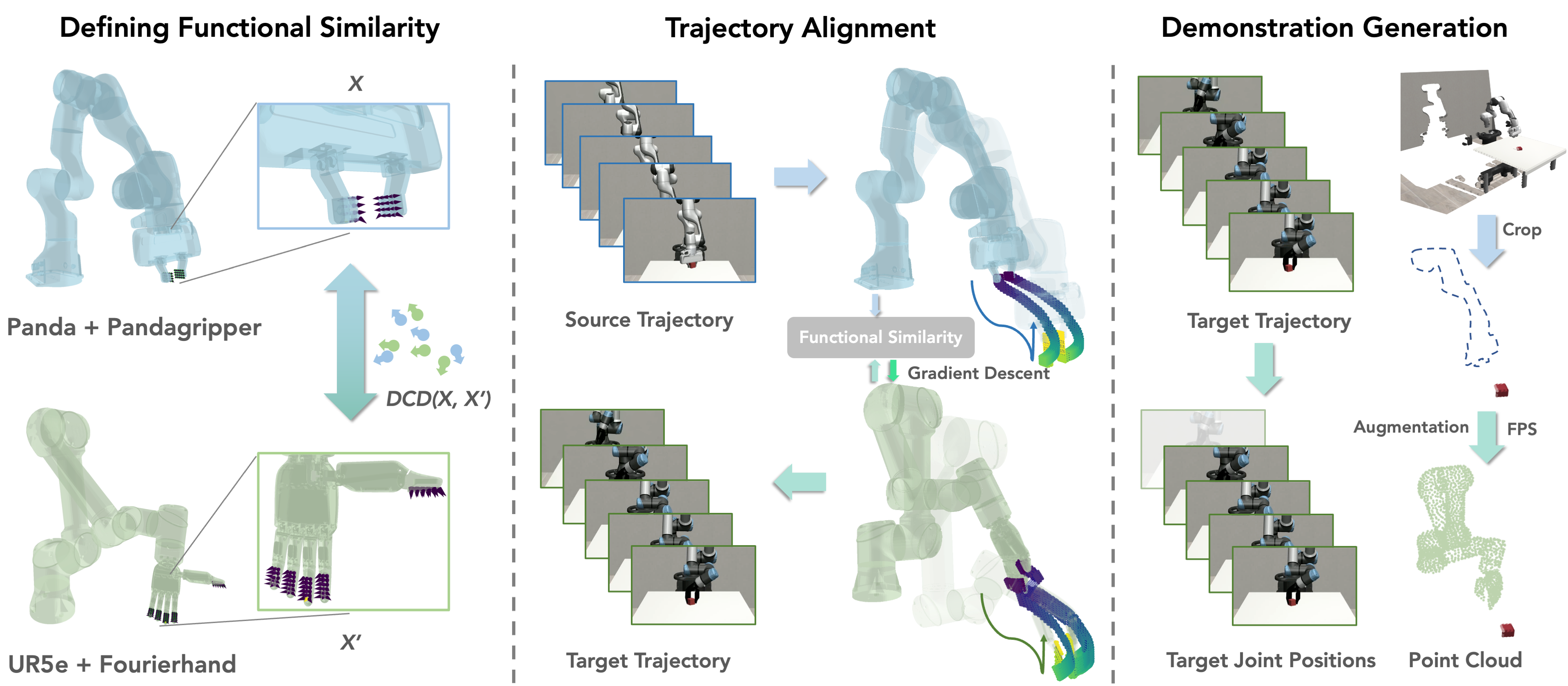

- CEI框架通过量化功能相似性,对齐轨迹,合成数据,实现跨具身策略迁移。

- 实验表明CEI在模拟和真实环境中均能有效迁移策略,平均迁移率达82.4%。

📝 摘要(中文)

基于大规模操作数据集训练的机器人基础模型在学习通用策略方面展现了潜力,但由于数据集偏差,它们通常过度拟合于特定视角、机器人手臂,尤其是平行爪夹持器。为了解决这个限制,我们提出了跨具身接口(CEI),一个用于跨具身学习的框架,它能够实现跨不同机器人手臂和末端执行器形态的演示迁移。CEI引入了“功能相似性”的概念,并使用定向Chamfer距离进行量化。然后,它通过基于梯度的优化来对齐机器人轨迹,随后为未见过的机器人手臂和末端执行器合成观察和动作。在实验中,CEI将数据和策略从Franka Panda机器人迁移到模拟环境中的16种不同的具身,跨越3个任务,并支持UR5+AG95夹持器机器人和UR5+Xhand机器人之间在6个真实世界任务中的双向迁移,实现了平均82.4%的迁移率。最后,我们证明了CEI也可以通过我们提出的技术扩展到空间泛化和多模态运动生成能力。

🔬 方法详解

问题定义:现有机器人操作策略学习方法,尤其是基于大型数据集训练的机器人基础模型,容易受到数据集偏差的影响,导致策略过度拟合于特定的机器人形态(例如,特定的机器人手臂和末端执行器)。这限制了策略在不同机器人之间的泛化能力,阻碍了通用机器人操作系统的发展。现有方法难以有效利用不同机器人上的数据进行联合训练,缺乏跨具身知识迁移的能力。

核心思路:CEI的核心思路是引入“功能相似性”的概念,并利用该相似性来实现跨具身的数据和策略迁移。具体来说,CEI首先量化不同机器人末端执行器之间的功能相似性,然后基于此相似性对齐不同机器人的轨迹,最后为目标机器人合成新的观察和动作。通过这种方式,CEI能够将源机器人的知识迁移到目标机器人,从而提高目标机器人的学习效率和泛化能力。

技术框架:CEI框架主要包含以下几个阶段:1) 功能相似性量化:使用定向Chamfer距离来量化不同机器人末端执行器之间的功能相似性。2) 轨迹对齐:基于功能相似性,通过梯度优化方法对齐不同机器人的轨迹。3) 数据合成:为目标机器人合成新的观察和动作,利用源机器人的数据增强目标机器人的训练集。4) 策略迁移:利用合成的数据训练目标机器人的策略,实现跨具身的策略迁移。

关键创新:CEI最重要的技术创新点在于提出了“功能相似性”的概念,并将其应用于跨具身策略迁移。与现有方法相比,CEI能够更有效地利用不同机器人上的数据,实现更好的泛化能力。此外,CEI还提出了一种基于定向Chamfer距离的功能相似性量化方法,以及一种基于梯度优化的轨迹对齐方法,这些方法都为跨具身策略迁移提供了新的思路。

关键设计:在功能相似性量化方面,使用了定向Chamfer距离来衡量两个末端执行器点云之间的距离,并将其作为功能相似性的度量。在轨迹对齐方面,使用了基于梯度的优化方法,通过最小化对齐后的轨迹之间的距离来优化轨迹的变换参数。在数据合成方面,使用了逆运动学方法来生成目标机器人的动作,并使用渲染技术来生成目标机器人的观察。

🖼️ 关键图片

📊 实验亮点

CEI在模拟和真实环境中的实验结果均表现出色。在模拟环境中,CEI成功将Franka Panda机器人的数据和策略迁移到16种不同的具身,跨越3个任务。在真实环境中,CEI实现了UR5+AG95夹持器机器人和UR5+Xhand机器人之间在6个任务中的双向迁移,平均迁移率达到82.4%。这些结果表明CEI具有很强的跨具身策略迁移能力。

🎯 应用场景

CEI框架具有广泛的应用前景,可用于机器人自动化、智能制造、医疗机器人等领域。通过CEI,可以快速将已有的机器人操作技能迁移到新的机器人平台上,降低机器人部署和维护成本。此外,CEI还可以促进不同机器人之间的协作,提高机器人系统的整体效率和鲁棒性。未来,CEI有望成为机器人操作系统的重要组成部分,推动机器人技术的进一步发展。

📄 摘要(原文)

Robotic foundation models trained on large-scale manipulation datasets have shown promise in learning generalist policies, but they often overfit to specific viewpoints, robot arms, and especially parallel-jaw grippers due to dataset biases. To address this limitation, we propose Cross-Embodiment Interface (\CEI), a framework for cross-embodiment learning that enables the transfer of demonstrations across different robot arm and end-effector morphologies. \CEI introduces the concept of \textit{functional similarity}, which is quantified using Directional Chamfer Distance. Then it aligns robot trajectories through gradient-based optimization, followed by synthesizing observations and actions for unseen robot arms and end-effectors. In experiments, \CEI transfers data and policies from a Franka Panda robot to \textbf{16} different embodiments across \textbf{3} tasks in simulation, and supports bidirectional transfer between a UR5+AG95 gripper robot and a UR5+Xhand robot across \textbf{6} real-world tasks, achieving an average transfer ratio of 82.4\%. Finally, we demonstrate that \CEI can also be extended with spatial generalization and multimodal motion generation capabilities using our proposed techniques. Project website: https://cross-embodiment-interface.github.io/