FlyCo: Foundation Model-Empowered Drones for Autonomous 3D Structure Scanning in Open-World Environments

作者: Chen Feng, Guiyong Zheng, Tengkai Zhuang, Yongqian Wu, Fangzhan He, Haojia Li, Juepeng Zheng, Shaojie Shen, Boyu Zhou

分类: cs.RO

发布日期: 2026-01-12

备注: 34 pages, 24 figures, 9 tables. Video: https://www.youtube.com/playlist?list=PLqjZjnqsCyl40rw3y15Yzc7Mdo-z1y2j8

💡 一句话要点

FlyCo:基于大模型的无人机自主三维结构扫描系统

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无人机 三维扫描 大模型 视觉-语言模型 自主导航

📋 核心要点

- 现有无人机三维扫描方法依赖于限制性假设或大量人工先验知识,限制了其在开放环境中的实用性、效率和适应性。

- FlyCo通过感知-预测-规划闭环,将大模型知识融入无人机自主扫描流程,仅需少量人工提示即可完成任务。

- 实验结果表明,FlyCo在场景理解、效率和安全性方面均优于现有方法,并具有良好的泛化能力和可扩展性。

📝 摘要(中文)

本文提出FlyCo,一个基于大模型的感知-预测-规划闭环系统,用于在未知开放环境中实现无人机自主三维目标扫描。FlyCo将低成本的人工提示(文本、视觉标注)转化为精确的自适应扫描飞行。系统包含三个协同阶段:(1) 感知模块融合传感器数据和视觉-语言大模型,实现鲁棒的目标定位和跟踪;(2) 预测模块提炼大模型知识并结合多模态线索,推断目标的完整几何形状;(3) 规划模块利用预测的远见生成高效安全的路径,全面覆盖目标。此外,本文还设计了关键组件,以提高开放世界目标定位的效率和鲁棒性,增强形状准确性、零样本泛化和时间稳定性方面的预测质量,并在长时程飞行效率与实时可计算性和在线避障之间取得平衡。大量的真实世界和模拟实验表明,FlyCo能够提供精确的场景理解、高效率和实时安全性,优于现有的方法,并验证了所提出的架构的实用性。全面的消融实验验证了每个组件的贡献。FlyCo还可作为灵活、可扩展的蓝图,随时利用未来的大模型和机器人技术进步。代码将会开源。

🔬 方法详解

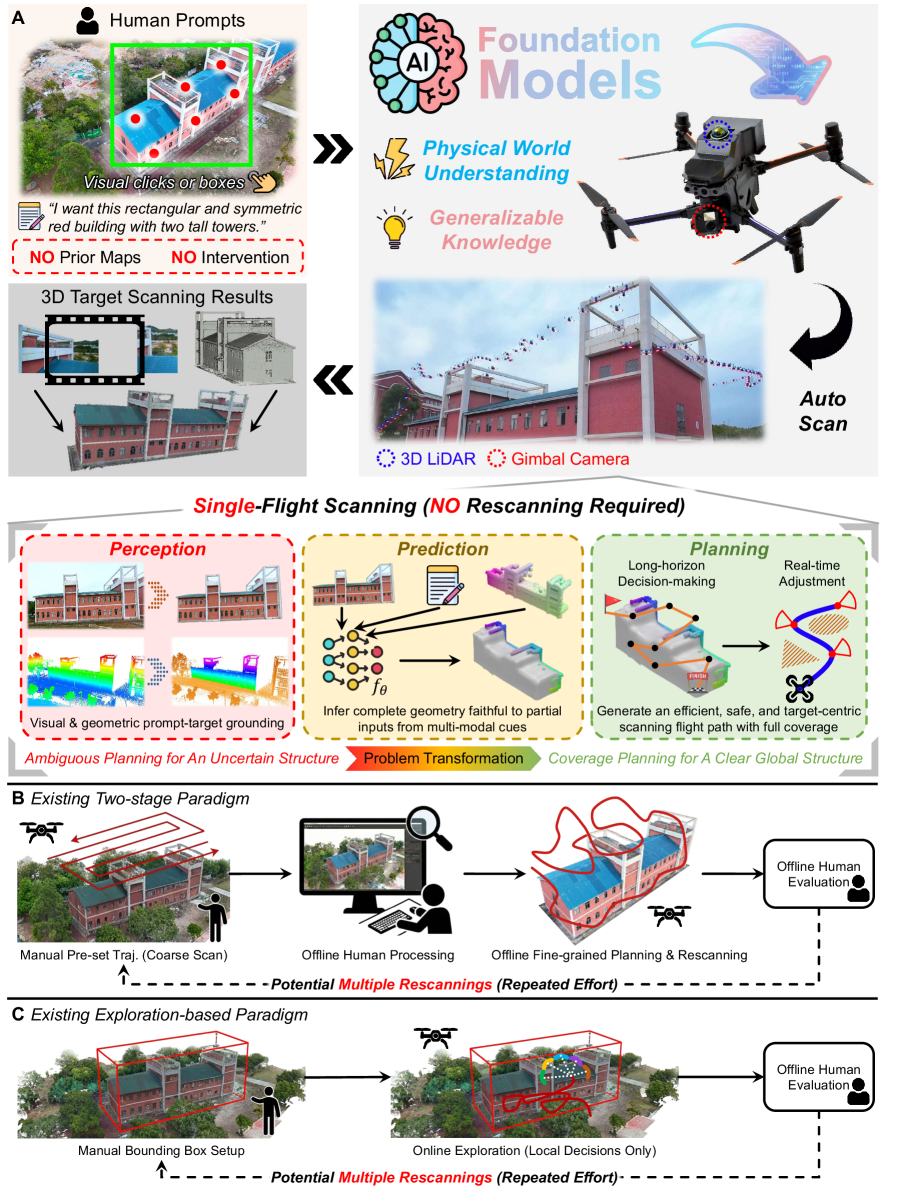

问题定义:现有无人机三维扫描方法在开放环境中面临挑战,主要痛点在于需要大量人工先验知识或对环境进行严格假设,导致实用性、效率和适应性受限。例如,需要预先定义扫描路径或手动标注目标,无法应对复杂多变的开放环境。

核心思路:FlyCo的核心思路是利用近年来兴起的大模型(Foundation Models)的强大知识和泛化能力,弥补传统方法的不足。通过将大模型融入无人机的感知、预测和规划流程,实现仅需少量人工提示即可完成自主扫描任务。这种方法旨在减少人工干预,提高扫描效率和鲁棒性。

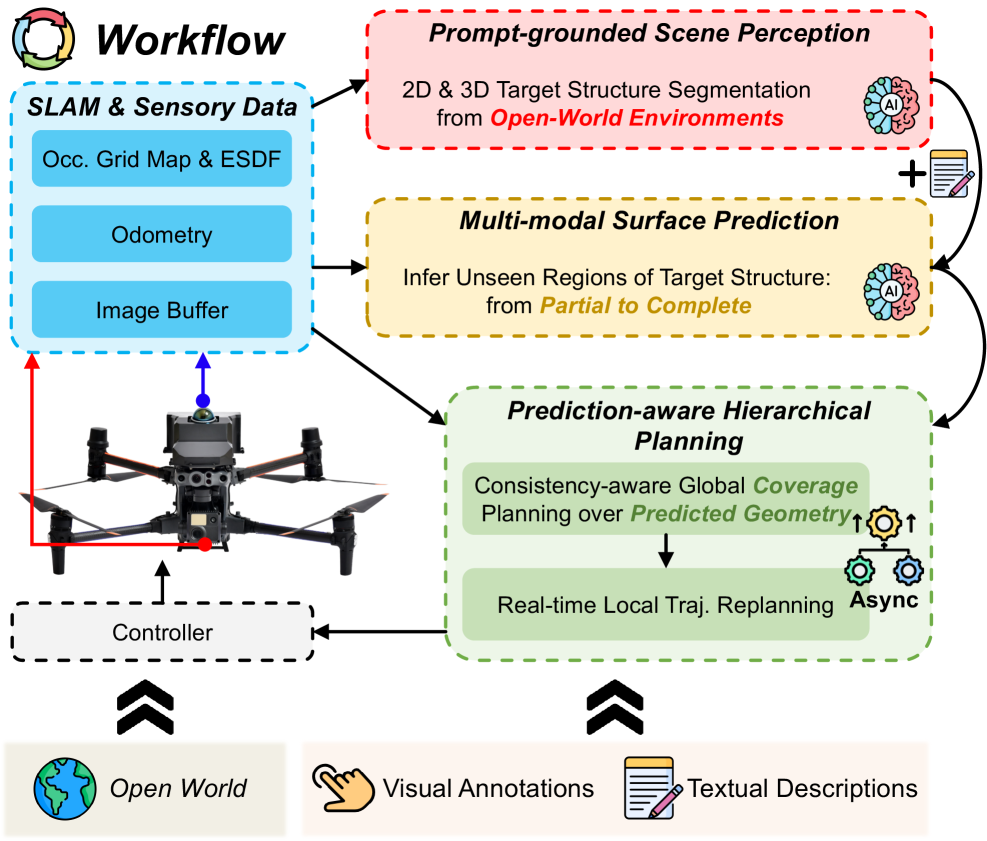

技术框架:FlyCo的整体架构是一个感知-预测-规划的闭环系统。首先,感知模块融合来自无人机载传感器的实时数据(如图像、点云)和视觉-语言大模型,实现对目标物体的鲁棒定位和跟踪。然后,预测模块利用大模型学习到的先验知识,结合多模态信息,对目标物体未被观测到的部分进行几何形状推断。最后,规划模块基于预测的完整几何形状,生成高效且安全的扫描路径,确保全面覆盖目标物体。

关键创新:FlyCo的关键创新在于将大模型有效地集成到无人机自主扫描系统中,实现了从少量人工提示到精确自适应扫描飞行的转化。与传统方法相比,FlyCo无需预先定义扫描路径或进行大量人工标注,降低了人工成本,提高了扫描效率和鲁棒性。此外,FlyCo还针对开放环境下的目标定位、形状预测和路径规划等关键问题,设计了特定的优化策略。

关键设计:在感知模块中,使用了视觉-语言大模型进行目标 grounding,提高了在复杂环境下的目标检测精度。在预测模块中,设计了多模态融合机制,结合视觉信息和语义信息,提升了形状预测的准确性和鲁棒性。在规划模块中,采用了基于预测的远见规划方法,平衡了长时程飞行效率与实时可计算性和在线避障。

🖼️ 关键图片

📊 实验亮点

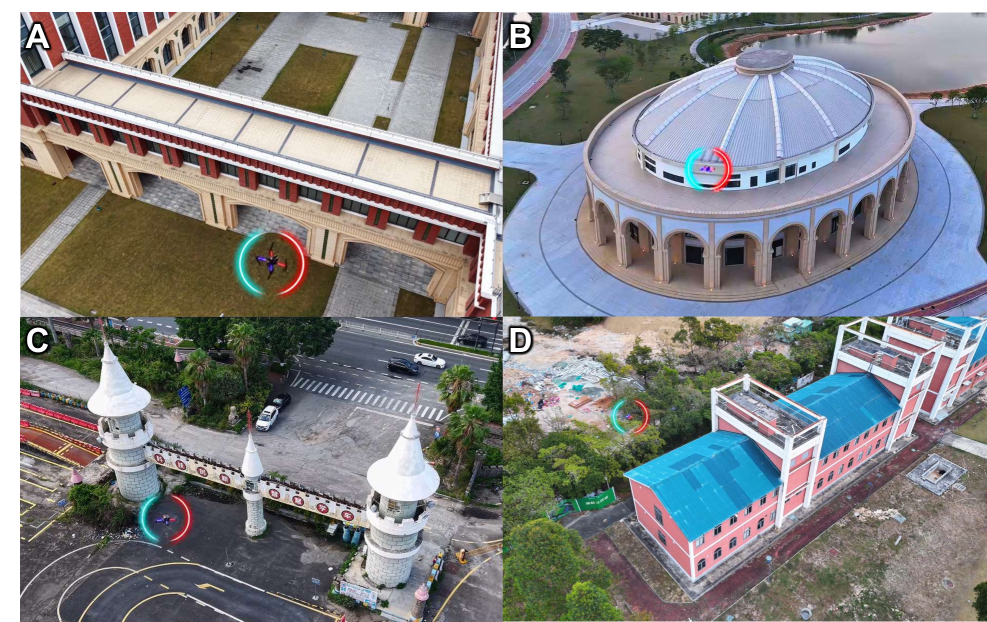

FlyCo在真实世界和模拟环境中进行了大量实验,结果表明其性能优于现有方法。例如,在目标定位精度、扫描效率和安全性方面均取得了显著提升。消融实验验证了每个组件的贡献,证明了FlyCo架构的有效性。此外,FlyCo还展示了良好的零样本泛化能力,能够在未见过的场景中进行有效扫描。

🎯 应用场景

FlyCo技术可广泛应用于基础设施巡检、灾害现场评估、考古遗址数字化、城市建模等领域。该技术能够降低人工成本,提高扫描效率和精度,为相关行业提供更高效、更智能的解决方案。未来,随着大模型和无人机技术的不断发展,FlyCo有望在更多领域发挥重要作用。

📄 摘要(原文)

Autonomous 3D scanning of open-world target structures via drones remains challenging despite broad applications. Existing paradigms rely on restrictive assumptions or effortful human priors, limiting practicality, efficiency, and adaptability. Recent foundation models (FMs) offer great potential to bridge this gap. This paper investigates a critical research problem: What system architecture can effectively integrate FM knowledge for this task? We answer it with FlyCo, a principled FM-empowered perception-prediction-planning loop enabling fully autonomous, prompt-driven 3D target scanning in diverse unknown open-world environments. FlyCo directly translates low-effort human prompts (text, visual annotations) into precise adaptive scanning flights via three coordinated stages: (1) perception fuses streaming sensor data with vision-language FMs for robust target grounding and tracking; (2) prediction distills FM knowledge and combines multi-modal cues to infer the partially observed target's complete geometry; (3) planning leverages predictive foresight to generate efficient and safe paths with comprehensive target coverage. Building on this, we further design key components to boost open-world target grounding efficiency and robustness, enhance prediction quality in terms of shape accuracy, zero-shot generalization, and temporal stability, and balance long-horizon flight efficiency with real-time computability and online collision avoidance. Extensive challenging real-world and simulation experiments show FlyCo delivers precise scene understanding, high efficiency, and real-time safety, outperforming existing paradigms with lower human effort and verifying the proposed architecture's practicality. Comprehensive ablations validate each component's contribution. FlyCo also serves as a flexible, extensible blueprint, readily leveraging future FM and robotics advances. Code will be released.