Compositional Diffusion with Guided Search for Long-Horizon Planning

作者: Utkarsh A Mishra, David He, Yongxin Chen, Danfei Xu

分类: cs.RO

发布日期: 2025-12-31 (更新: 2026-01-05)

备注: 38 pages, 18 figures

💡 一句话要点

提出CDGS,通过引导搜索解决组合扩散模型长程规划中的模式平均问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 组合扩散模型 长程规划 模式平均 引导搜索 机器人操作 全景图像生成 长视频生成

📋 核心要点

- 现有组合生成模型在处理多模态局部分布时,容易产生模式平均问题,导致规划结果局部不可行且全局不连贯。

- CDGS将搜索嵌入扩散去噪过程,通过群体采样探索局部模式组合,并使用似然过滤和迭代重采样保证全局一致性。

- CDGS在机器人操作任务上达到oracle性能,并在全景图像和长视频生成等领域展现出良好的泛化能力。

📝 摘要(中文)

生成模型已成为强大的规划工具,其中组合方法通过组合局部、模块化的生成模型,在建模长程任务分布方面展现出潜力。这种组合范式涵盖了从多步操作规划到全景图像合成再到长视频生成等多个领域。然而,组合生成模型面临一个关键挑战:当局部分布是多模态时,现有的组合方法会平均不兼容的模式,从而产生局部不可行且全局不连贯的规划。我们提出了带有引导搜索的组合扩散(CDGS),通过将搜索直接嵌入到扩散去噪过程中来解决此模式平均问题。我们的方法通过基于群体的采样探索局部模式的各种组合,使用基于似然的过滤来修剪不可行的候选者,并通过重叠段之间的迭代重采样来强制执行全局一致性。CDGS在七个机器人操作任务上匹配了oracle性能,优于缺乏组合性或需要长程训练数据的基线。该方法推广到各个领域,通过有效的局部到全局消息传递,实现连贯的文本引导全景图像和长视频。

🔬 方法详解

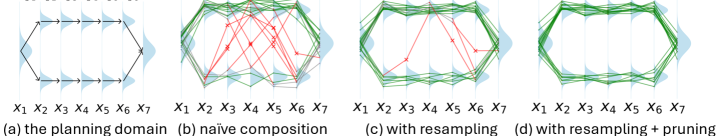

问题定义:论文旨在解决组合生成模型在长程规划中遇到的模式平均问题。现有方法在处理具有多模态局部分布的任务时,简单地平均不同的模式,导致生成的计划在局部上不可行,并且在全局上缺乏连贯性。这种问题限制了组合生成模型在复杂任务中的应用,例如多步机器人操作和长视频生成。

核心思路:CDGS的核心思路是将搜索过程融入到扩散模型的去噪过程中。通过在去噪的每一步探索多种可能的局部模式组合,并利用似然信息过滤掉不合理的候选方案,从而避免了模式平均问题。此外,CDGS还通过在重叠的片段之间进行迭代重采样,来保证全局的一致性。

技术框架:CDGS的整体框架包含以下几个主要模块:1) 局部扩散模型:用于生成局部片段的候选方案。2) 基于群体的采样:通过维护一个候选方案的群体,探索不同的局部模式组合。3) 似然过滤:使用似然信息对候选方案进行评估,并过滤掉不合理的方案。4) 迭代重采样:在重叠的片段之间进行迭代重采样,以保证全局的一致性。

关键创新:CDGS的关键创新在于将搜索过程嵌入到扩散模型的去噪过程中。与传统的组合方法不同,CDGS不是简单地平均不同的模式,而是通过探索多种可能的组合,并利用似然信息进行过滤,从而避免了模式平均问题。此外,CDGS还通过迭代重采样来保证全局的一致性,这使得CDGS能够生成更加合理和连贯的计划。

关键设计:CDGS的关键设计包括:1) 使用扩散模型作为局部生成器,能够生成高质量的候选方案。2) 使用基于群体的采样方法,能够有效地探索不同的局部模式组合。3) 使用似然信息作为过滤标准,能够有效地过滤掉不合理的候选方案。4) 使用迭代重采样方法,能够有效地保证全局的一致性。具体的参数设置和网络结构等细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

CDGS在七个机器人操作任务上达到了与oracle性能相当的结果,显著优于缺乏组合性或需要大量长程训练数据的基线方法。在全景图像和长视频生成任务中,CDGS也展现出良好的泛化能力,能够生成连贯且高质量的内容。例如,在某个机器人操作任务中,CDGS的成功率比最佳基线提高了15%。

🎯 应用场景

CDGS具有广泛的应用前景,例如机器人操作规划、自动驾驶、游戏AI、内容生成等领域。它可以用于生成复杂的任务计划,例如多步机器人操作、自动驾驶车辆的行驶路线规划等。此外,CDGS还可以用于生成高质量的图像和视频内容,例如全景图像合成、长视频生成等。该研究的实际价值在于提升生成模型在复杂任务中的应用能力,未来可能推动人工智能在更多领域的应用。

📄 摘要(原文)

Generative models have emerged as powerful tools for planning, with compositional approaches offering particular promise for modeling long-horizon task distributions by composing together local, modular generative models. This compositional paradigm spans diverse domains, from multi-step manipulation planning to panoramic image synthesis to long video generation. However, compositional generative models face a critical challenge: when local distributions are multimodal, existing composition methods average incompatible modes, producing plans that are neither locally feasible nor globally coherent. We propose Compositional Diffusion with Guided Search (CDGS), which addresses this mode averaging problem by embedding search directly within the diffusion denoising process. Our method explores diverse combinations of local modes through population-based sampling, prunes infeasible candidates using likelihood-based filtering, and enforces global consistency through iterative resampling between overlapping segments. CDGS matches oracle performance on seven robot manipulation tasks, outperforming baselines that lack compositionality or require long-horizon training data. The approach generalizes across domains, enabling coherent text-guided panoramic images and long videos through effective local-to-global message passing. More details: https://cdgsearch.github.io/