GR-Dexter Technical Report

作者: Ruoshi Wen, Guangzeng Chen, Zhongren Cui, Min Du, Yang Gou, Zhigang Han, Liqun Huang, Mingyu Lei, Yunfei Li, Zhuohang Li, Wenlei Liu, Yuxiao Liu, Xiao Ma, Hao Niu, Yutao Ouyang, Zeyu Ren, Haixin Shi, Wei Xu, Haoxiang Zhang, Jiajun Zhang, Xiao Zhang, Liwei Zheng, Weiheng Zhong, Yifei Zhou, Zhengming Zhu, Hang Li

分类: cs.RO

发布日期: 2025-12-30 (更新: 2026-01-09)

💡 一句话要点

GR-Dexter:面向灵巧手双臂机器人的通用操作VLA框架

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧手机器人 双臂机器人 视觉-语言-动作模型 机器人操作 通用机器人 遥操作 行为克隆

📋 核心要点

- 现有VLA系统在灵巧手双臂机器人上的应用受限于高自由度带来的动作空间大、遮挡频繁和数据收集成本高等挑战。

- GR-Dexter框架通过设计紧凑型灵巧手、直观的遥操作系统和有效的训练方法,实现了双臂灵巧手机器人的通用操作。

- 实验表明,GR-Dexter在长时程操作和泛化抓取放置任务中表现出色,对未见物体和指令具有更强的鲁棒性。

📝 摘要(中文)

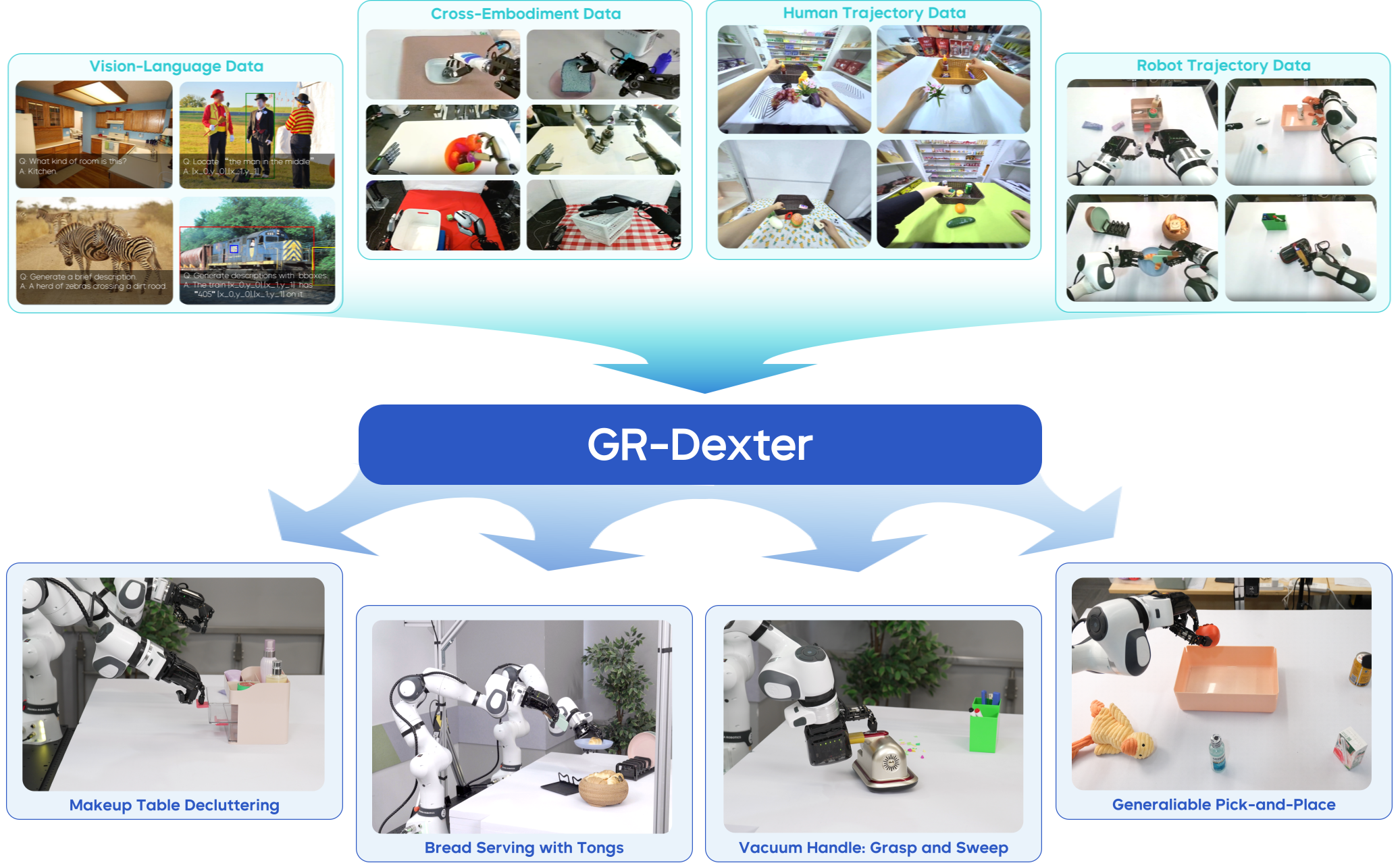

本文提出了GR-Dexter,一个用于基于视觉-语言-动作(VLA)的通用操作的双臂灵巧手机器人的整体硬件-模型-数据框架。现有系统大多局限于夹爪,而将VLA策略扩展到具有高自由度(DoF)灵巧手的双臂机器人仍然具有挑战性,原因在于动作空间的扩大、频繁的手-物体遮挡以及收集真实机器人数据的成本。GR-Dexter结合了紧凑型21自由度机械手的设计、用于真实机器人数据收集的直观双臂遥操作系统,以及利用遥操作机器人轨迹、大规模视觉-语言和精心策划的跨具身数据集的训练方法。在涵盖长时程日常操作和可泛化的抓取放置的真实世界评估中,GR-Dexter实现了强大的领域内性能,并提高了对未见物体和未见指令的鲁棒性。希望GR-Dexter能成为迈向通用灵巧手机器人操作的实用一步。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在机器人操作领域取得了显著进展,但大多集中于简单的夹爪操作。将这些模型扩展到具有高自由度灵巧手的双臂机器人面临诸多挑战,包括:动作空间呈指数级增长,导致策略学习困难;灵巧手操作过程中手部与物体之间的遮挡频繁,影响视觉感知;以及收集真实机器人数据的成本高昂,限制了模型训练规模。因此,如何设计一个能够有效利用视觉和语言信息,控制双臂灵巧手完成复杂操作任务的通用机器人系统,是本文要解决的核心问题。

核心思路:GR-Dexter的核心思路是构建一个完整的硬件-模型-数据框架,以克服上述挑战。首先,设计一个紧凑的21自由度灵巧手,在保证操作灵活性的同时,降低控制复杂度。其次,开发一个直观的双臂遥操作系统,用于高效收集高质量的真实机器人数据。最后,提出一种有效的训练方法,结合遥操作数据、大规模视觉-语言数据和跨具身数据集,提升模型的泛化能力和鲁棒性。

技术框架:GR-Dexter框架主要包含三个组成部分:1) 硬件平台:包括一个双臂机器人,每个手臂配备一个21自由度的灵巧手。2) 数据收集系统:一个直观的双臂遥操作界面,允许人类操作员控制机器人执行各种操作任务,并记录相应的视觉、语言和动作数据。3) 训练流程:利用收集到的遥操作数据,结合大规模视觉-语言数据集和跨具身数据集,训练一个VLA模型,该模型能够根据给定的语言指令,控制双臂灵巧手完成相应的操作任务。

关键创新:GR-Dexter的关键创新在于其整体性的设计理念,将硬件、数据和模型紧密结合,共同解决灵巧手双臂机器人操作的挑战。具体而言,紧凑型灵巧手的设计降低了控制难度,遥操作系统提高了数据收集效率,而结合多种数据集的训练方法则提升了模型的泛化能力。此外,该框架还探索了如何有效地利用大规模视觉-语言数据和跨具身数据,来弥补真实机器人数据的不足。

关键设计:GR-Dexter在硬件设计上采用了21自由度的灵巧手,并在数据收集方面设计了直观的遥操作界面。在模型训练方面,采用了行为克隆(Behavior Cloning)方法,并结合了数据增强技术,以提高模型的鲁棒性。此外,还使用了预训练的视觉-语言模型,以提升模型对语言指令的理解能力。具体的损失函数和网络结构等技术细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

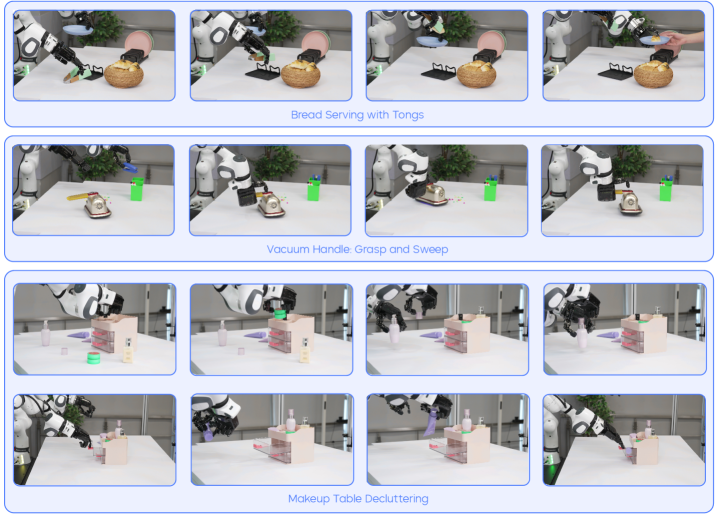

GR-Dexter在真实世界的实验中表现出色,在长时程日常操作和可泛化的抓取放置任务中均取得了显著成果。与现有方法相比,GR-Dexter在处理未见物体和未见指令时表现出更强的鲁棒性。具体性能数据和对比基线在论文中进行了详细展示,表明GR-Dexter是迈向通用灵巧手机器人操作的重要一步。

🎯 应用场景

GR-Dexter框架具有广泛的应用前景,可应用于智能制造、家庭服务、医疗康复等领域。例如,在智能制造中,机器人可以利用灵巧手完成精细的装配和操作任务;在家庭服务中,机器人可以帮助人们完成日常家务,如整理物品、准备食物等;在医疗康复中,机器人可以辅助医生进行手术,或帮助患者进行康复训练。该研究为通用机器人操作系统的发展奠定了基础,有望推动机器人技术在各个领域的广泛应用。

📄 摘要(原文)

Vision-language-action (VLA) models have enabled language-conditioned, long-horizon robot manipulation, but most existing systems are limited to grippers. Scaling VLA policies to bimanual robots with high degree-of-freedom (DoF) dexterous hands remains challenging due to the expanded action space, frequent hand-object occlusions, and the cost of collecting real-robot data. We present GR-Dexter, a holistic hardware-model-data framework for VLA-based generalist manipulation on a bimanual dexterous-hand robot. Our approach combines the design of a compact 21-DoF robotic hand, an intuitive bimanual teleoperation system for real-robot data collection, and a training recipe that leverages teleoperated robot trajectories together with large-scale vision-language and carefully curated cross-embodiment datasets. Across real-world evaluations spanning long-horizon everyday manipulation and generalizable pick-and-place, GR-Dexter achieves strong in-domain performance and improved robustness to unseen objects and unseen instructions. We hope GR-Dexter serves as a practical step toward generalist dexterous-hand robotic manipulation.