Emergence of Human to Robot Transfer in Vision-Language-Action Models

作者: Simar Kareer, Karl Pertsch, James Darpinian, Judy Hoffman, Danfei Xu, Sergey Levine, Chelsea Finn, Suraj Nair

分类: cs.RO, cs.AI

发布日期: 2025-12-27

💡 一句话要点

提出基于视觉-语言-动作模型的迁移学习方法,实现人到机器人的技能迁移

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 迁移学习 人到机器人 协同训练 具身智能

📋 核心要点

- 现有VLA模型依赖大量机器人数据,而人类视频数据蕴含丰富信息但难以直接迁移。

- 论文提出协同训练方法,通过在多样化场景下预训练VLA模型,使其学习具身无关的表示。

- 实验表明,充分预训练后,该方法在人类数据泛化任务上性能提升近一倍,验证了人到机器人迁移能力。

📝 摘要(中文)

视觉-语言-动作(VLA)模型能够实现广泛的开放世界泛化,但需要庞大且多样化的数据集。利用人类视频数据是一个有吸引力的选择,因为它们涵盖了各种真实场景且易于获取。然而,仅使用人类视频训练VLA模型很困难,建立人类与机器人之间的映射需要手动工程,这是一个主要的挑战。受大型语言模型进展的启发,即从多样化监督中学习的能力随着规模的扩大而涌现,我们探究类似的现象是否适用于包含人类视频数据的VLA模型。我们引入了一种简单的协同训练方法,并发现一旦VLA在足够多的场景、任务和具身对象上进行预训练,人到机器人的迁移就会涌现。我们的分析表明,这种涌现的能力源于多样化的预训练为人类和机器人数据产生了与具身对象无关的表示。我们通过一系列实验验证了这些发现,这些实验探测了人到机器人的技能迁移,并发现通过足够多样化的机器人预训练,我们的方法可以将仅在人类数据中看到的泛化设置的性能提高近一倍。

🔬 方法详解

问题定义:论文旨在解决如何利用易于获取的人类视频数据来提升机器人视觉-语言-动作(VLA)模型的泛化能力。现有方法要么需要大量昂贵的机器人数据,要么需要手动设计复杂的映射关系来实现人到机器人的迁移,这限制了VLA模型的应用范围和效率。

核心思路:论文的核心思路是借鉴大型语言模型中的涌现现象,即通过在足够大的数据集上进行预训练,模型能够自动学习到一些意想不到的能力。具体而言,论文假设,如果VLA模型在足够多的场景、任务和具身对象上进行预训练,它就能学习到一种与具身对象无关的表示,从而实现人到机器人的技能迁移。

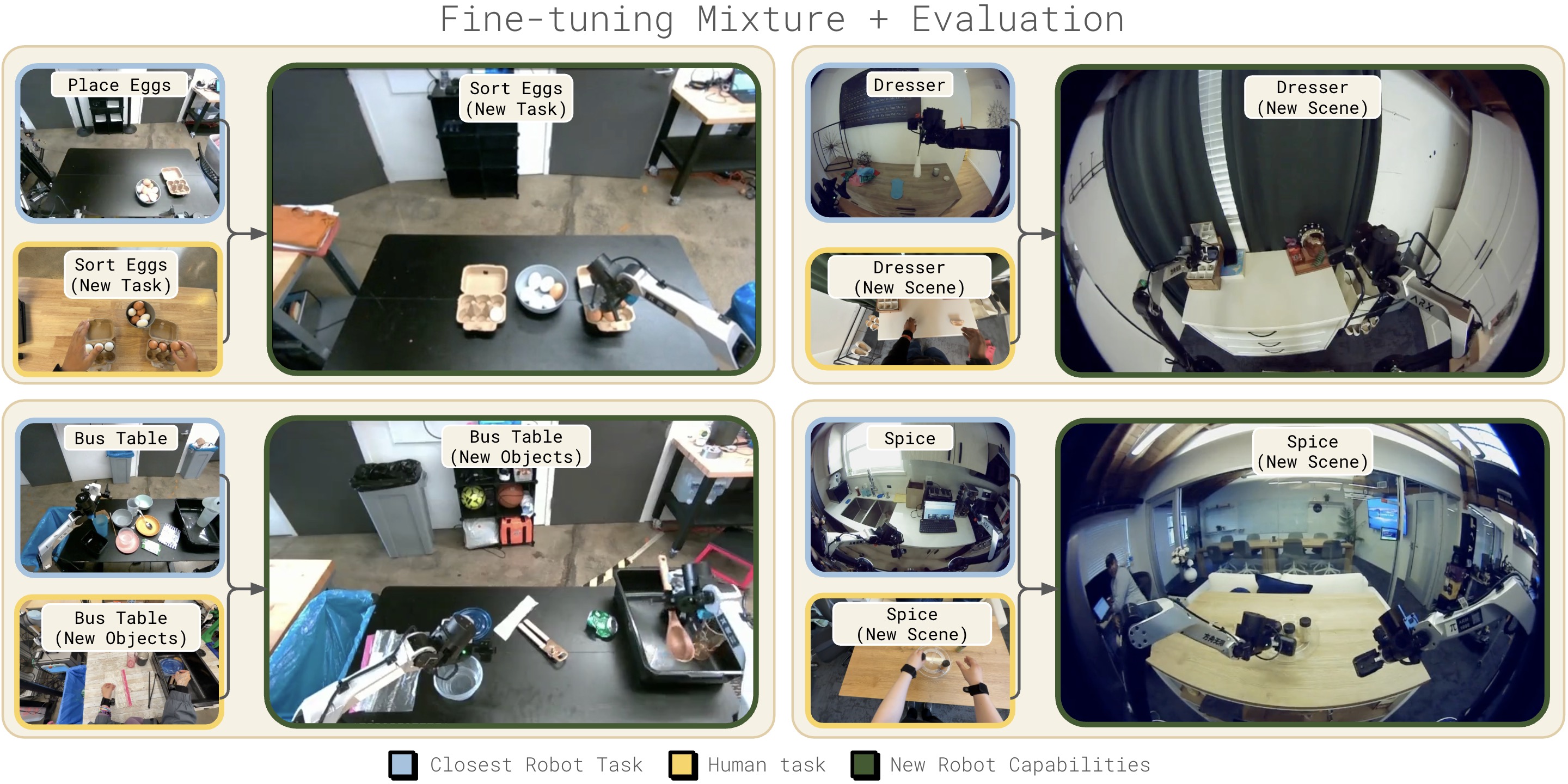

技术框架:论文提出了一种简单的协同训练方法。首先,使用大量的机器人数据对VLA模型进行预训练,使其具备一定的基础能力。然后,使用人类视频数据和机器人数据共同对模型进行微调,以促进人到机器人的知识迁移。整体流程包括数据收集、模型预训练和协同微调三个阶段。

关键创新:论文最重要的技术创新点在于发现了VLA模型中人到机器人迁移的涌现现象。通过实验证明,只要预训练的数据足够多样化,VLA模型就能自动学习到一种与具身对象无关的表示,从而实现人到机器人的技能迁移,而无需手动设计复杂的映射关系。

关键设计:论文的关键设计包括:1) 使用Transformer架构作为VLA模型的基础架构,Transformer具有强大的表示学习能力和泛化能力;2) 设计了一种简单的协同训练方法,通过交替使用人类视频数据和机器人数据对模型进行微调,以促进人到机器人的知识迁移;3) 使用多种评估指标来评估模型的性能,包括在机器人环境中执行任务的成功率和在人类视频中泛化的能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,通过充分的机器人预训练,该方法在人类数据泛化设置下的性能提升了近一倍。具体而言,在仅使用人类视频数据进行测试的任务中,该方法的成功率显著高于其他基线方法,验证了其有效性。此外,消融实验表明,预训练数据的多样性是实现人到机器人迁移的关键因素。

🎯 应用场景

该研究成果可应用于机器人自动化、远程操作、辅助生活等领域。通过利用大量人类视频数据,可以降低机器人训练成本,提高机器人在复杂环境中的适应性和泛化能力。未来,该技术有望实现更智能、更灵活的机器人系统,更好地服务于人类社会。

📄 摘要(原文)

Vision-language-action (VLA) models can enable broad open world generalization, but require large and diverse datasets. It is appealing to consider whether some of this data can come from human videos, which cover diverse real-world situations and are easy to obtain. However, it is difficult to train VLAs with human videos alone, and establishing a mapping between humans and robots requires manual engineering and presents a major research challenge. Drawing inspiration from advances in large language models, where the ability to learn from diverse supervision emerges with scale, we ask whether a similar phenomenon holds for VLAs that incorporate human video data. We introduce a simple co-training recipe, and find that human-to-robot transfer emerges once the VLA is pre-trained on sufficient scenes, tasks, and embodiments. Our analysis suggests that this emergent capability arises because diverse pretraining produces embodiment-agnostic representations for human and robot data. We validate these findings through a series of experiments probing human to robot skill transfer and find that with sufficiently diverse robot pre-training our method can nearly double the performance on generalization settings seen only in human data.