Flexible Multitask Learning with Factorized Diffusion Policy

作者: Chaoqi Liu, Haonan Chen, Sigmund H. Høeg, Shaoxiong Yao, Yunzhu Li, Kris Hauser, Yilun Du

分类: cs.RO, cs.AI

发布日期: 2025-12-26 (更新: 2026-02-01)

💡 一句话要点

提出因子化扩散策略,解决机器人多任务学习中动作分布复杂性问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多任务学习 扩散模型 机器人操作 因子化策略 模块化学习

📋 核心要点

- 机器人多任务学习面临动作分布复杂、模型欠拟合和缺乏灵活性的挑战。

- 论文提出因子化扩散策略,将复杂动作分布分解为多个专门的扩散模型,提升策略效果。

- 实验结果表明,该方法在模拟和真实机器人操作中均优于现有模块化和单体模型。

📝 摘要(中文)

多任务学习由于机器人动作分布的高度多模态和多样性而面临重大挑战。然而,有效地将策略拟合到这些复杂的任务分布通常很困难,并且现有的单体模型通常对动作分布欠拟合,并且缺乏有效适应所需的灵活性。我们引入了一种新颖的模块化扩散策略框架,该框架将复杂的动作分布分解为专门的扩散模型的组合,每个模型捕获行为空间的不同子模式,从而实现更有效的整体策略。此外,这种模块化结构通过添加或微调组件来实现对新任务的灵活策略适应,从而固有地减轻了灾难性遗忘。在模拟和真实机器人操作环境中,我们展示了我们的方法如何始终优于强大的模块化和单体基线。

🔬 方法详解

问题定义:论文旨在解决机器人多任务学习中,由于动作分布复杂、多模态,导致现有单体策略模型难以有效拟合,且缺乏灵活适应新任务能力的问题。现有方法容易出现欠拟合和灾难性遗忘现象。

核心思路:核心思路是将复杂的动作分布进行分解,利用多个专门的扩散模型分别学习动作空间的不同子模式。通过组合这些专门的模型,可以更有效地表示整体策略,并实现对新任务的灵活适应,同时缓解灾难性遗忘。

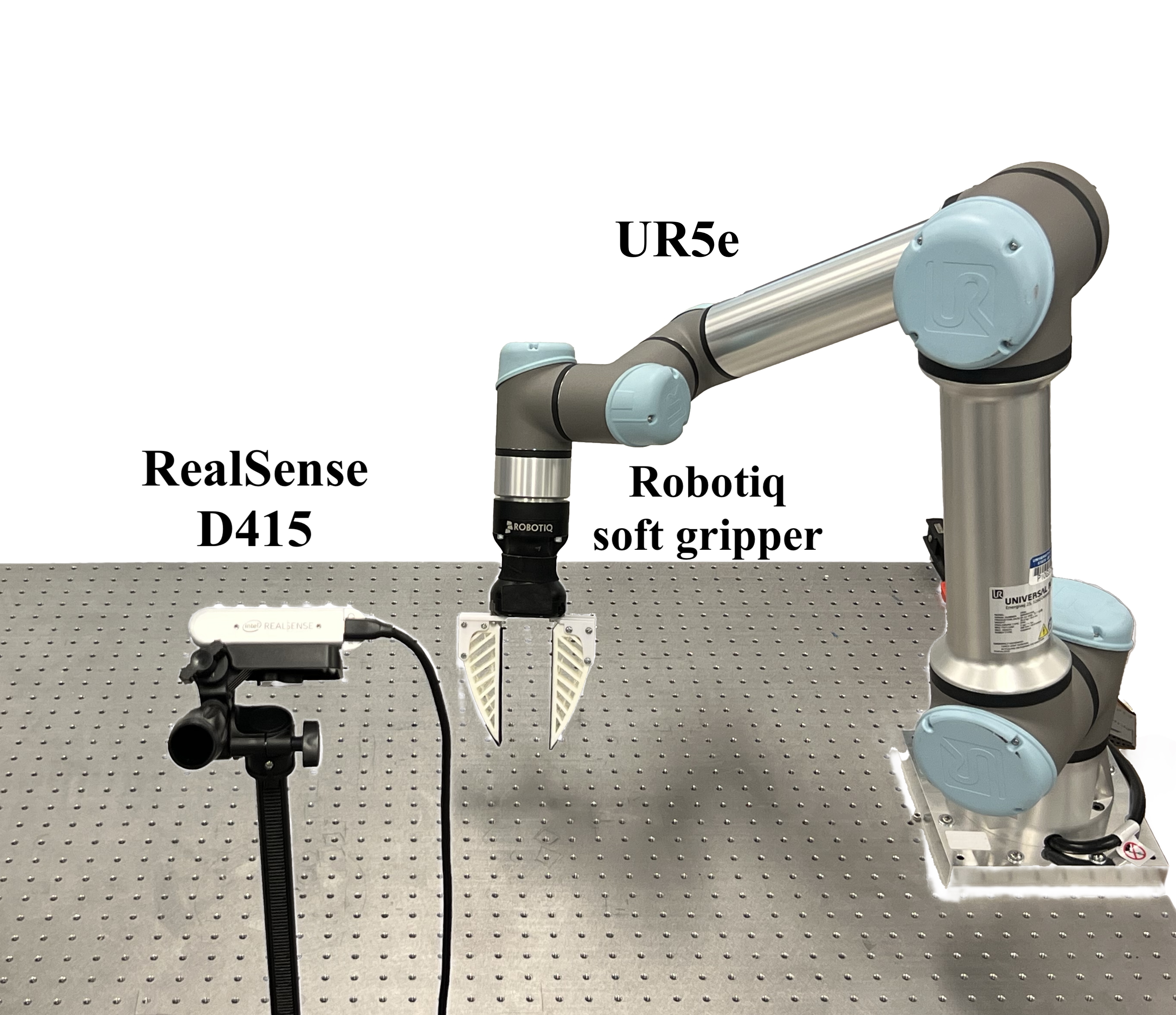

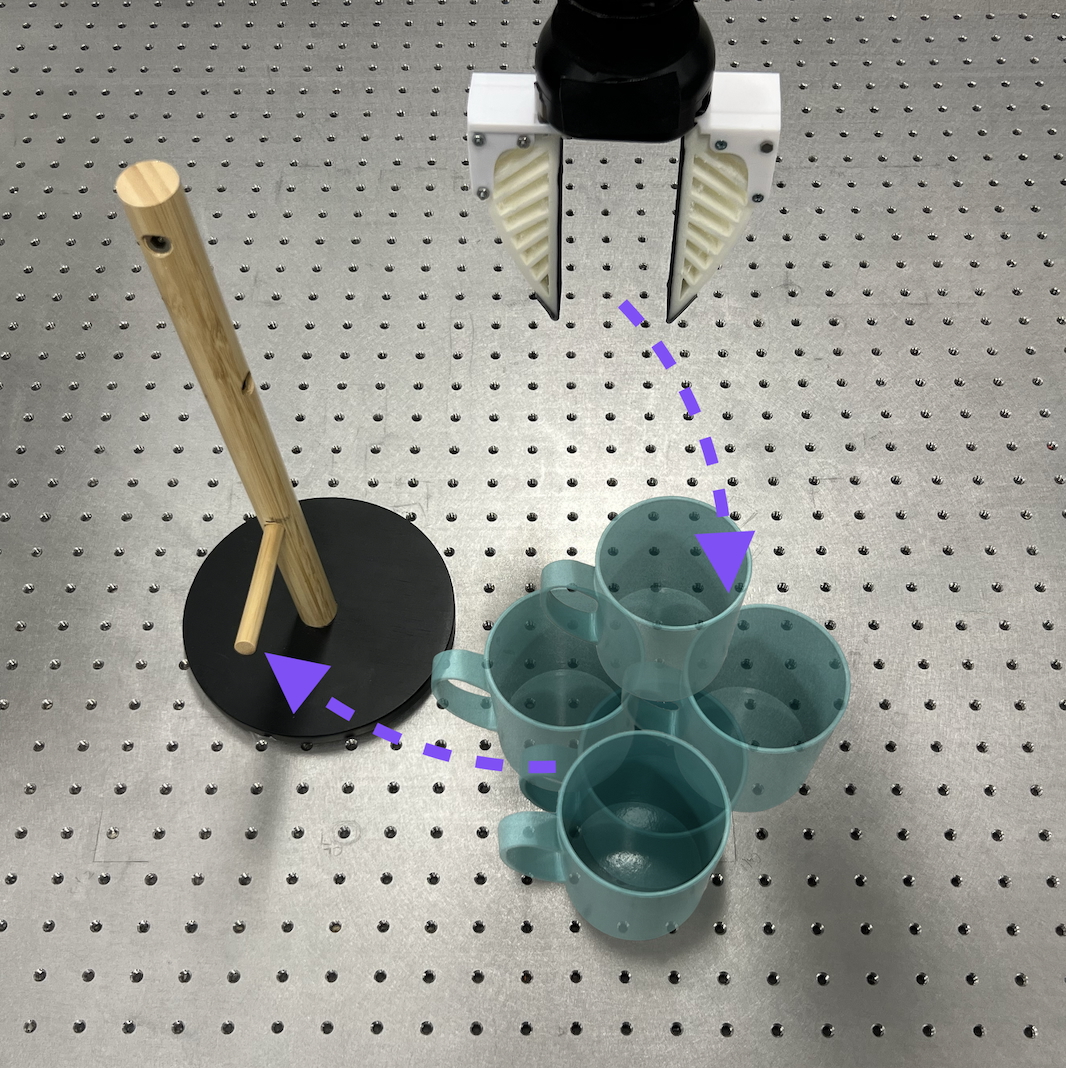

技术框架:整体框架是一个模块化的扩散策略网络。首先,将复杂的任务动作空间分解为多个子空间。然后,为每个子空间训练一个独立的扩散模型,每个模型负责学习该子空间内的动作分布。在推理阶段,通过组合这些扩散模型的输出来生成最终的动作。这种模块化结构允许灵活地添加或微调组件以适应新任务。

关键创新:关键创新在于将扩散模型应用于模块化的多任务学习框架中,并提出因子化扩散策略。与传统的单体扩散策略相比,该方法能够更好地捕捉复杂的多模态动作分布,并具有更强的泛化能力和适应性。此外,模块化结构天然地支持增量学习,可以有效缓解灾难性遗忘。

关键设计:论文中可能涉及的关键设计包括:如何进行动作空间的分解(例如,基于任务类型或动作类型),每个扩散模型的网络结构(例如,U-Net),扩散模型的训练目标函数(例如,噪声预测误差),以及如何组合多个扩散模型的输出(例如,加权平均或条件生成)。具体的参数设置和网络结构等细节需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

论文在模拟和真实机器人操作环境中进行了实验,结果表明,所提出的因子化扩散策略始终优于现有的模块化和单体基线方法。具体的性能提升幅度需要在论文中查找,可能包括成功率、完成时间和泛化能力等指标的提升。

🎯 应用场景

该研究成果可应用于各种机器人操作任务,例如装配、抓取、导航等。通过学习不同任务的动作模式,机器人可以更灵活地适应新的环境和任务要求。该方法在自动化生产线、服务机器人和家庭机器人等领域具有广泛的应用前景,能够提升机器人的智能化水平和工作效率。

📄 摘要(原文)

Multitask learning poses significant challenges due to the highly multimodal and diverse nature of robot action distributions. However, effectively fitting policies to these complex task distributions is often difficult, and existing monolithic models often underfit the action distribution and lack the flexibility required for efficient adaptation. We introduce a novel modular diffusion policy framework that factorizes complex action distributions into a composition of specialized diffusion models, each capturing a distinct sub-mode of the behavior space for a more effective overall policy. In addition, this modular structure enables flexible policy adaptation to new tasks by adding or fine-tuning components, which inherently mitigates catastrophic forgetting. Empirically, across both simulation and real-world robotic manipulation settings, we illustrate how our method consistently outperforms strong modular and monolithic baselines.