HELP: Hierarchical Embodied Language Planner for Household Tasks

作者: Alexandr V. Korchemnyi, Anatoly O. Onishchenko, Eva A. Bakaeva, Alexey K. Kovalev, Aleksandr I. Panov

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-12-25

💡 一句话要点

提出HELP:一种用于家庭任务的分层具身语言规划器

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能体 语言规划 分层架构 大型语言模型 家庭任务

📋 核心要点

- 现有具身智能体在复杂任务中规划能力不足,难以有效处理自然语言指令中的歧义。

- HELP通过分层架构,将大型语言模型分解为多个智能体,分别负责不同的子任务,提升规划效率。

- 论文在家庭任务中进行了实验,验证了HELP的有效性,并探索了开源LLM在具身智能体中的应用。

📝 摘要(中文)

具身智能体在复杂场景(无论是在真实环境还是模拟环境中)中的表现,很大程度上依赖于强大的规划能力。当指令以自然语言形式给出时,具备广泛语言知识的大型语言模型(LLM)可以发挥关键作用。然而,为了有效地利用这些模型处理语言歧义、从环境中检索信息以及基于智能体可用技能进行规划的能力,必须设计合适的架构。本文提出了一种分层具身语言规划器,称为HELP,它由一组基于LLM的智能体组成,每个智能体专门用于解决不同的子任务。我们在家庭任务上评估了所提出的方法,并使用具身智能体进行了真实世界的实验。我们还重点关注使用参数相对较少的开源LLM,以实现自主部署。

🔬 方法详解

问题定义:论文旨在解决具身智能体在家庭环境中执行复杂任务时,如何有效利用自然语言指令进行规划的问题。现有方法通常难以处理自然语言指令中的歧义,并且难以有效地从环境中检索信息,也无法很好地基于智能体自身的技能进行规划。这些问题导致智能体在复杂任务中的表现不佳。

核心思路:论文的核心思路是采用分层架构,将复杂的规划任务分解为多个子任务,并为每个子任务分配一个基于大型语言模型的智能体。每个智能体专注于解决特定的子任务,从而降低了单个智能体的复杂性,提高了整体规划的效率和鲁棒性。这种分层结构允许模型更好地处理语言歧义,并根据环境信息和智能体的技能进行更有效的规划。

技术框架:HELP (Hierarchical Embodied Language Planner) 的整体架构包含多个基于LLM的智能体,它们按照层次结构组织。顶层智能体负责将整个任务分解为一系列子任务,并将这些子任务分配给下层智能体。下层智能体负责执行具体的子任务,例如导航、物体操作等。每个智能体都可以与环境进行交互,并从环境中检索信息。智能体之间通过消息传递进行通信,协同完成整个任务。

关键创新:HELP的关键创新在于其分层架构和基于LLM的智能体设计。分层架构允许模型将复杂的任务分解为更小的、更易于管理的子任务,从而提高了规划的效率和鲁棒性。基于LLM的智能体能够有效地处理自然语言指令,并根据环境信息和智能体的技能进行规划。此外,论文还关注使用开源LLM,这使得该方法更易于部署和扩展。

关键设计:论文使用了开源LLM作为每个智能体的基础模型。具体的LLM选择和参数设置未知。智能体之间的消息传递机制也未详细描述。损失函数和网络结构等技术细节也未在摘要中提及,属于未知信息。

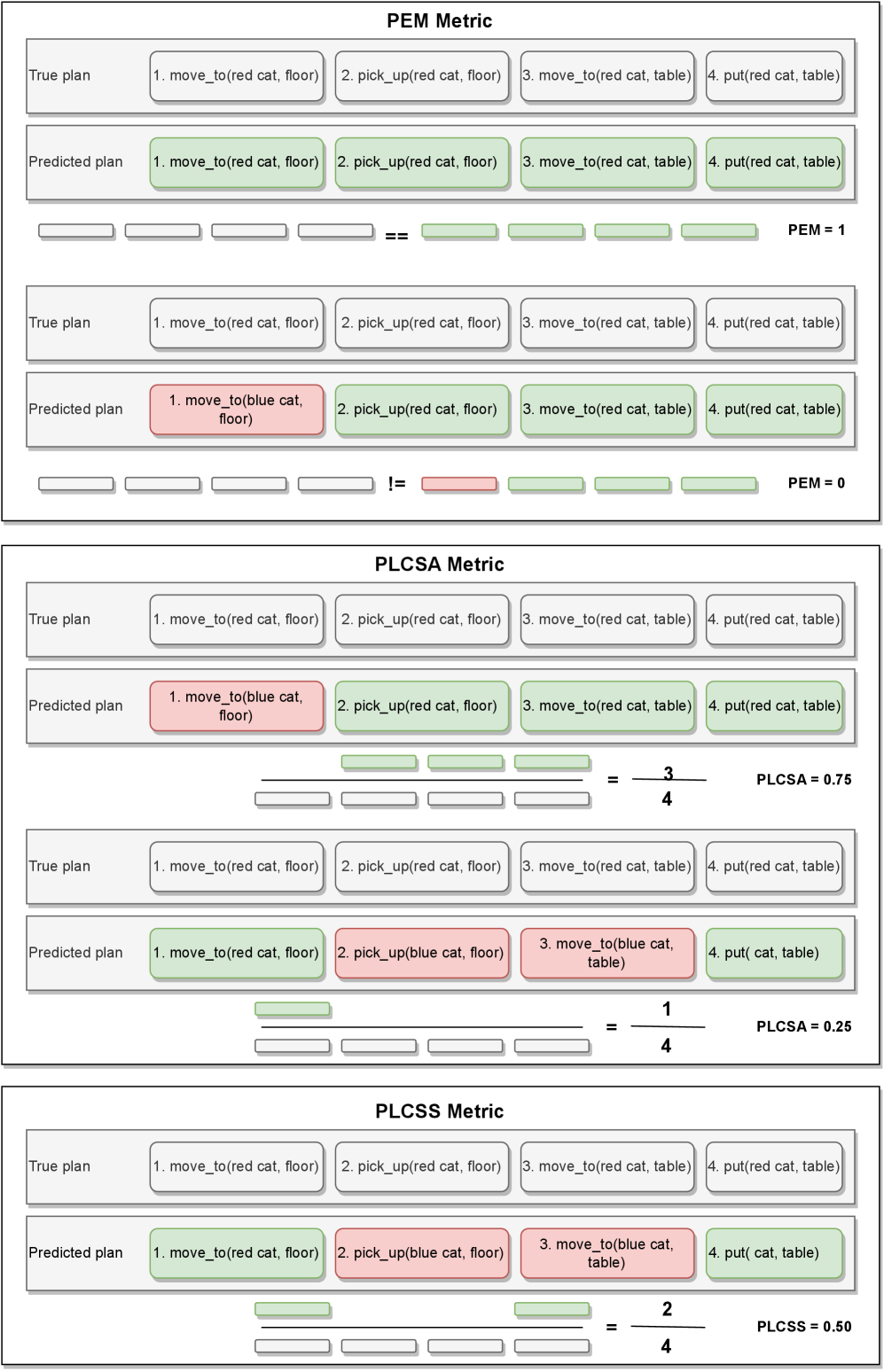

🖼️ 关键图片

📊 实验亮点

论文在家庭任务上进行了实验,验证了HELP的有效性。虽然摘要中没有提供具体的性能数据和对比基线,但实验结果表明,HELP能够成功地完成复杂的家庭任务,并且能够有效地处理自然语言指令中的歧义。此外,论文还进行了真实世界的实验,进一步验证了该方法的可行性。

🎯 应用场景

该研究成果可应用于家庭服务机器人、智能家居系统、以及其他需要具身智能体执行复杂任务的场景。通过将自然语言指令转化为可执行的行动计划,该方法可以使智能体更好地理解人类意图,并自主完成各种任务,从而提高生活质量和工作效率。未来的研究可以进一步探索该方法在更复杂环境和任务中的应用。

📄 摘要(原文)

Embodied agents tasked with complex scenarios, whether in real or simulated environments, rely heavily on robust planning capabilities. When instructions are formulated in natural language, large language models (LLMs) equipped with extensive linguistic knowledge can play this role. However, to effectively exploit the ability of such models to handle linguistic ambiguity, to retrieve information from the environment, and to be based on the available skills of an agent, an appropriate architecture must be designed. We propose a Hierarchical Embodied Language Planner, called HELP, consisting of a set of LLM-based agents, each dedicated to solving a different subtask. We evaluate the proposed approach on a household task and perform real-world experiments with an embodied agent. We also focus on the use of open source LLMs with a relatively small number of parameters, to enable autonomous deployment.