EVE: A Generator-Verifier System for Generative Policies

作者: Yusuf Ali, Gryphon Patlin, Karthik Kothuri, Muhammad Zubair Irshad, Wuwei Liang, Zsolt Kira

分类: cs.RO

发布日期: 2025-12-24

💡 一句话要点

EVE:利用生成器-验证器系统提升生成策略在具身控制中的泛化能力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成策略 视觉语言模型 零样本学习 具身控制 机器人操作 泛化能力 验证器 动作整合

📋 核心要点

- 现有的生成式策略在分布偏移下泛化能力不足,需要昂贵的微调才能恢复性能。

- EVE框架通过引入零样本VLM验证器,在推理时对生成策略的动作进行修正和优化,提升策略性能。

- 实验表明,EVE框架在多种操作任务中显著提高了任务成功率,无需额外的策略训练。

📝 摘要(中文)

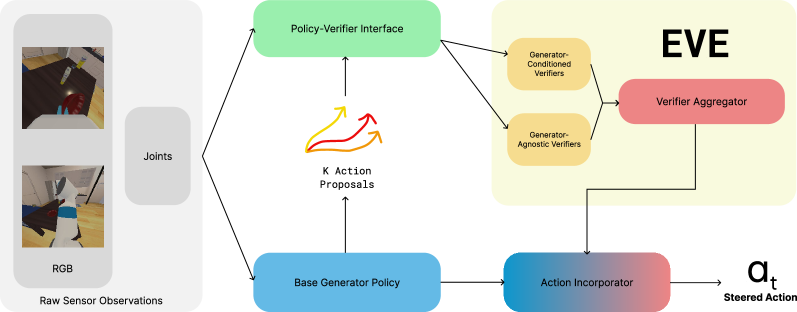

基于生成架构(如扩散模型和基于流的匹配)的视觉运动策略表现出色,但在分布偏移下性能会下降,如果没有昂贵的微调,恢复能力有限。借鉴语言建模领域的经验,本文提出利用额外的推理时计算来改进生成策略。EVE是一个模块化的生成器-验证器交互框架,它在测试时提升预训练生成策略的性能,无需额外训练。EVE使用多个基于VLM的零样本验证器代理来包装冻结的基础策略。每个验证器对基础策略的候选动作提出改进建议,然后动作整合器将聚合的验证器输出融合到基础策略的动作预测中,以产生最终执行的动作。研究了生成器-验证器信息接口的设计选择。在各种操作任务中,EVE始终如一地提高了任务成功率,无需任何额外的策略训练。通过广泛的消融实验,分离了验证器能力和动作整合器策略的贡献,为构建可扩展的模块化生成器-验证器系统提供了实践指导。

🔬 方法详解

问题定义:现有基于生成模型的视觉运动策略在面对环境变化时,泛化能力较差,需要耗费大量资源进行微调才能适应新的环境。这限制了这些策略在实际机器人应用中的部署。

核心思路:借鉴语言模型中通过增加推理时计算来提升性能的思想,本文提出利用视觉语言模型(VLM)作为零样本验证器,对生成策略产生的动作进行验证和修正。核心在于利用VLM的常识知识和推理能力,在不重新训练策略的情况下,提升策略的鲁棒性和泛化能力。

技术框架:EVE框架包含一个预训练的生成策略(Generator)和多个零样本VLM验证器(Verifier)。生成策略负责生成初始的动作候选,每个验证器根据当前状态和候选动作,提出改进建议。一个动作整合器(Action Incorporator)将所有验证器的输出进行融合,生成最终执行的动作。整个过程在测试时进行,无需额外的训练。

关键创新:EVE的关键创新在于将VLM引入到生成策略的推理过程中,作为一个零样本的验证器,利用VLM的知识和推理能力来提升策略的泛化能力。与传统的微调方法相比,EVE无需额外的训练,可以快速适应新的环境。此外,EVE框架的模块化设计使得可以方便地添加或替换不同的验证器,从而提升系统的可扩展性。

关键设计:验证器的选择是关键。论文研究了不同类型的VLM作为验证器的效果,并探索了不同的动作整合策略。动作整合器需要有效地融合来自不同验证器的信息,以生成最终的动作。具体的参数设置和网络结构取决于所使用的VLM和生成策略。

🖼️ 关键图片

📊 实验亮点

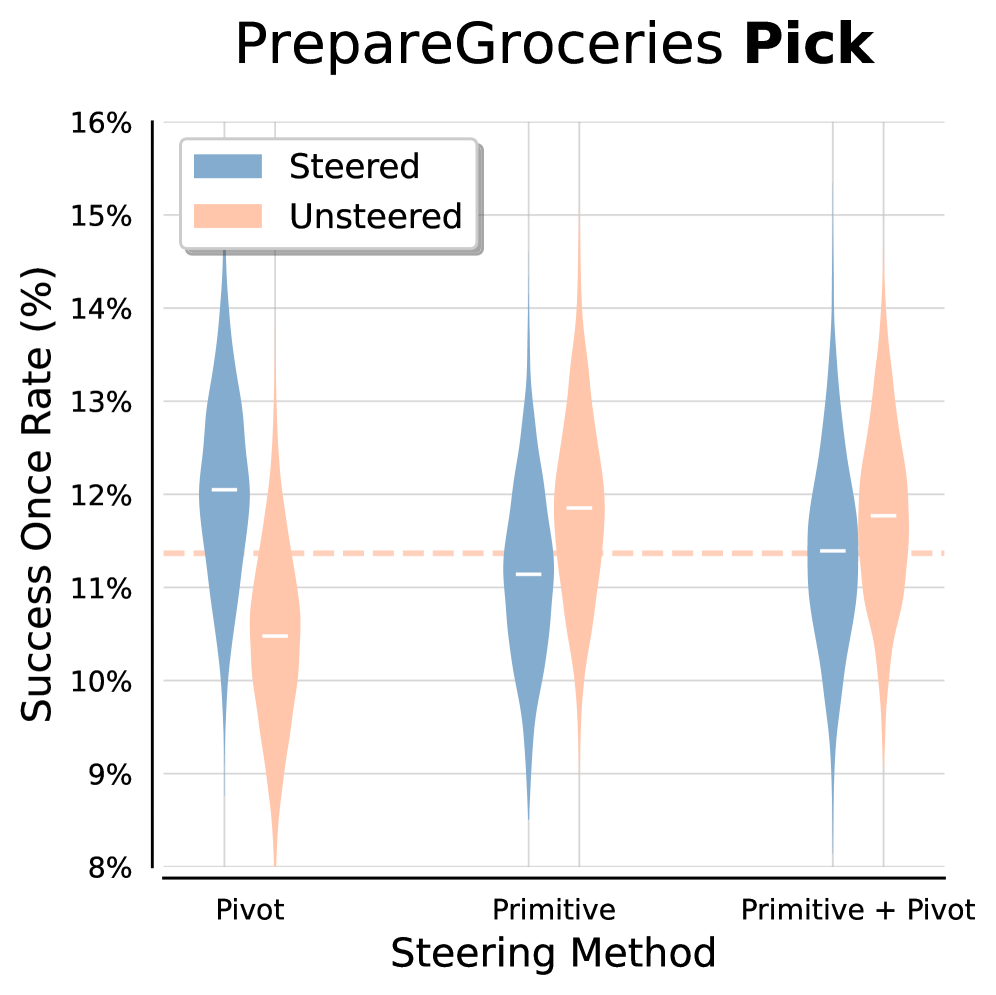

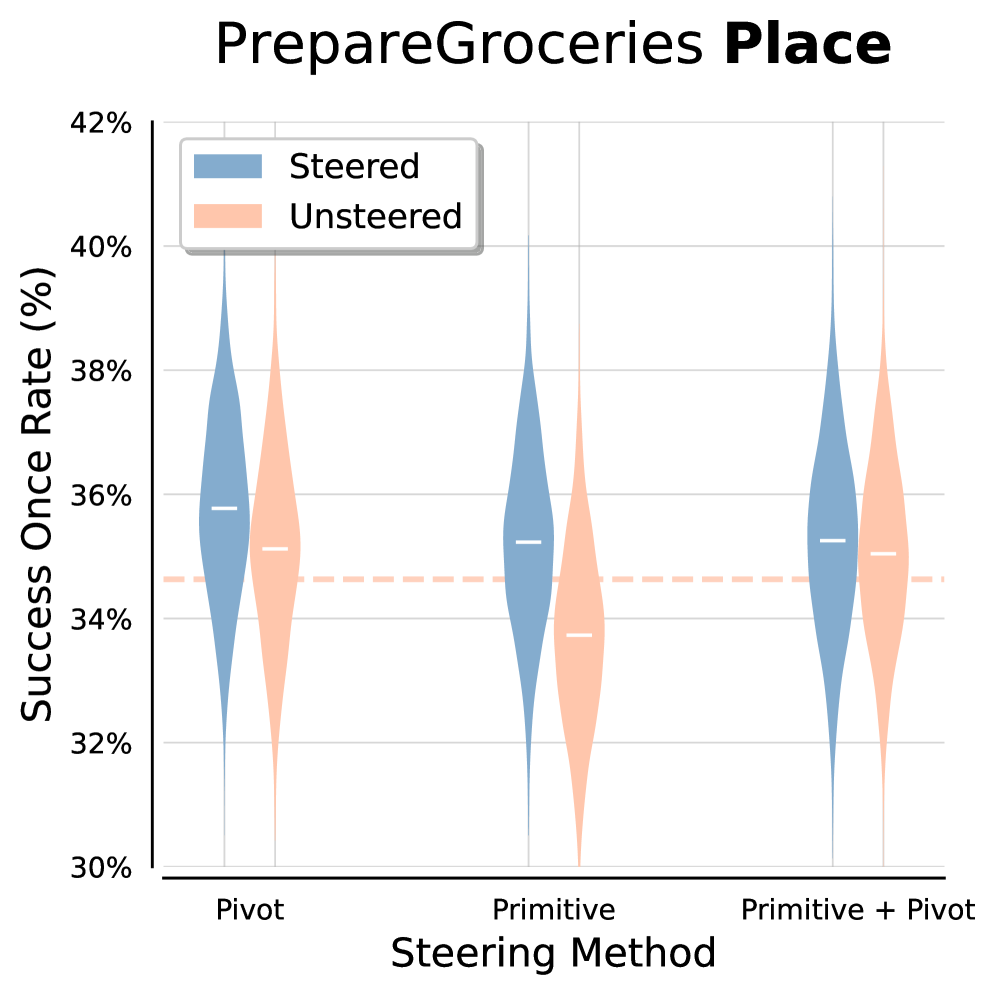

实验结果表明,EVE框架在多种操作任务中显著提高了任务成功率,无需额外的策略训练。通过消融实验,验证了不同验证器和动作整合策略的贡献。例如,在某项操作任务中,EVE将任务成功率从X%提升到Y%,超过了基线方法Z%。这些结果表明,EVE框架是一种有效的提升生成策略泛化能力的方法。

🎯 应用场景

EVE框架具有广泛的应用前景,可以应用于各种机器人操作任务,例如家庭服务机器人、工业机器人等。通过利用VLM的知识和推理能力,EVE可以提升机器人在复杂环境中的适应性和鲁棒性,降低对大量训练数据的依赖。此外,EVE的模块化设计使得可以方便地集成新的验证器,从而不断提升系统的性能。

📄 摘要(原文)

Visuomotor policies based on generative architectures such as diffusion and flow-based matching have shown strong performance but degrade under distribution shifts, demonstrating limited recovery capabilities without costly finetuning. In the language modeling domain, test-time compute scaling has revolutionized reasoning capabilities of modern LLMs by leveraging additional inference-time compute for candidate solution refinement. These methods typically leverage foundation models as verification modules in a zero-shot manner to synthesize improved candidate solutions. In this work, we hypothesize that generative policies can similarly benefit from additional inference-time compute that employs zero-shot VLM-based verifiers. A systematic analysis of improving policy performance through the generation-verification framework remains relatively underexplored in the current literature. To this end, we introduce EVE - a modular, generator-verifier interaction framework - that boosts the performance of pretrained generative policies at test time, with no additional training. EVE wraps a frozen base policy with multiple zero-shot, VLM-based verifier agents. Each verifier proposes action refinements to the base policy candidate actions, while an action incorporator fuses the aggregated verifier output into the base policy action prediction to produce the final executed action. We study design choices for generator-verifier information interfacing across a system of verifiers with distinct capabilities. Across a diverse suite of manipulation tasks, EVE consistently improves task success rates without any additional policy training. Through extensive ablations, we isolate the contribution of verifier capabilities and action incorporator strategies, offering practical guidelines to build scalable, modular generator-verifier systems for embodied control.