CoDrone: Autonomous Drone Navigation Assisted by Edge and Cloud Foundation Models

作者: Pengyu Chen, Tao Ouyang, Ke Luo, Weijie Hong, Xu Chen

分类: cs.RO

发布日期: 2025-12-22 (更新: 2025-12-24)

备注: This paper is accepted by the IEEE Internet of Things Journal (IoT-J) for publication in the Special Issue on "Augmented Edge Sensing Intelligence for Low-Altitude IoT Systems"

💡 一句话要点

CoDrone:边缘云协同,利用基础模型增强无人机自主导航能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 无人机导航 边缘计算 云计算 深度强化学习 视觉语言模型 自主导航 基础模型

📋 核心要点

- 现有无人机自主导航受限于机载算力,无法部署复杂深度模型,而卸载到边缘服务器又引入了高延迟。

- CoDrone提出云-边-端协同框架,利用边缘辅助的基础模型进行深度估计,并结合深度强化学习进行调度。

- 实验表明,CoDrone在不同飞行速度和网络条件下,平均飞行距离提升40%,导航质量提升5%。

📝 摘要(中文)

无人机自主导航面临着机载计算资源有限的关键挑战,这限制了部署的深度神经网络只能采用浅层架构,无法处理复杂的环境。将任务卸载到远程边缘服务器会引入高延迟,从而在系统设计中产生固有的权衡。为了解决这些限制,我们提出了CoDrone——第一个云-边-端协同计算框架,将基础模型集成到自主无人机巡航场景中,有效地利用基础模型来增强资源受限的无人机平台性能。为了减少机载计算和数据传输开销,CoDrone采用灰度图像进行导航模型。当需要增强环境感知时,CoDrone利用边缘辅助的基础模型Depth Anything V2进行深度估计,并引入了一种新颖的基于一维占据栅格的导航方法——在提高自主导航效率和表征简洁性的同时,实现细粒度的场景理解。CoDrone的一个关键组成部分是基于深度强化学习的神经调度器,它将深度估计与自主导航决策无缝集成,从而能够实时适应动态环境。此外,该框架还引入了一个无人机特定的视觉语言交互模块,该模块结合了领域定制的低级飞行原语,以实现云基础模型与无人机之间的有效交互。VLM的引入增强了复杂未知场景中的开放集推理能力。实验结果表明,CoDrone在不同的飞行速度和网络条件下优于基线方法,平均飞行距离提高了40%,平均导航质量提高了5%。

🔬 方法详解

问题定义:无人机自主导航需要在有限的机载计算资源下,实现对复杂环境的感知和决策。现有方法要么依赖于计算量小的浅层网络,导致环境感知能力不足;要么将计算卸载到边缘服务器,但引入了不可忽视的延迟,影响导航的实时性。因此,如何在资源受限的无人机平台上,实现高效、实时的自主导航是一个关键问题。

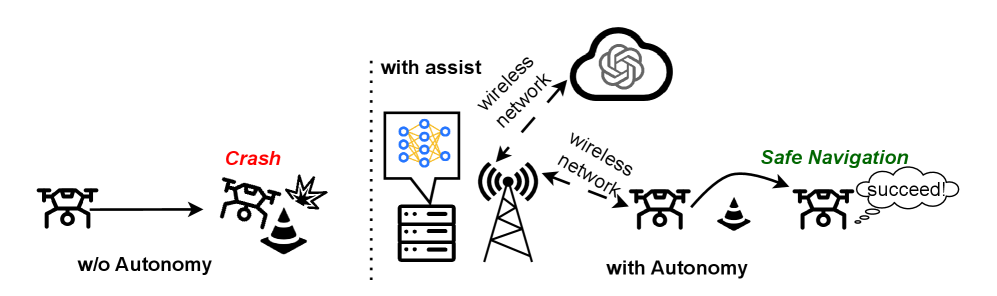

核心思路:CoDrone的核心思路是利用云-边-端协同计算,将计算密集型的任务(如深度估计和视觉语言交互)卸载到边缘服务器或云端,同时在无人机端保留轻量级的导航模型。通过深度强化学习的神经调度器,动态地选择是否需要进行深度估计,从而在计算资源和导航性能之间取得平衡。此外,引入视觉语言模型(VLM)增强无人机在复杂未知环境中的推理能力。

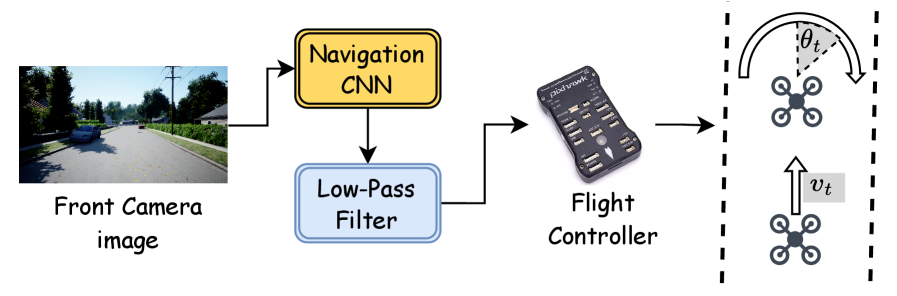

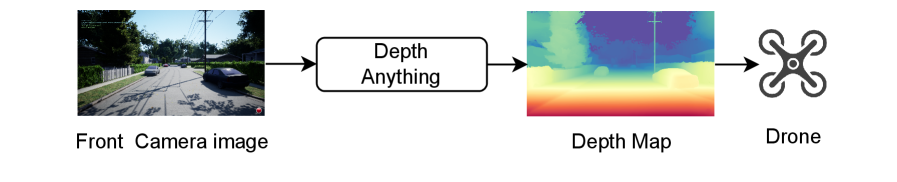

技术框架:CoDrone的整体框架包括三个主要部分:无人机端、边缘服务器和云端。无人机端负责图像采集和轻量级导航;边缘服务器负责深度估计(使用Depth Anything V2)和神经调度;云端负责视觉语言交互。整个流程如下:无人机采集灰度图像,输入导航模型进行初步导航决策。神经调度器根据当前环境状态,决定是否需要进行深度估计。如果需要,将图像发送到边缘服务器进行深度估计,并将深度信息反馈给无人机,用于优化导航决策。在需要进行复杂推理时,无人机与云端的VLM进行交互,获取导航指令。

关键创新:CoDrone的关键创新在于以下几点:1) 提出了一种云-边-端协同计算框架,将基础模型集成到无人机自主导航中。2) 引入了基于一维占据栅格的导航方法,简化了导航的表征。3) 设计了基于深度强化学习的神经调度器,实现了深度估计和导航决策的动态集成。4) 提出了无人机特定的视觉语言交互模块,增强了无人机在复杂环境中的推理能力。

关键设计:CoDrone的关键设计包括:1) 使用灰度图像作为导航模型的输入,降低了计算和传输开销。2) 采用Depth Anything V2进行深度估计,提高了深度估计的准确性。3) 设计了基于一维占据栅格的导航方法,简化了环境的表征。4) 使用深度强化学习训练神经调度器,使其能够根据环境状态动态地选择是否进行深度估计。5) 针对无人机领域定制了视觉语言交互模块,使其能够理解无人机的飞行指令。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CoDrone在不同的飞行速度和网络条件下,平均飞行距离比基线方法提高了40%,平均导航质量提高了5%。这些结果表明,CoDrone能够有效地利用云-边-端协同计算和基础模型,提高无人机在复杂环境下的自主导航能力。此外,CoDrone的神经调度器能够根据环境状态动态地选择是否进行深度估计,从而在计算资源和导航性能之间取得平衡。

🎯 应用场景

CoDrone框架具有广泛的应用前景,例如在物流配送、环境监测、灾害救援等领域。通过利用云-边-端协同计算和基础模型,CoDrone可以提高无人机在复杂环境下的自主导航能力,降低对机载计算资源的要求,从而降低无人机的使用成本和维护成本。未来,CoDrone还可以与其他传感器和算法集成,实现更高级的无人机应用。

📄 摘要(原文)

Autonomous navigation for Unmanned Aerial Vehicles faces key challenges from limited onboard computational resources, which restrict deployed deep neural networks to shallow architectures incapable of handling complex environments. Offloading tasks to remote edge servers introduces high latency, creating an inherent trade-off in system design. To address these limitations, we propose CoDrone - the first cloud-edge-end collaborative computing framework integrating foundation models into autonomous UAV cruising scenarios - effectively leveraging foundation models to enhance performance of resource-constrained unmanned aerial vehicle platforms. To reduce onboard computation and data transmission overhead, CoDrone employs grayscale imagery for the navigation model. When enhanced environmental perception is required, CoDrone leverages the edge-assisted foundation model Depth Anything V2 for depth estimation and introduces a novel one-dimensional occupancy grid-based navigation method - enabling fine-grained scene understanding while advancing efficiency and representational simplicity of autonomous navigation. A key component of CoDrone is a Deep Reinforcement Learning-based neural scheduler that seamlessly integrates depth estimation with autonomous navigation decisions, enabling real-time adaptation to dynamic environments. Furthermore, the framework introduces a UAV-specific vision language interaction module incorporating domain-tailored low-level flight primitives to enable effective interaction between the cloud foundation model and the UAV. The introduction of VLM enhances open-set reasoning capabilities in complex unseen scenarios. Experimental results show CoDrone outperforms baseline methods under varying flight speeds and network conditions, achieving a 40% increase in average flight distance and a 5% improvement in average Quality of Navigation.