Large Video Planner Enables Generalizable Robot Control

作者: Boyuan Chen, Tianyuan Zhang, Haoran Geng, Kiwhan Song, Caiyi Zhang, Peihao Li, William T. Freeman, Jitendra Malik, Pieter Abbeel, Russ Tedrake, Vincent Sitzmann, Yilun Du

分类: cs.RO, cs.CV

发布日期: 2025-12-17

备注: 29 pages, 16 figures

💡 一句话要点

提出基于大规模视频预训练的通用机器人控制框架,实现零样本泛化。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人控制 视频预训练 通用机器人 零样本学习 机器人规划 动作生成 时空建模

📋 核心要点

- 现有机器人控制方法依赖于多模态大型语言模型,但忽略了视频中蕴含的时空信息,限制了泛化能力。

- 论文提出一种基于大规模视频预训练的机器人控制框架,直接从视频中学习状态和动作的关联,生成可执行的机器人动作。

- 通过真实机器人实验验证了该框架的有效性,实现了在未见过的场景和任务中的零样本泛化,并开源了模型和数据集。

📝 摘要(中文)

通用机器人需要能够在不同任务和环境中泛化的决策模型。现有方法通过扩展多模态大型语言模型(MLLM)并添加动作输出,构建视觉-语言-动作(VLA)机器人基础模型。本文探索了一种替代范式,即使用大规模视频预训练作为构建机器人基础模型的主要模态。与静态图像和语言不同,视频捕捉了物理世界中状态和动作的时空序列,这与机器人行为自然对齐。我们整理了一个互联网规模的人类活动和任务演示视频数据集,并首次以基础模型的规模训练了一个用于生成式机器人规划的开放视频模型。该模型为新的场景和任务生成零样本视频规划,我们对其进行后处理以提取可执行的机器人动作。通过第三方选择的真实任务和真实机器人实验评估了任务级泛化能力,证明了成功的物理执行。这些结果表明了强大的指令遵循、强大的泛化能力和现实世界的可行性。我们发布了模型和数据集,以支持开放的、可复现的基于视频的机器人学习。

🔬 方法详解

问题定义:现有机器人控制方法,特别是基于多模态大型语言模型(MLLM)的方法,虽然利用了语言和图像的预训练优势,但忽略了视频数据中蕴含的丰富时空信息。这些方法在处理需要理解动作序列和状态变化的复杂任务时,泛化能力受到限制。因此,如何利用大规模视频数据来提升机器人控制的泛化能力是一个关键问题。

核心思路:论文的核心思路是利用大规模视频预训练来构建机器人基础模型。视频数据天然包含了状态和动作的时空序列,与机器人行为高度对齐。通过训练模型从视频中学习人类活动和任务演示,可以使机器人具备理解和生成动作序列的能力,从而实现更好的泛化性能。

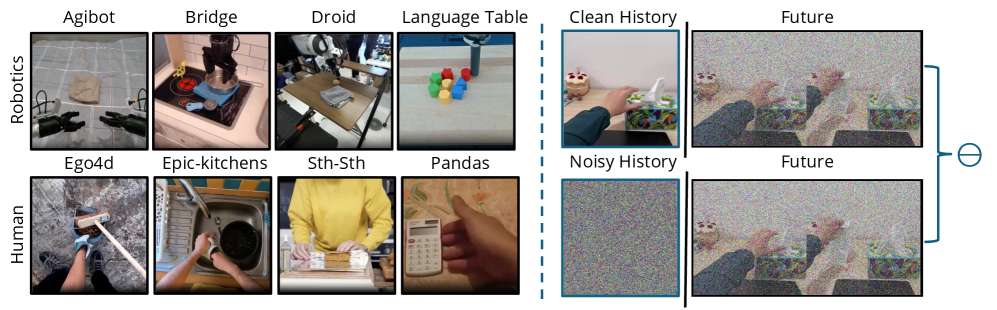

技术框架:该框架主要包含以下几个阶段:1) 数据收集:构建一个互联网规模的人类活动和任务演示视频数据集。2) 模型训练:以基础模型的规模训练一个开放视频模型,用于生成式机器人规划。3) 视频规划:对于新的场景和任务,模型生成零样本视频规划。4) 动作提取:对生成的视频规划进行后处理,提取可执行的机器人动作。5) 机器人执行:将提取的动作指令发送给机器人,控制其执行任务。

关键创新:最重要的技术创新点在于将大规模视频预训练作为机器人控制的主要模态。与以往主要依赖语言和图像的方法不同,该方法直接从视频中学习动作序列和状态变化,更符合机器人控制的本质。此外,该模型能够生成零样本视频规划,无需针对特定任务进行微调,大大提高了泛化能力。

关键设计:论文的关键设计包括:1) 大规模视频数据集的构建,保证了模型能够学习到丰富的动作模式。2) 开放视频模型的选择和训练,使其具备生成高质量视频规划的能力。3) 视频规划的后处理和动作提取方法,将生成的视频规划转化为可执行的机器人动作。具体的网络结构、损失函数和参数设置等细节在论文中进行了详细描述(具体细节未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在第三方选择的真实任务和真实机器人实验中取得了成功,证明了强大的指令遵循能力、强大的泛化能力和现实世界的可行性。具体性能数据和对比基线未知,但论文强调了其在零样本泛化方面的优势,表明该方法能够有效地处理未见过的场景和任务。

🎯 应用场景

该研究成果可广泛应用于各种需要通用机器人控制的场景,例如家庭服务、物流仓储、工业自动化等。通过学习人类的活动视频,机器人可以更好地理解和执行各种任务,从而提高工作效率和降低成本。未来,该技术有望实现机器人在复杂和动态环境中的自主操作,推动机器人技术的进一步发展。

📄 摘要(原文)

General-purpose robots require decision-making models that generalize across diverse tasks and environments. Recent works build robot foundation models by extending multimodal large language models (MLLMs) with action outputs, creating vision-language-action (VLA) systems. These efforts are motivated by the intuition that MLLMs' large-scale language and image pretraining can be effectively transferred to the action output modality. In this work, we explore an alternative paradigm of using large-scale video pretraining as a primary modality for building robot foundation models. Unlike static images and language, videos capture spatio-temporal sequences of states and actions in the physical world that are naturally aligned with robotic behavior. We curate an internet-scale video dataset of human activities and task demonstrations, and train, for the first time at a foundation-model scale, an open video model for generative robotics planning. The model produces zero-shot video plans for novel scenes and tasks, which we post-process to extract executable robot actions. We evaluate task-level generalization through third-party selected tasks in the wild and real-robot experiments, demonstrating successful physical execution. Together, these results show robust instruction following, strong generalization, and real-world feasibility. We release both the model and dataset to support open, reproducible video-based robot learning. Our website is available at https://www.boyuan.space/large-video-planner/.