MPC-Guided Safe Reinforcement Learning and Lipschitz-Based Filtering for Structured Nonlinear Systems

作者: Patrick Kostelac, Xuerui Wang, Anahita Jamshidnejad

分类: cs.RO, eess.SY

发布日期: 2025-12-14

💡 一句话要点

提出MPC引导的安全强化学习框架,解决结构化非线性系统控制问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 模型预测控制 安全控制 非线性系统 Lipschitz连续性

📋 核心要点

- 现有强化学习方法在探索过程中难以保证动态约束的满足,模型预测控制虽然能处理约束,但依赖精确模型且计算量大。

- 本文提出一种MPC引导的安全强化学习框架,利用MPC定义安全控制边界,引导RL策略学习,并在部署时使用轻量级安全滤波器。

- 在非线性气动弹性机翼系统上的实验表明,该方法能有效抑制扰动,降低执行器工作量,并在湍流下保持鲁棒性能。

📝 摘要(中文)

现代工程系统,如自动驾驶车辆、柔性机器人和智能航空航天平台,需要对不确定性具有鲁棒性、能适应环境变化并在实时约束下保证安全的控制器。强化学习(RL)为与不确定环境交互的非线性动力学系统提供了强大的数据驱动适应性。然而,RL缺乏在探索过程中满足动态约束的内置机制。模型预测控制(MPC)提供了结构化的约束处理和鲁棒性,但其对精确模型的依赖和计算量大的在线优化可能带来重大挑战。本文提出了一种集成的MPC-RL框架,该框架结合了MPC的稳定性和安全性保证以及RL的适应性。在训练期间,MPC定义了安全控制边界,引导RL组件并实现约束感知的策略学习。在部署时,学习到的策略实时运行,并使用基于Lipschitz连续性的轻量级安全滤波器,以确保满足约束,而无需繁重的在线优化。该方法在一个非线性气动弹性机翼系统上进行了验证,证明了其改进的抗扰动能力、降低的执行器工作量以及在湍流下的鲁棒性能。该架构可推广到具有结构化非线性和有界扰动的其他领域,为工程应用中安全的人工智能驱动控制提供了一种可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决结构化非线性系统在不确定环境中安全控制的问题。现有强化学习方法在探索过程中难以保证满足动态约束,存在安全隐患。而模型预测控制虽然可以处理约束,但依赖于精确的系统模型,且在线优化计算量大,难以满足实时性要求。

核心思路:论文的核心思路是将模型预测控制(MPC)的安全性保证与强化学习(RL)的自适应能力相结合。MPC负责提供安全控制边界,引导RL进行策略学习,确保训练过程中的安全性。在部署阶段,使用学习到的策略进行实时控制,并利用基于Lipschitz连续性的轻量级安全滤波器来保证约束满足,避免了复杂的在线优化。

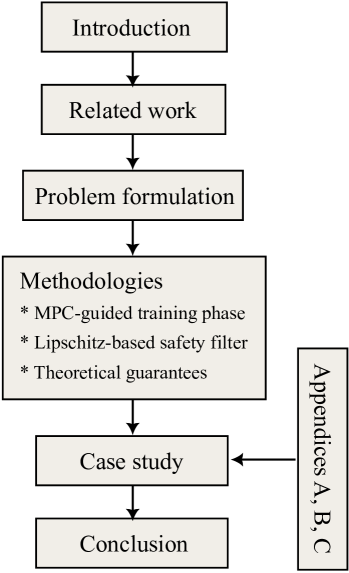

技术框架:整体框架包含训练和部署两个阶段。在训练阶段,MPC作为安全引导,为RL提供安全控制边界,RL在此边界内进行策略学习。在部署阶段,学习到的RL策略直接用于控制,同时利用基于Lipschitz连续性的安全滤波器对控制输出进行修正,确保满足约束条件。该框架主要包含MPC模块、RL策略学习模块和Lipschitz安全滤波器模块。

关键创新:最重要的技术创新在于将MPC的安全性保证与RL的自适应能力有机结合,提出了一种MPC引导的安全强化学习框架。与传统的RL方法相比,该方法在训练过程中能够保证安全性,避免了因探索而导致的危险行为。与传统的MPC方法相比,该方法能够利用RL学习到的策略进行实时控制,避免了复杂的在线优化。

关键设计:MPC模块用于生成安全控制边界,其参数设置需要根据具体的系统动力学特性进行调整。RL策略学习模块可以使用各种RL算法,如TRPO、PPO等,损失函数需要考虑控制性能和安全性。Lipschitz安全滤波器基于系统的Lipschitz常数进行设计,用于修正RL策略的输出,确保满足约束条件。Lipschitz常数的估计方法是关键的技术细节。

🖼️ 关键图片

📊 实验亮点

在非线性气动弹性机翼系统上的实验结果表明,该方法能够有效抑制扰动,降低执行器工作量,并在湍流环境下保持鲁棒性能。与传统的控制方法相比,该方法在抗扰动能力、执行器效率和鲁棒性方面均有显著提升,验证了该方法的有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于需要安全可靠控制的结构化非线性系统,例如自动驾驶车辆、柔性机器人、智能航空航天平台等。通过结合MPC的安全性保证和RL的自适应能力,可以实现对复杂系统的安全、高效控制,具有重要的实际应用价值和广阔的应用前景。未来,该方法有望进一步推广到更复杂的系统和环境,为人工智能驱动的控制系统提供更可靠的解决方案。

📄 摘要(原文)

Modern engineering systems, such as autonomous vehicles, flexible robotics, and intelligent aerospace platforms, require controllers that are robust to uncertainties, adaptive to environmental changes, and safety-aware under real-time constraints. RL offers powerful data-driven adaptability for systems with nonlinear dynamics that interact with uncertain environments. RL, however, lacks built-in mechanisms for dynamic constraint satisfaction during exploration. MPC offers structured constraint handling and robustness, but its reliance on accurate models and computationally demanding online optimization may pose significant challenges. This paper proposes an integrated MPC-RL framework that combines stability and safety guarantees of MPC with the adaptability of RL. During training, MPC defines safe control bounds that guide the RL component and that enable constraint-aware policy learning. At deployment, the learned policy operates in real time with a lightweight safety filter based on Lipschitz continuity to ensure constraint satisfaction without heavy online optimizations. The approach, which is validated on a nonlinear aeroelastic wing system, demonstrates improved disturbance rejection, reduced actuator effort, and robust performance under turbulence. The architecture generalizes to other domains with structured nonlinearities and bounded disturbances, offering a scalable solution for safe artificial-intelligence-driven control in engineering applications.