Learning to Get Up Across Morphologies: Zero-Shot Recovery with a Unified Humanoid Policy

作者: Jonathan Spraggett

分类: cs.RO, cs.LG

发布日期: 2025-12-13

备注: Accepted at 28th RoboCup International Symposium

🔗 代码/项目: GITHUB

💡 一句话要点

提出一种通用人形机器人策略,实现跨形态零样本摔倒恢复

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 人形机器人 摔倒恢复 深度强化学习 零样本迁移 形态泛化

📋 核心要点

- 现有方法需要为每种人形机器人形态单独训练摔倒恢复策略,成本高昂且缺乏通用性。

- 论文提出一种基于深度强化学习的统一策略,通过CrossQ训练,实现跨多种形态的零样本摔倒恢复。

- 实验表明,该策略在未见过的机器人形态上也能有效恢复,性能甚至超越部分特定形态的专家策略。

📝 摘要(中文)

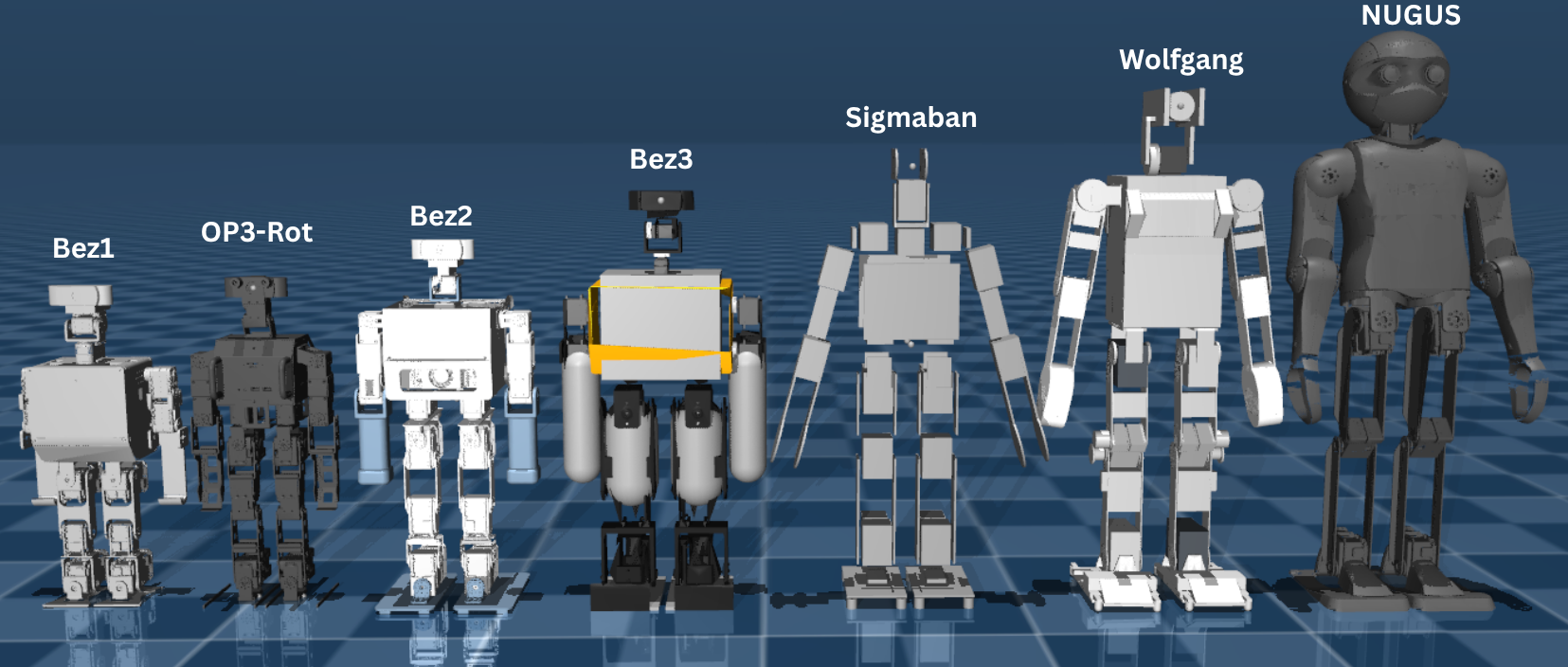

摔倒恢复是人形机器人在动态环境(如RoboCup)中的关键技能,长时间的倒地往往决定比赛的胜负。最近使用深度强化学习(DRL)的技术已经产生了鲁棒的站起行为,但现有方法需要为每种机器人形态训练单独的策略。本文提出了一个单一的DRL策略,能够从七种不同人形机器人的摔倒中恢复,这些机器人具有不同的高度(0.48 - 0.81米)、重量(2.8 - 7.9公斤)和动力学特性。该统一策略使用CrossQ训练,在未见过的形态上实现了高达86 +/- 7%(95%置信区间[81, 89])的零样本迁移,无需针对特定机器人进行训练。全面的留一法实验、形态缩放分析和多样性消融实验表明,有针对性的形态覆盖可以提高零样本泛化能力。在某些情况下,共享策略甚至超过了专门的基线。这些发现说明了形态不可知控制在摔倒恢复中的实用性,为通用人形机器人控制奠定了基础。该软件已开源,可在https://github.com/utra-robosoccer/unified-humanoid-getup 获取。

🔬 方法详解

问题定义:现有的人形机器人摔倒恢复方法通常需要针对特定机器人形态进行训练,这导致了高昂的训练成本和部署难度。每当机器人形态发生改变,就需要重新训练策略,限制了其在多样化机器人平台上的应用。因此,如何设计一种通用的、形态不可知的摔倒恢复策略是一个重要的挑战。

核心思路:论文的核心思路是训练一个能够泛化到不同机器人形态的单一策略。通过在多种形态的机器人上进行训练,并利用CrossQ算法来提高策略的泛化能力,使得该策略能够在未见过的机器人形态上也能有效地执行摔倒恢复任务。这种方法避免了为每种机器人单独训练策略的需求,大大降低了训练成本和部署难度。

技术框架:该方法采用深度强化学习框架,主要包括以下几个模块:1) 环境模拟器:用于模拟不同形态的机器人及其摔倒场景。2) 强化学习智能体:使用深度神经网络作为策略网络,负责学习摔倒恢复策略。3) CrossQ算法:用于提高策略的泛化能力,通过在不同形态的机器人之间进行知识迁移,使得策略能够适应未见过的形态。4) 奖励函数:用于指导智能体学习摔倒恢复行为,包括站立高度、平衡性和时间惩罚等。

关键创新:该论文最重要的技术创新点在于提出了一个能够跨多种机器人形态进行零样本迁移的摔倒恢复策略。与现有方法相比,该方法无需针对特定机器人进行训练,大大降低了训练成本和部署难度。此外,通过CrossQ算法,该方法能够有效地提高策略的泛化能力,使得策略能够在未见过的机器人形态上也能有效地执行摔倒恢复任务。

关键设计:论文的关键设计包括:1) 使用CrossQ算法来提高策略的泛化能力,通过在不同形态的机器人之间进行知识迁移。2) 设计了一个综合的奖励函数,包括站立高度、平衡性和时间惩罚等,以指导智能体学习摔倒恢复行为。3) 通过形态缩放分析和多样性消融实验,研究了不同形态参数对策略泛化能力的影响,并选择了合适的形态组合进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该统一策略在未见过的机器人形态上实现了高达86 +/- 7%(95%置信区间[81, 89])的零样本迁移成功率。在某些情况下,该共享策略甚至超过了专门为特定形态训练的基线策略。通过留一法实验、形态缩放分析和多样性消融实验,验证了该方法的有效性和泛化能力。

🎯 应用场景

该研究成果可广泛应用于人形机器人领域,尤其是在RoboCup等动态环境中。通用的摔倒恢复策略能够提高机器人的自主性和鲁棒性,减少因摔倒造成的停机时间,从而提升机器人在复杂环境中的工作效率。此外,该方法也为通用人形机器人控制奠定了基础,有望推动人形机器人在服务、救援等领域的应用。

📄 摘要(原文)

Fall recovery is a critical skill for humanoid robots in dynamic environments such as RoboCup, where prolonged downtime often decides the match. Recent techniques using deep reinforcement learning (DRL) have produced robust get-up behaviors, yet existing methods require training of separate policies for each robot morphology. This paper presents a single DRL policy capable of recovering from falls across seven humanoid robots with diverse heights (0.48 - 0.81 m), weights (2.8 - 7.9 kg), and dynamics. Trained with CrossQ, the unified policy transfers zero-shot up to 86 +/- 7% (95% CI [81, 89]) on unseen morphologies, eliminating the need for robot-specific training. Comprehensive leave-one-out experiments, morph scaling analysis, and diversity ablations show that targeted morphological coverage improves zero-shot generalization. In some cases, the shared policy even surpasses the specialist baselines. These findings illustrate the practicality of morphology-agnostic control for fall recovery, laying the foundation for generalist humanoid control. The software is open-source and available at: https://github.com/utra-robosoccer/unified-humanoid-getup