Iterative Compositional Data Generation for Robot Control

作者: Anh-Quan Pham, Marcel Hussing, Shubhankar P. Patankar, Dani S. Bassett, Jorge Mendez-Mendez, Eric Eaton

分类: cs.RO, cs.LG

发布日期: 2025-12-11 (更新: 2025-12-20)

备注: Added experiments in Appendix A; no change to main paper

💡 一句话要点

提出基于迭代组合数据生成的机器人控制方法,解决多任务泛化问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人控制 数据生成 组合泛化 扩散模型 Transformer 离线强化学习 语义建模

📋 核心要点

- 现有机器人控制方法难以泛化到多对象、多机器人和多环境的复杂任务组合。

- 提出一种语义组合扩散Transformer,将状态转移分解为可组合的组件,并通过注意力机制学习组件间的交互。

- 通过迭代的自我改进程序,利用离线强化学习验证并优化合成数据,显著提升了零样本性能。

📝 摘要(中文)

机器人操作数据采集成本高昂,使得在多对象、多机器人和多环境设置中,获取组合爆炸式增长的任务演示数据变得不切实际。虽然最近的生成模型可以为单个任务合成有用的数据,但它们没有利用机器人领域的组合结构,并且难以泛化到未见过的任务组合。我们提出了一种语义组合扩散Transformer,它将状态转移分解为机器人、对象、障碍物和目标特定的组件,并通过注意力机制学习它们之间的交互。在有限的任务子集上训练后,我们证明了我们的模型可以零样本生成高质量的转移数据,从中我们可以学习未见过的任务组合的控制策略。然后,我们引入了一个迭代的自我改进程序,其中合成数据通过离线强化学习进行验证,并纳入后续的训练轮次。我们的方法大大提高了零样本性能,优于单体和硬编码的组合基线,最终解决了几乎所有保留的任务,并证明了学习表示中出现了有意义的组合结构。

🔬 方法详解

问题定义:机器人控制面临的最大挑战之一是数据收集成本高昂,尤其是在涉及多个对象、机器人和环境的复杂任务中。现有的生成模型虽然可以为特定任务生成数据,但它们通常忽略了机器人领域的组合结构,导致难以泛化到未见过的任务组合,限制了其在实际应用中的价值。

核心思路:该论文的核心思路是将复杂的机器人控制任务分解为可组合的语义组件,例如机器人自身的动作、对象的状态、障碍物的布局以及任务的目标。通过学习这些组件之间的交互关系,模型可以更好地理解任务的内在结构,从而能够生成适用于未见任务组合的数据。

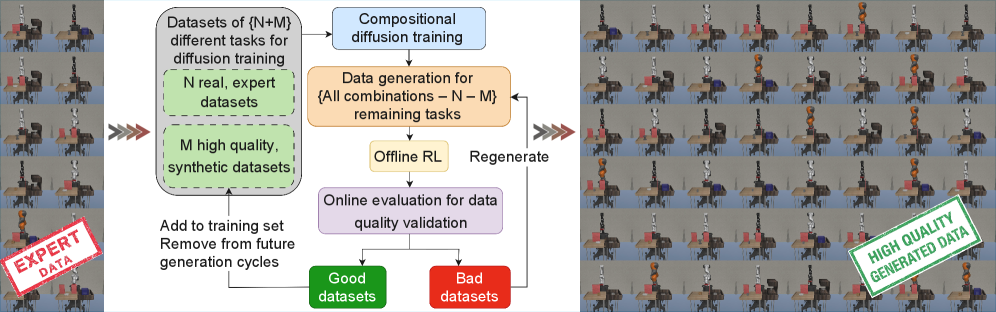

技术框架:该方法的核心是一个语义组合扩散Transformer。该Transformer接收任务描述作为输入,并生成相应的状态转移数据。整个流程包含以下几个关键步骤:首先,将状态转移分解为机器人、对象、障碍物和目标特定的组件;然后,利用Transformer的注意力机制学习这些组件之间的交互;最后,通过迭代的自我改进程序,使用离线强化学习验证生成的数据,并将验证后的数据用于后续的训练轮次,从而不断提高生成数据的质量。

关键创新:该论文的关键创新在于提出了语义组合扩散Transformer,它能够显式地建模机器人控制任务的组合结构。与传统的单体模型相比,该模型能够更好地泛化到未见过的任务组合。此外,迭代的自我改进程序也能够有效地提高生成数据的质量,从而进一步提升控制策略的性能。

关键设计:该模型使用了Transformer架构,并针对机器人控制任务进行了定制。具体来说,模型使用了注意力机制来学习不同组件之间的交互关系。此外,模型还使用了扩散模型来生成状态转移数据。在训练过程中,模型使用了离线强化学习来验证生成的数据,并使用验证后的数据来更新模型的参数。损失函数的设计也至关重要,需要平衡生成数据的质量和多样性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在零样本学习方面显著优于单体和硬编码的组合基线。最终,该方法解决了几乎所有保留的任务,并证明了学习表示中出现了有意义的组合结构。具体性能提升数据在论文中给出,表明该方法在复杂机器人控制任务中具有很强的实用性。

🎯 应用场景

该研究成果可应用于各种机器人控制场景,尤其是在需要处理复杂任务组合的领域,如自动化装配、物流仓储和家庭服务机器人。通过生成高质量的训练数据,可以降低机器人学习控制策略的成本,并提高机器人的泛化能力,使其能够适应各种未知的环境和任务。

📄 摘要(原文)

Collecting robotic manipulation data is expensive, making it impractical to acquire demonstrations for the combinatorially large space of tasks that arise in multi-object, multi-robot, and multi-environment settings. While recent generative models can synthesize useful data for individual tasks, they do not exploit the compositional structure of robotic domains and struggle to generalize to unseen task combinations. We propose a semantic compositional diffusion transformer that factorizes transitions into robot-, object-, obstacle-, and objective-specific components and learns their interactions through attention. Once trained on a limited subset of tasks, we show that our model can zero-shot generate high-quality transitions from which we can learn control policies for unseen task combinations. Then, we introduce an iterative self-improvement procedure in which synthetic data is validated via offline reinforcement learning and incorporated into subsequent training rounds. Our approach substantially improves zero-shot performance over monolithic and hard-coded compositional baselines, ultimately solving nearly all held-out tasks and demonstrating the emergence of meaningful compositional structure in the learned representations.