Evaluating Gemini Robotics Policies in a Veo World Simulator

作者: Gemini Robotics Team, Krzysztof Choromanski, Coline Devin, Yilun Du, Debidatta Dwibedi, Ruiqi Gao, Abhishek Jindal, Thomas Kipf, Sean Kirmani, Isabel Leal, Fangchen Liu, Anirudha Majumdar, Andrew Marmon, Carolina Parada, Yulia Rubanova, Dhruv Shah, Vikas Sindhwani, Jie Tan, Fei Xia, Ted Xiao, Sherry Yang, Wenhao Yu, Allan Zhou

分类: cs.RO, cs.AI, cs.CV, cs.LG

发布日期: 2025-12-11 (更新: 2026-01-06)

💡 一句话要点

提出基于Veo视频模型的生成式评估系统,用于评估机器人策略在各种场景下的性能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人策略评估 生成式世界模型 视频模型 异分布泛化 物理安全 语义安全 Veo模型

📋 核心要点

- 现有机器人策略评估主要依赖同分布数据,缺乏对异分布场景的泛化能力评估。

- 提出一种基于Veo视频模型的生成式评估系统,支持机器人动作条件化和多视角一致性。

- 实验证明该系统能准确预测策略在各种场景下的性能,并暴露违反安全约束的行为。

📝 摘要(中文)

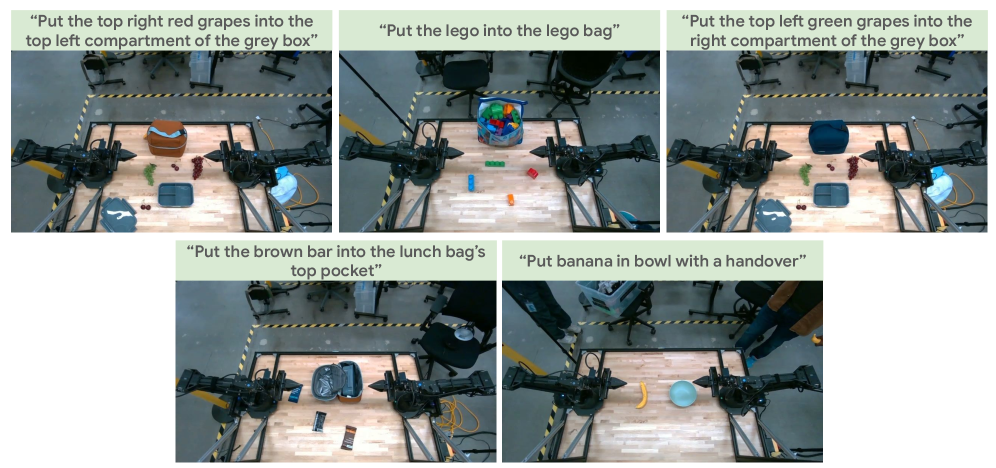

生成式世界模型在模拟机器人策略与各种环境的交互方面具有巨大潜力。前沿视频模型能够以可扩展和通用的方式生成逼真的观测和环境交互。然而,视频模型在机器人技术中的应用主要限于同分布评估,即与用于训练策略或微调基础视频模型的场景相似的场景。本报告表明,视频模型可用于机器人策略评估的整个范围:从评估标称性能到异分布泛化,以及探测物理和语义安全性。我们介绍了一种基于前沿视频基础模型(Veo)构建的生成式评估系统。该系统经过优化,支持机器人动作条件化和多视图一致性,同时集成生成式图像编辑和多视图补全,以合成真实世界场景的多种泛化变体。我们证明该系统保留了视频模型的基本能力,能够准确模拟经过编辑以包含新交互对象、新视觉背景和新干扰对象的场景。这种保真度能够准确预测不同策略在标称和异分布条件下的相对性能,确定不同泛化轴对策略性能的相对影响,并执行策略的红队测试,以暴露违反物理或语义安全约束的行为。我们通过对双臂机械手的八个Gemini Robotics策略检查点和五个任务的1600多次真实世界评估验证了这些能力。

🔬 方法详解

问题定义:现有机器人策略评估方法主要依赖于真实环境或高成本的仿真环境,难以进行大规模、多样化的评估,尤其是在异分布(OOD)场景下的泛化能力评估。此外,现有方法在物理和语义安全方面的评估能力也有限,难以发现潜在的安全隐患。

核心思路:利用生成式视频模型(Veo)强大的生成能力,构建一个可控的、多样化的虚拟环境,用于评估机器人策略的性能。通过对视频模型进行优化,使其能够支持机器人动作条件化和多视角一致性,从而更真实地模拟机器人与环境的交互。

技术框架:该生成式评估系统主要包含以下几个模块:1) 基于Veo的视频生成模块,负责生成逼真的环境视频;2) 机器人动作条件化模块,将机器人动作作为输入,控制视频的生成过程;3) 多视角一致性模块,保证不同视角下生成的视频内容一致;4) 生成式图像编辑模块,用于修改场景,例如添加新物体、改变背景等;5) 多视角补全模块,用于补全被遮挡的区域。整个流程是,首先输入机器人动作,然后通过视频生成模块生成环境视频,再通过图像编辑模块修改场景,最后通过多视角补全模块补全被遮挡的区域,从而得到一个完整的虚拟环境,用于评估机器人策略。

关键创新:该方法的核心创新在于将生成式视频模型应用于机器人策略评估,并针对机器人动作条件化和多视角一致性进行了优化。与传统的仿真环境相比,该方法能够生成更逼真、更多样化的环境,从而更全面地评估机器人策略的性能。此外,该方法还集成了生成式图像编辑和多视角补全技术,进一步增强了环境的可控性和真实性。

关键设计:在视频生成模块中,使用了Veo视频模型作为基础模型,并对其进行了微调,使其能够更好地支持机器人动作条件化。在机器人动作条件化模块中,使用了Transformer网络来学习机器人动作与视频帧之间的映射关系。在多视角一致性模块中,使用了3D卷积神经网络来保证不同视角下生成的视频内容一致。在生成式图像编辑模块中,使用了Stable Diffusion模型来修改场景。在多视角补全模块中,使用了深度学习模型来补全被遮挡的区域。

🖼️ 关键图片

📊 实验亮点

通过1600多次真实世界评估,验证了该系统在评估Gemini Robotics策略检查点和五个双臂机械手任务方面的有效性。实验结果表明,该系统能够准确预测不同策略在标称和异分布条件下的相对性能,并能够暴露违反物理或语义安全约束的行为。该系统能够确定不同泛化轴对策略性能的相对影响,为策略的优化提供了指导。

🎯 应用场景

该研究成果可应用于机器人策略的开发、测试和验证,尤其是在复杂、动态和未知的环境中。通过该系统,可以更高效、更安全地评估机器人策略的性能,并发现潜在的安全隐患。此外,该系统还可以用于机器人教育和培训,帮助学生和工程师更好地理解和掌握机器人技术。

📄 摘要(原文)

Generative world models hold significant potential for simulating interactions with visuomotor policies in varied environments. Frontier video models can enable generation of realistic observations and environment interactions in a scalable and general manner. However, the use of video models in robotics has been limited primarily to in-distribution evaluations, i.e., scenarios that are similar to ones used to train the policy or fine-tune the base video model. In this report, we demonstrate that video models can be used for the entire spectrum of policy evaluation use cases in robotics: from assessing nominal performance to out-of-distribution (OOD) generalization, and probing physical and semantic safety. We introduce a generative evaluation system built upon a frontier video foundation model (Veo). The system is optimized to support robot action conditioning and multi-view consistency, while integrating generative image-editing and multi-view completion to synthesize realistic variations of real-world scenes along multiple axes of generalization. We demonstrate that the system preserves the base capabilities of the video model to enable accurate simulation of scenes that have been edited to include novel interaction objects, novel visual backgrounds, and novel distractor objects. This fidelity enables accurately predicting the relative performance of different policies in both nominal and OOD conditions, determining the relative impact of different axes of generalization on policy performance, and performing red teaming of policies to expose behaviors that violate physical or semantic safety constraints. We validate these capabilities through 1600+ real-world evaluations of eight Gemini Robotics policy checkpoints and five tasks for a bimanual manipulator.