Task-Oriented Grasping Using Reinforcement Learning with a Contextual Reward Machine

作者: Hui Li, Akhlak Uz Zaman, Fujian Yan, Hongsheng He

分类: cs.RO

发布日期: 2025-12-11

💡 一句话要点

提出基于上下文奖励机的强化学习方法,用于高效任务导向抓取

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 任务导向抓取 强化学习 上下文奖励机 机器人控制 近端策略优化

📋 核心要点

- 现有抓取方法在复杂任务中面临探索空间大、学习效率低等问题。

- 利用上下文奖励机将任务分解为子任务,并为每个子任务定义上下文信息,引导探索。

- 实验表明,该方法在模拟和真实机器人上均取得了优异的抓取成功率和学习效率。

📝 摘要(中文)

本文提出了一种结合上下文奖励机的强化学习框架,用于任务导向的抓取。上下文奖励机通过将抓取任务分解为可管理的子任务来降低任务复杂度。每个子任务都与特定阶段的上下文相关联,包括奖励函数、动作空间和状态抽象函数。这种上下文信息能够实现有效的阶段内指导,并通过减少状态-动作空间和在明确定义的边界内指导探索来提高学习效率。此外,引入了转移奖励来鼓励或惩罚阶段之间的转移,从而引导模型朝着期望的阶段序列发展,并进一步加速收敛。当与近端策略优化算法集成时,所提出的方法在包含各种对象、可供性和抓取拓扑的1000个模拟抓取任务中实现了95%的成功率。在学习速度和成功率方面均优于最先进的方法。该方法被转移到真实的机器人上,在六种可供性的60个抓取任务中实现了83.3%的成功率。这些实验结果证明了卓越的准确性、数据效率和学习效率。它们强调了该模型在模拟和真实环境中推进任务导向抓取的潜力。

🔬 方法详解

问题定义:论文旨在解决任务导向的抓取问题,即如何让机器人在复杂环境中,针对不同的物体和任务需求,高效、准确地完成抓取。现有方法通常面临探索空间巨大、学习效率低下的问题,难以适应多样化的抓取场景。

核心思路:论文的核心思路是将复杂的抓取任务分解为一系列可管理的子任务(阶段),并为每个子任务定义明确的上下文信息,包括奖励函数、动作空间和状态抽象函数。通过这种方式,可以显著减小每个阶段的探索空间,并利用上下文信息引导智能体进行更有效的学习。

技术框架:整体框架包含三个主要组成部分:环境、智能体和上下文奖励机。环境提供状态信息,智能体根据状态选择动作,上下文奖励机负责定义每个阶段的奖励函数、动作空间和状态抽象函数。智能体与环境交互,并根据上下文奖励机的反馈进行学习。整个过程使用近端策略优化(PPO)算法进行训练。

关键创新:最重要的创新点在于上下文奖励机的引入。它将复杂的抓取任务分解为一系列具有明确上下文信息的子任务,从而降低了学习难度,提高了学习效率。此外,转移奖励的引入进一步引导智能体学习期望的阶段序列,加速了收敛。

关键设计:上下文奖励机定义了每个阶段的奖励函数,用于指导智能体在特定阶段的行为。转移奖励用于鼓励或惩罚阶段之间的转移,引导智能体学习期望的阶段序列。状态抽象函数用于提取每个阶段的关键状态信息,减少状态空间的维度。PPO算法用于优化智能体的策略,使其能够根据状态选择合适的动作。

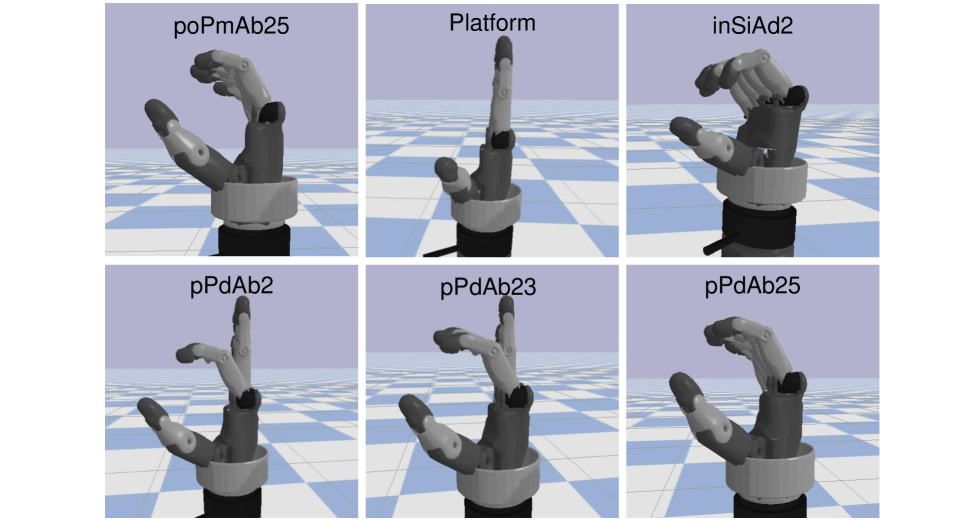

🖼️ 关键图片

📊 实验亮点

该方法在模拟环境中实现了95%的抓取成功率,优于现有方法。在真实机器人实验中,针对六种不同的可供性,实现了83.3%的抓取成功率。实验结果表明,该方法在学习速度、数据效率和抓取准确性方面均具有显著优势,验证了其在实际应用中的潜力。

🎯 应用场景

该研究成果可广泛应用于机器人自动化领域,例如工业生产线上的物料抓取、家庭服务机器人中的物品整理、以及医疗机器人中的辅助操作等。通过提升机器人抓取的准确性和效率,可以显著提高自动化水平,降低人工成本,并改善用户体验。未来,该方法有望扩展到更复杂的任务导向操作中。

📄 摘要(原文)

This paper presents a reinforcement learning framework that incorporates a Contextual Reward Machine for task-oriented grasping. The Contextual Reward Machine reduces task complexity by decomposing grasping tasks into manageable sub-tasks. Each sub-task is associated with a stage-specific context, including a reward function, an action space, and a state abstraction function. This contextual information enables efficient intra-stage guidance and improves learning efficiency by reducing the state-action space and guiding exploration within clearly defined boundaries. In addition, transition rewards are introduced to encourage or penalize transitions between stages which guides the model toward desirable stage sequences and further accelerates convergence. When integrated with the Proximal Policy Optimization algorithm, the proposed method achieved a 95% success rate across 1,000 simulated grasping tasks encompassing diverse objects, affordances, and grasp topologies. It outperformed the state-of-the-art methods in both learning speed and success rate. The approach was transferred to a real robot, where it achieved a success rate of 83.3% in 60 grasping tasks over six affordances. These experimental results demonstrate superior accuracy, data efficiency, and learning efficiency. They underscore the model's potential to advance task-oriented grasping in both simulated and real-world settings.