Push Smarter, Not Harder: Hierarchical RL-Diffusion Policy for Efficient Nonprehensile Manipulation

作者: Steven Caro, Stephen L. Smith

分类: cs.RO, cs.LG

发布日期: 2025-12-10

备注: 8 pages, 8 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出HeRD:一种层级RL-扩散策略,用于高效的非抓取操作

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 非抓取操作 强化学习 扩散模型 层级控制 机器人操作

📋 核心要点

- 非抓取操作因其复杂的接触动力学和长程规划需求而极具挑战,现有方法难以兼顾效率与泛化性。

- HeRD采用层级结构,利用强化学习选择中间目标,并使用扩散模型生成到达目标的轨迹,结合了两者的优势。

- 实验表明,HeRD在成功率、路径效率和泛化能力上均优于现有方法,为非抓取操作提供了一种新思路。

📝 摘要(中文)

本文提出了一种名为HeRD的层级强化学习-扩散策略,用于解决非抓取操作中的控制难题,例如在复杂环境中推动物体。该方法将推动任务分解为两个层级:高层目标选择和低层轨迹生成。高层强化学习(RL)智能体用于选择中间空间目标,而低层目标条件扩散模型用于生成可行的、高效的轨迹以达到这些目标。这种架构结合了RL的长期奖励最大化行为和扩散模型的生成能力。我们在2D仿真环境中评估了该方法,结果表明,在成功率、路径效率和跨多种环境配置的泛化能力方面,该方法优于最先进的基线。我们的结果表明,具有生成式低层规划的层级控制是可扩展的、面向目标的非抓取操作的一个有希望的方向。代码、文档和训练好的模型已开源。

🔬 方法详解

问题定义:论文旨在解决非抓取操作中,尤其是在复杂环境中推动物体时,由于接触动力学复杂和需要长程规划而导致的控制难题。现有方法通常难以在成功率、路径效率和泛化能力之间取得平衡,难以适应不同的环境配置。

核心思路:论文的核心思路是将推动任务分解为两个层级:高层目标选择和低层轨迹生成。高层使用强化学习来学习长期奖励最大化的策略,选择合适的中间目标;低层使用扩散模型来生成到达这些目标的轨迹。这种分层结构允许模型分别学习长期规划和局部运动生成,从而提高整体效率和泛化能力。

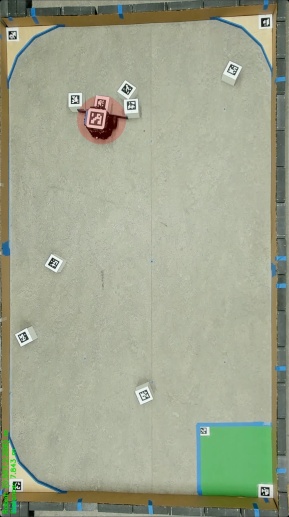

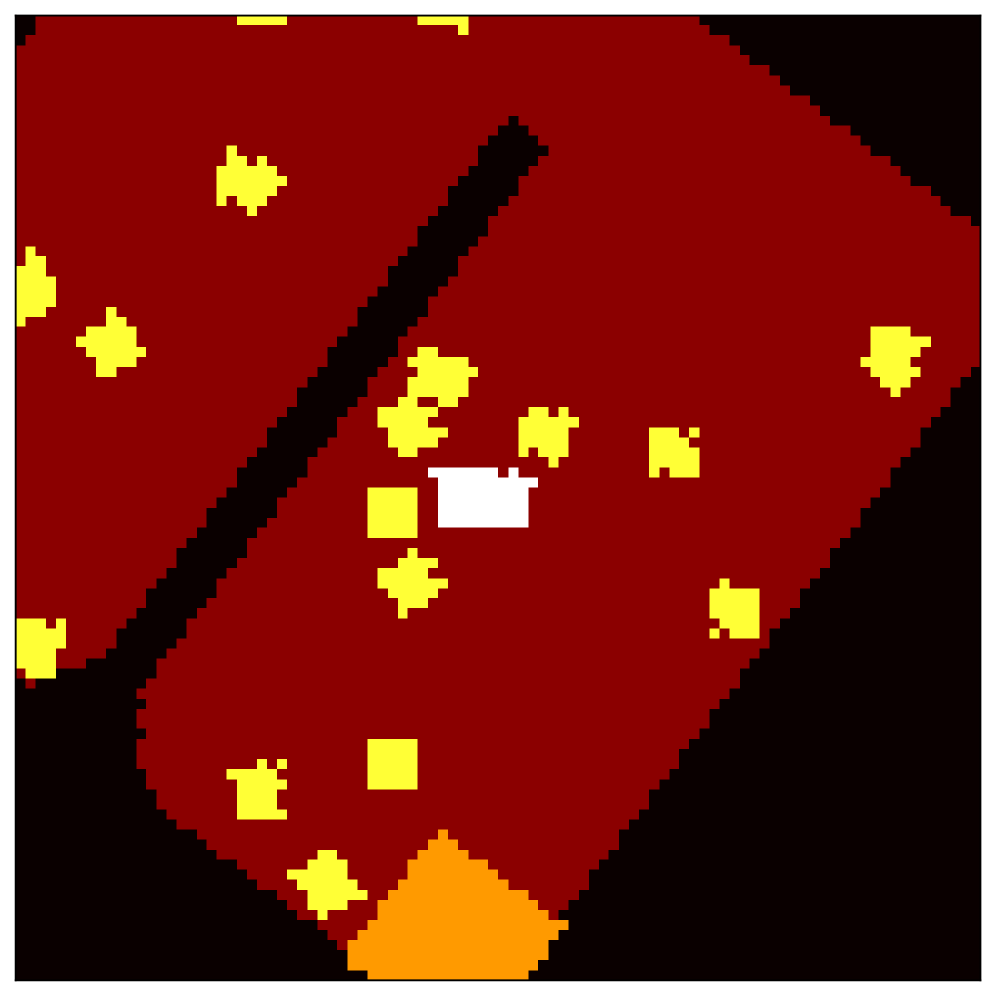

技术框架:HeRD的整体架构包含两个主要模块:高层RL智能体和低层目标条件扩散模型。高层RL智能体接收环境状态作为输入,输出中间目标。低层扩散模型接收环境状态和中间目标作为输入,生成到达该目标的轨迹。整个流程是:首先,高层RL智能体根据当前环境状态选择一个中间目标;然后,低层扩散模型生成一条到达该目标的轨迹;最后,执行该轨迹,并更新环境状态。

关键创新:最重要的技术创新点在于将强化学习和扩散模型结合起来,形成一个层级控制框架。强化学习负责长期规划,扩散模型负责局部运动生成。这种结合既利用了强化学习的奖励最大化能力,又利用了扩散模型的生成能力,从而提高了整体性能。与现有方法相比,HeRD能够更好地处理复杂的接触动力学和长程规划需求。

关键设计:高层RL智能体可以使用任何标准的强化学习算法,例如PPO或SAC。低层扩散模型可以使用任何目标条件扩散模型,例如Conditional Denoising Diffusion Probabilistic Models (DDPMs)。论文中可能使用了特定的奖励函数来训练高层RL智能体,以及特定的损失函数来训练低层扩散模型。具体的网络结构和参数设置需要在论文的实验部分查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HeRD在2D仿真环境中优于最先进的基线方法。具体而言,HeRD在成功率、路径效率和跨多种环境配置的泛化能力方面均取得了显著提升。这些结果表明,通过结合强化学习和扩散模型,可以有效地解决非抓取操作中的控制难题,并为未来的研究提供了有价值的参考。

🎯 应用场景

该研究成果可应用于机器人操作、自动化装配、物流分拣等领域。通过学习高效的非抓取操作策略,机器人可以在复杂环境中灵活地操纵物体,完成各种任务。未来的研究可以探索将该方法扩展到三维环境、多物体操作以及更复杂的任务场景,从而进一步提升机器人的自主性和适应性。

📄 摘要(原文)

Nonprehensile manipulation, such as pushing objects across cluttered environments, presents a challenging control problem due to complex contact dynamics and long-horizon planning requirements. In this work, we propose HeRD, a hierarchical reinforcement learning-diffusion policy that decomposes pushing tasks into two levels: high-level goal selection and low-level trajectory generation. We employ a high-level reinforcement learning (RL) agent to select intermediate spatial goals, and a low-level goal-conditioned diffusion model to generate feasible, efficient trajectories to reach them. This architecture combines the long-term reward maximizing behaviour of RL with the generative capabilities of diffusion models. We evaluate our method in a 2D simulation environment and show that it outperforms the state-of-the-art baseline in success rate, path efficiency, and generalization across multiple environment configurations. Our results suggest that hierarchical control with generative low-level planning is a promising direction for scalable, goal-directed nonprehensile manipulation. Code, documentation, and trained models are available: https://github.com/carosteven/HeRD.