LISN: Language-Instructed Social Navigation with VLM-based Controller Modulating

作者: Junting Chen, Yunchuan Li, Panfeng Jiang, Jiacheng Du, Zixuan Chen, Chenrui Tie, Jiajun Deng, Lin Shao

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-12-10

备注: 8 pages

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出LISN-Bench与Social-Nav-Modulator,实现语言指导的社交导航。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社交导航 语言指导 视觉语言模型 机器人 人机交互

📋 核心要点

- 现有社交导航方法主要关注路径效率和避撞,忽略了机器人理解并执行人类指令的能力。

- 论文提出Social-Nav-Modulator,利用VLM调节代价地图和控制器参数,实现语言指导的社交导航。

- 实验表明,该方法在语言指导的社交导航任务中,成功率显著高于现有方法,尤其在复杂场景中。

📝 摘要(中文)

本文提出了一种用于语言指导的社交导航方法,旨在实现人机共存。现有社交导航研究主要关注路径效率和行人避撞,忽略了机器人遵循用户指令的能力。为此,本文构建了首个基于仿真的语言指导社交导航基准测试LISN-Bench,它基于Rosnav-Arena 3.0,整合了指令跟随和场景理解。同时,提出了Social-Nav-Modulator,一个快速-慢速分层系统,其中视觉语言模型(VLM)智能体调节代价地图和控制器参数。这种解耦降低了对高频VLM推理的依赖,提高了动态避障和感知适应性。实验结果表明,该方法平均成功率达到91.3%,比最具竞争力的基线高出63%,尤其在人群跟随和避开禁行区域等挑战性任务中表现突出。

🔬 方法详解

问题定义:现有社交导航方法主要关注路径效率和行人避障,缺乏对人类指令的理解和执行能力。这使得机器人在复杂社交环境中难以与人类自然交互,无法满足用户特定的导航需求。现有方法难以将语言指令融入导航决策中,导致机器人行为不符合人类期望。

核心思路:论文的核心思路是利用视觉语言模型(VLM)理解人类指令,并将其转化为机器人可执行的导航策略。通过VLM调节代价地图和控制器参数,使机器人能够根据指令调整其行为,从而实现语言指导的社交导航。这种方法将高级语义信息融入底层控制,提高了机器人的导航智能。

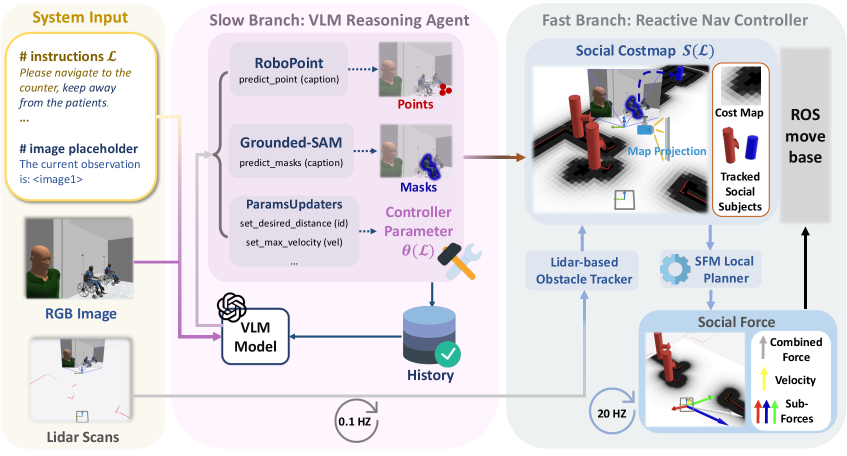

技术框架:Social-Nav-Modulator采用快速-慢速分层系统。慢速VLM环负责理解语言指令和场景信息,并生成代价地图和控制器参数的调制信号。快速底层控制器则根据调制后的参数进行实时的路径规划和运动控制。这种分层结构降低了对高频VLM推理的依赖,提高了系统的实时性和鲁棒性。主要模块包括:VLM指令解析模块、代价地图调制模块和控制器参数调制模块。

关键创新:该方法最重要的创新点在于将VLM与传统导航框架相结合,实现了语言指导的社交导航。通过VLM对代价地图和控制器参数进行调制,将高级语义信息融入底层控制,使得机器人能够根据指令调整其行为。这种方法突破了传统社交导航方法的局限性,为实现更智能、更自然的机器人交互提供了新的思路。

关键设计:VLM采用预训练的视觉语言模型,例如CLIP或ALIGN,并针对社交导航任务进行微调。代价地图调制模块根据VLM的输出,调整代价地图中不同区域的权重,例如,禁止区域的权重被设置为高值。控制器参数调制模块则根据VLM的输出,调整机器人的速度、加速度等参数,以实现不同的导航行为,例如,跟随行人时降低速度。

🖼️ 关键图片

📊 实验亮点

Social-Nav-Modulator在LISN-Bench上取得了显著的性能提升,平均成功率达到91.3%,比最具竞争力的基线高出63%。尤其在人群跟随和避开禁行区域等挑战性任务中,性能提升更为明显。实验结果表明,该方法能够有效地理解和执行人类指令,实现语言指导的社交导航。

🎯 应用场景

该研究成果可应用于服务机器人、导览机器人、智能轮椅等领域,使其能够在医院、商场、博物馆等复杂环境中,根据用户指令进行导航,并与人类进行自然的社交互动。该技术有助于提升机器人的智能化水平,提高用户体验,促进人机协作。

📄 摘要(原文)

Towards human-robot coexistence, socially aware navigation is significant for mobile robots. Yet existing studies on this area focus mainly on path efficiency and pedestrian collision avoidance, which are essential but represent only a fraction of social navigation. Beyond these basics, robots must also comply with user instructions, aligning their actions to task goals and social norms expressed by humans. In this work, we present LISN-Bench, the first simulation-based benchmark for language-instructed social navigation. Built on Rosnav-Arena 3.0, it is the first standardized social navigation benchmark to incorporate instruction following and scene understanding across diverse contexts. To address this task, we further propose Social-Nav-Modulator, a fast-slow hierarchical system where a VLM agent modulates costmaps and controller parameters. Decoupling low-level action generation from the slower VLM loop reduces reliance on high-frequency VLM inference while improving dynamic avoidance and perception adaptability. Our method achieves an average success rate of 91.3%, which is greater than 63% than the most competitive baseline, with most of the improvements observed in challenging tasks such as following a person in a crowd and navigating while strictly avoiding instruction-forbidden regions. The project website is at: https://social-nav.github.io/LISN-project/