Mind to Hand: Purposeful Robotic Control via Embodied Reasoning

作者: Peijun Tang, Shangjin Xie, Binyan Sun, Baifu Huang, Kuncheng Luo, Haotian Yang, Weiqi Jin, Jianan Wang

分类: cs.RO, cs.AI

发布日期: 2025-12-09 (更新: 2025-12-10)

备注: 49 pages, 25 figures

💡 一句话要点

Lumo-1:通过具身推理实现通用机器人控制,连接“思维”与“行动”

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身推理 视觉-语言-动作模型 机器人控制 预训练模型 强化学习

📋 核心要点

- 现有AI系统在互联网规模数据上展现出广泛的推理能力,但将其应用于物理行动仍然面临巨大挑战。

- Lumo-1通过三阶段预训练流程,将预训练VLM扩展到具身推理和动作预测,最终实现结构化推理和推理-动作对齐。

- 实验表明,Lumo-1在具身视觉-语言推理方面取得了显著的性能提升,并在真实机器人任务中超越了现有基线。

📝 摘要(中文)

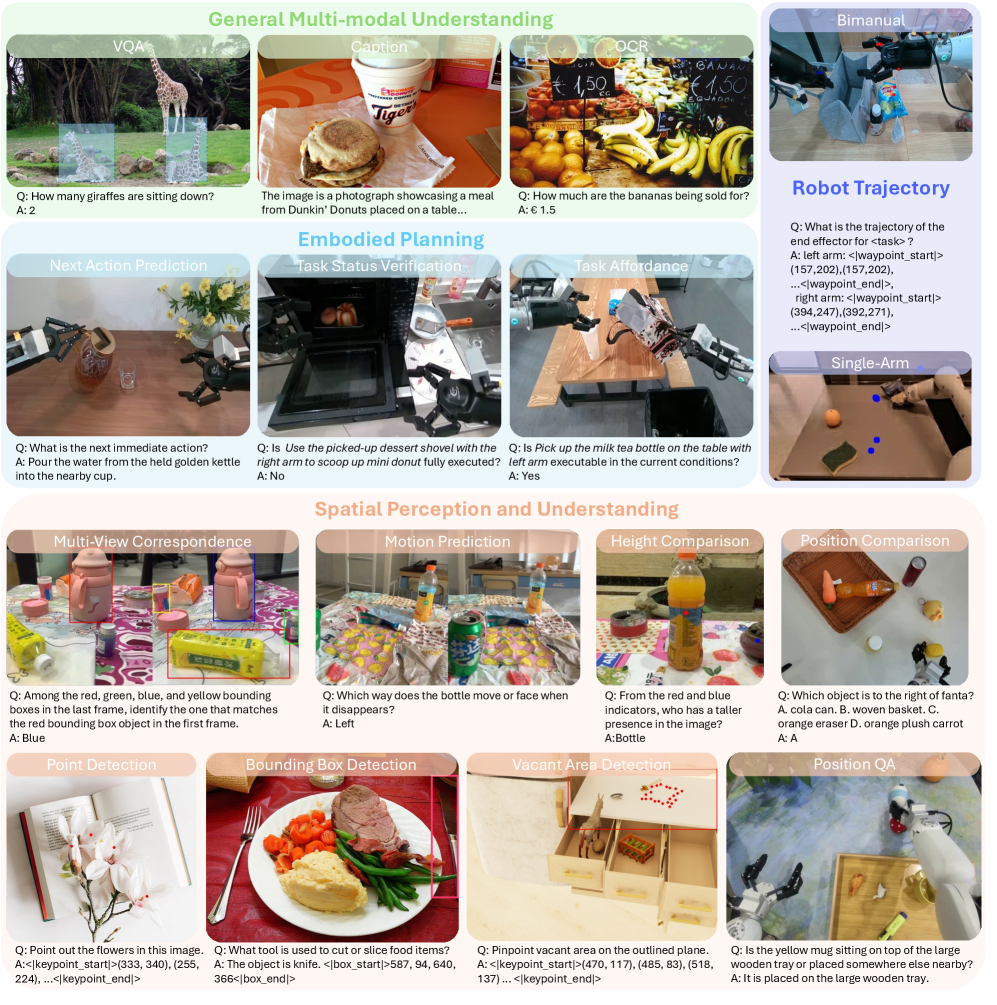

本文提出Lumo-1,一个通用的视觉-语言-动作(VLA)模型,旨在统一机器人推理(“思维”)与机器人动作(“手”)。该方法基于预训练视觉-语言模型(VLM)的通用多模态推理能力,逐步扩展到具身推理和动作预测,最终实现结构化推理和推理-动作对齐。该方法包含一个三阶段预训练流程:(1)在精选的视觉-语言数据上继续进行VLM预训练,以增强具身推理技能,如规划、空间理解和轨迹预测;(2)在跨具身机器人数据以及视觉-语言数据上进行联合训练;(3)在Astribot S1(一种具有类人灵巧性和敏捷性的双臂移动机械臂)上收集的轨迹上,使用推理过程进行动作训练。最后,集成强化学习以进一步完善推理-动作一致性,并闭合语义推理和运动控制之间的循环。大量实验表明,Lumo-1在具身视觉-语言推理方面取得了显著的性能提升,这是通用机器人控制的关键组成部分。真实世界的评估进一步表明,Lumo-1在各种具有挑战性的机器人任务中超越了强大的基线,并且对新颖的物体和环境具有很强的泛化能力,尤其擅长长时程任务,并能响应需要对策略、概念和空间进行推理的人类自然指令。

🔬 方法详解

问题定义:现有方法难以将AI系统的推理能力有效应用于物理世界的机器人控制。痛点在于如何将互联网规模数据训练的推理能力与机器人的具身感知和动作执行相结合,尤其是在长时程任务和复杂环境中。

核心思路:Lumo-1的核心思路是将预训练的视觉-语言模型(VLM)作为基础,通过逐步的预训练和强化学习,使其具备具身推理和动作执行能力。通过这种方式,可以利用VLM强大的推理能力,并将其迁移到机器人控制领域。这样设计的目的是为了克服从头开始训练机器人控制模型的困难,并提高模型的泛化能力。

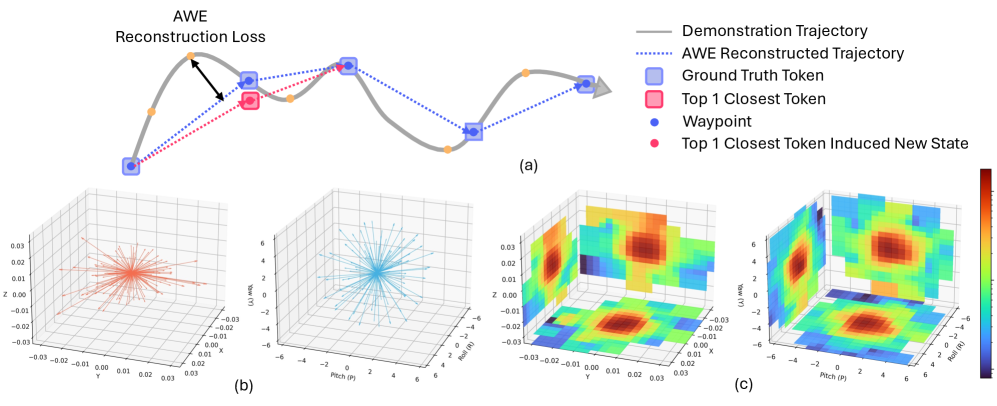

技术框架:Lumo-1的技术框架包含三个主要阶段: 1. VLM预训练增强:在精选的视觉-语言数据上继续预训练VLM,以增强其在规划、空间理解和轨迹预测等方面的具身推理能力。 2. 跨具身联合训练:在跨具身机器人数据以及视觉-语言数据上进行联合训练,使模型能够理解不同机器人的动作空间和感知特性。 3. 推理动作训练:在Astribot S1机器人上收集的轨迹上,使用推理过程进行动作训练,使模型能够根据推理结果生成相应的动作。 最后,使用强化学习来进一步优化推理-动作一致性,并闭合语义推理和运动控制之间的循环。

关键创新:Lumo-1的关键创新在于其三阶段预训练流程,该流程能够有效地将预训练VLM的推理能力迁移到机器人控制领域。与现有方法相比,Lumo-1能够更好地处理长时程任务和复杂环境,并能够响应人类自然指令。

关键设计:Lumo-1的关键设计包括: 1. 精选的视觉-语言数据集:用于增强VLM的具身推理能力。 2. 跨具身机器人数据集:用于使模型能够理解不同机器人的动作空间和感知特性。 3. 强化学习优化:用于进一步优化推理-动作一致性。

🖼️ 关键图片

📊 实验亮点

Lumo-1在具身视觉-语言推理方面取得了显著的性能提升,并在真实机器人任务中超越了现有基线。具体而言,Lumo-1在长时程任务和复杂环境中表现出色,并且能够响应人类自然指令。实验结果表明,Lumo-1对新颖的物体和环境具有很强的泛化能力,能够有效地完成各种具有挑战性的机器人任务。

🎯 应用场景

Lumo-1具有广泛的应用前景,包括智能家居、工业自动化、医疗辅助等领域。它可以用于控制机器人完成各种复杂任务,例如物品整理、装配、手术辅助等。该研究的实际价值在于提高了机器人的智能化水平和自主性,使其能够更好地服务于人类。未来,Lumo-1有望成为通用机器人控制的基础模型,推动机器人技术的发展。

📄 摘要(原文)

Humans act with context and intention, with reasoning playing a central role. While internet-scale data has enabled broad reasoning capabilities in AI systems, grounding these abilities in physical action remains a major challenge. We introduce Lumo-1, a generalist vision-language-action (VLA) model that unifies robot reasoning ("mind") with robot action ("hand"). Our approach builds upon the general multi-modal reasoning capabilities of pre-trained vision-language models (VLMs), progressively extending them to embodied reasoning and action prediction, and ultimately towards structured reasoning and reasoning-action alignment. This results in a three-stage pre-training pipeline: (1) Continued VLM pre-training on curated vision-language data to enhance embodied reasoning skills such as planning, spatial understanding, and trajectory prediction; (2) Co-training on cross-embodiment robot data alongside vision-language data; and (3) Action training with reasoning process on trajectories collected on Astribot S1, a bimanual mobile manipulator with human-like dexterity and agility. Finally, we integrate reinforcement learning to further refine reasoning-action consistency and close the loop between semantic inference and motor control. Extensive experiments demonstrate that Lumo-1 achieves significant performance improvements in embodied vision-language reasoning, a critical component for generalist robotic control. Real-world evaluations further show that Lumo-1 surpasses strong baselines across a wide range of challenging robotic tasks, with strong generalization to novel objects and environments, excelling particularly in long-horizon tasks and responding to human-natural instructions that require reasoning over strategy, concepts and space.