SensHRPS: Sensing Comfortable Human-Robot Proxemics and Personal Space With Eye-Tracking

作者: Nadezhda Kushina, Ko Watanabe, Aarthi Kannan, Ashita Ashok, Andreas Dengel, Karsten Berns

分类: cs.RO, cs.AI, cs.HC

发布日期: 2025-12-09 (更新: 2025-12-10)

💡 一句话要点

SensHRPS:利用眼动追踪感知舒适的人机近距离交互和个人空间

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人机交互 眼动追踪 舒适度评估 社交机器人 个人空间

📋 核心要点

- 现有方法难以准确评估人机交互中用户的舒适度,尤其是在近距离交互时,缺乏对生理指标的有效利用。

- 该研究利用眼动追踪技术,通过分析用户的注视特征,预测用户在与机器人互动时的舒适度,关注生理舒适度阈值。

- 实验结果表明,决策树分类器在预测舒适度方面表现最佳(F1-score = 0.73),最小瞳孔直径是最关键的预测指标。

📝 摘要(中文)

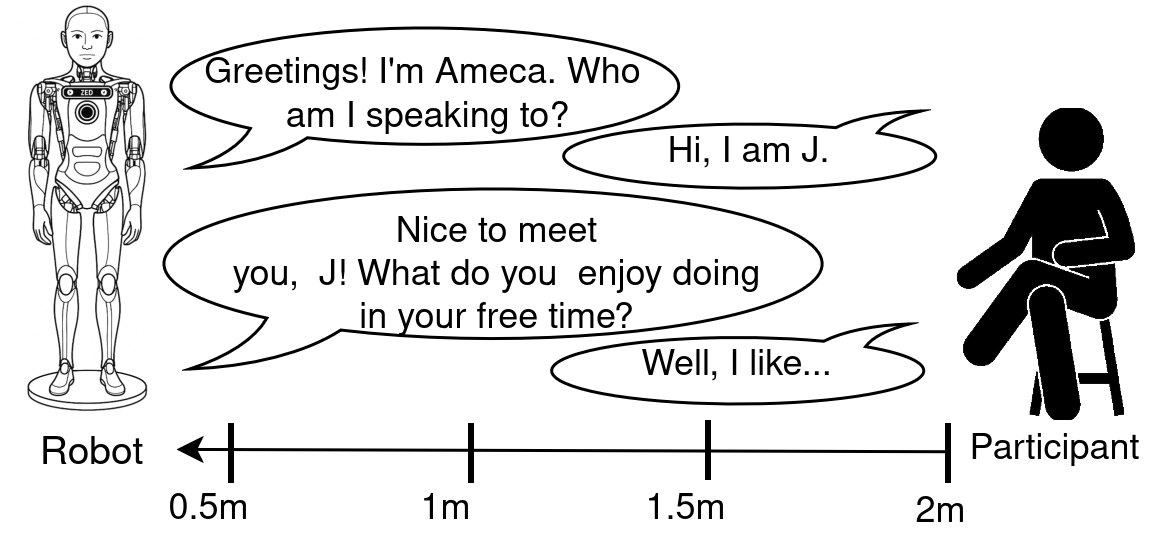

社交机器人必须适应人类的近距离规范,以确保用户的舒适度和参与度。虽然先前的研究表明,眼动追踪特征可以可靠地估计人际互动中的舒适度,但它们在与人形机器人互动中的适用性仍未得到探索。在本研究中,我们使用移动眼动追踪和主观报告(N=19),研究了用户在四种实验控制距离(0.5米至2.0米)下与机器人“Ameca”互动时的舒适度。我们评估了多种机器学习和深度学习模型,以根据注视特征估计舒适度。与之前Transformer模型表现出色的人际研究相反,决策树分类器取得了最高的性能(F1-score = 0.73),其中最小瞳孔直径被确定为最关键的预测指标。这些发现表明,人机交互中的生理舒适度阈值与人际动态不同,并且可以使用可解释的逻辑有效地建模。

🔬 方法详解

问题定义:论文旨在解决人机交互中,机器人如何感知并适应人类的个人空间和近距离规范,从而提升用户舒适度的问题。现有方法主要集中在人际互动的研究,缺乏对人机交互特性的考虑,难以准确评估用户在与机器人互动时的舒适程度。

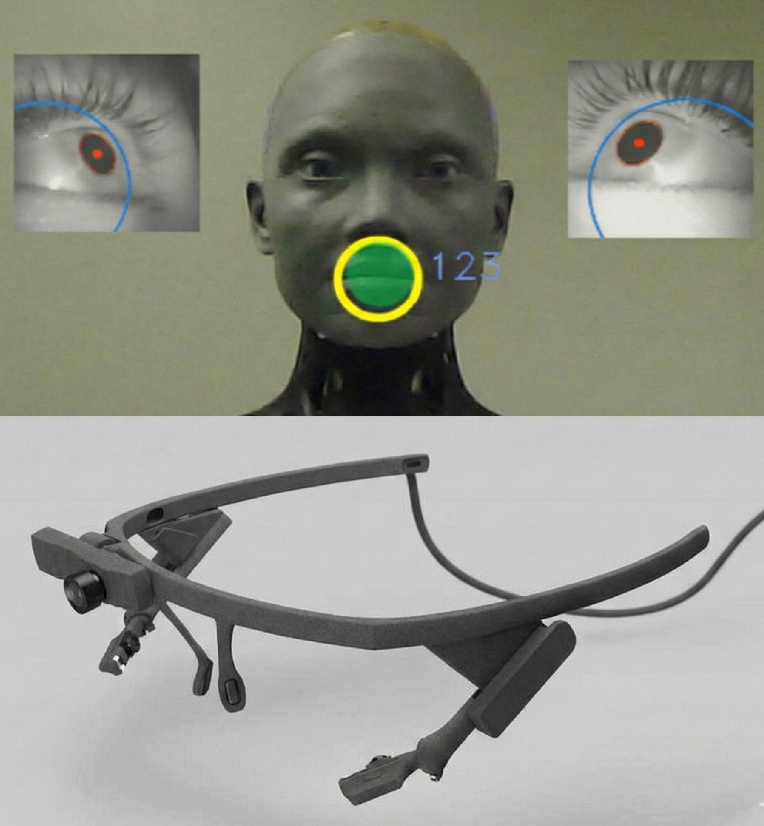

核心思路:论文的核心思路是利用眼动追踪技术,通过分析用户的注视行为和生理反应(如瞳孔直径),来推断用户在不同距离下与机器人互动时的舒适度。这种方法基于眼动数据能够反映个体的情绪和认知状态,从而为机器人提供感知用户舒适度的有效途径。

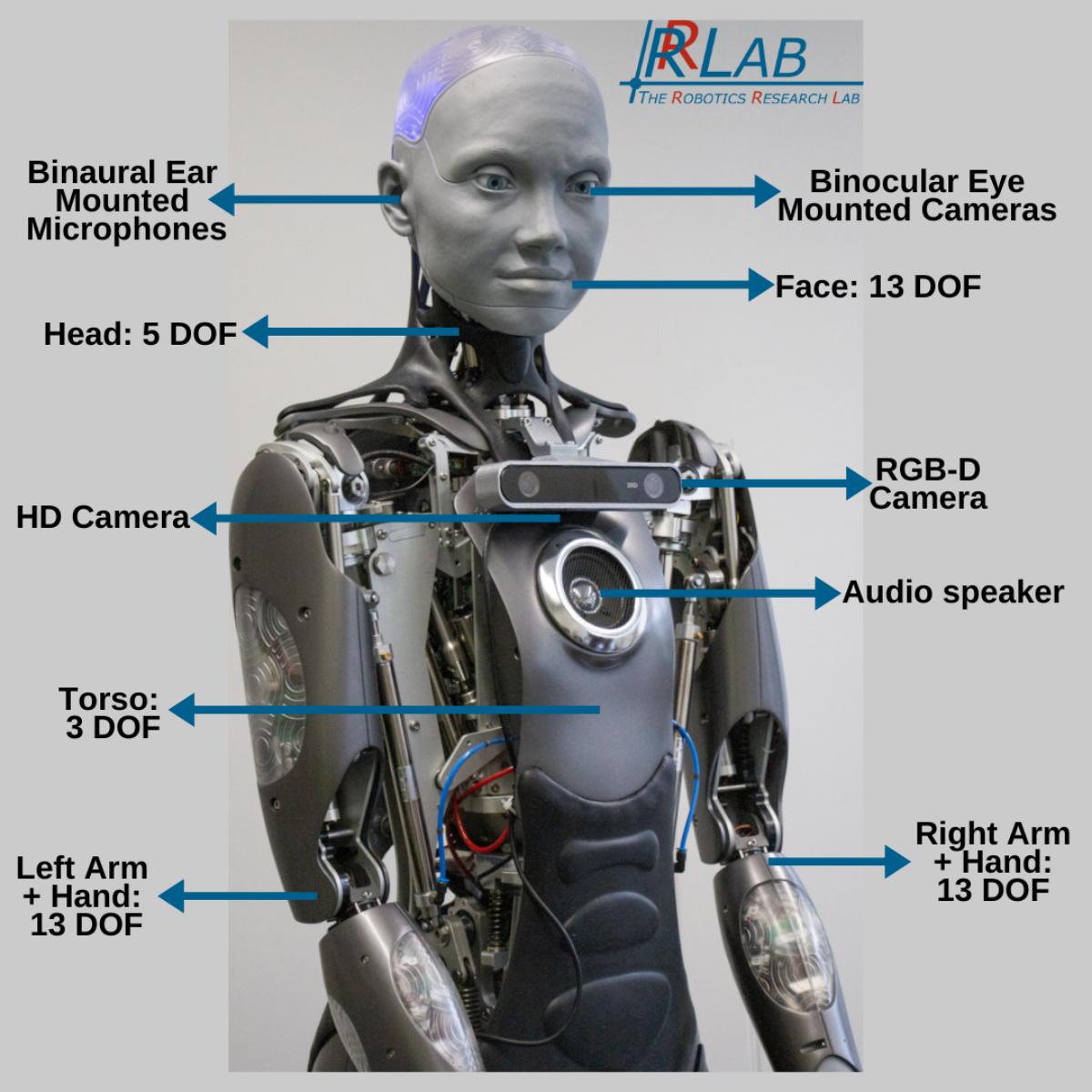

技术框架:整体框架包括数据采集和模型训练两个主要阶段。首先,通过移动眼动追踪设备收集用户在不同距离下与机器人Ameca互动时的眼动数据和主观舒适度报告。然后,利用这些数据训练多种机器学习和深度学习模型,包括决策树、Transformer等,以预测用户的舒适度。最后,评估不同模型的性能,并分析关键的眼动特征。

关键创新:该研究的关键创新在于将眼动追踪技术应用于人机交互舒适度评估,并发现人机交互中的舒适度阈值与人际互动存在差异。此外,研究结果表明,相比于在人际互动中表现优异的Transformer模型,决策树分类器在人机交互中表现更好,这表明人机交互的舒适度评估可能更依赖于可解释的逻辑。

关键设计:实验中控制了机器人与用户之间的距离(0.5m到2.0m),并使用移动眼动追踪设备记录用户的眼动数据,包括注视位置、注视时长、瞳孔直径等。同时,通过主观问卷收集用户对舒适度的自我评估。在模型训练方面,研究比较了多种机器学习和深度学习模型,并使用F1-score作为评估指标。最小瞳孔直径被确定为最重要的特征。

🖼️ 关键图片

📊 实验亮点

实验结果表明,决策树分类器在预测用户与机器人Ameca互动时的舒适度方面表现最佳,F1-score达到0.73。与以往人际互动研究中Transformer模型的优异表现不同,该研究发现最小瞳孔直径是预测人机交互舒适度的最关键指标,这表明人机交互与人际互动在舒适度感知方面存在差异。

🎯 应用场景

该研究成果可应用于各种人机交互场景,例如社交机器人、服务机器人、远程医疗和虚拟现实等。通过感知用户的舒适度,机器人可以动态调整其行为,例如调整距离、改变语调或提供个性化服务,从而提高用户的满意度和信任度。此外,该研究还可以为机器人设计提供指导,帮助开发者设计更符合人类需求的机器人。

📄 摘要(原文)

Social robots must adjust to human proxemic norms to ensure user comfort and engagement. While prior research demonstrates that eye-tracking features reliably estimate comfort in human-human interactions, their applicability to interactions with humanoid robots remains unexplored. In this study, we investigate user comfort with the robot "Ameca" across four experimentally controlled distances (0.5 m to 2.0 m) using mobile eye-tracking and subjective reporting (N=19). We evaluate multiple machine learning and deep learning models to estimate comfort based on gaze features. Contrary to previous human-human studies where Transformer models excelled, a Decision Tree classifier achieved the highest performance (F1-score = 0.73), with minimum pupil diameter identified as the most critical predictor. These findings suggest that physiological comfort thresholds in human-robot interaction differ from human-human dynamics and can be effectively modeled using interpretable logic.