Chat with UAV -- Human-UAV Interaction Based on Large Language Models

作者: Haoran Wang, Zhuohang Chen, Guang Li, Bo Ma, Chuanghuang Li

分类: cs.RO, cs.AI

发布日期: 2025-12-09

💡 一句话要点

提出基于双Agent的大语言模型人机交互框架,提升无人机任务执行灵活性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 无人机 大型语言模型 双Agent 任务规划

📋 核心要点

- 现有基于大语言模型的人机交互框架在混合任务规划和执行方面存在困难,导致复杂场景适应性低。

- 提出双Agent框架,分别由任务规划Agent和执行Agent组成,利用Prompt Engineering处理任务。

- 实验结果表明,该框架提高了人机交互的流畅性和任务执行的灵活性,满足用户个性化需求。

📝 摘要(中文)

未来无人机交互系统正从工程师驱动转向用户驱动,旨在取代传统预定义的人机交互设计。这种转变侧重于实现更个性化的任务规划和设计,从而获得更高质量的交互体验和更大的灵活性,可应用于农业、航空摄影、物流和环境监测等诸多领域。然而,由于用户和无人机之间缺乏通用语言,这种交互通常难以实现。大型语言模型的发展具备理解自然语言和机器人(无人机)行为的能力,标志着个性化人机交互的可能性。最近,一些基于LLM的HUI框架被提出,但它们通常难以处理混合任务的规划和执行,导致在复杂场景中的适应性较低。本文提出了一种新颖的双Agent HUI框架。该框架构建了两个独立的LLM Agent(任务规划Agent和执行Agent),并应用不同的Prompt Engineering分别处理任务的理解、规划和执行。为了验证该框架的有效性和性能,我们构建了一个涵盖无人机四个典型应用场景的任务数据库,并使用三个独立指标量化了HUI框架的性能。同时,选择了不同的LLM模型来控制无人机,并比较了性能。用户研究实验结果表明,该框架提高了HUI的流畅性和任务执行的灵活性,有效地满足了用户的个性化需求。

🔬 方法详解

问题定义:论文旨在解决现有基于大语言模型的人机交互框架在复杂场景下,混合任务规划和执行能力不足的问题。现有的框架难以灵活适应用户的个性化需求,导致交互体验不佳。

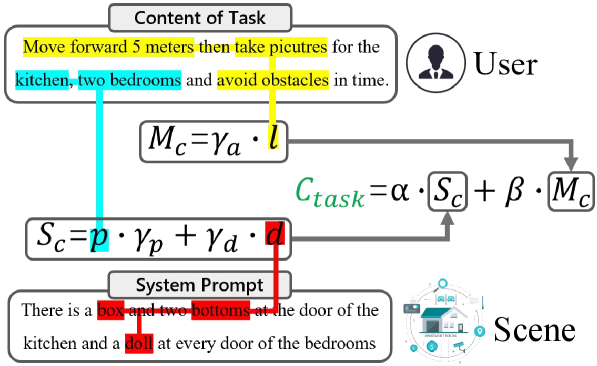

核心思路:论文的核心思路是将任务规划和执行解耦,分别由两个独立的LLM Agent负责。任务规划Agent负责理解用户意图并生成任务计划,执行Agent负责将任务计划转化为无人机的具体控制指令。这种解耦的设计可以提高系统的模块化程度和灵活性。

技术框架:该框架包含两个主要的Agent:任务规划Agent和执行Agent。用户输入自然语言指令后,任务规划Agent首先理解用户意图,然后根据场景知识和约束条件生成一个详细的任务计划。接着,执行Agent接收任务计划,并将其分解为一系列无人机可以执行的动作指令。最后,无人机执行这些指令完成任务。两个Agent之间通过结构化的数据进行通信。

关键创新:该论文的关键创新在于提出了双Agent的架构,将任务规划和执行分离。这种分离使得每个Agent可以专注于自己的任务,从而提高了整体系统的效率和鲁棒性。此外,论文还使用了Prompt Engineering来优化LLM的性能,使其更好地理解用户意图和生成合理的任务计划。

关键设计:论文的关键设计包括:1) 针对任务规划Agent和执行Agent设计了不同的Prompt模板,以引导LLM生成高质量的输出。2) 定义了Agent之间通信的数据格式,确保任务计划能够被正确地传递和解析。3) 选择了合适的LLM模型,并对其进行了微调,以提高其在无人机控制任务上的性能。(具体参数设置和损失函数未知)

🖼️ 关键图片

📊 实验亮点

论文构建了一个包含四个典型无人机应用场景的任务数据库,并使用三个独立指标量化了HUI框架的性能。实验结果表明,该框架提高了人机交互的流畅性和任务执行的灵活性,有效地满足了用户的个性化需求。同时,论文还比较了不同LLM模型控制无人机的性能,为实际应用中LLM模型的选择提供了参考。

🎯 应用场景

该研究成果可应用于多种无人机应用场景,例如农业植保、航空摄影、物流配送和环境监测等。通过自然语言交互,用户可以更方便地控制无人机完成各种任务,无需专业的编程知识。该研究有望推动无人机技术的普及和应用,并提升相关行业的效率和智能化水平。未来,该技术还可以扩展到其他机器人平台,实现更广泛的人机协作。

📄 摘要(原文)

The future of UAV interaction systems is evolving from engineer-driven to user-driven, aiming to replace traditional predefined Human-UAV Interaction designs. This shift focuses on enabling more personalized task planning and design, thereby achieving a higher quality of interaction experience and greater flexibility, which can be used in many fileds, such as agriculture, aerial photography, logistics, and environmental monitoring. However, due to the lack of a common language between users and the UAVs, such interactions are often difficult to be achieved. The developments of Large Language Models possess the ability to understand nature languages and Robots' (UAVs') behaviors, marking the possibility of personalized Human-UAV Interaction. Recently, some HUI frameworks based on LLMs have been proposed, but they commonly suffer from difficulties in mixed task planning and execution, leading to low adaptability in complex scenarios. In this paper, we propose a novel dual-agent HUI framework. This framework constructs two independent LLM agents (a task planning agent, and an execution agent) and applies different Prompt Engineering to separately handle the understanding, planning, and execution of tasks. To verify the effectiveness and performance of the framework, we have built a task database covering four typical application scenarios of UAVs and quantified the performance of the HUI framework using three independent metrics. Meanwhile different LLM models are selected to control the UAVs with compared performance. Our user study experimental results demonstrate that the framework improves the smoothness of HUI and the flexibility of task execution in the tasks scenario we set up, effectively meeting users' personalized needs.