Surrogate compliance modeling enables reinforcement learned locomotion gaits for soft robots

作者: Jue Wang, Mingsong Jiang, Luis A. Ramirez, Bilige Yang, Mujun Zhang, Esteban Figueroa, Wenzhong Yan, Rebecca Kramer-Bottiglio

分类: cs.RO, eess.SY

发布日期: 2025-12-08

💡 一句话要点

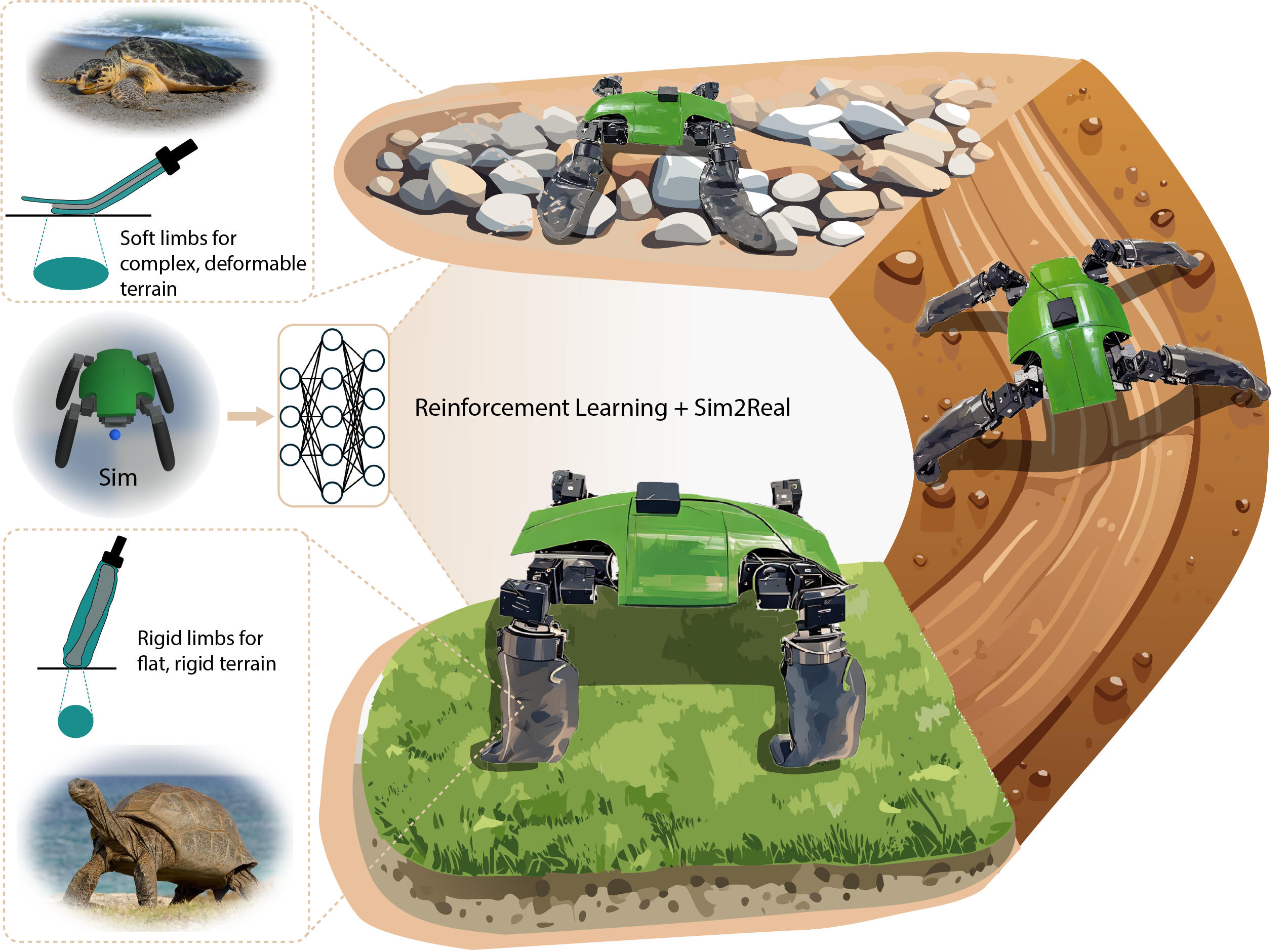

提出基于替代柔顺性建模的强化学习方法,实现软体机器人的稳健运动控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 软体机器人 强化学习 运动控制 Sim-to-Real 柔顺性建模

📋 核心要点

- 软体机器人因其形变能力在复杂环境中具有优势,但精确的软体动力学建模和控制仍面临挑战。

- 该论文提出一种替代柔顺性建模方法,通过在刚体仿真中引入间接变量来模拟软体变形,简化了仿真过程。

- 实验结果表明,该方法在两栖机器人上实现了有效的步态学习,并成功迁移到真实环境,显著降低了运动成本。

📝 摘要(中文)

本文提出了一种替代柔顺性建模方法,用于解决软体机器人运动控制中仿真和控制难题。该方法在刚体仿真器中引入间接变量来表示软材料的变形,而非显式地建模软体物理。通过将变形效应捕捉为有效肢体长度和肢体质心的变化,并结合强化学习和广泛的变量随机化,实现了完全在刚体仿真中进行可靠的策略学习。所学到的步态可以直接迁移到硬件,在坚硬、平坦的基质上表现出高保真度的sim-to-real性能,在流变复杂的地形上表现出稳健但较低保真度的迁移。与开环基线相比,所学习的闭环步态表现出前所未有的陆地机动性,并实现了成本运输降低一个数量级。现场实验进一步证明了该机器人在砾石、草地和泥地等多种自然地形上的稳定、多步态运动。

🔬 方法详解

问题定义:软体机器人的运动控制面临的主要问题是精确建模的困难。传统的软体仿真计算成本高昂且精度有限,而刚体仿真无法捕捉软材料的动态特性。这导致难以在仿真环境中训练有效的控制策略,并将其成功迁移到真实世界。

核心思路:该论文的核心思路是使用“替代柔顺性建模”来规避直接的软体动力学建模。通过在刚体仿真中引入间接变量,例如肢体长度和质心的变化,来近似表示软体材料的变形效应。这种方法允许在计算效率更高的刚体仿真环境中进行策略学习。

技术框架:整体框架包括以下几个主要阶段:1) 使用刚体仿真器搭建机器人模型;2) 引入间接变量来表示软体部件的变形,例如肢体长度和质心的偏移;3) 使用强化学习算法(具体算法未知)训练控制策略,同时对间接变量进行广泛的随机化,以提高策略的鲁棒性;4) 将学习到的策略迁移到真实机器人硬件上进行验证。

关键创新:该方法最重要的创新在于使用间接变量来替代显式的软体动力学建模。这种方法极大地简化了仿真过程,使得可以使用计算效率更高的刚体仿真器进行策略学习。通过对间接变量进行随机化,提高了策略对真实世界中各种不确定性的适应能力,从而实现了更好的sim-to-real迁移。

关键设计:论文中关键的设计包括:1) 选择合适的间接变量来表示软体变形,例如肢体长度和质心的变化;2) 设计合理的随机化策略,以覆盖间接变量的可能取值范围,提高策略的鲁棒性;3) 使用合适的强化学习算法(具体算法未知)来训练控制策略,并优化奖励函数以鼓励期望的行为。

🖼️ 关键图片

📊 实验亮点

该研究在两栖机器人上进行了验证,结果表明,所学习的步态可以直接迁移到硬件,在坚硬、平坦的基质上表现出高保真度的sim-to-real性能,在流变复杂的地形上表现出稳健的迁移。与开环基线相比,所学习的闭环步态实现了成本运输降低一个数量级,并展示了在砾石、草地和泥地等多种自然地形上的稳定运动。

🎯 应用场景

该研究成果可应用于各种软体机器人的运动控制,尤其是在复杂地形或环境中作业的机器人。例如,可用于搜索救援、环境监测、农业机器人等领域。该方法降低了软体机器人控制策略开发的难度和成本,加速了软体机器人在实际应用中的部署。

📄 摘要(原文)

Adaptive morphogenetic robots adapt their morphology and control policies to meet changing tasks and environmental conditions. Many such systems leverage soft components, which enable shape morphing but also introduce simulation and control challenges. Soft-body simulators remain limited in accuracy and computational tractability, while rigid-body simulators cannot capture soft-material dynamics. Here, we present a surrogate compliance modeling approach: rather than explicitly modeling soft-body physics, we introduce indirect variables representing soft-material deformation within a rigid-body simulator. We validate this approach using our amphibious robotic turtle, a quadruped with soft morphing limbs designed for multi-environment locomotion. By capturing deformation effects as changes in effective limb length and limb center of mass, and by applying reinforcement learning with extensive randomization of these indirect variables, we achieve reliable policy learning entirely in a rigid-body simulation. The resulting gaits transfer directly to hardware, demonstrating high-fidelity sim-to-real performance on hard, flat substrates and robust, though lower-fidelity, transfer on rheologically complex terrains. The learned closed-loop gaits exhibit unprecedented terrestrial maneuverability and achieve an order-of-magnitude reduction in cost of transport compared to open-loop baselines. Field experiments with the robot further demonstrate stable, multi-gait locomotion across diverse natural terrains, including gravel, grass, and mud.