CERNet: Class-Embedding Predictive-Coding RNN for Unified Robot Motion, Recognition, and Confidence Estimation

作者: Hiroki Sawada, Alexandre Pitti, Mathias Quoy

分类: cs.RO

发布日期: 2025-12-07

💡 一句话要点

CERNet:用于统一机器人运动、识别和置信度估计的类嵌入预测编码RNN

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人运动控制 行为识别 置信度估计 预测编码 循环神经网络

📋 核心要点

- 现有机器人难以在实时生成运动的同时,推断观察到的行为意图并评估自身推理的置信度。

- CERNet通过动态更新的类嵌入向量,将运动生成和识别统一在分层预测编码循环神经网络中。

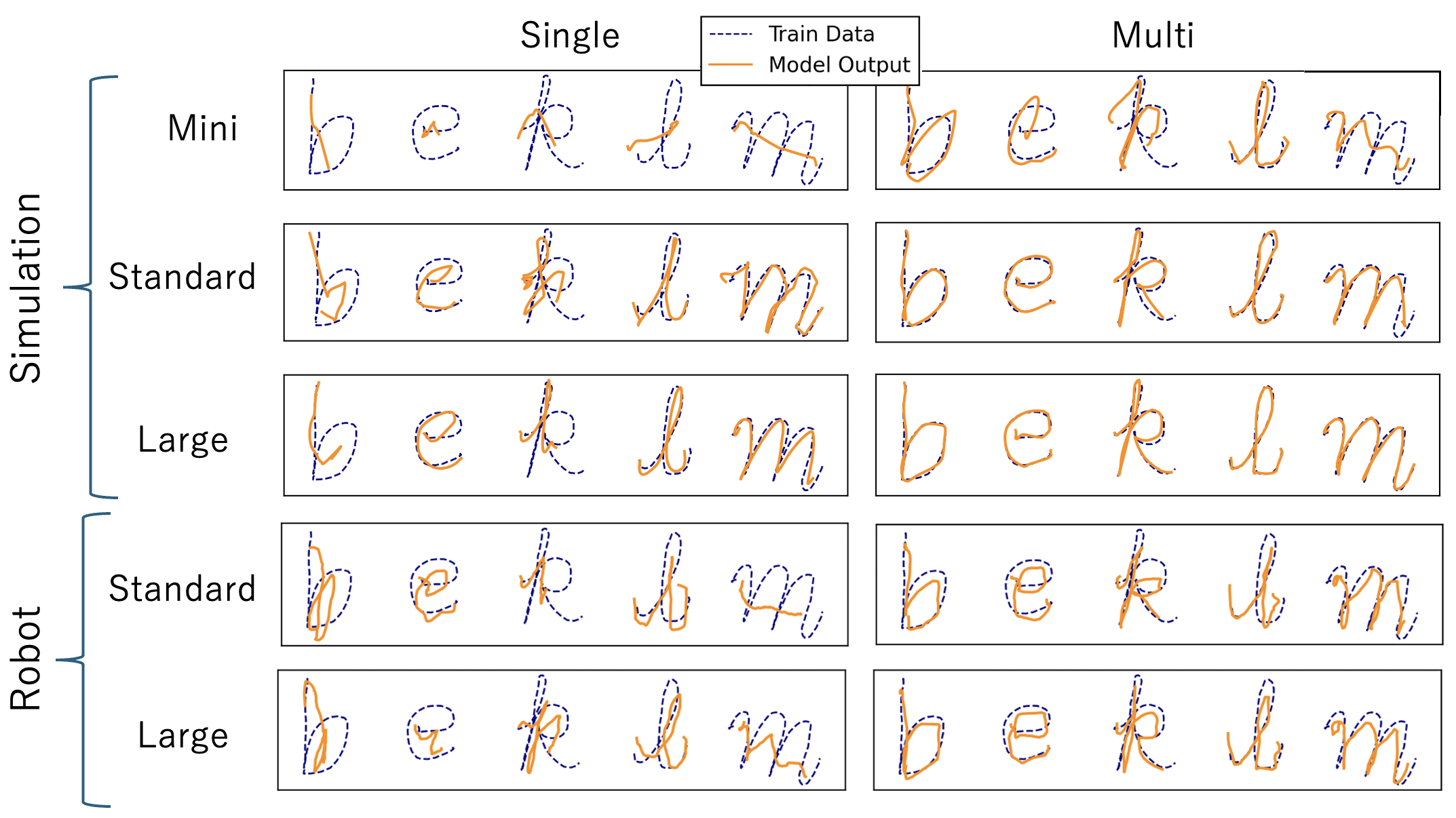

- 实验表明,CERNet在轨迹再现误差、运动保真度和在线轨迹分类准确率方面均优于基线模型。

📝 摘要(中文)

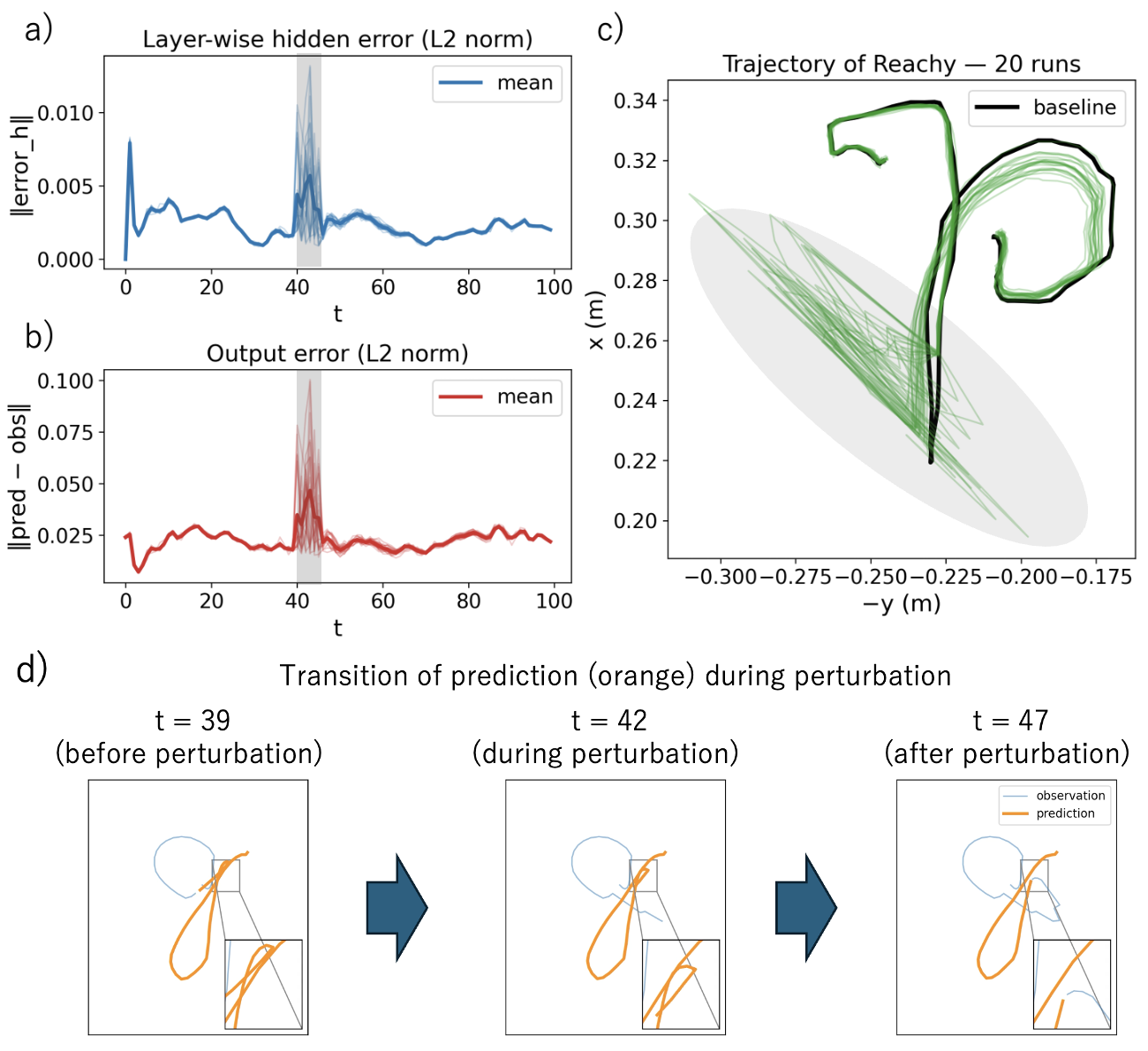

本文提出了一种统一的模型CERNet,它是一个配备类嵌入向量的分层预测编码循环神经网络(PC-RNN),能够在单个框架内实现机器人运动生成、行为意图推断和置信度估计。该模型利用动态更新的类嵌入向量来统一运动生成和识别,并在生成和推理两种模式下运行。在生成模式下,类嵌入将隐藏状态的动态约束到特定于类的子空间;在推理模式下,它被在线优化以最小化预测误差,从而实现实时识别。在人形机器人上对26个动觉示教字母的验证表明,我们的分层模型比参数匹配的单层基线降低了76%的轨迹再现误差,在外部扰动下保持了运动保真度,并以68%的Top-1和81%的Top-2准确率在线推断演示轨迹类别。此外,内部预测误差自然地反映了模型对其识别的置信度。这种在紧凑的PC-RNN框架内集成了鲁棒生成、实时识别和内在不确定性估计的方法,为物理机器人中的运动记忆提供了一种紧凑且可扩展的方法,在对意图敏感的人机协作中具有潜在的应用。

🔬 方法详解

问题定义:现有机器人运动控制方法通常难以同时兼顾运动生成、行为识别和置信度估计。传统的运动生成模型缺乏对环境和意图的感知能力,而行为识别模型则难以与运动控制系统集成。此外,机器人难以评估自身行为识别的置信度,这限制了其在复杂环境中的应用。

核心思路:本文的核心思路是利用预测编码循环神经网络(PC-RNN)的特性,通过引入类嵌入向量,将运动生成和行为识别统一到一个框架中。类嵌入向量可以动态地表示当前的行为类别,并用于约束PC-RNN的隐藏状态,从而实现特定于类的运动生成和识别。通过优化类嵌入向量以最小化预测误差,可以实现实时的行为识别,并且预测误差的大小可以反映模型对识别结果的置信度。

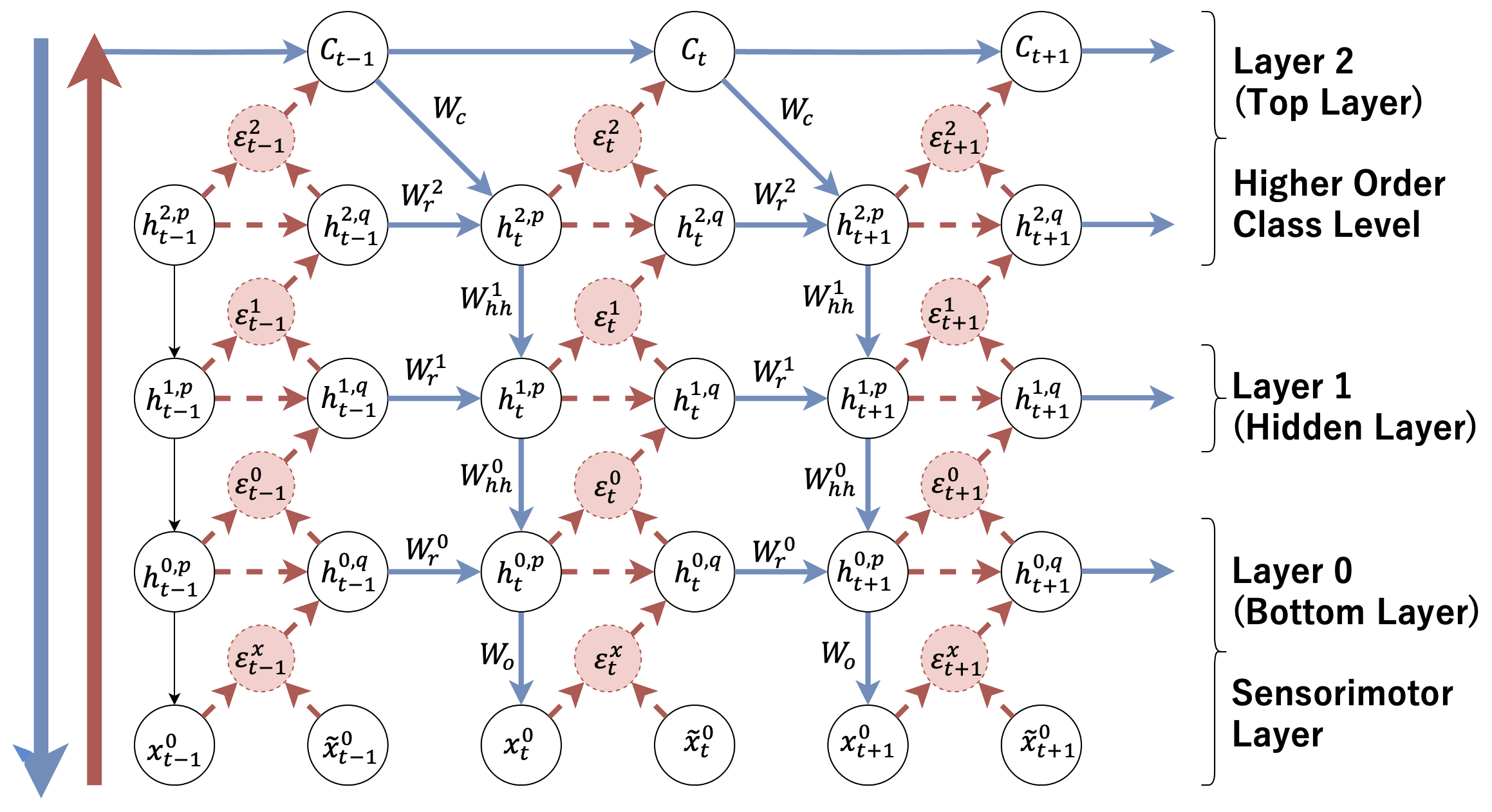

技术框架:CERNet的整体架构是一个分层的PC-RNN,包含多个层级的循环神经网络。每一层都接收来自上一层的预测和观测,并生成自身的预测和误差信号。类嵌入向量被引入到网络的顶层,用于约束顶层隐藏状态的动态。模型在两种模式下运行:生成模式和推理模式。在生成模式下,类嵌入向量被预先设定,网络根据该类别的运动模式生成轨迹。在推理模式下,类嵌入向量被在线优化,以最小化预测误差,从而实现实时的行为识别。

关键创新:CERNet的关键创新在于将类嵌入向量引入到PC-RNN中,从而实现了运动生成和行为识别的统一。这种方法不仅可以提高运动生成的鲁棒性和准确性,还可以实现实时的行为识别和置信度估计。此外,分层结构的设计使得模型可以学习到不同层级的运动模式,从而提高了模型的泛化能力。

关键设计:类嵌入向量的维度是一个重要的参数,需要根据具体的任务进行调整。损失函数包括预测误差和类嵌入向量的正则化项,用于防止过拟合。网络结构的选择也需要根据任务的复杂程度进行调整。实验中,作者使用了GRU作为循环神经网络的单元,并采用了Adam优化器进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CERNet在人形机器人上对26个动觉示教字母的轨迹再现误差比参数匹配的单层基线降低了76%,在外部扰动下保持了运动保真度,并以68%的Top-1和81%的Top-2准确率在线推断演示轨迹类别。内部预测误差能够自然地反映模型对其识别的置信度。

🎯 应用场景

CERNet在人机协作、康复机器人、自主导航等领域具有广泛的应用前景。例如,在人机协作中,机器人可以根据人类的动作意图,生成相应的运动轨迹,并评估自身行为识别的置信度,从而实现更加安全和高效的协作。在康复机器人中,CERNet可以用于辅助患者进行康复训练,并根据患者的运动情况,实时调整训练方案。在自主导航中,机器人可以利用CERNet识别环境中的物体和行为,从而实现更加智能和安全的导航。

📄 摘要(原文)

Robots interacting with humans must not only generate learned movements in real-time, but also infer the intent behind observed behaviors and estimate the confidence of their own inferences. This paper proposes a unified model that achieves all three capabilities within a single hierarchical predictive-coding recurrent neural network (PC-RNN) equipped with a class embedding vector, CERNet, which leverages a dynamically updated class embedding vector to unify motor generation and recognition. The model operates in two modes: generation and inference. In the generation mode, the class embedding constrains the hidden state dynamics to a class-specific subspace; in the inference mode, it is optimized online to minimize prediction error, enabling real-time recognition. Validated on a humanoid robot across 26 kinesthetically taught alphabets, our hierarchical model achieves 76% lower trajectory reproduction error than a parameter-matched single-layer baseline, maintains motion fidelity under external perturbations, and infers the demonstrated trajectory class online with 68% Top-1 and 81% Top-2 accuracy. Furthermore, internal prediction errors naturally reflect the model's confidence in its recognition. This integration of robust generation, real-time recognition, and intrinsic uncertainty estimation within a compact PC-RNN framework offers a compact and extensible approach to motor memory in physical robots, with potential applications in intent-sensitive human-robot collaboration.