Vision-Guided Grasp Planning for Prosthetic Hands in Unstructured Environments

作者: Shifa Sulaiman, Akash Bachhar, Ming Shen, Simon Bøgh

分类: cs.RO

发布日期: 2025-12-06

💡 一句话要点

提出一种视觉引导的假肢手抓取规划算法,用于非结构化环境下的灵巧操作。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 假肢手 抓取规划 视觉引导 RRT*算法 逆运动学 非结构化环境

📋 核心要点

- 现有假肢技术在动态环境中与多样化对象交互时,灵活性和自主性不足,面临挑战。

- 该论文提出一种视觉引导的抓取算法,通过感知、规划和控制的集成,提升假肢手的灵巧操作能力。

- 该方法在仿真环境中验证,并在Linker Hand O7平台上进行了实验集成,证明了其可行性。

📝 摘要(中文)

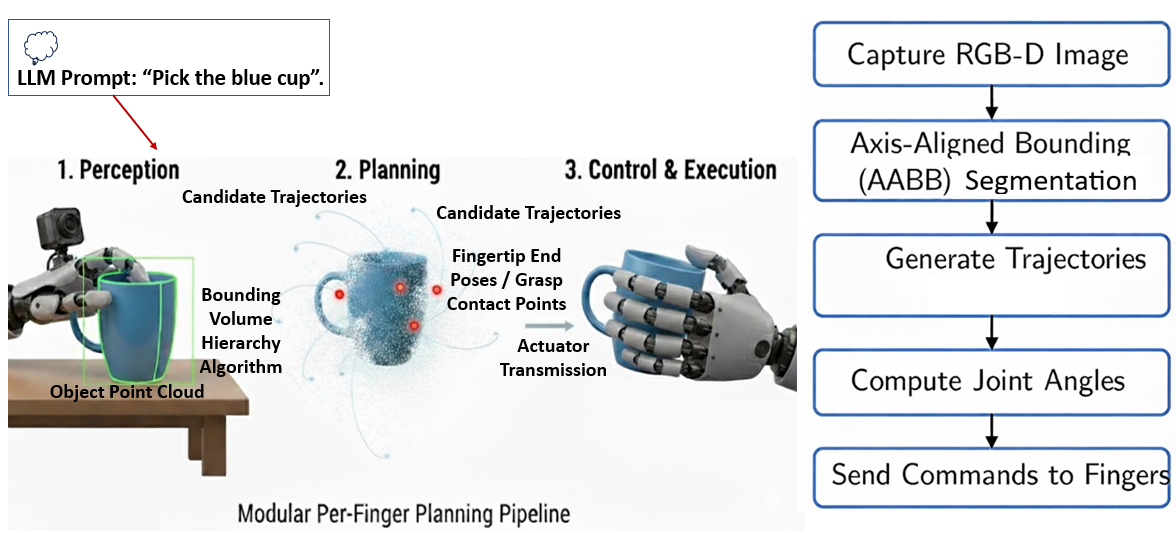

本文提出了一种视觉引导的假肢手抓取算法,旨在通过集成感知、规划和控制来实现灵巧操作。该方法利用安装在设备上的摄像头捕获场景,并采用基于边界体积层次(BVH)的视觉算法来分割目标对象并定义其边界框。然后,通过使用Rapidly-exploring Random Tree Star算法生成候选轨迹,并基于这些轨迹与对象点云之间的最小欧几里得距离选择指尖末端姿态,从而计算抓取接触点。每个手指的抓取姿态都是独立确定的,从而实现自适应的、特定于对象的配置。采用基于阻尼最小二乘(DLS)的逆运动学求解器来计算相应的关节角度,随后将其传输到手指执行器以执行。这种模块化流程能够实现每个手指的抓取规划,并支持在非结构化环境中的实时适应性。该方法已在仿真中得到验证,并在Linker Hand O7平台上进行了实验集成。

🔬 方法详解

问题定义:现有假肢手在非结构化环境中进行抓取时,难以准确感知目标物体,并规划出合适的抓取姿态。传统方法通常依赖于预定义的抓取策略或人工示教,泛化能力较差,难以适应复杂多变的环境。因此,需要一种能够自主感知环境并规划抓取的智能算法。

核心思路:该论文的核心思路是利用视觉信息引导假肢手的抓取规划。通过摄像头获取环境图像,分割出目标物体,并基于物体的几何信息规划手指的抓取姿态。每个手指的抓取姿态独立规划,从而实现对不同形状物体的自适应抓取。

技术框架:该方法包含以下主要模块:1) 视觉感知模块:使用摄像头捕获场景图像,并采用基于BVH的算法分割目标物体,得到物体的边界框和点云数据。2) 抓取规划模块:使用RRT*算法生成候选抓取轨迹,并根据轨迹与物体点云的距离选择最佳抓取点。每个手指的抓取姿态独立规划。3) 逆运动学求解模块:使用DLS方法求解假肢手的关节角度,将规划的抓取姿态转换为关节控制指令。4) 控制执行模块:将关节控制指令发送给假肢手的执行器,控制手指运动,完成抓取动作。

关键创新:该方法最重要的创新点在于实现了基于视觉信息的 per-finger 抓取规划。与传统方法相比,该方法能够根据物体的形状和姿态,独立规划每个手指的抓取姿态,从而实现更灵活、更稳定的抓取。此外,该方法采用RRT*算法进行抓取轨迹规划,能够有效地搜索抓取空间,找到最优的抓取姿态。

关键设计:在抓取规划模块中,使用RRT*算法生成候选抓取轨迹时,需要设置合适的采样策略和代价函数。采样策略影响搜索效率,代价函数影响抓取姿态的质量。论文中可能使用了启发式的采样策略,并设计了考虑抓取稳定性和可达性的代价函数。DLS逆运动学求解器中的阻尼系数是一个关键参数,需要根据假肢手的运动学特性进行调整,以避免关节越界和奇异性问题。

🖼️ 关键图片

📊 实验亮点

论文在仿真环境中验证了该方法的有效性,并在Linker Hand O7平台上进行了实验集成。实验结果表明,该方法能够成功抓取不同形状的物体,并具有较好的鲁棒性和适应性。具体的性能数据(如抓取成功率、抓取时间等)未知,但实验结果证明了该方法在实际应用中的潜力。

🎯 应用场景

该研究成果可应用于智能假肢、机器人抓取等领域。通过视觉引导的抓取规划,假肢手可以更好地适应非结构化环境,完成日常生活中的各种任务,提高残疾人的生活质量。此外,该方法还可以应用于工业机器人,实现自动化装配、物料搬运等任务,提高生产效率。

📄 摘要(原文)

Recent advancements in prosthetic technology have increasingly focused on enhancing dexterity and autonomy through intelligent control systems. Vision-based approaches offer promising results for enabling prosthetic hands to interact more naturally with diverse objects in dynamic environments. Building on this foundation, the paper presents a vision-guided grasping algorithm for a prosthetic hand, integrating perception, planning, and control for dexterous manipulation. A camera mounted on the set up captures the scene, and a Bounding Volume Hierarchy (BVH)-based vision algorithm is employed to segment an object for grasping and define its bounding box. Grasp contact points are then computed by generating candidate trajectories using Rapidly-exploring Random Tree Star algorithm, and selecting fingertip end poses based on the minimum Euclidean distance between these trajectories and the objects point cloud. Each finger grasp pose is determined independently, enabling adaptive, object-specific configurations. Damped Least Square (DLS) based Inverse kinematics solver is used to compute the corresponding joint angles, which are subsequently transmitted to the finger actuators for execution. This modular pipeline enables per-finger grasp planning and supports real-time adaptability in unstructured environments. The proposed method is validated in simulation, and experimental integration on a Linker Hand O7 platform.