GuideNav: User-Informed Development of a Vision-Only Robotic Navigation Assistant For Blind Travelers

作者: Hochul Hwang, Soowan Yang, Jahir Sadik Monon, Nicholas A Giudice, Sunghoon Ivan Lee, Joydeep Biswas, Donghyun Kim

分类: cs.RO, cs.CV, cs.HC

发布日期: 2025-12-05

💡 一句话要点

GuideNav:面向视障人士的纯视觉机器人导航辅助系统,通过用户研究指导开发。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 机器人导航 视觉导航 盲人辅助 示教-重复 拓扑地图

📋 核心要点

- 现有盲人辅助导航系统缺乏以用户为中心的设计,难以满足实际需求,且依赖昂贵传感器。

- GuideNav通过深入的用户调研,模仿导盲犬的工作方式,构建纯视觉的示教-重复导航系统。

- 实验表明,GuideNav能够在多种户外环境中实现公里级的可靠导航,用户研究也验证了其可行性。

📝 摘要(中文)

针对盲人和低视力(BLV)人群的移动辅助系统,虽然在以用户为中心的研究方面取得了显著进展,但直接指导机器人导航设计的参考仍然很少。为了弥合这一差距,我们进行了一项综合的人类研究,包括对26名导盲犬使用者、4名盲杖使用者、9名导盲犬训练员和1名定向与行动训练员的访谈,以及超过15小时的导盲犬辅助行走观察。经过匿名化处理后,我们开源了该数据集,以促进以人为本的开发,并为BLV人群辅助系统的知情决策提供依据。基于这项形成性研究的见解,我们开发了GuideNav,一种纯视觉的、示教-重复导航系统。受导盲犬的训练和辅助方式的启发,GuideNav使用机器人自主地重复由视力正常的人演示的路径。具体来说,该系统构建了示教路线的拓扑表示,将视觉位置识别与时间滤波相结合,并采用相对姿态估计器来计算导航动作——所有这些都不依赖于昂贵、笨重、耗电的传感器,如激光雷达。在现场测试中,GuideNav在五个户外环境中始终如一地实现了公里级的路线跟踪,即使在示教和重复运行之间存在明显的场景变化,也能保持可靠性。一项针对3名导盲犬使用者和1名导盲犬训练员的用户研究进一步证实了该系统的可行性,这标志着(据我们所知)首次展示了四足移动系统以类似于导盲犬的方式检索路径。

🔬 方法详解

问题定义:现有盲人辅助导航系统通常依赖于激光雷达等昂贵且耗电的传感器,限制了其便携性和易用性。此外,这些系统在设计时往往缺乏对用户需求的深入理解,导致实际应用效果不佳。因此,需要开发一种低成本、易于使用且真正满足盲人用户需求的导航辅助系统。

核心思路:GuideNav的核心思路是模仿导盲犬的工作方式,通过“示教-重复”的方式进行导航。首先,由视力正常的人演示一遍路线,机器人学习并记住该路线。然后,机器人自主地重复该路线,为盲人用户提供导航辅助。这种方法无需复杂的地图构建和定位算法,降低了系统的复杂性和成本。

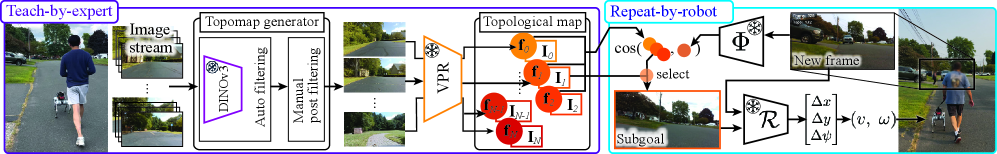

技术框架:GuideNav的整体框架包括以下几个主要模块:1) 路线示教模块:由视力正常的人引导机器人行走一遍路线,机器人记录视觉信息。2) 拓扑地图构建模块:根据记录的视觉信息,构建路线的拓扑表示。3) 视觉位置识别模块:在重复导航过程中,识别当前位置与拓扑地图中的节点之间的对应关系。4) 时间滤波模块:对视觉位置识别结果进行时间滤波,提高识别的鲁棒性。5) 相对姿态估计模块:根据视觉位置识别结果,估计机器人相对于目标位置的姿态。6) 导航控制模块:根据相对姿态估计结果,控制机器人进行导航。

关键创新:GuideNav的关键创新在于其纯视觉的导航方式和模仿导盲犬的导航策略。与传统的依赖激光雷达等传感器的导航系统不同,GuideNav仅使用摄像头进行导航,降低了成本和功耗。此外,GuideNav通过模仿导盲犬的导航策略,更好地满足了盲人用户的需求。

关键设计:GuideNav的关键设计包括:1) 拓扑地图的构建方式:使用视觉里程计和关键帧选择算法构建拓扑地图,保证地图的准确性和紧凑性。2) 视觉位置识别算法:使用深度学习方法提取图像特征,并使用相似度匹配算法进行位置识别。3) 时间滤波算法:使用卡尔曼滤波对视觉位置识别结果进行平滑处理,提高识别的鲁棒性。4) 相对姿态估计算法:使用PnP算法估计机器人相对于目标位置的姿态。

🖼️ 关键图片

📊 实验亮点

GuideNav在五个户外环境中进行了公里级的路线跟踪测试,即使在示教和重复运行之间存在明显的场景变化,也能保持可靠性。与传统的基于激光雷达的导航系统相比,GuideNav在成本和功耗方面具有显著优势。用户研究表明,GuideNav能够以类似于导盲犬的方式检索路径,验证了其可行性和有效性。

🎯 应用场景

GuideNav具有广泛的应用前景,可用于盲人导航、室内机器人导航、物流配送等领域。该系统能够帮助盲人更加安全、自主地出行,提高生活质量。在室内环境中,GuideNav可以用于引导机器人在仓库、工厂等场所进行导航。此外,该系统还可以应用于物流配送领域,实现无人配送。

📄 摘要(原文)

While commendable progress has been made in user-centric research on mobile assistive systems for blind and low-vision (BLV) individuals, references that directly inform robot navigation design remain rare. To bridge this gap, we conducted a comprehensive human study involving interviews with 26 guide dog handlers, four white cane users, nine guide dog trainers, and one O\&M trainer, along with 15+ hours of observing guide dog-assisted walking. After de-identification, we open-sourced the dataset to promote human-centered development and informed decision-making for assistive systems for BLV people. Building on insights from this formative study, we developed GuideNav, a vision-only, teach-and-repeat navigation system. Inspired by how guide dogs are trained and assist their handlers, GuideNav autonomously repeats a path demonstrated by a sighted person using a robot. Specifically, the system constructs a topological representation of the taught route, integrates visual place recognition with temporal filtering, and employs a relative pose estimator to compute navigation actions - all without relying on costly, heavy, power-hungry sensors such as LiDAR. In field tests, GuideNav consistently achieved kilometer-scale route following across five outdoor environments, maintaining reliability despite noticeable scene variations between teach and repeat runs. A user study with 3 guide dog handlers and 1 guide dog trainer further confirmed the system's feasibility, marking (to our knowledge) the first demonstration of a quadruped mobile system retrieving a path in a manner comparable to guide dogs.