Two-Stage Camera Calibration Method for Multi-Camera Systems Using Scene Geometry

作者: Aleksandr Abramov

分类: eess.IV, cs.RO

发布日期: 2025-12-04

💡 一句话要点

提出一种基于场景几何的多相机系统两阶段标定方法,无需精确场景信息。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 多相机标定 场景几何 两阶段标定 交互式标定 相机位姿估计

📋 核心要点

- 传统多相机标定方法依赖精确场景信息或同步视频,在实际部署中面临诸多限制。

- 该方法通过两阶段标定,首先利用场景几何信息进行单相机部分标定,然后交互式调整相机视场完成系统标定。

- 实验结果表明,该方法具有良好的适用性、准确性和灵活性,可在复杂场景下实现精确的多相机跟踪。

📝 摘要(中文)

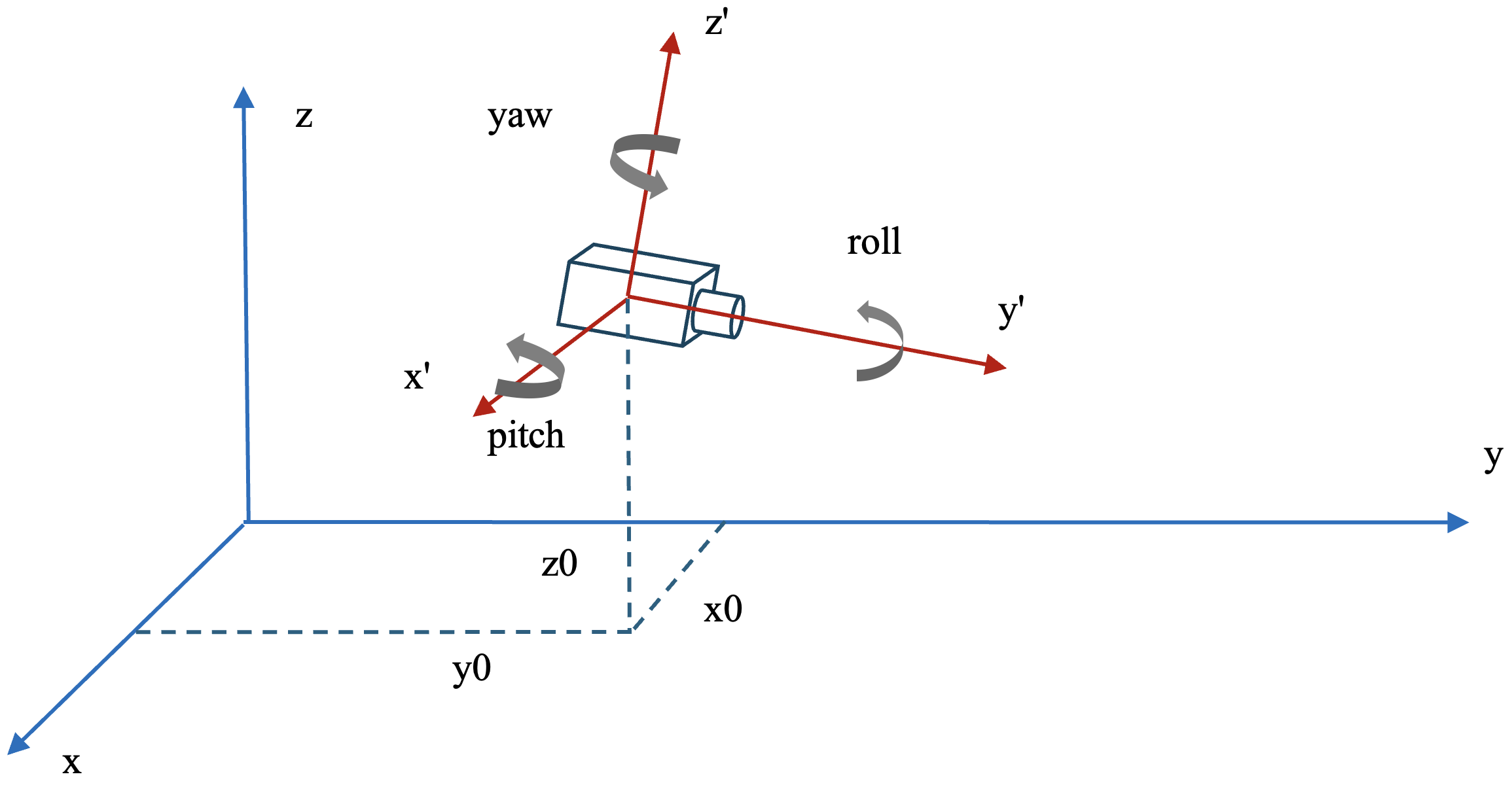

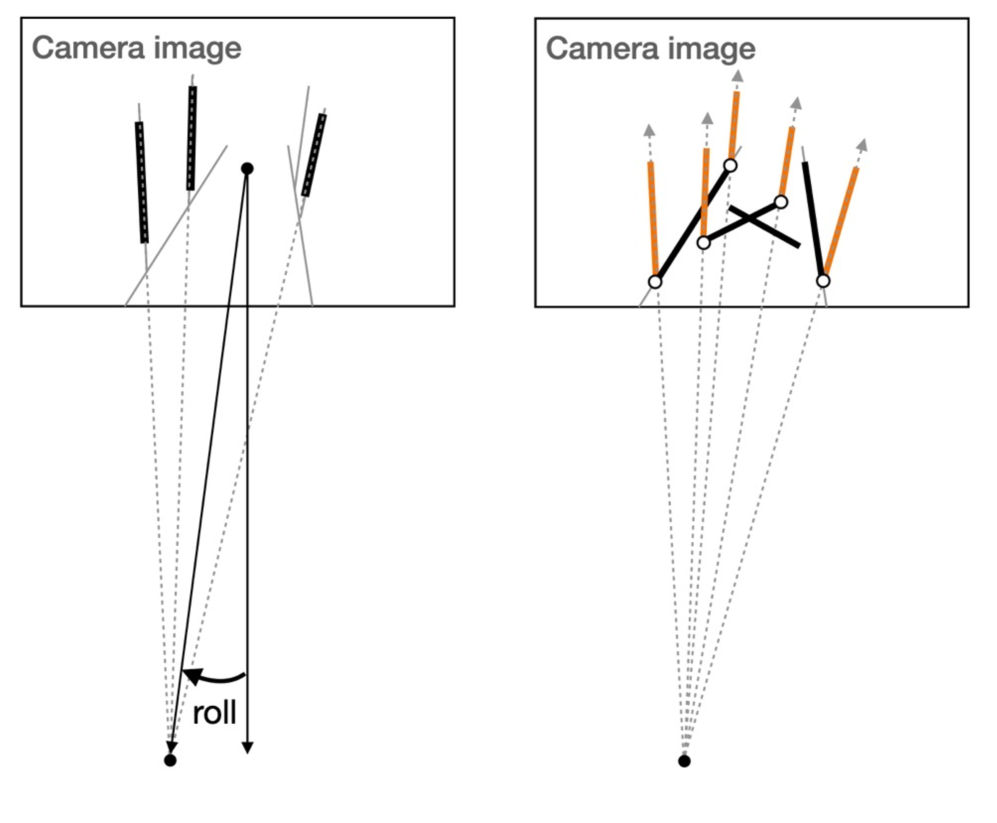

多相机系统的标定是精确目标跟踪的关键任务。然而,在实际环境中,由于缺乏精确的楼层平面图、无法放置标定图案或视频流未同步等问题,传统方法不再适用,这仍然是一个具有挑战性的问题。本文提出了一种新颖的两阶段标定方法,克服了这些限制。在第一阶段,基于操作员对自然几何基元(平行线、垂直线和垂直线,或等长的线段)的标注,对单个相机进行部分标定。这允许估计关键参数(横滚角、俯仰角、焦距),并将相机的有效视场(EFOV)投影到基本3D坐标系中的水平面上。在第二阶段,通过交互式操作投影的EFOV多边形来实现精确的系统标定。操作员调整它们的位置、比例和旋转,以使它们与楼层平面图对齐,或者在没有楼层平面图的情况下,使用投影到系统中所有相机的虚拟标定元素。这确定了剩余的外部参数(相机位置和偏航角)。标定只需要来自每个相机的静态图像,无需物理访问或同步视频。该方法被实现为一个实用的Web服务。比较分析和演示视频证实了该方法的适用性、准确性和灵活性,从而能够在以前被认为不可行的场景中部署精确的多相机跟踪系统。

🔬 方法详解

问题定义:多相机系统标定的目标是确定每个相机相对于世界坐标系的位姿参数(包括位置和姿态)。传统方法通常需要精确的标定物或场景几何信息,例如棋盘格、三维标定块或已知的楼层平面图。然而,在许多实际应用场景中,这些信息难以获取,或者相机之间难以进行精确同步,导致传统方法失效。因此,如何在缺乏精确场景信息和同步视频的情况下,实现多相机系统的精确标定是一个亟待解决的问题。

核心思路:该论文的核心思路是将多相机标定问题分解为两个阶段。第一阶段,利用场景中常见的几何特征(如平行线、垂直线等)进行单相机部分标定,估计相机的内部参数和部分外部参数。第二阶段,通过交互式调整相机视场,利用楼层平面图或虚拟标定元素,完成系统标定,估计剩余的外部参数。这种两阶段方法降低了对场景信息的依赖,提高了标定的灵活性和鲁棒性。

技术框架:该方法主要包含两个阶段: 1. 单相机部分标定:操作员在每个相机的图像中手动标注场景中的几何基元(平行线、垂直线、等长线段)。根据这些标注,估计相机的横滚角、俯仰角和焦距,并将相机的有效视场(EFOV)投影到水平面上。 2. 系统标定:操作员通过交互式操作,调整投影的EFOV多边形的位置、比例和旋转,使其与楼层平面图或虚拟标定元素对齐。根据这些调整,估计相机的剩余外部参数(位置和偏航角)。

关键创新:该方法的主要创新在于: 1. 无需精确场景信息:利用场景中常见的几何特征进行标定,降低了对场景信息的依赖。 2. 两阶段标定:将标定问题分解为两个阶段,提高了标定的灵活性和鲁棒性。 3. 交互式调整:通过交互式调整相机视场,方便操作员进行标定,提高了标定的效率和准确性。

关键设计: 1. 几何基元选择:选择平行线、垂直线和等长线段作为几何基元,是因为这些特征在现实场景中比较常见,易于标注。 2. EFOV投影:将相机的有效视场投影到水平面上,方便操作员进行交互式调整。 3. 交互式调整界面:设计友好的交互式调整界面,方便操作员调整EFOV多边形的位置、比例和旋转。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了该方法的有效性和准确性。实验结果表明,该方法能够在缺乏精确场景信息的情况下,实现多相机系统的精确标定。演示视频展示了该方法在实际场景中的应用效果,验证了其适用性和灵活性。虽然论文中没有给出具体的性能数据,但实验结果表明该方法能够满足实际应用的需求。

🎯 应用场景

该研究成果可广泛应用于智能安防、机器人导航、自动驾驶等领域。在这些场景中,多相机系统被用于目标跟踪、场景重建和环境感知。该方法降低了多相机系统部署的门槛,使其能够在以前被认为不可行的场景中应用,具有重要的实际价值和广阔的应用前景。

📄 摘要(原文)

Calibration of multi-camera systems is a key task for accurate object tracking. However, it remains a challenging problem in real-world conditions, where traditional methods are not applicable due to the lack of accurate floor plans, physical access to place calibration patterns, or synchronized video streams. This paper presents a novel two-stage calibration method that overcomes these limitations. In the first stage, partial calibration of individual cameras is performed based on an operator's annotation of natural geometric primitives (parallel, perpendicular, and vertical lines, or line segments of equal length). This allows estimating key parameters (roll, pitch, focal length) and projecting the camera's Effective Field of View (EFOV) onto the horizontal plane in a base 3D coordinate system. In the second stage, precise system calibration is achieved through interactive manipulation of the projected EFOV polygons. The operator adjusts their position, scale, and rotation to align them with the floor plan or, in its absence, using virtual calibration elements projected onto all cameras in the system. This determines the remaining extrinsic parameters (camera position and yaw). Calibration requires only a static image from each camera, eliminating the need for physical access or synchronized video. The method is implemented as a practical web service. Comparative analysis and demonstration videos confirm the method's applicability, accuracy, and flexibility, enabling the deployment of precise multi-camera tracking systems in scenarios previously considered infeasible.