CRAFT-E: A Neuro-Symbolic Framework for Embodied Affordance Grounding

作者: Zhou Chen, Joe Lin, Carson Bulgin, Sathyanarayanan N. Aakur

分类: cs.RO, cs.AI

发布日期: 2025-12-03

备注: 20 pages. 3 figures, 4 tables. Under Review

💡 一句话要点

提出CRAFT-E框架以解决助理机器人物体功能理解问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 助理机器人 神经符号框架 物体功能理解 可解释性 抓取推理 知识图谱 视觉-语言对齐

📋 核心要点

- 现有助理机器人方法多依赖黑箱模型,缺乏透明性和可控性,限制了其在实际应用中的可靠性。

- CRAFT-E框架通过结合符号推理与感知,提供了可解释的物体选择路径,增强了功能推理的可靠性。

- CRAFT-E在多个实验中表现出色,包括静态场景和真实世界试验,展示了其在物体功能理解上的优势。

📝 摘要(中文)

助理机器人在非结构化环境中不仅需要理解物体的种类,还需理解其可用功能。现有方法多依赖黑箱模型或固定的功能标签,导致透明性、可控性和可靠性不足。本文提出CRAFT-E,一个模块化的神经符号框架,结合结构化的动词-属性-物体知识图谱与视觉-语言对齐及基于能量的抓取推理。该系统生成可解释的物体选择路径,并将抓取可行性纳入功能推理中。我们还构建了一个统一注释的基准数据集,并在物理机器人上部署了完整的管道。CRAFT-E在静态场景、基于ImageNet的功能检索及涉及20个动词和39个物体的真实世界实验中表现出色,提供了透明的组件级诊断。

🔬 方法详解

问题定义:本文旨在解决助理机器人在非结构化环境中对物体功能的理解问题。现有方法往往依赖黑箱模型或固定的功能标签,导致透明性和可控性不足,影响实际应用的可靠性。

核心思路:CRAFT-E框架通过构建一个模块化的神经符号系统,结合结构化的动词-属性-物体知识图谱与视觉-语言对齐,提供了可解释的物体选择路径,并将抓取可行性纳入功能推理中。这样的设计使得系统在物体选择时能够考虑多种因素,增强了推理的透明性和可靠性。

技术框架:CRAFT-E的整体架构包括知识图谱构建、视觉-语言对齐、抓取推理等主要模块。系统首先通过知识图谱整合动词和物体的属性信息,然后进行视觉和语言的对齐,最后通过能量模型进行抓取可行性推理。

关键创新:CRAFT-E的主要创新在于其模块化的神经符号框架,能够生成可解释的物体选择路径,并将抓取可行性作为功能推理的核心部分。这与现有的端到端模型形成鲜明对比,提供了更高的透明性和可定制性。

关键设计:在设计中,CRAFT-E采用了统一的注释标准,构建了基准数据集,涵盖动词-物体兼容性、分割和抓取候选项等信息。此外,系统的损失函数和网络结构经过精心设计,以确保在不同场景中的鲁棒性和准确性。

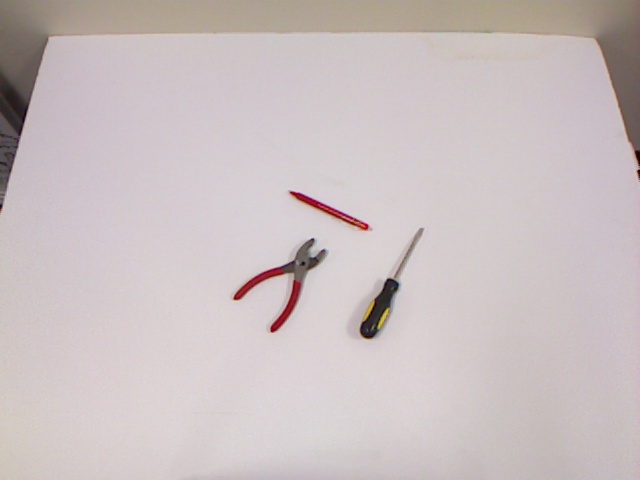

🖼️ 关键图片

📊 实验亮点

CRAFT-E在静态场景和真实世界试验中表现出色,尤其在功能检索任务中,展示了其在处理20个动词和39个物体时的竞争力。系统在面对感知噪声时依然保持鲁棒性,并提供了透明的组件级诊断,显著提升了决策的可信度。

🎯 应用场景

CRAFT-E框架在助理机器人领域具有广泛的应用潜力,能够帮助机器人在复杂环境中更好地理解物体的功能和抓取可行性。这一研究不仅提升了机器人在实际任务中的表现,也为未来的智能系统提供了可解释和可定制的决策支持,推动了人机协作的进步。

📄 摘要(原文)

Assistive robots operating in unstructured environments must understand not only what objects are, but what they can be used for. This requires grounding language-based action queries to objects that both afford the requested function and can be physically retrieved. Existing approaches often rely on black-box models or fixed affordance labels, limiting transparency, controllability, and reliability for human-facing applications. We introduce CRAFT-E, a modular neuro-symbolic framework that composes a structured verb-property-object knowledge graph with visual-language alignment and energy-based grasp reasoning. The system generates interpretable grounding paths that expose the factors influencing object selection and incorporates grasp feasibility as an integral part of affordance inference. We further construct a benchmark dataset with unified annotations for verb-object compatibility, segmentation, and grasp candidates, and deploy the full pipeline on a physical robot. CRAFT-E achieves competitive performance in static scenes, ImageNet-based functional retrieval, and real-world trials involving 20 verbs and 39 objects. The framework remains robust under perceptual noise and provides transparent, component-level diagnostics. By coupling symbolic reasoning with embodied perception, CRAFT-E offers an interpretable and customizable alternative to end-to-end models for affordance-grounded object selection, supporting trustworthy decision-making in assistive robotic systems.