Autonomous Reinforcement Learning Robot Control with Intel's Loihi 2 Neuromorphic Hardware

作者: Kenneth Stewart, Roxana Leontie, Samantha Chapin, Joe Hays, Sumit Bam Shrestha, Carl Glen Henshaw

分类: cs.RO, cs.AI, cs.LG

发布日期: 2025-12-03

备注: Submitted for review at NICE 2026 (Neuro-Inspired Computational Elements) conference

💡 一句话要点

提出基于Loihi 2神经形态硬件的自主强化学习机器人控制方案

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 神经形态计算 强化学习 机器人控制 Loihi 2 SDNN

📋 核心要点

- 现有机器人控制方法通常计算量大,能耗高,难以满足空间等资源受限场景的需求。

- 论文提出将强化学习训练的ANN转换为SDNN,部署在Intel Loihi 2神经形态硬件上,实现低功耗、低延迟的机器人控制。

- 实验表明,该方法在Astrobee机器人控制任务中,验证了神经形态硬件在机器人控制方面的可行性。

📝 摘要(中文)

本文提出了一种端到端的流程,用于在神经形态硬件上部署强化学习(RL)训练的人工神经网络(ANN),通过将它们转换为脉冲Sigma-Delta神经网络(SDNNs)来实现。我们证明了完全在仿真中训练的ANN策略可以转换为与Intel的Loihi 2架构兼容的SDNN,从而实现低延迟和节能的推理。作为一个测试案例,我们使用了一个RL策略来控制Astrobee自由飞行机器人,类似于先前在太空硬件中验证过的控制器。该策略使用修正线性单元(ReLUs)进行训练,然后转换为SDNN并部署在Intel的Loihi 2上,最后在NVIDIA的Omniverse Isaac Lab仿真环境中进行评估,以实现Astrobee运动的闭环控制。我们比较了GPU和Loihi 2之间的执行性能。结果突出了使用神经形态平台进行机器人控制的可行性,并为未来空间和地面机器人应用中节能、实时的神经形态计算建立了一条途径。

🔬 方法详解

问题定义:论文旨在解决机器人控制中计算资源和能耗的限制问题,尤其是在空间机器人等资源受限的环境中。传统的机器人控制方法,如基于深度学习的控制策略,通常需要大量的计算资源,导致较高的能耗,这对于需要在能源效率方面有严格要求的应用场景来说是一个挑战。

核心思路:论文的核心思路是将传统的基于人工神经网络(ANN)的强化学习策略转换为脉冲Sigma-Delta神经网络(SDNN),并将其部署在Intel的Loihi 2神经形态硬件上。神经形态硬件具有低功耗、高并行性的特点,能够有效地执行SDNN,从而实现节能高效的机器人控制。

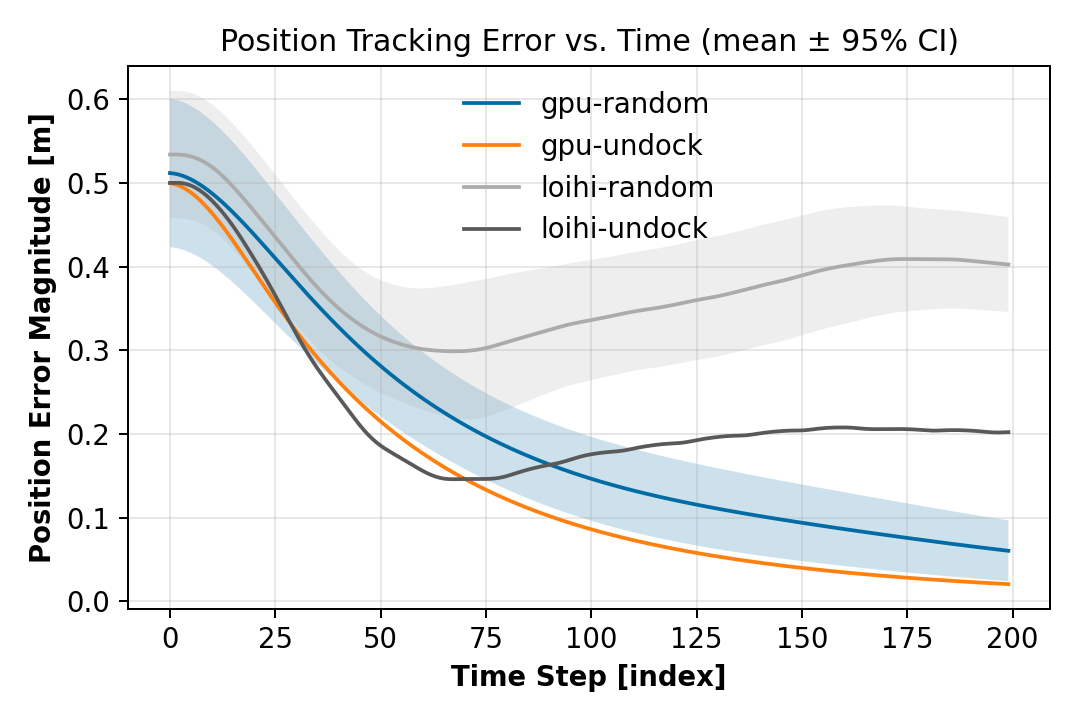

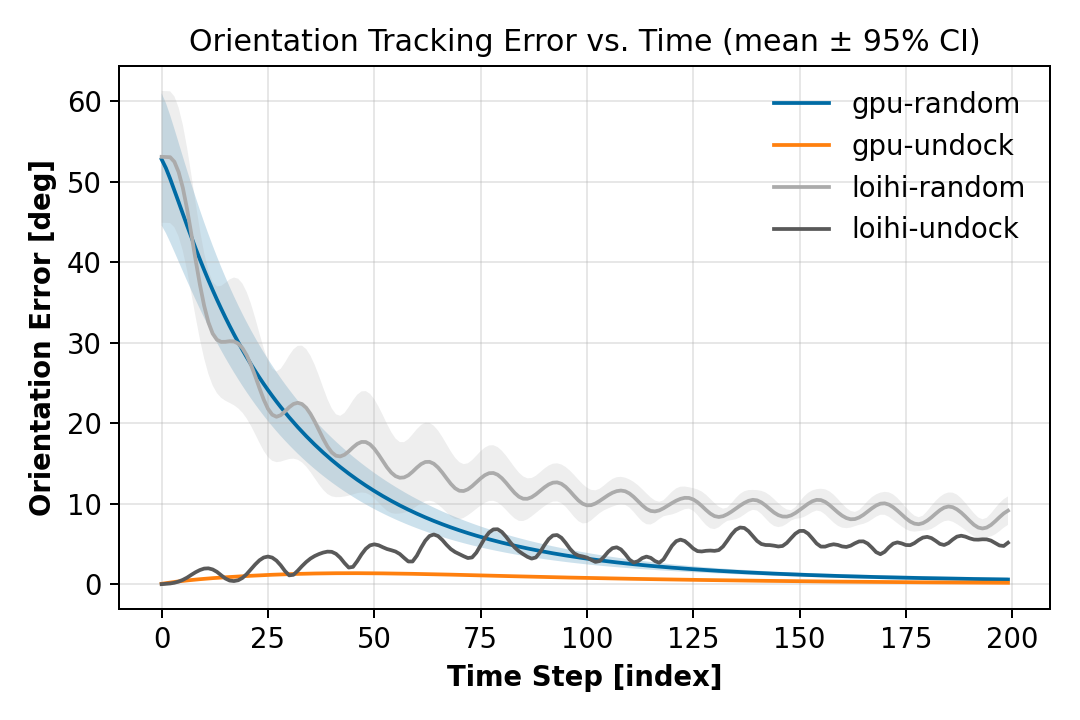

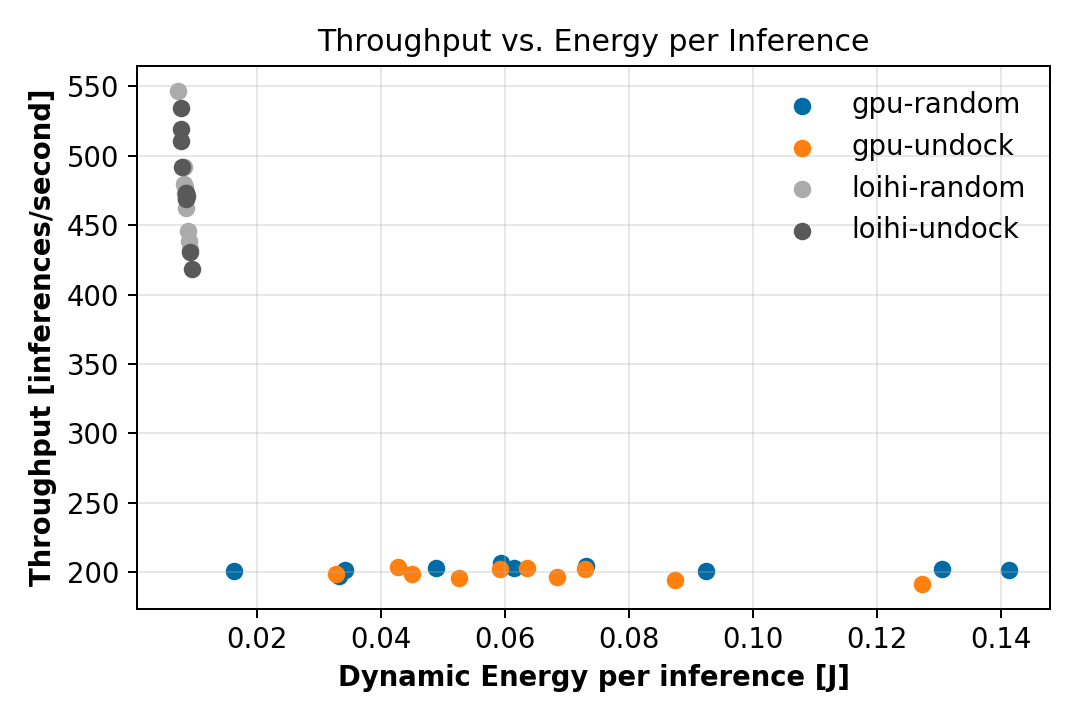

技术框架:整体流程包括以下几个阶段:1) 在仿真环境中训练基于ANN的强化学习策略;2) 将训练好的ANN策略转换为SDNN;3) 将SDNN部署到Intel的Loihi 2神经形态硬件上;4) 在NVIDIA的Omniverse Isaac Lab仿真环境中,使用Loihi 2控制Astrobee机器人,进行闭环控制测试;5) 比较Loihi 2和GPU的执行性能。

关键创新:该论文的关键创新在于将强化学习与神经形态计算相结合,提出了一种端到端的解决方案,实现了在神经形态硬件上部署强化学习策略进行机器人控制。与传统的基于GPU的控制方法相比,该方法有望实现更低的功耗和更快的响应速度。

关键设计:论文使用修正线性单元(ReLUs)训练ANN策略。ANN到SDNN的转换过程是关键,需要仔细调整参数以保证转换后的SDNN能够保持ANN的性能。在Loihi 2上的部署需要考虑硬件的特性,例如神经元的连接方式和脉冲的编码方式。闭环控制测试中,需要精确地测量Loihi 2的延迟和功耗,并与GPU进行比较。

🖼️ 关键图片

📊 实验亮点

论文在NVIDIA Omniverse Isaac Lab中进行了Astrobee机器人的闭环控制实验,验证了Loihi 2在机器人控制中的可行性。虽然论文中没有给出具体的性能数据,但强调了Loihi 2在低延迟和节能方面的优势。未来的工作可以进一步量化Loihi 2相对于GPU的性能提升,例如延迟降低百分比和功耗降低百分比。

🎯 应用场景

该研究成果可应用于空间机器人、无人机、移动机器人等领域,尤其适用于对功耗和实时性有较高要求的场景。例如,在深空探测任务中,使用神经形态硬件进行机器人控制可以显著降低能源消耗,延长任务时间。此外,该技术还可以应用于智能家居、自动驾驶等领域,实现更节能、更智能的控制系统。

📄 摘要(原文)

We present an end-to-end pipeline for deploying reinforcement learning (RL) trained Artificial Neural Networks (ANNs) on neuromorphic hardware by converting them into spiking Sigma-Delta Neural Networks (SDNNs). We demonstrate that an ANN policy trained entirely in simulation can be transformed into an SDNN compatible with Intel's Loihi 2 architecture, enabling low-latency and energy-efficient inference. As a test case, we use an RL policy for controlling the Astrobee free-flying robot, similar to a previously hardware in space-validated controller. The policy, trained with Rectified Linear Units (ReLUs), is converted to an SDNN and deployed on Intel's Loihi 2, then evaluated in NVIDIA's Omniverse Isaac Lab simulation environment for closed-loop control of Astrobee's motion. We compare execution performance between GPU and Loihi 2. The results highlight the feasibility of using neuromorphic platforms for robotic control and establish a pathway toward energy-efficient, real-time neuromorphic computation in future space and terrestrial robotics applications.