What Is The Best 3D Scene Representation for Robotics? From Geometric to Foundation Models

作者: Tianchen Deng, Yue Pan, Shenghai Yuan, Dong Li, Chen Wang, Mingrui Li, Long Chen, Lihua Xie, Danwei Wang, Jingchuan Wang, Javier Civera, Hesheng Wang, Weidong Chen

分类: cs.RO, cs.CV

发布日期: 2025-12-03 (更新: 2026-01-10)

💡 一句话要点

综述:机器人3D场景表示方法,从几何到Foundation Model的演进与展望

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D场景表示 机器人 神经辐射场 Foundation Model SLAM 导航 避障

📋 核心要点

- 现有机器人场景表示方法在下游任务(如导航和避障)中存在局限性,无法有效整合高层语义信息。

- 本文旨在全面评估现有3D场景表示方法,并探讨3D Foundation Model作为未来机器人统一解决方案的潜力。

- 通过对不同场景表示方法在机器人各模块中的优缺点进行比较,为研究人员提供有价值的参考。

📝 摘要(中文)

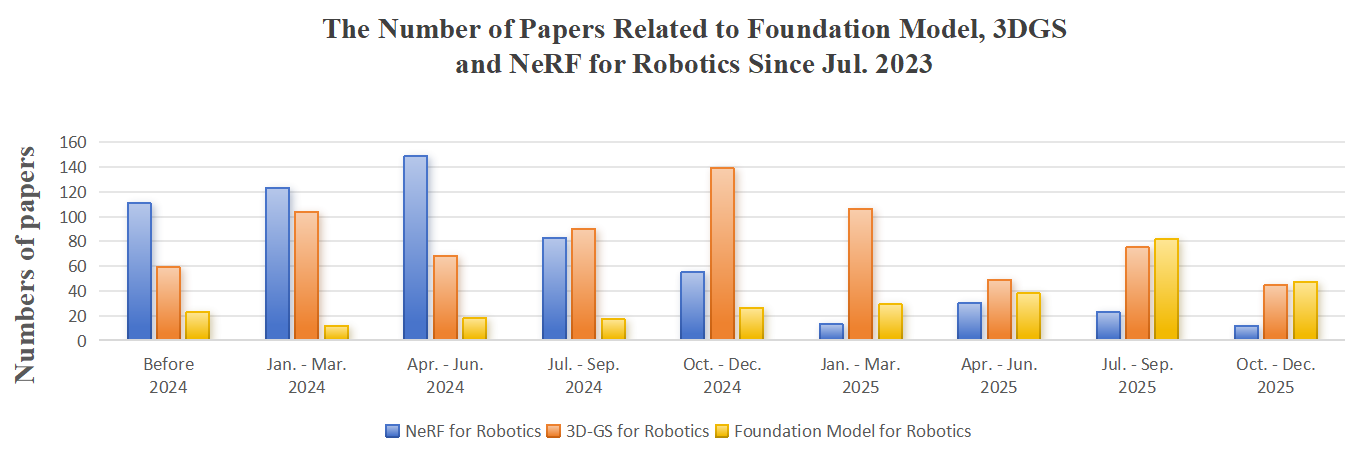

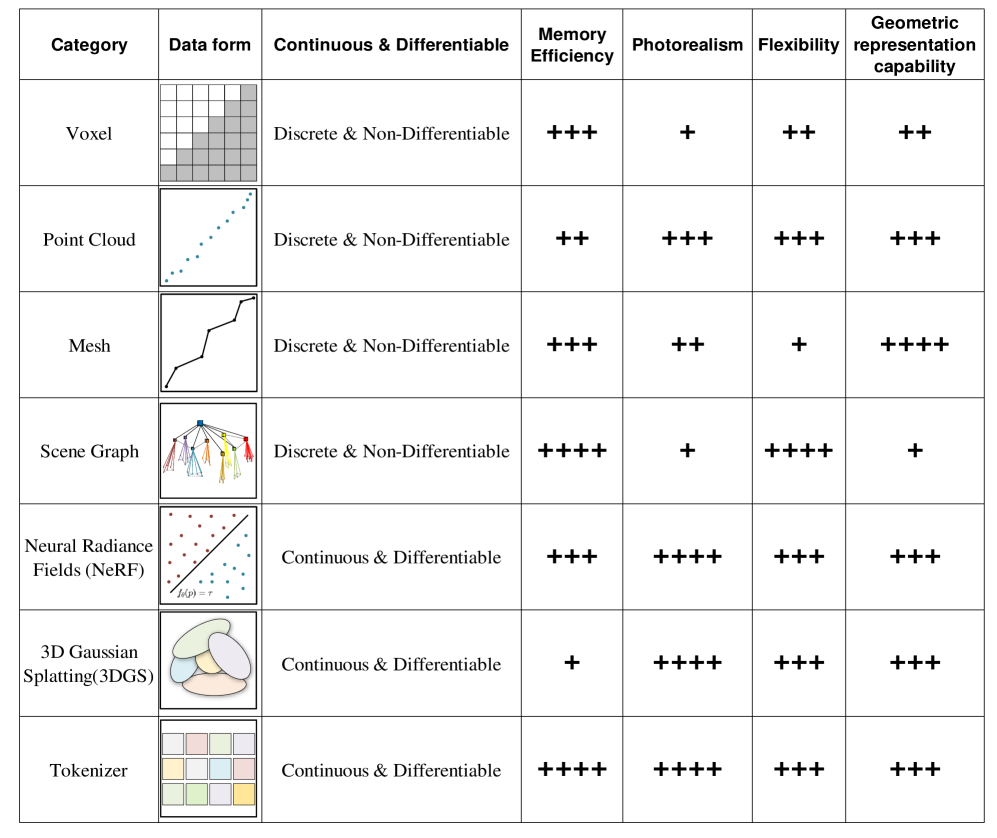

本文全面概述了机器人领域现有的场景表示方法,涵盖了传统的表示方法,如点云、体素、有符号距离函数(SDF)和场景图,以及较新的神经表示方法,如神经辐射场(NeRF)、3D高斯溅射(3DGS)和新兴的Foundation Model。虽然当前的SLAM和定位系统主要依赖于点云和体素等稀疏表示,但预计密集场景表示将在导航和避障等下游任务中发挥关键作用。此外,NeRF、3DGS和Foundation Model等神经表示非常适合集成高层语义特征和基于语言的先验知识,从而实现更全面的3D场景理解和具身智能。本文将机器人的核心模块分为五个部分(感知、建图、定位、导航、操作)。首先,介绍了不同场景表示方法的标准公式,并比较了不同模块中场景表示的优缺点。本综述围绕着“机器人最佳3D场景表示是什么?”这一问题展开。然后,讨论了3D场景表示的未来发展趋势,特别关注3D Foundation Model如何取代当前方法,成为未来机器人应用的统一解决方案。还探讨了充分实现该模型所面临的剩余挑战。旨在为新手和经验丰富的研究人员提供有价值的资源,以探索3D场景表示的未来及其在机器人技术中的应用。已在GitHub上发布了一个开源项目,并将继续向该项目添加新的作品和技术。

🔬 方法详解

问题定义:现有机器人场景表示方法,如点云和体素,虽然在SLAM和定位中应用广泛,但在下游任务中表现不足,无法有效利用高层语义信息。神经表示方法,如NeRF和3DGS,虽然能整合语义信息,但计算成本高昂,难以实时应用。因此,需要一种既能高效表示场景几何信息,又能整合语义信息,并能适应不同机器人任务的3D场景表示方法。

核心思路:本文的核心思路是通过对现有各种3D场景表示方法进行全面分析和比较,找出它们在不同机器人任务中的优缺点。同时,探讨新兴的3D Foundation Model作为统一解决方案的潜力,并分析其面临的挑战。通过这种方式,为研究人员提供选择和开发更适合机器人应用的3D场景表示方法的指导。

技术框架:本文的技术框架主要包括以下几个部分:1) 对传统场景表示方法(如点云、体素、SDF、场景图)进行介绍;2) 对神经表示方法(如NeRF、3DGS)进行介绍;3) 将机器人核心模块分为五个部分(感知、建图、定位、导航、操作),并分析不同场景表示方法在这些模块中的应用;4) 讨论3D Foundation Model作为未来统一解决方案的潜力;5) 探讨实现3D Foundation Model所面临的挑战。

关键创新:本文的创新之处在于:1) 对机器人领域现有的3D场景表示方法进行了全面的综述和比较,涵盖了传统方法和新兴的神经表示方法;2) 提出了3D Foundation Model作为未来机器人统一解决方案的设想,并分析了其可行性和挑战;3) 将机器人核心模块分解为五个部分,并针对每个模块分析了不同场景表示方法的优缺点,为研究人员提供了更细粒度的指导。

关键设计:本文主要是一篇综述性文章,没有提出新的算法或模型。但是,文章对各种3D场景表示方法的公式、优缺点、适用场景等进行了详细的描述和比较,为研究人员提供了重要的参考信息。此外,文章还对3D Foundation Model的未来发展趋势进行了展望,并提出了需要解决的关键问题。

🖼️ 关键图片

📊 实验亮点

本文对现有3D场景表示方法进行了全面的对比分析,并着重强调了3D Foundation Model在机器人领域的潜力。该综述为研究人员提供了一个清晰的路线图,指出了未来研究方向,并开源了相关代码,方便后续研究。

🎯 应用场景

该研究成果可应用于机器人导航、避障、操作等多个领域。通过选择合适的3D场景表示方法,可以提高机器人在复杂环境中的感知和决策能力,从而实现更智能、更高效的机器人应用。未来,3D Foundation Model有望成为机器人领域的通用场景表示方法,推动机器人技术的进一步发展。

📄 摘要(原文)

In this paper, we provide a comprehensive overview of existing scene representation methods for robotics, covering traditional representations such as point clouds, voxels, signed distance functions (SDF), and scene graphs, as well as more recent neural representations like Neural Radiance Fields (NeRF), 3D Gaussian Splatting (3DGS), and the emerging Foundation Models. While current SLAM and localization systems predominantly rely on sparse representations like point clouds and voxels, dense scene representations are expected to play a critical role in downstream tasks such as navigation and obstacle avoidance. Moreover, neural representations such as NeRF, 3DGS, and foundation models are well-suited for integrating high-level semantic features and language-based priors, enabling more comprehensive 3D scene understanding and embodied intelligence. In this paper, we categorized the core modules of robotics into five parts (Perception, Mapping, Localization, Navigation, Manipulation). We start by presenting the standard formulation of different scene representation methods and comparing the advantages and disadvantages of scene representation across different modules. This survey is centered around the question: What is the best 3D scene representation for robotics? We then discuss the future development trends of 3D scene representations, with a particular focus on how the 3D Foundation Model could replace current methods as the unified solution for future robotic applications. The remaining challenges in fully realizing this model are also explored. We aim to offer a valuable resource for both newcomers and experienced researchers to explore the future of 3D scene representations and their application in robotics. We have published an open-source project on GitHub and will continue to add new works and technologies to this project.