Reframing Human-Robot Interaction Through Extended Reality: Unlocking Safer, Smarter, and More Empathic Interactions with Virtual Robots and Foundation Models

作者: Yuchong Zhang, Yong Ma, Danica Kragic

分类: cs.HC, cs.RO

发布日期: 2025-12-02 (更新: 2025-12-11)

备注: This paper is under review

💡 一句话要点

利用扩展现实重构人机交互,实现更安全、智能和共情的虚拟机器人交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 扩展现实 虚拟机器人 大型基础模型 认知智能 共情交互 多模态融合

📋 核心要点

- 现有物理机器人在人机交互中存在硬件限制,难以实现灵活部署和扩展,且成本较高。

- 论文提出利用XR技术创建虚拟机器人,并由大型基础模型驱动,使其具备认知能力和共情能力。

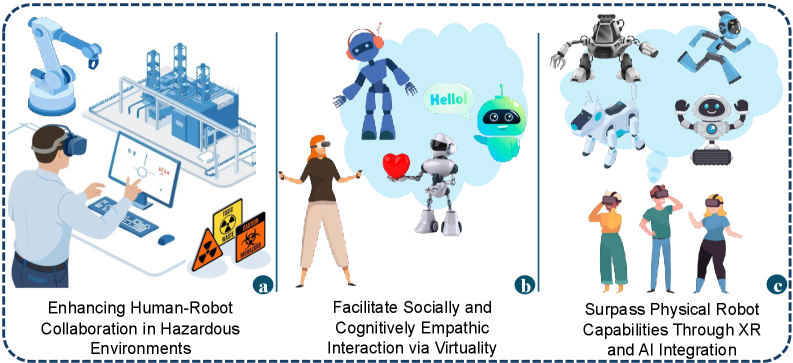

- 通过XR和AI的集成,虚拟机器人能够支持安全关键场景,实现跨领域的社交共情交互,并扩展物理能力。

📝 摘要(中文)

本文通过扩展现实(XR)重构人机交互(HRI),认为由大型基础模型(FMs)驱动的虚拟机器人可以作为具有认知基础和共情能力的智能体。与物理机器人不同,XR原生智能体不受硬件约束,可以按需实例化、调整和扩展,同时仍然提供具身性和共现性。我们综合了XR、HRI和认知AI领域的工作,展示了此类智能体如何支持安全关键场景、跨领域的社交和认知共情交互,以及通过XR和AI集成扩展物理能力。然后,我们讨论了多模态大型基础模型(例如,大型语言模型、大型视觉模型和视觉-语言模型)如何实现上下文感知推理、情感敏感情境和长期适应,从而将虚拟机器人定位为认知和共情中介,而不仅仅是模拟资产。同时,我们强调了挑战和潜在风险,包括过度信任、文化和表征偏见、围绕生物特征传感的隐私问题以及数据治理和透明度。最后,本文概述了一个以人为本、符合伦理的XR智能体研究议程——强调多层评估框架、多用户生态系统、混合虚拟-物理具身性以及社会和伦理设计实践,以设想由FMs驱动的基于XR的虚拟智能体,将未来的HRI重塑为更高效和自适应的范例。

🔬 方法详解

问题定义:现有的人机交互系统依赖于物理机器人,这些机器人受到硬件的限制,难以灵活部署和扩展,并且成本高昂。此外,物理机器人难以模拟复杂的人类情感和认知过程,限制了人机交互的深度和广度。

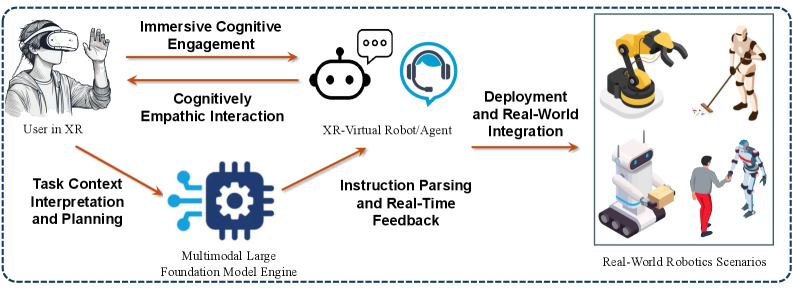

核心思路:论文的核心思路是利用扩展现实(XR)技术创建虚拟机器人,并由大型基础模型(FMs)驱动。通过XR技术,虚拟机器人可以摆脱物理硬件的限制,实现按需实例化、调整和扩展。同时,借助大型基础模型,虚拟机器人可以具备更强的认知能力和共情能力,从而实现更自然、更智能的人机交互。

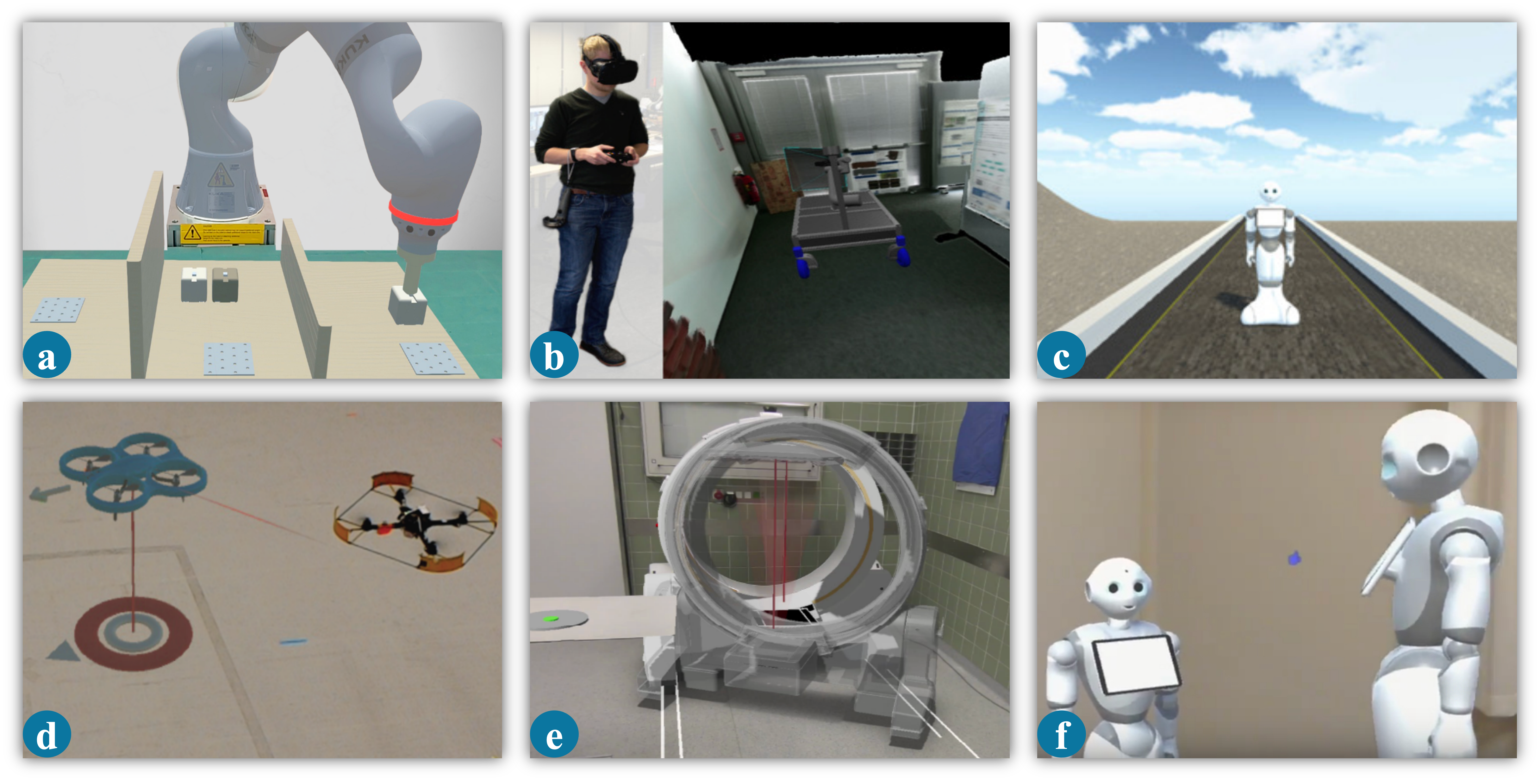

技术框架:论文提出的技术框架主要包括以下几个模块:1) XR环境构建模块,用于创建虚拟现实或增强现实环境;2) 虚拟机器人建模模块,用于创建具有逼真外观和行为的虚拟机器人;3) 大型基础模型集成模块,用于将大型语言模型、大型视觉模型和视觉-语言模型集成到虚拟机器人中,使其具备认知能力和共情能力;4) 人机交互接口模块,用于实现用户与虚拟机器人之间的交互,例如语音交互、手势交互等。

关键创新:论文最重要的技术创新点在于将XR技术和大型基础模型相结合,创造了一种全新的虚拟机器人交互模式。这种模式不仅可以摆脱物理硬件的限制,实现灵活部署和扩展,还可以借助大型基础模型,使虚拟机器人具备更强的认知能力和共情能力,从而实现更自然、更智能的人机交互。与现有方法相比,该方法能够提供更丰富的交互体验,并支持更广泛的应用场景。

关键设计:论文中涉及的关键设计包括:1) 虚拟机器人的外观和行为设计,需要使其尽可能逼真,以增强用户的沉浸感;2) 大型基础模型的选择和集成,需要根据具体的应用场景选择合适的模型,并进行优化,以提高其性能;3) 人机交互接口的设计,需要使其尽可能自然和易用,以提高用户的交互体验;4) 针对XR环境的优化,例如降低延迟、提高渲染质量等,以增强用户的沉浸感。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述性文章,没有具体的实验数据。其亮点在于提出了一个利用XR和大型基础模型重构人机交互的新思路,并对该思路的潜在应用场景和挑战进行了深入探讨。该研究为未来人机交互的发展方向提供了新的视角。

🎯 应用场景

该研究成果可应用于多个领域,包括远程协作、教育培训、医疗康复、娱乐游戏等。例如,在远程协作中,虚拟机器人可以作为用户的虚拟助手,帮助用户完成各种任务;在教育培训中,虚拟机器人可以作为虚拟教师,为学生提供个性化的指导;在医疗康复中,虚拟机器人可以作为虚拟治疗师,帮助患者进行康复训练。

📄 摘要(原文)

This perspective reframes human-robot interaction (HRI) through extended reality (XR), arguing that virtual robots powered by large foundation models (FMs) can serve as cognitively grounded, empathic agents. Unlike physical robots, XR-native agents are unbound by hardware constraints and can be instantiated, adapted, and scaled on demand, while still affording embodiment and co-presence. We synthesize work across XR, HRI, and cognitive AI to show how such agents can support safety-critical scenarios, socially and cognitively empathic interaction across domains, and outreaching physical capabilities with XR and AI integration. We then discuss how multimodal large FMs (e.g., large language model, large vision model, and vision-language model) enable context-aware reasoning, affect-sensitive situations, and long-term adaptation, positioning virtual robots as cognitive and empathic mediators rather than mere simulation assets. At the same time, we highlight challenges and potential risks, including overtrust, cultural and representational bias, privacy concerns around biometric sensing, and data governance and transparency. The paper concludes by outlining a research agenda for human-centered, ethically grounded XR agents - emphasizing multi-layered evaluation frameworks, multi-user ecosystems, mixed virtual-physical embodiment, and societal and ethical design practices to envision XR-based virtual agents powered by FMs as reshaping future HRI into a more efficient and adaptive paradigm.