EfficientFlow: Efficient Equivariant Flow Policy Learning for Embodied AI

作者: Jianlei Chang, Ruofeng Mei, Wei Ke, Xiangyu Xu

分类: cs.RO, cs.AI, cs.CV, cs.LG

发布日期: 2025-12-01 (更新: 2025-12-14)

备注: Accepted by AAAI 2026. Project Page: https://efficientflow.github.io/

💡 一句话要点

EfficientFlow:面向具身AI的高效等变Flow策略学习

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身AI Flow策略学习 等变性 数据效率 采样效率

📋 核心要点

- 现有生成策略在具身AI任务中面临数据效率和采样效率的挑战,限制了其应用。

- EfficientFlow通过引入等变Flow匹配和加速正则化策略,提升数据效率和采样速度。

- 实验表明,EfficientFlow在有限数据下表现优异,推理速度显著提升,验证了其有效性。

📝 摘要(中文)

生成模型最近在视觉运动策略学习中展现出显著潜力,能够在各种具身AI任务中实现灵活且富有表现力的控制。然而,现有的生成策略通常面临数据效率低下的问题,需要大规模的演示数据,并且采样效率不高,导致推理期间动作生成速度缓慢。我们提出了EfficientFlow,一个统一的框架,用于通过基于Flow的策略学习实现高效的具身AI。为了提高数据效率,我们将等变性引入到Flow匹配中。我们从理论上证明,当使用各向同性高斯先验和等变速度预测网络时,得到的动作分布仍然是等变的,从而提高了泛化能力并大大减少了数据需求。为了加速采样,我们提出了一种新的加速正则化策略。由于直接计算边缘Flow轨迹的加速度是难以处理的,我们推导出一个新的替代损失,该损失仅使用条件轨迹即可实现稳定且可扩展的训练。在广泛的机器人操作基准测试中,所提出的算法在有限数据下实现了有竞争力或更优越的性能,同时提供了显著更快的推理速度。这些结果突出了EfficientFlow作为高性能具身AI的强大而高效的范例。

🔬 方法详解

问题定义:现有基于生成模型的具身AI策略学习方法,通常需要大量数据进行训练,且推理阶段的动作生成速度较慢,限制了其在实际场景中的应用。这些方法难以在数据有限的情况下泛化,并且采样效率不高,导致实时控制困难。

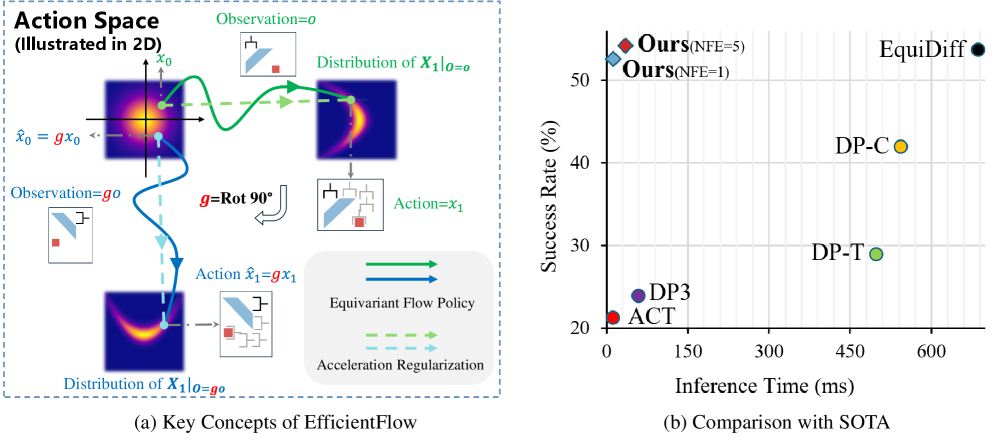

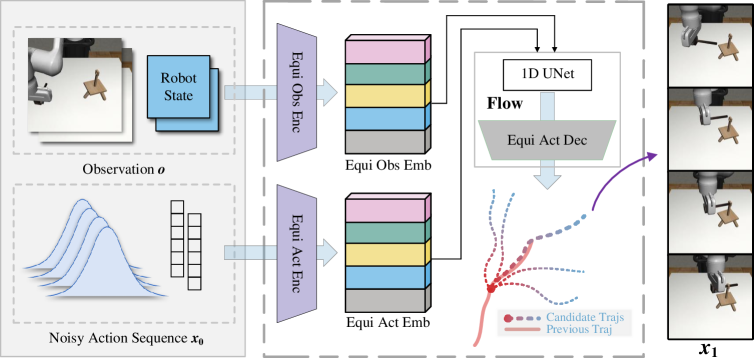

核心思路:EfficientFlow的核心思路是通过引入等变性来提高数据效率,并使用加速正则化来加速采样。等变性保证了模型在变换下的不变性,从而减少了对大量数据的依赖。加速正则化则通过优化轨迹的加速度,使得采样过程更加高效。

技术框架:EfficientFlow框架主要包含两个关键部分:等变Flow匹配和加速正则化。等变Flow匹配利用等变速度预测网络,学习从先验分布到动作分布的映射。加速正则化则通过一个替代损失函数,优化Flow轨迹的加速度,从而加速采样过程。整体流程包括数据收集、模型训练和策略部署三个阶段。

关键创新:EfficientFlow的关键创新在于将等变性引入Flow匹配,并提出了加速正则化策略。等变性保证了模型在变换下的不变性,从而提高了数据效率。加速正则化则通过优化轨迹的加速度,使得采样过程更加高效。与现有方法相比,EfficientFlow在数据效率和采样速度方面都有显著提升。

关键设计:EfficientFlow的关键设计包括:1) 使用各向同性高斯先验分布作为动作的先验;2) 设计等变速度预测网络,保证动作分布的等变性;3) 提出加速正则化的替代损失函数,该损失函数仅使用条件轨迹即可实现稳定且可扩展的训练。损失函数包括Flow匹配损失和加速正则化损失两部分,通过联合优化这两个损失函数,可以提高数据效率和采样速度。

🖼️ 关键图片

📊 实验亮点

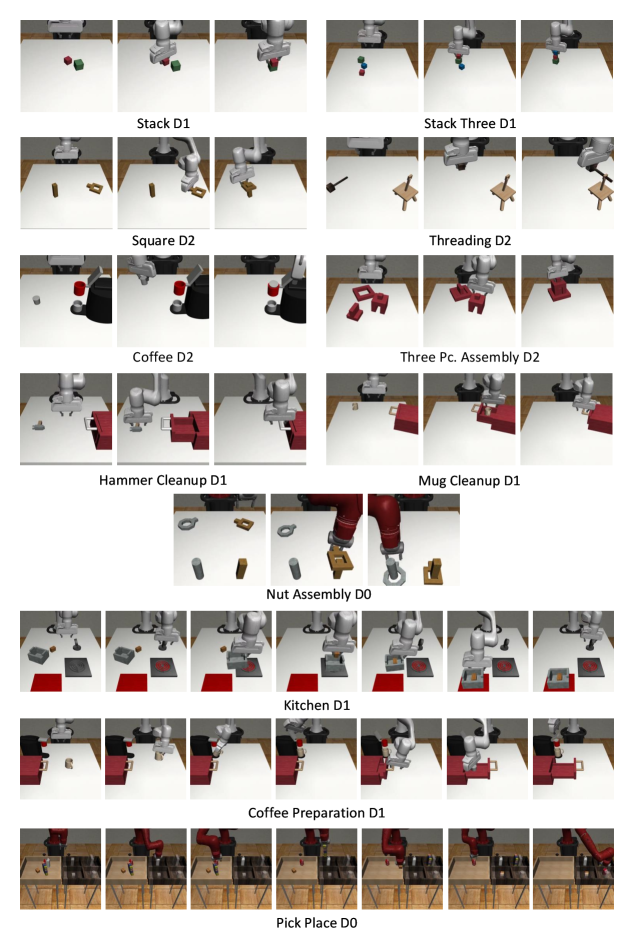

EfficientFlow在多个机器人操作基准测试中取得了优异的性能。在有限数据下,EfficientFlow的性能与现有方法相比具有竞争力甚至更优越。同时,EfficientFlow的推理速度显著提升,比现有方法快数倍。这些结果表明,EfficientFlow是一种高效且有效的具身AI策略学习方法。

🎯 应用场景

EfficientFlow在机器人操作、自动驾驶、虚拟现实等领域具有广泛的应用前景。它可以用于训练机器人在复杂环境中的操作技能,例如抓取、放置、组装等。此外,EfficientFlow还可以用于自动驾驶车辆的运动规划和控制,以及虚拟现实环境中的角色控制。该研究的实际价值在于降低了具身AI策略学习的数据需求和计算成本,为高性能具身AI的应用提供了新的途径。

📄 摘要(原文)

Generative modeling has recently shown remarkable promise for visuomotor policy learning, enabling flexible and expressive control across diverse embodied AI tasks. However, existing generative policies often struggle with data inefficiency, requiring large-scale demonstrations, and sampling inefficiency, incurring slow action generation during inference. We introduce EfficientFlow, a unified framework for efficient embodied AI with flow-based policy learning. To enhance data efficiency, we bring equivariance into flow matching. We theoretically prove that when using an isotropic Gaussian prior and an equivariant velocity prediction network, the resulting action distribution remains equivariant, leading to improved generalization and substantially reduced data demands. To accelerate sampling, we propose a novel acceleration regularization strategy. As direct computation of acceleration is intractable for marginal flow trajectories, we derive a novel surrogate loss that enables stable and scalable training using only conditional trajectories. Across a wide range of robotic manipulation benchmarks, the proposed algorithm achieves competitive or superior performance under limited data while offering dramatically faster inference. These results highlight EfficientFlow as a powerful and efficient paradigm for high-performance embodied AI.