Experiences from Benchmarking Vision-Language-Action Models for Robotic Manipulation

作者: Yihao Zhang, Yuankai Qi, Xi Zheng

分类: cs.RO, cs.AI

发布日期: 2025-11-14

💡 一句话要点

对机器人操作的视觉-语言-动作模型进行基准测试与经验分析。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言-动作模型 机器人操作 基准测试 泛化能力 适应性

📋 核心要点

- 现有视觉-语言-动作模型缺乏系统性的真实环境评估和跨模型对比,阻碍了其在机器人操作中的应用。

- 本文通过构建标准化评估框架,在真实机器人平台上对多个VLA模型进行基准测试,分析其性能。

- 实验结果揭示了不同VLA模型在精度、泛化性和部署成本上的权衡,为实际应用提供了指导。

📝 摘要(中文)

本文对应用于机器人领域的通用操作的视觉-语言-动作(VLA)模型进行了基准测试,旨在填补系统性真实世界评估和跨模型比较的空白。我们对ACT、OpenVLA-OFT、RDT-1B和π₀四个代表性VLA模型在ALOHA Mobile平台上进行了仿真和真实环境下的四项操作任务的评估,并建立了一个标准化的评估框架,从准确性和效率(成功率和成功时间)、适应性(包括同分布、空间分布外和实例加空间分布外)以及语言指令遵循准确性三个关键维度衡量性能。实验结果表明,π₀在分布外场景中表现出卓越的适应性,而ACT在同分布中提供最高的稳定性。进一步分析揭示了计算需求、数据缩放行为以及常见的失败模式(如近失抓取、过早释放和长时程状态漂移)的差异。这些发现揭示了VLA模型架构在精度、泛化性和部署成本之间存在的实际权衡,为在真实机器人操作任务中选择和部署VLA模型提供了可操作的见解。

🔬 方法详解

问题定义:现有视觉-语言-动作(VLA)模型在机器人操作领域展现出潜力,但缺乏充分的真实世界评估和跨模型比较。这使得难以选择合适的模型并了解其在实际应用中的性能表现。现有方法难以量化模型在不同环境和任务下的泛化能力,以及在计算资源和数据需求方面的差异。

核心思路:本文的核心思路是通过建立一个标准化的评估框架,对多个代表性的VLA模型在真实机器人平台上进行基准测试。通过系统地评估模型的准确性、效率、适应性和语言指令遵循能力,揭示不同模型之间的优劣势,并分析其在实际应用中的权衡。

技术框架:该研究的技术框架主要包括以下几个部分:1) 选择四个代表性的VLA模型:ACT、OpenVLA-OFT、RDT-1B和π₀。2) 在ALOHA Mobile平台上进行仿真和真实环境下的四项操作任务。3) 建立标准化的评估框架,从准确性和效率、适应性和语言指令遵循准确性三个维度衡量性能。4) 分析实验结果,揭示不同模型在精度、泛化性和部署成本之间的权衡。

关键创新:该研究的关键创新在于建立了标准化的评估框架,能够系统地评估VLA模型在真实机器人操作任务中的性能。该框架不仅考虑了模型的准确性和效率,还关注了其在不同分布下的适应性和语言指令遵循能力。此外,该研究还深入分析了不同模型的计算需求、数据缩放行为和常见失败模式,为实际应用提供了有价值的见解。

关键设计:评估框架的关键设计包括:1) 准确性和效率的评估指标:成功率和成功时间。2) 适应性的评估:包括同分布、空间分布外和实例加空间分布外三种场景。3) 语言指令遵循准确性的评估:通过分析模型对不同语言指令的响应,评估其理解和执行指令的能力。4) 实验任务的设计:选择具有代表性的操作任务,例如抓取、放置和组装等,以评估模型在不同场景下的性能。

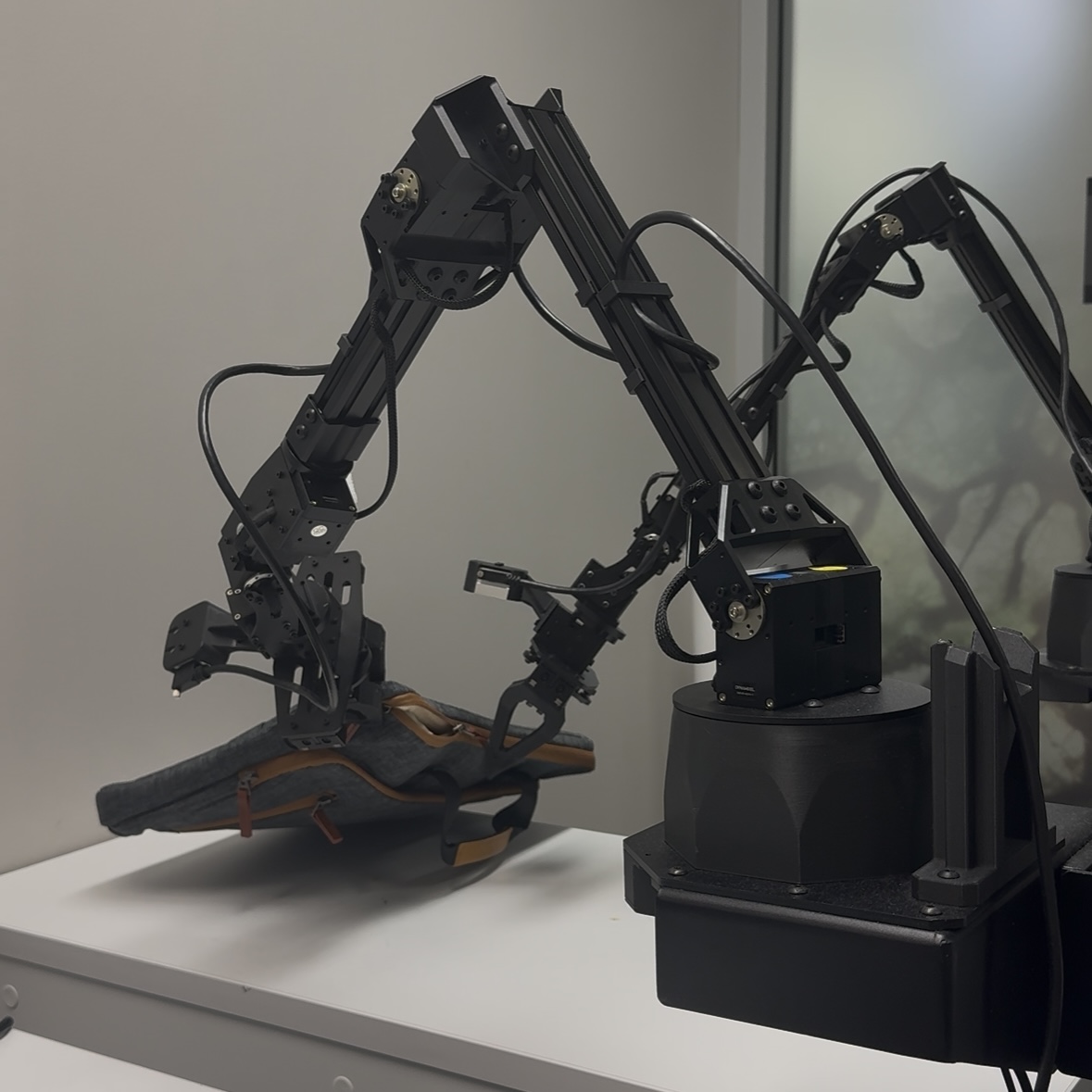

🖼️ 关键图片

📊 实验亮点

实验结果表明,π₀在分布外场景中表现出卓越的适应性,而ACT在同分布中提供最高的稳定性。此外,研究还揭示了不同模型在计算需求、数据缩放行为和常见失败模式方面的差异。例如,某些模型在近失抓取和过早释放方面表现出较高的失败率,而另一些模型则容易出现长时程状态漂移。

🎯 应用场景

该研究成果可应用于各种机器人操作场景,例如智能制造、家庭服务和医疗辅助等。通过选择合适的VLA模型,可以提高机器人在复杂环境中的操作能力,降低部署成本,并提升人机协作效率。未来的研究可以进一步探索如何优化VLA模型,提高其泛化能力和鲁棒性,使其能够更好地适应真实世界的挑战。

📄 摘要(原文)

Foundation models applied in robotics, particularly \textbf{Vision--Language--Action (VLA)} models, hold great promise for achieving general-purpose manipulation. Yet, systematic real-world evaluations and cross-model comparisons remain scarce. This paper reports our \textbf{empirical experiences} from benchmarking four representative VLAs -- \textbf{ACT}, \textbf{OpenVLA--OFT}, \textbf{RDT-1B}, and \boldmath{$π_0$} -- across four manipulation tasks conducted in both simulation and on the \textbf{ALOHA Mobile} platform. We establish a \textbf{standardized evaluation framework} that measures performance along three key dimensions: (1) \textit{accuracy and efficiency} (success rate and time-to-success), (2) \textit{adaptability} across in-distribution, spatial out-of-distribution, and instance-plus-spatial out-of-distribution settings, and (3) \textit{language instruction-following accuracy}. Through this process, we observe that \boldmath{$π_0$} demonstrates superior adaptability in out-of-distribution scenarios, while \textbf{ACT} provides the highest stability in-distribution. Further analysis highlights differences in computational demands, data-scaling behavior, and recurring failure modes such as near-miss grasps, premature releases, and long-horizon state drift. These findings reveal practical trade-offs among VLA model architectures in balancing precision, generalization, and deployment cost, offering actionable insights for selecting and deploying VLAs in real-world robotic manipulation tasks.