Foundation Models for Trajectory Planning in Autonomous Driving: A Review of Progress and Open Challenges

作者: Kemal Oksuz, Alexandru Buburuzan, Anthony Knittel, Yuhan Yao, Puneet K. Dokania

分类: cs.RO, cs.CV

发布日期: 2025-10-31

备注: Under review

🔗 代码/项目: GITHUB

💡 一句话要点

综述:自动驾驶轨迹规划中的Foundation模型进展与挑战

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 轨迹规划 Foundation模型 多模态学习 视觉-语言模型

📋 核心要点

- 现有自动驾驶轨迹规划方法依赖手工设计,泛化能力弱,难以处理复杂场景。

- 论文综述了基于Foundation模型的轨迹规划方法,利用多模态输入直接预测轨迹。

- 论文分析了37种方法的架构、优势和局限性,并评估了代码和数据的开放性。

📝 摘要(中文)

多模态Foundation模型的出现显著改变了自动驾驶技术,使其从传统的手工设计选择转向统一的、基于Foundation模型的方法,能够直接从原始传感器输入推断运动轨迹。这类新方法还可以将自然语言作为额外的模态,其中视觉-语言-动作(VLA)模型是代表性的例子。本综述通过统一的分类法,全面考察了这些方法,批判性地评估了它们的架构设计选择、方法论优势以及固有的能力和局限性。我们的调查涵盖了37种最近提出的、涵盖了使用Foundation模型进行轨迹规划的方法。此外,我们还评估了这些方法在源代码和数据集方面的开放性,为从业者和研究人员提供了有价值的信息。我们提供了一个配套网页,根据我们的分类法对这些方法进行编目,网址为:https://github.com/fiveai/FMs-for-driving-trajectories

🔬 方法详解

问题定义:自动驾驶轨迹规划旨在根据环境感知信息生成安全、高效的车辆行驶轨迹。传统方法依赖于手工设计的规则和模块,难以适应复杂多变的交通场景,泛化能力有限。此外,如何有效融合多种传感器信息(如视觉、激光雷达、地图等)也是一个挑战。

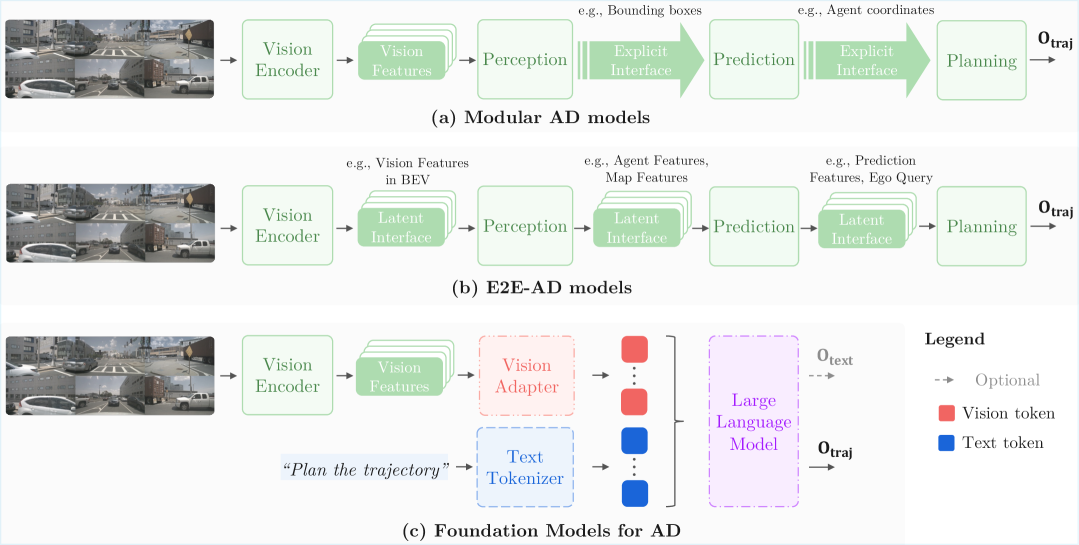

核心思路:论文的核心思路是利用大规模预训练的Foundation模型,例如视觉-语言模型,直接从原始传感器数据(如图像、点云)和自然语言指令中学习轨迹规划策略。这种端到端的方法避免了手工特征工程,有望提高模型的泛化能力和适应性。

技术框架:该综述论文分析了多种基于Foundation模型的轨迹规划方法,这些方法通常包含以下几个主要模块:1) 感知模块:负责从传感器数据中提取环境信息;2) 决策模块:根据环境信息和目标生成轨迹;3) 控制模块:将轨迹转化为车辆控制指令。Foundation模型通常被用于决策模块,例如,使用视觉-语言模型将图像和自然语言指令映射到轨迹。

关键创新:最重要的技术创新在于利用大规模预训练的Foundation模型进行轨迹规划,这与传统方法依赖手工规则和模块化的设计思路截然不同。Foundation模型能够学习到更丰富的环境表示和更复杂的行为模式,从而提高轨迹规划的性能。

关键设计:不同的方法在Foundation模型的选择、输入模态、损失函数和训练策略上有所不同。例如,一些方法使用Transformer架构的视觉-语言模型,将图像和自然语言指令作为输入,预测车辆的运动轨迹。损失函数通常包括轨迹预测误差、碰撞惩罚和舒适度指标等。训练策略包括模仿学习、强化学习和混合方法。

🖼️ 关键图片

📊 实验亮点

该综述论文系统地分析了37种基于Foundation模型的轨迹规划方法,并评估了它们的性能和局限性。论文还提供了代码和数据集的开放性信息,为研究人员和从业者提供了有价值的参考。通过对比不同方法的优缺点,论文指出了未来研究方向,例如如何提高模型的泛化能力、如何处理长尾场景等。

🎯 应用场景

该研究成果可应用于各种自动驾驶场景,包括城市道路、高速公路和停车场等。通过利用Foundation模型,自动驾驶系统能够更好地理解环境、预测行为,并生成更安全、高效的行驶轨迹。此外,该技术还有潜力应用于机器人导航、无人机控制等领域,具有广阔的应用前景。

📄 摘要(原文)

The emergence of multi-modal foundation models has markedly transformed the technology for autonomous driving, shifting away from conventional and mostly hand-crafted design choices towards unified, foundation-model-based approaches, capable of directly inferring motion trajectories from raw sensory inputs. This new class of methods can also incorporate natural language as an additional modality, with Vision-Language-Action (VLA) models serving as a representative example. In this review, we provide a comprehensive examination of such methods through a unifying taxonomy to critically evaluate their architectural design choices, methodological strengths, and their inherent capabilities and limitations. Our survey covers 37 recently proposed approaches that span the landscape of trajectory planning with foundation models. Furthermore, we assess these approaches with respect to the openness of their source code and datasets, offering valuable information to practitioners and researchers. We provide an accompanying webpage that catalogs the methods based on our taxonomy, available at: https://github.com/fiveai/FMs-for-driving-trajectories