AgriGS-SLAM: Orchard Mapping Across Seasons via Multi-View Gaussian Splatting SLAM

作者: Mirko Usuelli, David Rapado-Rincon, Gert Kootstra, Matteo Matteucci

分类: cs.RO, cs.CV

发布日期: 2025-10-30

💡 一句话要点

AgriGS-SLAM:基于多视角高斯溅射的果园跨季节建图SLAM

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: SLAM 3D高斯溅射 激光雷达 多视角 果园 跨季节 机器人 环境感知

📋 核心要点

- 果园环境的SLAM面临重复几何结构、季节变化和树叶运动的挑战,传统方法难以保证重建质量和鲁棒性。

- AgriGS-SLAM结合激光雷达里程计和多视角3D高斯溅射,利用批量光栅化和梯度驱动的地图生命周期管理,提升重建效果。

- 实验表明,AgriGS-SLAM在跨季节的果园环境中,相比现有3DGS-SLAM方法,实现了更清晰、稳定的重建和更准确的轨迹。

📝 摘要(中文)

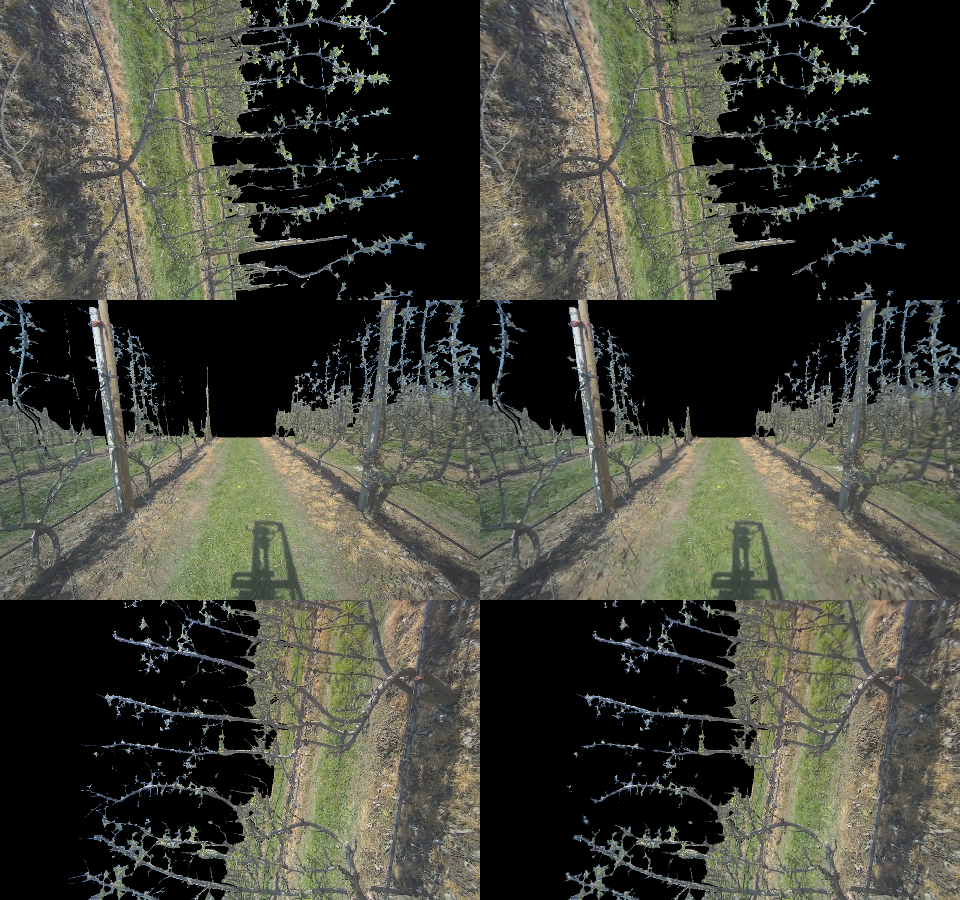

本文提出AgriGS-SLAM,一个视觉-激光雷达SLAM框架,用于解决果园中自主机器人对3D场景的实时理解问题,该问题受到重复的行几何结构、季节性外观变化和风驱动的树叶运动的影响。AgriGS-SLAM将直接激光雷达里程计和回环闭合与多相机3D高斯溅射(3DGS)渲染相结合。通过互补视角的批量光栅化恢复被遮挡的果园结构,同时在关键帧之间执行的统一梯度驱动的地图生命周期保持精细细节并限制内存。姿态优化由基于概率激光雷达的深度一致性项引导,并通过相机投影反向传播以加强几何-外观耦合。该系统在苹果和梨园的休眠期、开花期和收获期进行了部署,使用标准化轨迹协议评估训练视角和新视角的合成,以减少评估中3DGS的过拟合。在跨季节和地点的实验中,AgriGS-SLAM比最新的3DGS-SLAM基线提供更清晰、更稳定的重建和更稳定的轨迹,同时保持了拖拉机上的实时性能。虽然本文在果园监测中进行了演示,但该方法可以应用于其他需要鲁棒多模态感知的户外领域。

🔬 方法详解

问题定义:论文旨在解决果园等复杂户外环境中,由于季节变化、光照变化、植被遮挡以及重复结构等因素导致的SLAM系统定位精度下降和地图构建质量差的问题。现有方法难以在保证实时性的前提下,实现鲁棒且精确的3D场景重建。

核心思路:论文的核心思路是将激光雷达里程计与多视角3D高斯溅射(3DGS)渲染相结合,利用激光雷达提供精确的几何约束,同时利用多视角图像信息进行纹理渲染和细节补充。通过梯度驱动的地图生命周期管理,实现地图的动态更新和内存控制。

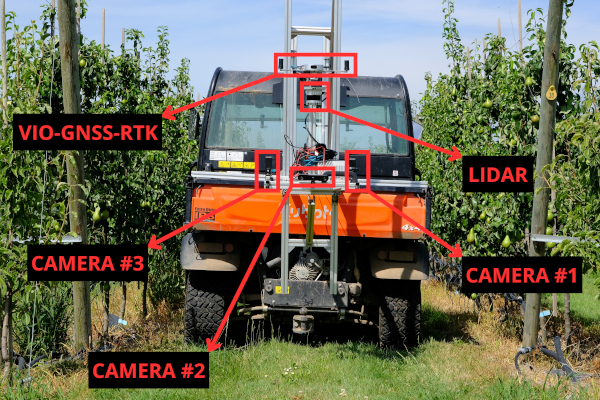

技术框架:AgriGS-SLAM框架主要包含以下几个模块:1) 激光雷达里程计:用于提供初始的位姿估计;2) 多相机系统:采集多视角的图像信息;3) 3D高斯溅射渲染:将场景表示为一组3D高斯分布,并利用多视角图像进行渲染;4) 梯度驱动的地图生命周期管理:根据梯度信息动态调整高斯分布的参数,并控制地图的规模;5) 基于概率激光雷达的深度一致性优化:利用激光雷达深度信息对相机位姿进行优化,增强几何-外观一致性。

关键创新:论文的关键创新在于将多视角3D高斯溅射与激光雷达里程计相结合,并提出了梯度驱动的地图生命周期管理方法。这种方法能够有效地利用多模态信息,提高SLAM系统的鲁棒性和精度,同时控制地图的规模。此外,基于概率激光雷达的深度一致性优化进一步增强了几何-外观耦合。

关键设计:论文中,3D高斯溅射的参数包括位置、协方差矩阵、颜色和透明度等。梯度驱动的地图生命周期管理通过计算高斯分布的梯度信息,动态调整高斯分布的参数,并删除冗余的高斯分布。基于概率激光雷达的深度一致性优化使用概率模型对激光雷达深度信息进行建模,并将其作为损失函数的一部分,用于优化相机位姿。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AgriGS-SLAM在跨季节的果园环境中,相比于现有的3DGS-SLAM方法,能够提供更清晰、更稳定的重建和更准确的轨迹。具体而言,AgriGS-SLAM在重建质量和定位精度方面均优于对比方法,并且能够保持实时性能。

🎯 应用场景

AgriGS-SLAM在农业领域具有广泛的应用前景,例如精准农业、果园管理、作物生长监测等。该技术可以帮助机器人实现自主导航和环境感知,从而提高农业生产效率和降低成本。此外,该方法还可以应用于其他户外场景,如城市建模、自动驾驶等。

📄 摘要(原文)

Autonomous robots in orchards require real-time 3D scene understanding despite repetitive row geometry, seasonal appearance changes, and wind-driven foliage motion. We present AgriGS-SLAM, a Visual--LiDAR SLAM framework that couples direct LiDAR odometry and loop closures with multi-camera 3D Gaussian Splatting (3DGS) rendering. Batch rasterization across complementary viewpoints recovers orchard structure under occlusions, while a unified gradient-driven map lifecycle executed between keyframes preserves fine details and bounds memory. Pose refinement is guided by a probabilistic LiDAR-based depth consistency term, back-propagated through the camera projection to tighten geometry-appearance coupling. We deploy the system on a field platform in apple and pear orchards across dormancy, flowering, and harvesting, using a standardized trajectory protocol that evaluates both training-view and novel-view synthesis to reduce 3DGS overfitting in evaluation. Across seasons and sites, AgriGS-SLAM delivers sharper, more stable reconstructions and steadier trajectories than recent state-of-the-art 3DGS-SLAM baselines while maintaining real-time performance on-tractor. While demonstrated in orchard monitoring, the approach can be applied to other outdoor domains requiring robust multimodal perception.