Beyond the Uncanny Valley: A Mixed-Method Investigation of Anthropomorphism in Protective Responses to Robot Abuse

作者: Fan Yang, Lingyao Li, Yaxin Hu, Michael Rodgers, Renkai Ma

分类: cs.RO

发布日期: 2025-10-30 (更新: 2025-11-01)

💡 一句话要点

研究机器人拟人化程度对人类保护行为的影响,揭示恐怖谷效应与道德反应的关联。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱八:物理动画 (Physics-based Animation)

关键词: 人机交互 机器人伦理 恐怖谷效应 拟人化 道德反应

📋 核心要点

- 现有研究对机器人拟人化与人类道德反应之间的关系理解不足,尤其是在恐怖谷效应的影响下。

- 该研究通过混合方法,结合定量和定性数据,深入分析了不同拟人化程度的机器人遭受虐待时,人类的保护反应。

- 实验结果表明,中等拟人化程度的机器人更能激发人类的愤怒和保护欲,挑战了恐怖谷效应会抑制道德关怀的传统观点。

📝 摘要(中文)

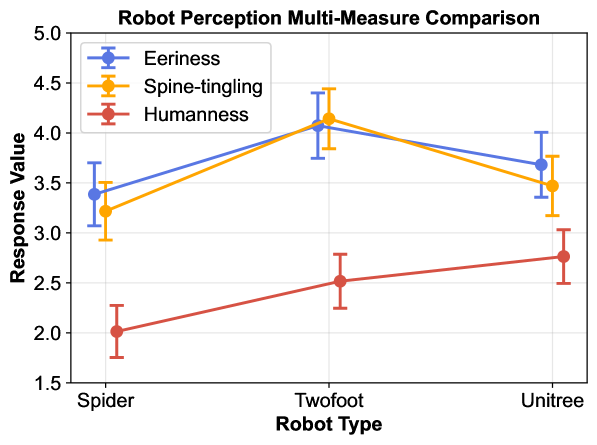

本研究探讨了不同程度的拟人化特征如何影响人类对机器人虐待的保护反应,将“计算机即社会行动者(CASA)”和恐怖谷理论扩展到道德领域。实验中,201名参与者观看了虐待低(蜘蛛型)、中(双足型)或高(人形)拟人化机器人的视频。通过自陈式调查(测量情绪和恐怖感)、生理数据(面部表情分析)和定性反思,进行综合分析。结果表明,保护反应并非线性关系。双足型机器人因其最高的恐怖感和“脊背发凉”感,引发了最强烈的生理愤怒表达。双足型和人形机器人的自陈愤怒和内疚感显著高于蜘蛛型机器人。定性研究表明,随着拟人化程度的提高,道德推理从财产损失的技术评估转变为对施虐者品格的谴责,治理建议也从财产法扩展到准动物权利和社会责任的呼吁。研究表明,恐怖谷效应非但没有减弱道德关注,反而增强了保护冲动,对机器人设计、政策和未来法律框架具有重要意义。

🔬 方法详解

问题定义:本研究旨在解决的问题是:不同拟人化程度的机器人遭受虐待时,人类的保护反应有何不同?现有研究未能充分解释恐怖谷效应是否会抑制人类对机器人的道德关怀,以及这种关怀如何随着拟人化程度的变化而变化。

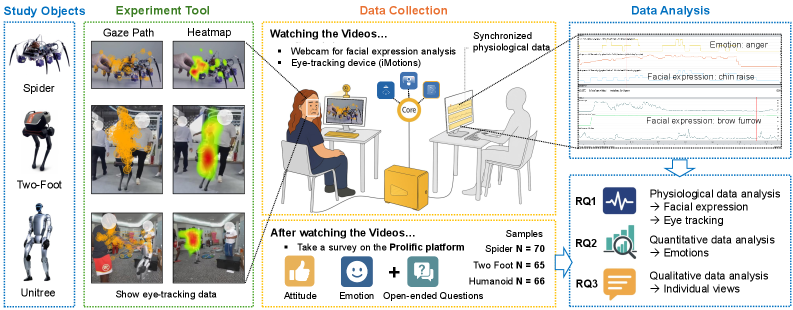

核心思路:核心思路是通过实验操纵机器人的拟人化程度(低、中、高),并测量参与者在观看机器人遭受虐待视频后的情绪反应、生理反应和道德判断。通过三角测量法,结合自陈报告、面部表情分析和定性访谈,更全面地理解人类的保护反应。

技术框架:研究采用混合方法,包括: 1. 实验设计:参与者观看三种不同拟人化程度(蜘蛛型、双足型、人形)的机器人遭受虐待的视频。 2. 数据收集: - 自陈报告:使用问卷测量参与者的情绪(如愤怒、内疚)和恐怖感。 - 生理数据:使用自动面部表情分析软件提取参与者的面部表情数据。 - 定性数据:通过访谈收集参与者对机器人虐待事件的看法和道德判断。 3. 数据分析:对收集到的数据进行统计分析和主题分析,以揭示拟人化程度与保护反应之间的关系。

关键创新:该研究的关键创新在于: 1. 将恐怖谷理论与道德领域相结合,探讨了恐怖谷效应如何影响人类对机器人虐待的道德反应。 2. 采用混合方法,结合定量和定性数据,更全面地理解了人类的保护反应。 3. 发现中等拟人化程度的机器人更能激发人类的保护欲,挑战了恐怖谷效应会抑制道德关怀的传统观点。

关键设计: 1. 机器人拟人化程度:设计了三种不同拟人化程度的机器人模型(蜘蛛型、双足型、人形),以操纵自变量。 2. 虐待场景:设计了机器人遭受虐待的视频,以引发参与者的情绪反应。 3. 面部表情分析:使用OpenFace等软件进行自动面部表情分析,提取参与者的面部表情数据,如愤怒、厌恶等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,中等拟人化程度(双足型)的机器人引发了最强烈的生理愤怒表达,与恐怖谷效应相符。自陈报告显示,双足型和人形机器人的愤怒和内疚感显著高于蜘蛛型机器人。定性分析表明,随着拟人化程度的提高,道德推理从财产损失评估转向对施虐者品格的谴责,并呼吁准动物权利和社会责任。

🎯 应用场景

该研究成果可应用于机器人设计、人机交互、伦理道德和法律法规等领域。在机器人设计方面,可以帮助设计者更好地理解人类的情感需求,设计出更易于被人类接受和信任的机器人。在法律法规方面,可以为机器人权利的制定提供参考,促进机器人伦理的健康发展。此外,该研究还有助于理解人类如何将道德观念扩展到非人类实体上。

📄 摘要(原文)

Robots with anthropomorphic features are increasingly shaping how humans perceive and morally engage with them. Our research investigates how different levels of anthropomorphism influence protective responses to robot abuse, extending the Computers as Social Actors (CASA) and uncanny valley theories into a moral domain. In an experiment, we invite 201 participants to view videos depicting abuse toward a robot with low (Spider), moderate (Two-Foot), or high (Humanoid) anthropomorphism. To provide a comprehensive analysis, we triangulate three modalities: self-report surveys measuring emotions and uncanniness, physiological data from automated facial expression analysis, and qualitative reflections. Findings indicate that protective responses are not linear. The moderately anthropomorphic Two-Foot robot, rated highest in eeriness and "spine-tingling" sensations consistent with the uncanny valley, elicited the strongest physiological anger expressions. Self-reported anger and guilt are significantly higher for both the Two-Foot and Humanoid robots compared to the Spider. Qualitative findings further reveal that as anthropomorphism increases, moral reasoning shifts from technical assessments of property damage to condemnation of the abuser's character, while governance proposals expand from property law to calls for quasi-animal rights and broader societal responsibility. These results suggest that the uncanny valley does not dampen moral concern but paradoxically heightens protective impulses, offering critical implications for robot design, policy, and future legal frameworks.