Morphology-Aware Graph Reinforcement Learning for Tensegrity Robot Locomotion

作者: Chi Zhang, Mingrui Li, Wenzhe Tong, Xiaonan Huang

分类: cs.RO

发布日期: 2025-10-30

💡 一句话要点

提出一种形态感知图强化学习方法,用于张拉整体机器人运动控制。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 张拉整体机器人 强化学习 图神经网络 运动控制 形态感知

📋 核心要点

- 张拉整体机器人控制难点在于其欠驱动和高度耦合的动力学特性,传统方法难以有效学习。

- 论文核心思想是将机器人拓扑结构建模为图,利用图神经网络学习组件间的耦合关系,提升学习效率。

- 实验表明,该方法在仿真和真实机器人上均表现出良好的性能,且无需微调即可实现策略迁移。

📝 摘要(中文)

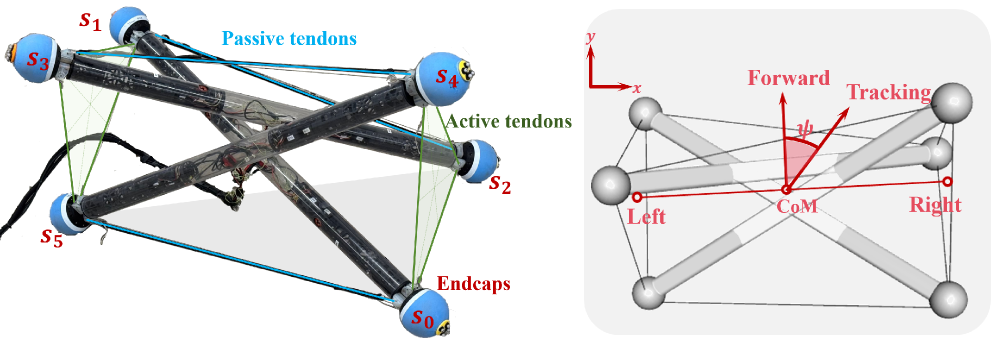

张拉整体机器人结合了刚性杆和弹性缆索,具有高弹性和可展开性,但由于其欠驱动和高度耦合的动力学特性,在运动控制方面面临着重大挑战。本文提出了一种形态感知强化学习框架,该框架将图神经网络(GNN)集成到软演员-评论家(SAC)算法中。通过将机器人的物理拓扑结构表示为图,所提出的基于GNN的策略能够捕获组件之间的耦合关系,从而实现比传统多层感知器(MLP)策略更快、更稳定的学习。该方法在物理3杆张拉整体机器人上进行了验证,涵盖了包括直线跟踪和双向转弯在内的三种运动原语。结果表明,该方法具有卓越的样本效率、对噪声和刚度变化的鲁棒性以及更高的轨迹精度。值得注意的是,学习到的策略可以直接从仿真转移到硬件,无需微调,从而实现稳定的真实世界运动。这些结果证明了将结构先验知识融入强化学习对于张拉整体机器人控制的优势。

🔬 方法详解

问题定义:张拉整体机器人的运动控制问题,由于其欠驱动和高度耦合的动力学特性,传统的控制方法难以有效地进行建模和控制。现有的基于MLP的强化学习方法难以捕捉组件之间的复杂关系,导致学习效率低下,泛化能力不足。

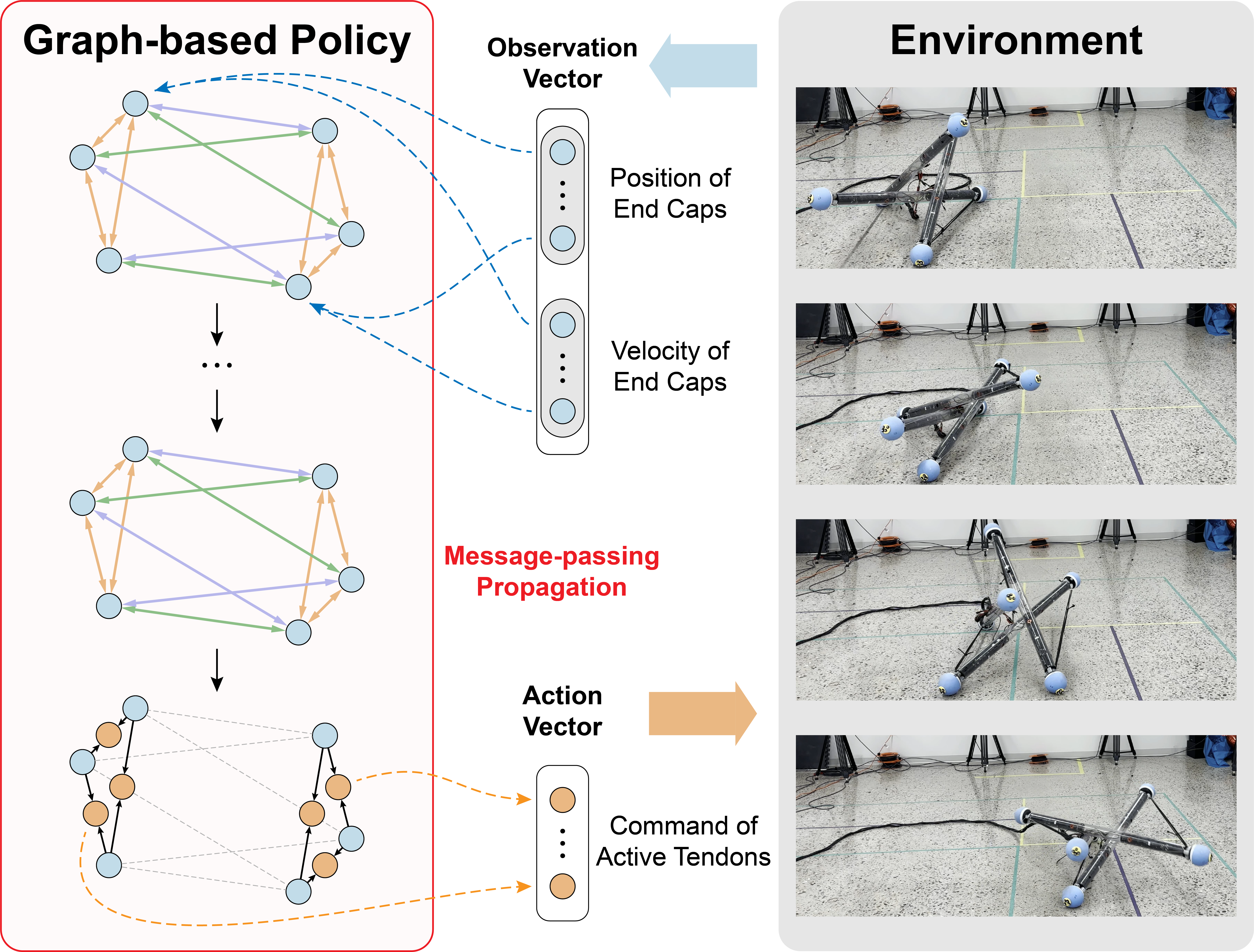

核心思路:论文的核心思路是将张拉整体机器人的物理拓扑结构表示为图,利用图神经网络(GNN)来学习机器人各个组件之间的耦合关系。通过这种方式,GNN能够更好地理解机器人的整体结构和动力学特性,从而学习到更有效的控制策略。

技术框架:该方法将GNN集成到软演员-评论家(SAC)算法中,形成一个形态感知强化学习框架。整体流程如下:首先,将机器人的物理拓扑结构表示为图,其中节点代表机器人组件(如杆和缆索),边代表组件之间的连接关系。然后,GNN利用该图结构来提取机器人的结构特征。这些结构特征与机器人的状态信息一起输入到SAC算法中,用于学习控制策略。SAC算法负责优化策略,使其能够在环境中获得最大的奖励。

关键创新:该方法最重要的技术创新点在于将GNN引入到张拉整体机器人的强化学习控制中。与传统的MLP策略相比,GNN能够更好地捕捉机器人组件之间的耦合关系,从而实现更快的学习速度和更高的控制精度。此外,该方法还具有良好的泛化能力,能够适应不同的机器人形态和环境条件。

关键设计:论文中使用了特定的GNN结构(具体结构未知),并将其与SAC算法相结合。损失函数的设计目标是最大化机器人的运动速度和稳定性,同时最小化控制动作的能量消耗。在训练过程中,使用了合适的奖励函数来引导机器人学习期望的运动行为。具体的参数设置和超参数优化细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在样本效率、鲁棒性和轨迹精度方面均优于传统的MLP策略。在直线跟踪和双向转弯等运动原语上,该方法能够学习到更稳定和精确的控制策略。更重要的是,学习到的策略可以直接从仿真转移到真实的张拉整体机器人上,无需进行额外的微调,实现了良好的零样本迁移效果。

🎯 应用场景

该研究成果可应用于各种张拉整体机器人的运动控制,例如搜索救援、地形勘探和空间探索等领域。通过学习高效的运动策略,张拉整体机器人能够在复杂和未知的环境中执行任务,并展现出其独特的适应性和鲁棒性。此外,该方法还可以推广到其他具有复杂结构和动力学特性的机器人系统。

📄 摘要(原文)

Tensegrity robots combine rigid rods and elastic cables, offering high resilience and deployability but posing major challenges for locomotion control due to their underactuated and highly coupled dynamics. This paper introduces a morphology-aware reinforcement learning framework that integrates a graph neural network (GNN) into the Soft Actor-Critic (SAC) algorithm. By representing the robot's physical topology as a graph, the proposed GNN-based policy captures coupling among components, enabling faster and more stable learning than conventional multilayer perceptron (MLP) policies. The method is validated on a physical 3-bar tensegrity robot across three locomotion primitives, including straight-line tracking and bidirectional turning. It shows superior sample efficiency, robustness to noise and stiffness variations, and improved trajectory accuracy. Notably, the learned policies transfer directly from simulation to hardware without fine-tuning, achieving stable real-world locomotion. These results demonstrate the advantages of incorporating structural priors into reinforcement learning for tensegrity robot control.