Robotic Assistant: Completing Collaborative Tasks with Dexterous Vision-Language-Action Models

作者: Boshi An, Chenyu Yang, Robert Katzschmann

分类: cs.RO

发布日期: 2025-10-29

💡 一句话要点

提出基于视觉-语言-动作模型的机器人助手,用于灵巧的人机协作任务

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 视觉-语言-动作模型 灵巧操作 机器人助手 意图预测

📋 核心要点

- 现有机器人协作方法在灵巧性和泛化性方面存在不足,难以适应复杂的人机交互场景。

- 利用预训练的视觉-语言-动作模型,通过少量语言提示和针对性改进,实现更自然流畅的人机协作。

- 实验表明,提出的方法在灵巧操作和长时程任务中表现良好,但存在对特定演示者过拟合的问题。

📝 摘要(中文)

本文针对灵巧的人机协作,对预训练的视觉-语言-动作(VLA)模型(Open-VLA)进行了适配,仅需少量语言提示。该方法主要包含三个方面的改进:(i) 在视觉骨干网络中加入FiLM条件控制,以实现任务感知的感知;(ii) 增加一个辅助意图头,用于预测合作者手部姿态和目标线索;(iii) 动作空间后处理,预测紧凑的delta动作(位置/旋转)和PCA降维后的手指关节,然后映射到完整指令。通过使用多视角、遥操作的Franka和Mimic手数据集(使用MediaPipe手部姿态进行增强),证明了delta动作的良好特性,并且四个主成分可以解释约96%的手部关节方差。消融实验表明,动作后处理是性能的主要驱动因素;辅助意图有所帮助,FiLM效果不一,而方向运动损失则会产生不利影响。一个实时堆栈(在RTX 4090上延迟约为0.3秒)将“拾取”和“传递”组合成长时程行为。研究发现,关键限制在于“训练器过度拟合”特定演示者。

🔬 方法详解

问题定义:论文旨在解决机器人如何在人类的少量语言提示下,完成灵巧的人机协作任务。现有方法通常依赖于大量的特定任务数据或复杂的控制算法,难以泛化到新的协作场景,并且在灵巧操作方面存在局限性。

核心思路:论文的核心思路是利用预训练的视觉-语言-动作模型(Open-VLA)的强大表征能力,通过少量针对性的改进,使其能够适应灵巧的人机协作任务。通过引入任务感知的视觉感知、意图预测和动作空间后处理,提高机器人的感知能力、预测能力和控制精度。

技术框架:整体框架包含以下几个主要模块:1) 视觉感知模块:使用视觉骨干网络提取图像特征,并使用FiLM条件控制实现任务感知的感知。2) 意图预测模块:使用辅助意图头预测合作者手部姿态和目标线索。3) 动作生成模块:预测紧凑的delta动作(位置/旋转)和PCA降维后的手指关节。4) 动作执行模块:将预测的动作映射到Franka和Mimic手的完整控制指令。

关键创新:论文的关键创新在于将预训练的VLA模型应用于灵巧的人机协作任务,并通过针对性的改进,提高了机器人的感知、预测和控制能力。特别是,动作空间后处理通过预测紧凑的delta动作和PCA降维后的手指关节,显著提高了动作的平滑性和可控性。

关键设计:1) FiLM条件控制:将任务相关的语言信息融入到视觉特征提取过程中,提高视觉感知的任务相关性。2) 辅助意图头:通过预测合作者手部姿态和目标线索,提高机器人对人类意图的理解能力。3) 动作空间后处理:使用delta动作和PCA降维,减少动作空间的维度,提高动作的平滑性和可控性。4) 数据集增强:使用MediaPipe手部姿态估计器增强数据集,提高模型的鲁棒性。

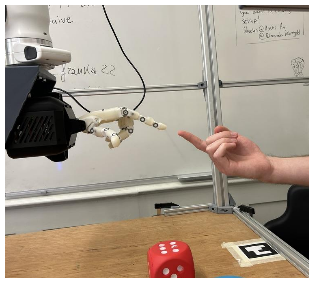

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的方法在灵巧操作和长时程任务中表现良好。消融实验表明,动作后处理是性能的主要驱动因素,辅助意图有所帮助。此外,该方法可以在RTX 4090上实现约0.3秒的实时延迟,具备实际应用潜力。研究还指出了“训练器过度拟合”特定演示者是当前方法的主要限制。

🎯 应用场景

该研究成果可应用于多种人机协作场景,例如:智能制造、医疗康复、家庭服务等。通过赋予机器人更强的灵巧操作能力和对人类意图的理解能力,可以实现更高效、安全、自然的协作模式,提高生产效率和服务质量,并减轻人类的劳动强度。

📄 摘要(原文)

We adapt a pre-trained Vision-Language-Action (VLA) model (Open-VLA) for dexterous human-robot collaboration with minimal language prompting. Our approach adds (i) FiLM conditioning to visual backbones for task-aware perception, (ii) an auxiliary intent head that predicts collaborator hand pose and target cues, and (iii) action-space post-processing that predicts compact deltas (position/rotation) and PCA-reduced finger joints before mapping to full commands. Using a multi-view, teleoperated Franka and Mimic-hand dataset augmented with MediaPipe hand poses, we demonstrate that delta actions are well-behaved and that four principal components explain ~96% of hand-joint variance. Ablations identify action post-processing as the primary performance driver; auxiliary intent helps, FiLM is mixed, and a directional motion loss is detrimental. A real-time stack (~0.3 s latency on one RTX 4090) composes "pick-up" and "pass" into a long-horizon behavior. We surface "trainer overfitting" to specific demonstrators as the key limitation.