Sim-to-Real Gentle Manipulation of Deformable and Fragile Objects with Stress-Guided Reinforcement Learning

作者: Kei Ikemura, Yifei Dong, David Blanco-Mulero, Alberta Longhini, Li Chen, Florian T. Pokorny

分类: cs.RO

发布日期: 2025-10-29

备注: Under review

💡 一句话要点

提出基于应力引导强化学习的柔性物体轻柔操作方法,实现模拟到真实的迁移

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 柔性物体操作 应力引导 模拟到真实迁移 课程学习

📋 核心要点

- 现有柔性物体操作方法依赖精确模型或专用传感器,成本高且泛化性差,难以应对真实场景的复杂性。

- 本文提出一种基于视觉的强化学习方法,通过应力惩罚奖励和课程学习,引导智能体学习轻柔操作策略。

- 实验表明,该方法在模拟环境中学习的策略能够零样本迁移到真实世界,有效降低物体受到的应力。

📝 摘要(中文)

针对柔性和易碎物体的机器人操作难题,现有方法依赖精确模型或专用传感器,增加了复杂性且缺乏泛化性。本文提出了一种基于视觉的强化学习方法,该方法结合了应力惩罚奖励,显式地抑制对物体的损伤。此外,为了引导学习,本文还引入了离线演示以及从刚性代理到可变形对象的课程学习。该方法在模拟和真实场景中进行了评估,结果表明,在模拟环境中学习到的策略可以零样本迁移到真实世界,执行诸如拾取和推动豆腐等任务。实验结果表明,与普通强化学习策略相比,所学习的策略表现出损伤感知的轻柔操作行为,在实现任务目标的同时,施加在易碎物体上的应力降低了36.5%。

🔬 方法详解

问题定义:论文旨在解决柔性和易碎物体(如豆腐)的机器人操作问题。现有方法通常依赖于精确的物体模型或特定的传感器和夹具,这增加了系统的复杂性,并且难以泛化到不同的物体和环境。此外,过度操作可能导致物体损坏,这在实际应用中是不可接受的。

核心思路:论文的核心思路是通过强化学习训练一个能够感知物体受力情况并进行轻柔操作的策略。通过在奖励函数中加入应力惩罚项,引导智能体学习避免对物体施加过大的力。同时,利用离线演示和课程学习加速训练过程,并提高策略的泛化能力。

技术框架:整体框架包括以下几个主要部分:1) 基于视觉的感知模块,用于获取环境信息;2) 强化学习智能体,负责学习操作策略;3) 模拟环境,用于训练智能体;4) 奖励函数,用于指导智能体学习。具体流程是:智能体通过视觉感知获取环境状态,根据当前策略选择动作,在模拟环境中执行动作,获得奖励,并利用奖励更新策略。通过不断迭代,智能体最终学习到能够完成任务并避免损坏物体的策略。

关键创新:论文的关键创新在于将应力信息融入到强化学习的奖励函数中。通过显式地惩罚对物体施加的应力,引导智能体学习轻柔操作策略。此外,利用课程学习,从简单的刚性物体逐渐过渡到复杂的可变形物体,提高了学习效率和策略的泛化能力。

关键设计:奖励函数的设计是关键。除了任务完成的奖励外,还包括一个应力惩罚项,该项与物体受到的应力大小成正比。课程学习的设计也至关重要,从刚性代理开始,逐步增加物体的可变形程度,使得智能体能够逐步适应复杂的操作环境。此外,论文还使用了离线演示来引导学习,加速了训练过程。

🖼️ 关键图片

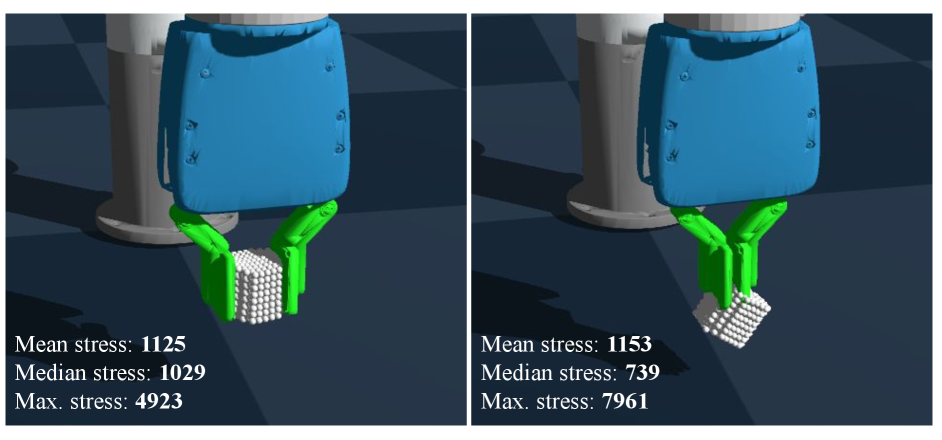

📊 实验亮点

实验结果表明,与传统的强化学习方法相比,本文提出的方法能够显著降低物体受到的应力,降低幅度达到36.5%,同时保证任务完成率。此外,该方法在模拟环境中学习到的策略能够零样本迁移到真实世界,无需额外的微调,验证了该方法的有效性和泛化能力。

🎯 应用场景

该研究成果可应用于食品加工、医疗手术、精密仪器装配等领域,在这些领域中,对易碎或可变形物体的操作至关重要。通过学习轻柔的操作策略,可以减少物体损坏的风险,提高生产效率和产品质量。未来,该方法有望扩展到更复杂的任务和环境,实现更智能、更安全的机器人操作。

📄 摘要(原文)

Robotic manipulation of deformable and fragile objects presents significant challenges, as excessive stress can lead to irreversible damage to the object. While existing solutions rely on accurate object models or specialized sensors and grippers, this adds complexity and often lacks generalization. To address this problem, we present a vision-based reinforcement learning approach that incorporates a stress-penalized reward to discourage damage to the object explicitly. In addition, to bootstrap learning, we incorporate offline demonstrations as well as a designed curriculum progressing from rigid proxies to deformables. We evaluate the proposed method in both simulated and real-world scenarios, showing that the policy learned in simulation can be transferred to the real world in a zero-shot manner, performing tasks such as picking up and pushing tofu. Our results show that the learned policies exhibit a damage-aware, gentle manipulation behavior, demonstrating their effectiveness by decreasing the stress applied to fragile objects by 36.5% while achieving the task goals, compared to vanilla RL policies.