SynHLMA:Synthesizing Hand Language Manipulation for Articulated Object with Discrete Human Object Interaction Representation

作者: Wang zhi, Yuyan Liu, Liu Liu, Li Zhang, Ruixuan Lu, Dan Guo

分类: cs.RO, cs.AI, cs.CV

发布日期: 2025-10-29

💡 一句话要点

SynHLMA:合成具身智能中基于语言指令的手部操作铰接物体序列

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱五:交互与反应 (Interaction & Reaction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手部操作 铰接物体 语言指令 抓取合成 具身智能

📋 核心要点

- 现有方法难以将语言指令融入手部操作铰接物体(HAOI)的抓取合成中,尤其缺乏对长期操作序列的建模。

- SynHLMA框架通过离散的HAOI表示,将手部与物体的交互帧和自然语言嵌入对齐,从而实现语言指导下的抓取序列生成。

- 实验结果表明,SynHLMA在HAOI生成、预测和插值任务上优于现有技术,并成功应用于机器人抓取模仿学习。

📝 摘要(中文)

本文提出了一种新的手部操作铰接物体(HAOI)序列生成框架SynHLMA,用于合成带有语言指令的手部操作铰接物体。给定铰接物体的完整点云,我们利用离散的HAOI表示来建模每个手部与物体的交互帧。结合自然语言嵌入,通过HAOI操作语言模型训练这些表示,以在共享表示空间中将抓取过程与其语言描述对齐。采用关节感知损失来确保手部抓取跟随铰接物体关节的动态变化。通过这种方式,我们的SynHLMA实现了HAOI生成、HAOI预测和HAOI插值这三个典型的铰接物体手部操作任务。我们在自建的HAOI-lang数据集上评估SynHLMA,实验结果表明,与最先进的方法相比,我们的方法具有优越的手部抓取序列生成性能。我们还展示了一个机器人抓取应用,该应用能够使用SynHLMA提供的操作序列,通过模仿学习执行灵巧的抓取。我们的代码和数据集将公开。

🔬 方法详解

问题定义:现有方法在生成带有语言指令的手部抓取时,主要集中在静态物体上,缺乏对铰接物体操作的长期序列建模能力。在HAOI任务中,手部抓取不仅需要考虑物体功能,还需要考虑物体形变过程中的操作序列,这给抓取合成带来了挑战。现有方法难以将语言指令有效地融入到HAOI的抓取序列生成中。

核心思路:SynHLMA的核心思路是将手部与铰接物体的交互过程表示为一系列离散的HAOI帧,并利用自然语言嵌入来描述这些帧。通过训练一个HAOI操作语言模型,将抓取过程的视觉信息和语言描述对齐到一个共享的表示空间中。这样,就可以根据语言指令生成相应的抓取序列。

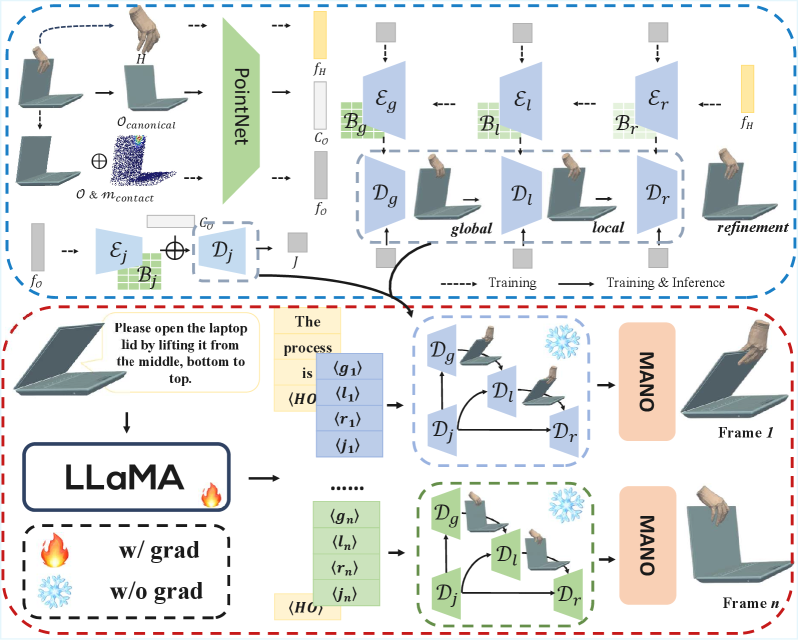

技术框架:SynHLMA框架主要包含以下几个模块:1) 离散HAOI表示模块,用于将手部与物体的交互帧编码为离散的表示;2) 自然语言嵌入模块,用于提取语言指令的特征;3) HAOI操作语言模型,用于将HAOI表示和语言嵌入对齐,并生成抓取序列;4) 关节感知损失函数,用于约束手部抓取跟随铰接物体关节的动态变化。整体流程是:输入铰接物体的点云和语言指令,经过上述模块处理后,输出手部抓取序列。

关键创新:SynHLMA的关键创新在于:1) 提出了离散的HAOI表示,能够有效地表示手部与铰接物体的交互帧;2) 利用HAOI操作语言模型,将视觉信息和语言描述对齐,实现了语言指导下的抓取序列生成;3) 引入了关节感知损失函数,保证了手部抓取与铰接物体关节的动态一致性。

关键设计:在离散HAOI表示模块中,使用了VQ-VAE(Vector Quantized Variational Autoencoder)来学习离散的码本。HAOI操作语言模型采用了Transformer架构,用于建模抓取序列的长期依赖关系。关节感知损失函数的设计考虑了铰接物体关节的旋转和平移,以确保手部抓取与关节运动的协调性。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

SynHLMA在自建的HAOI-lang数据集上进行了评估,实验结果表明,与现有最先进的方法相比,SynHLMA在HAOI生成、HAOI预测和HAOI插值任务上均取得了显著的性能提升。具体而言,SynHLMA在抓取成功率、抓取质量和抓取序列的流畅性等方面均优于对比方法。此外,SynHLMA还成功应用于机器人抓取模仿学习,验证了其在实际应用中的可行性。

🎯 应用场景

SynHLMA的研究成果可以应用于机器人灵巧操作、虚拟现实/增强现实(VR/AR)以及具身智能等领域。例如,在机器人灵巧操作中,可以利用SynHLMA生成的抓取序列,使机器人能够根据语言指令完成复杂的铰接物体操作任务。在VR/AR中,可以为用户提供更自然、更智能的交互体验。此外,该研究还可以促进人机协作和智能制造的发展。

📄 摘要(原文)

Generating hand grasps with language instructions is a widely studied topic that benefits from embodied AI and VR/AR applications. While transferring into hand articulatied object interaction (HAOI), the hand grasps synthesis requires not only object functionality but also long-term manipulation sequence along the object deformation. This paper proposes a novel HAOI sequence generation framework SynHLMA, to synthesize hand language manipulation for articulated objects. Given a complete point cloud of an articulated object, we utilize a discrete HAOI representation to model each hand object interaction frame. Along with the natural language embeddings, the representations are trained by an HAOI manipulation language model to align the grasping process with its language description in a shared representation space. A joint-aware loss is employed to ensure hand grasps follow the dynamic variations of articulated object joints. In this way, our SynHLMA achieves three typical hand manipulation tasks for articulated objects of HAOI generation, HAOI prediction and HAOI interpolation. We evaluate SynHLMA on our built HAOI-lang dataset and experimental results demonstrate the superior hand grasp sequence generation performance comparing with state-of-the-art. We also show a robotics grasp application that enables dexterous grasps execution from imitation learning using the manipulation sequence provided by our SynHLMA. Our codes and datasets will be made publicly available.