RobotArena $\infty$: Scalable Robot Benchmarking via Real-to-Sim Translation

作者: Yash Jangir, Yidi Zhang, Kashu Yamazaki, Chenyu Zhang, Kuan-Hsun Tu, Tsung-Wei Ke, Lei Ke, Yonatan Bisk, Katerina Fragkiadaki

分类: cs.RO, cs.AI, cs.CV, cs.LG

发布日期: 2025-10-27

备注: Website: https://robotarenainf.github.io

💡 一句话要点

RobotArena $\infty$: 通过真实到模拟转换实现可扩展的机器人基准测试

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 机器人基准测试 真实到模拟转换 视觉语言模型 可扩展评估 机器人通用智能体

📋 核心要点

- 现有机器人策略评估方法在真实世界中成本高昂、难以复现,在模拟环境中泛化性不足,无法有效评估真实世界训练的模型。

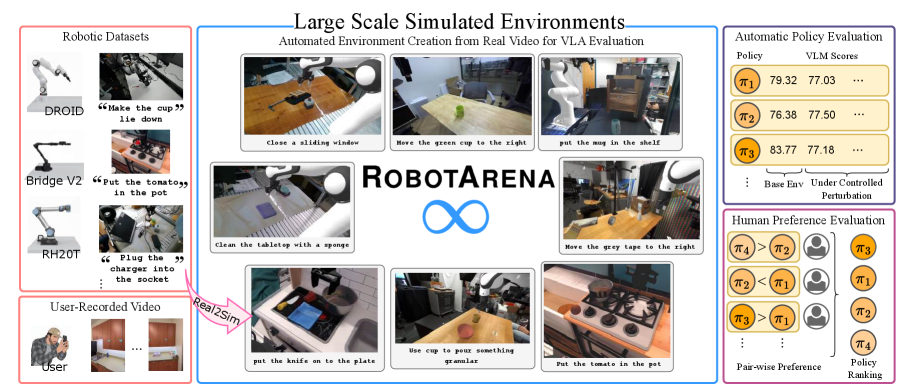

- 该论文提出RobotArena $\infty$,利用视觉语言模型、2D到3D生成建模和可微渲染,将真实世界视频演示转换为大规模模拟环境。

- 该框架使用VLM引导的自动评分和众包人工偏好判断来评估策略,并通过系统扰动模拟环境来测试策略的鲁棒性。

📝 摘要(中文)

为了追求机器人通用智能体——能够执行各种任务的智能体,需要严格且可扩展的评估。然而,机器人策略的真实世界测试受到根本限制:它耗费人力、速度慢、大规模情况下不安全且难以重现。现有的模拟基准测试也存在类似限制,因为它们在相同的合成领域内训练和测试策略,并且无法评估从真实世界演示或替代模拟环境中训练的模型。随着策略范围和复杂性的扩展,这些障碍只会加剧,因为在机器人技术中定义“成功”通常取决于对执行质量的细致入微的人工判断。本文介绍了一种新的基准测试框架,通过将VLA评估转移到大规模模拟环境中并辅以在线人工反馈来克服这些挑战。利用视觉语言模型、2D到3D生成建模和可微渲染的进步,我们的方法自动将来自广泛使用的机器人数据集的视频演示转换为模拟对应物。在这些数字孪生中,我们使用自动化的VLM引导评分和从众包工作者那里收集的可扩展的人工偏好判断来评估VLA策略,从而将人工参与从繁琐的场景设置、重置和安全监督转变为轻量级的偏好比较。为了衡量鲁棒性,我们系统地扰动模拟环境的多个轴,例如纹理和对象放置,从而在受控变化下进行策略泛化的压力测试。最终形成了一个不断发展、可重现且可扩展的真实世界训练机器人操作策略的基准,解决了当今机器人技术领域中一个关键的缺失能力。

🔬 方法详解

问题定义:现有机器人策略评估方法存在真实世界测试成本高、难以复现,以及模拟环境泛化性差的问题。真实世界测试需要大量人力进行场景设置、重置和安全监督,并且难以大规模进行。现有的模拟基准测试通常在相同的合成领域内训练和测试策略,无法评估从真实世界数据或不同模拟环境中训练的模型。此外,定义机器人任务的“成功”往往依赖于细致的人工判断,难以自动化。

核心思路:该论文的核心思路是将真实世界的机器人操作视频演示自动转换为大规模的模拟环境,并在这些模拟环境中评估机器人策略。通过利用视觉语言模型、2D到3D生成建模和可微渲染等技术,可以高效地创建数字孪生环境,并使用自动化评分和人工偏好判断相结合的方式来评估策略的性能。这种方法降低了真实世界测试的成本,并提高了评估的可扩展性和可重复性。

技术框架:RobotArena $\infty$ 框架主要包含以下几个阶段:1) 数据转换:利用视觉语言模型和2D到3D生成建模技术,将真实世界的机器人操作视频演示转换为模拟环境。2) 策略评估:在模拟环境中运行待评估的机器人策略。3) 自动评分:使用VLM引导的自动评分方法对策略的执行结果进行评估。4) 人工偏好判断:通过众包平台收集人工对不同策略执行结果的偏好判断。5) 鲁棒性测试:系统地扰动模拟环境的纹理、对象位置等参数,测试策略在不同环境下的泛化能力。

关键创新:该论文的关键创新在于:1) 自动化真实到模拟转换:利用先进的视觉语言模型和生成建模技术,实现了从真实世界视频到高质量模拟环境的自动转换,大大降低了环境构建的成本。2) 混合评估方法:结合了VLM引导的自动评分和人工偏好判断,既保证了评估的效率,又考虑了人工对机器人任务执行质量的细致判断。3) 系统性的鲁棒性测试:通过系统地扰动模拟环境的参数,对策略的泛化能力进行了全面的评估。

关键设计:在数据转换阶段,使用了预训练的视觉语言模型来理解视频中的场景和任务描述,并利用2D到3D生成模型生成对应的3D场景。在策略评估阶段,使用了可微渲染技术,使得策略的执行结果可以被VLM直接分析和评分。在人工偏好判断阶段,设计了清晰的用户界面和评估流程,以保证收集到的数据质量。

🖼️ 关键图片

📊 实验亮点

该论文提出了一个可扩展的机器人基准测试框架,能够自动将真实世界的视频演示转换为模拟环境,并使用VLM引导的自动评分和人工偏好判断来评估机器人策略。通过系统地扰动模拟环境,可以测试策略的鲁棒性。该框架为真实世界训练的机器人操作策略提供了一个持续发展、可重现且可扩展的基准。

🎯 应用场景

RobotArena $\infty$ 可用于机器人通用智能体的开发和评估,加速机器人技术在工业自动化、家庭服务、医疗健康等领域的应用。该框架能够提供可扩展、可重复的评估环境,帮助研究人员快速迭代和优化机器人策略,并促进不同算法之间的公平比较。

📄 摘要(原文)

The pursuit of robot generalists - instructable agents capable of performing diverse tasks across diverse environments - demands rigorous and scalable evaluation. Yet real-world testing of robot policies remains fundamentally constrained: it is labor-intensive, slow, unsafe at scale, and difficult to reproduce. Existing simulation benchmarks are similarly limited, as they train and test policies within the same synthetic domains and cannot assess models trained from real-world demonstrations or alternative simulation environments. As policies expand in scope and complexity, these barriers only intensify, since defining "success" in robotics often hinges on nuanced human judgments of execution quality. In this paper, we introduce a new benchmarking framework that overcomes these challenges by shifting VLA evaluation into large-scale simulated environments augmented with online human feedback. Leveraging advances in vision-language models, 2D-to-3D generative modeling, and differentiable rendering, our approach automatically converts video demonstrations from widely used robot datasets into simulated counterparts. Within these digital twins, we assess VLA policies using both automated VLM-guided scoring and scalable human preference judgments collected from crowdworkers, transforming human involvement from tedious scene setup, resetting, and safety supervision into lightweight preference comparisons. To measure robustness, we systematically perturb simulated environments along multiple axes, such as textures and object placements, stress-testing policy generalization under controlled variation. The result is a continuously evolving, reproducible, and scalable benchmark for real-world trained robot manipulation policies, addressing a critical missing capability in today's robotics landscape.