Deductive Chain-of-Thought Augmented Socially-aware Robot Navigation World Model

作者: Weizheng Wang, Obi Ike, Soyun Choi, Sungeun Hong, Byung-Cheol Min

分类: cs.RO

发布日期: 2025-10-27

💡 一句话要点

提出NaviWM以解决社交机器人导航中的安全性与合理性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社交机器人 导航模型 逻辑推理 动态环境 安全性 社交规范 人工智能

📋 核心要点

- 现有方法在动态人类环境中依赖LLMs进行导航,导致行为不稳定和安全性不足。

- NaviWM通过空间-时间世界模型和演绎推理模块,增强LLM的推理能力,确保导航决策符合社交规范。

- 实验结果显示,NaviWM在拥挤环境中成功率提高,社交违规行为减少,验证了其有效性。

📝 摘要(中文)

社交机器人导航越来越依赖大型语言模型(LLMs)进行推理和路径规划,但仅依靠LLMs往往导致在动态人类环境中出现不可预测和不安全的行为。本文提出了NaviWM,一个社交感知的机器人导航世界模型,通过结构化的世界模型和逻辑驱动的推理过程增强LLM的推理能力。NaviWM包括两个主要组件:空间-时间世界模型和演绎推理模块。实验表明,NaviWM在拥挤环境中提高了成功率并减少了社交违规行为,展示了将形式化推理与LLMs结合在社交导航中的优势。

🔬 方法详解

问题定义:本文旨在解决社交机器人在动态人类环境中导航时的安全性和合理性问题。现有方法依赖LLMs进行推理,常导致不稳定和不安全的行为,缺乏物理基础和逻辑一致性。

核心思路:NaviWM通过结合空间-时间世界模型和演绎推理模块,增强LLM的推理能力,使机器人能够在遵循社交规范的同时进行安全导航。这样的设计确保了机器人在复杂环境中做出合理的决策。

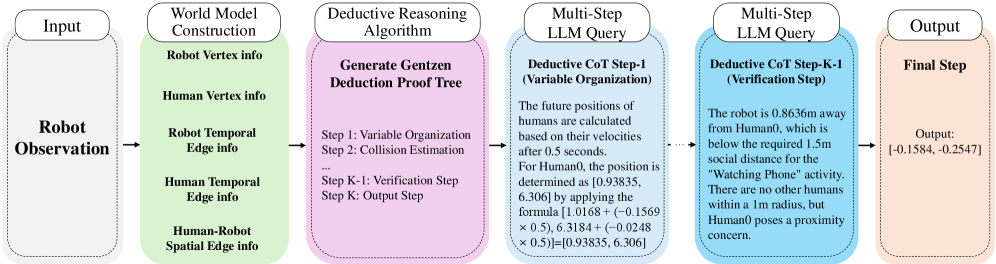

技术框架:NaviWM的整体架构包括两个主要模块:首先是空间-时间世界模型,捕捉环境中代理的位置信息、速度和活动;其次是演绎推理模块,指导LLMs进行多步骤的逻辑推理。

关键创新:NaviWM的主要创新在于将社交规范编码为一阶逻辑,提供可解释和可验证的推理过程。这一方法与传统的提示或微调方法有本质区别,增强了推理的透明性和可靠性。

关键设计:在设计中,NaviWM采用了特定的逻辑规则来定义社交规范,并通过多步骤推理过程来确保决策的合理性和安全性。具体的参数设置和损失函数设计尚未详细说明,需进一步研究。

🖼️ 关键图片

📊 实验亮点

实验结果表明,NaviWM在拥挤环境中的成功率显著提高,社交违规行为减少,具体数据未在摘要中提供。与传统方法相比,NaviWM展示了更强的社交感知能力和安全性,验证了形式化推理与LLMs结合的有效性。

🎯 应用场景

NaviWM的研究成果可广泛应用于社交机器人、智能家居、服务机器人等领域,提升机器人在动态环境中的导航能力和人机交互体验。未来,随着技术的进步,NaviWM有望在更复杂的社交场景中发挥作用,推动机器人技术的发展。

📄 摘要(原文)

Social robot navigation increasingly relies on large language models for reasoning, path planning, and enabling movement in dynamic human spaces. However, relying solely on LLMs for planning often leads to unpredictable and unsafe behaviors, especially in dynamic human spaces, due to limited physical grounding and weak logical consistency. In this work, we introduce NaviWM, a socially-aware robot Navigation World Model that augments LLM reasoning with a structured world model and a logic-driven chain-of-thought process. NaviWM consists of two main components: (1) a spatial-temporal world model that captures the positions, velocities, and activities of agents in the environment, and (2) a deductive reasoning module that guides LLMs through a multi-step, logic-based inference process. This integration enables the robot to generate navigation decisions that are both socially compliant and physically safe, under well-defined constraints such as personal space, collision avoidance, and timing. Unlike previous methods based on prompting or fine-tuning, NaviWM encodes social norms as first-order logic, enabling interpretable and verifiable reasoning. Experiments show that NaviWM improves success rates and reduces social violations, particularly in crowded environments. These results demonstrate the benefit of combining formal reasoning with LLMs for robust social navigation. Additional experimental details and demo videos for this work can be found at: https://sites.google.com/view/NaviWM.