TARC: Time-Adaptive Robotic Control

作者: Arnav Sukhija, Lenart Treven, Jin Cheng, Florian Dörfler, Stelian Coros, Andreas Krause

分类: cs.RO, cs.LG

发布日期: 2025-10-27

💡 一句话要点

提出时间自适应机器人控制(TARC),解决固定频率控制的局限性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器人控制 强化学习 时间自适应 零样本迁移 sim-to-real

📋 核心要点

- 传统机器人控制采用固定频率,低频控制效率高但鲁棒性差,高频控制鲁棒性好但效率低,难以兼顾。

- 论文提出一种基于强化学习的控制策略,允许机器人自主选择控制动作及其持续时间,从而自适应地调整控制频率。

- 在真实机器人平台上的实验表明,该方法在保证性能的同时,显著降低了控制频率,并展现出良好的适应性。

📝 摘要(中文)

本文提出了一种基于强化学习的时间自适应机器人控制(TARC)方法,旨在解决机器人固定频率控制中效率与鲁棒性之间的权衡问题。与生物系统不同,传统机器人控制频率固定,无法根据环境需求进行调整。TARC策略能够联合选择控制动作及其应用时长,使机器人能够自主调节控制频率以适应不同情况。该方法在高速遥控车和四足机器人两个不同的硬件平台上进行了零样本的sim-to-real实验验证。实验结果表明,TARC在奖励方面与固定频率基线方法相当或更优,同时显著降低了控制频率,并在真实环境中表现出适应性频率控制。

🔬 方法详解

问题定义:现有机器人控制系统通常采用固定的控制频率,这导致了效率和鲁棒性之间的权衡。低频率控制虽然计算效率高,但对快速变化的环境响应不足,容易导致控制不稳定。高频率控制则可以提供更好的鲁棒性,但计算成本高昂,限制了其在资源受限平台上的应用。因此,如何根据环境动态调整控制频率,以在效率和鲁棒性之间取得平衡,是一个亟待解决的问题。

核心思路:论文的核心思路是利用强化学习训练一个策略,该策略不仅输出控制动作,还输出该动作的持续时间。通过这种方式,机器人可以根据当前的状态和环境,自主决定何时以及如何进行控制,从而实现时间自适应的控制。这种方法模仿了生物系统根据需求调整控制频率的能力。

技术框架:TARC方法采用强化学习框架,具体流程如下:首先,使用强化学习算法(例如PPO)训练一个策略网络。该策略网络以机器人的状态作为输入,输出控制动作和该动作的持续时间。然后,在仿真环境中对策略进行训练,并使用域随机化等技术提高策略的泛化能力。最后,将训练好的策略部署到真实机器人上进行测试。

关键创新:TARC的关键创新在于将控制动作的持续时间纳入了策略的输出空间。这使得机器人能够自主地调整控制频率,从而适应不同的环境和任务需求。与传统的固定频率控制方法相比,TARC能够更好地平衡效率和鲁棒性。

关键设计:策略网络通常采用多层感知机(MLP)或循环神经网络(RNN)结构。损失函数通常包括奖励函数和正则化项,用于鼓励策略选择合适的控制动作和持续时间。为了提高策略的泛化能力,可以使用域随机化技术,在仿真环境中随机改变机器人的参数和环境条件。

🖼️ 关键图片

📊 实验亮点

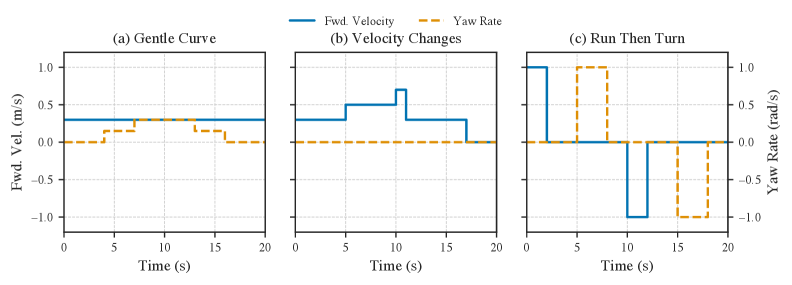

TARC在高速遥控车和四足机器人平台上进行了零样本的sim-to-real实验。在遥控车实验中,TARC在保持与固定频率基线方法相当的性能的同时,将控制频率降低了约50%。在四足机器人实验中,TARC在越障任务中表现出更好的稳定性和鲁棒性,并且能够根据地形动态调整步频。

🎯 应用场景

时间自适应机器人控制(TARC)具有广泛的应用前景,例如在资源受限的移动机器人平台上,可以根据任务需求动态调整控制频率,以延长电池续航时间。在复杂地形或动态环境中,可以提高机器人的稳定性和鲁棒性。此外,该方法还可以应用于工业自动化、无人驾驶等领域,提高机器人的效率和适应性。未来,TARC有望成为机器人控制领域的重要发展方向。

📄 摘要(原文)

Fixed-frequency control in robotics imposes a trade-off between the efficiency of low-frequency control and the robustness of high-frequency control, a limitation not seen in adaptable biological systems. We address this with a reinforcement learning approach in which policies jointly select control actions and their application durations, enabling robots to autonomously modulate their control frequency in response to situational demands. We validate our method with zero-shot sim-to-real experiments on two distinct hardware platforms: a high-speed RC car and a quadrupedal robot. Our method matches or outperforms fixed-frequency baselines in terms of rewards while significantly reducing the control frequency and exhibiting adaptive frequency control under real-world conditions.