OmniDexGrasp: Generalizable Dexterous Grasping via Foundation Model and Force Feedback

作者: Yi-Lin Wei, Zhexi Luo, Yuhao Lin, Mu Lin, Zhizhao Liang, Shuoyu Chen, Wei-Shi Zheng

分类: cs.RO

发布日期: 2025-10-27

备注: Project page: https://isee-laboratory.github.io/OmniDexGrasp/

💡 一句话要点

OmniDexGrasp:基于Foundation Model和力反馈的通用灵巧抓取

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 灵巧抓取 Foundation Model 力反馈控制 机器人操作 迁移学习

📋 核心要点

- 现有灵巧抓取方法在面对多样化的物体或任务时,由于语义灵巧抓取数据集规模有限,泛化能力不足。

- OmniDexGrasp利用Foundation Model增强泛化性,通过人类图像到机器人动作的迁移策略和力感知自适应抓取策略,弥合抽象模型知识与物理机器人执行之间的差距。

- 实验结果表明,OmniDexGrasp在多种用户提示、抓取任务和灵巧手上表现出良好的性能,并具有扩展到灵巧操作任务的潜力。

📝 摘要(中文)

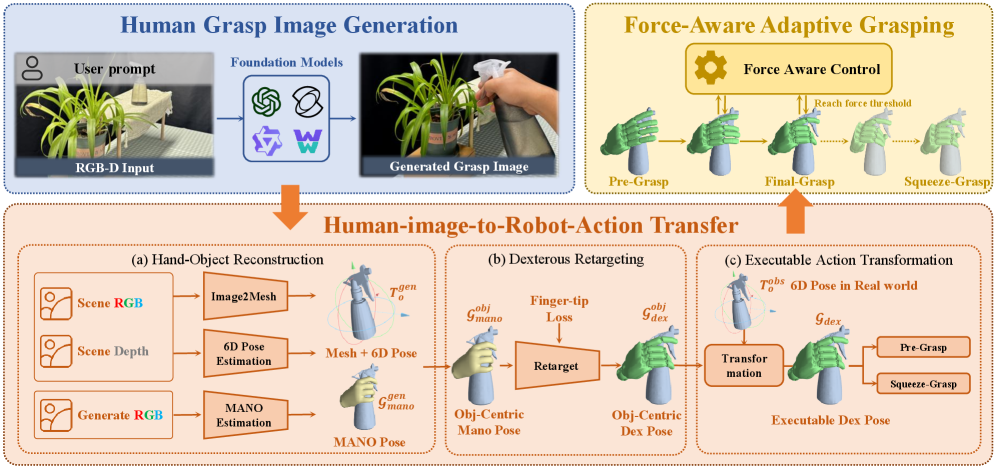

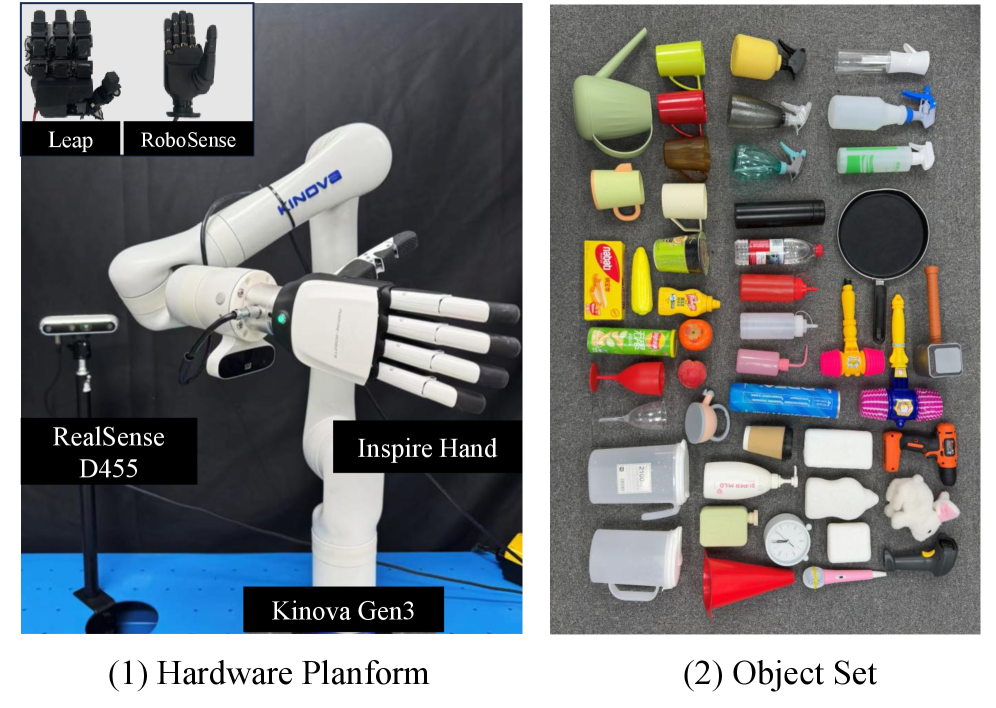

本文提出OmniDexGrasp,一个通用的灵巧抓取框架,通过结合Foundation Model与迁移和控制策略,实现用户提示、灵巧具身和抓取任务的全面能力。OmniDexGrasp集成了三个关键模块:(i)利用Foundation Model生成支持用户提示和任务的抓取图像,增强泛化能力;(ii)一种人类图像到机器人动作的迁移策略,将人类演示转换为可执行的机器人动作,实现全面的灵巧具身;(iii)力感知的自适应抓取策略,确保鲁棒和稳定的抓取执行。在模拟和真实机器人上的实验验证了OmniDexGrasp在各种用户提示、抓取任务和灵巧手上的有效性,并进一步展示了其在灵巧操作任务中的可扩展性。

🔬 方法详解

问题定义:论文旨在解决机器人灵巧抓取的泛化性问题,即如何使机器人能够根据人类指令灵活地抓取和操作各种物体。现有方法依赖于大规模的语义灵巧抓取数据集,但数据集的规模限制了模型的泛化能力,难以适应新的物体和任务。此外,如何将Foundation Model的抽象知识转化为可执行的机器人动作也是一个挑战。

核心思路:论文的核心思路是结合Foundation Model的强大泛化能力和力反馈控制的鲁棒性,设计一个能够理解人类指令并将其转化为机器人动作的通用框架。通过人类抓取图像到机器人动作的迁移学习,弥合了人类演示和机器人执行之间的差距。力感知自适应抓取策略则保证了抓取的稳定性和可靠性。

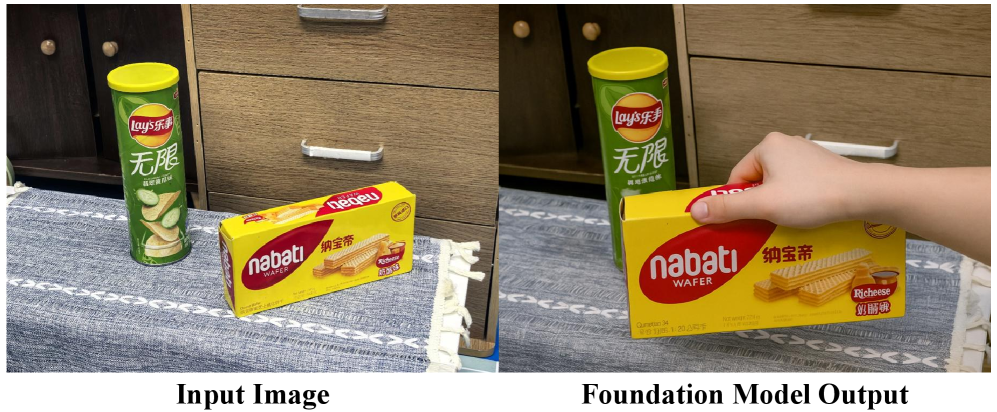

技术框架:OmniDexGrasp框架包含三个主要模块:(1)Foundation Model模块:用于生成支持用户提示和任务的抓取图像,增强泛化能力。(2)人类图像到机器人动作迁移模块:将人类演示转换为可执行的机器人动作,实现灵巧具身。(3)力感知自适应抓取模块:利用力传感器信息调整抓取策略,确保抓取的鲁棒性和稳定性。整体流程是:用户输入指令,Foundation Model生成抓取图像,迁移模块将图像转化为机器人动作,最后力感知模块进行微调和控制。

关键创新:论文的关键创新在于将Foundation Model、迁移学习和力反馈控制相结合,构建了一个通用的灵巧抓取框架。这种结合方式充分利用了Foundation Model的泛化能力和力反馈控制的鲁棒性,提高了机器人抓取的适应性和可靠性。此外,人类图像到机器人动作的迁移策略也避免了直接从Foundation Model生成机器人动作的困难。

关键设计:论文的关键设计包括:(1) 使用特定的Foundation Model(具体模型未知)进行抓取图像生成,并针对机器人抓取任务进行微调(具体微调方法未知)。(2) 设计了一种人类图像到机器人动作的迁移学习算法,将人类演示的抓取姿态映射到机器人的关节空间。(具体映射方法未知)(3) 采用力传感器获取抓取过程中的力信息,并设计了一种自适应控制算法,根据力反馈调整抓取力度和姿态,以保证抓取的稳定性。(具体控制算法未知)

🖼️ 关键图片

📊 实验亮点

论文在模拟和真实机器人上进行了实验验证,结果表明OmniDexGrasp在各种用户提示、抓取任务和灵巧手上表现出良好的性能。具体性能数据未知,但实验结果表明该方法能够有效地提高机器人抓取的泛化性和鲁棒性,并具有扩展到灵巧操作任务的潜力。与现有方法相比,OmniDexGrasp在处理新的物体和任务时表现出更强的适应性。

🎯 应用场景

OmniDexGrasp在工业自动化、家庭服务机器人、医疗康复等领域具有广泛的应用前景。例如,在工业自动化中,机器人可以根据操作人员的指令灵活地抓取和组装各种零件。在家庭服务机器人中,机器人可以帮助人们完成各种家务,如整理物品、准备食物等。在医疗康复领域,机器人可以辅助医生进行手术操作,提高手术的精度和效率。

📄 摘要(原文)

Enabling robots to dexterously grasp and manipulate objects based on human commands is a promising direction in robotics. However, existing approaches are challenging to generalize across diverse objects or tasks due to the limited scale of semantic dexterous grasp datasets. Foundation models offer a new way to enhance generalization, yet directly leveraging them to generate feasible robotic actions remains challenging due to the gap between abstract model knowledge and physical robot execution. To address these challenges, we propose OmniDexGrasp, a generalizable framework that achieves omni-capabilities in user prompting, dexterous embodiment, and grasping tasks by combining foundation models with the transfer and control strategies. OmniDexGrasp integrates three key modules: (i) foundation models are used to enhance generalization by generating human grasp images supporting omni-capability of user prompt and task; (ii) a human-image-to-robot-action transfer strategy converts human demonstrations into executable robot actions, enabling omni dexterous embodiment; (iii) force-aware adaptive grasp strategy ensures robust and stable grasp execution. Experiments in simulation and on real robots validate the effectiveness of OmniDexGrasp on diverse user prompts, grasp task and dexterous hands, and further results show its extensibility to dexterous manipulation tasks.