Awakening Facial Emotional Expressions in Human-Robot

作者: Yongtong Zhu, Lei Li, Iggy Qian, WenBin Zhou, Ye Yuan, Qingdu Li, Na Liu, Jianwei Zhang

分类: cs.RO

发布日期: 2025-10-27

备注: Accepted to IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS 2025). 8 pages, 7 figures, IEEE two-column format

💡 一句话要点

提出基于KAN和注意力机制的端到端学习框架,用于类人机器人自主生成面部表情

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 类人机器人 面部表情生成 深度学习 KAN网络 注意力机制 人机交互 情感计算 开源数据集

📋 核心要点

- 现有类人机器人面部表情生成依赖预编程模式,人工成本高,缺乏自主学习能力。

- 论文提出基于KAN和注意力机制的端到端学习框架,使机器人能够通过自训练学习类人表情。

- 构建了首个类人机器人开源面部数据集,实验表明该方法能准确且多样地模仿面部表情。

📝 摘要(中文)

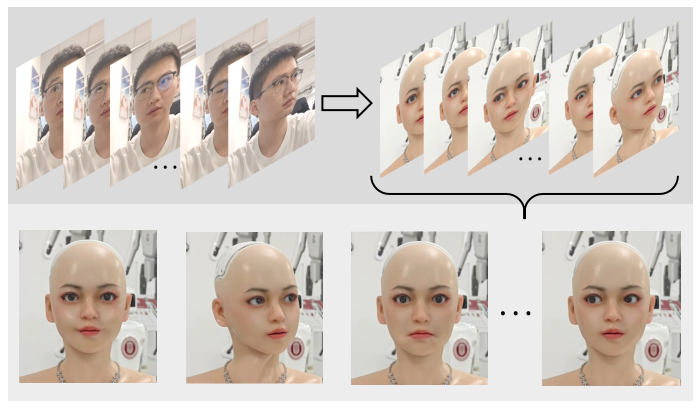

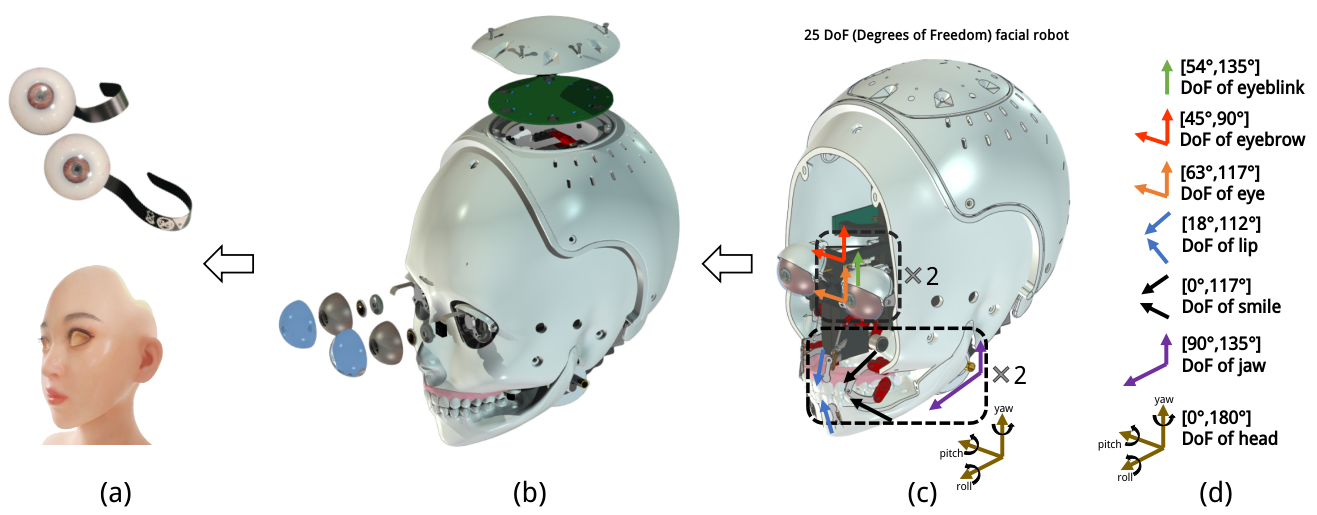

类人社交机器人的面部表情生成能力对于实现自然和类人的交互至关重要,它在增强人机交互的流畅性和情感表达的准确性方面起着关键作用。目前,类人社交机器人的面部表情生成仍然依赖于预先编程的行为模式,这些模式需要手动编码,耗费大量的人力和时间成本。为了使类人机器人能够自主地获得通用的表达能力,它们需要发展通过自训练来学习类人表情的能力。为了应对这一挑战,我们设计了一个具有高度仿生机器人面孔,该面孔具有物理电子动画面部单元,并开发了一个基于KAN(Kolmogorov-Arnold Network)和注意力机制的端到端学习框架。与之前的类人社交机器人不同,我们还精心设计了一个基于面部运动原语专家策略的自动数据收集系统来构建数据集。值得注意的是,据我们所知,这是第一个用于类人社交机器人的开源面部数据集。全面的评估表明,我们的方法在不同的测试对象中实现了准确和多样化的面部模仿。

🔬 方法详解

问题定义:论文旨在解决类人社交机器人面部表情生成依赖预编程、人工成本高的问题。现有方法难以使机器人自主学习并生成自然、多样的面部表情,限制了人机交互的流畅性和情感表达的准确性。

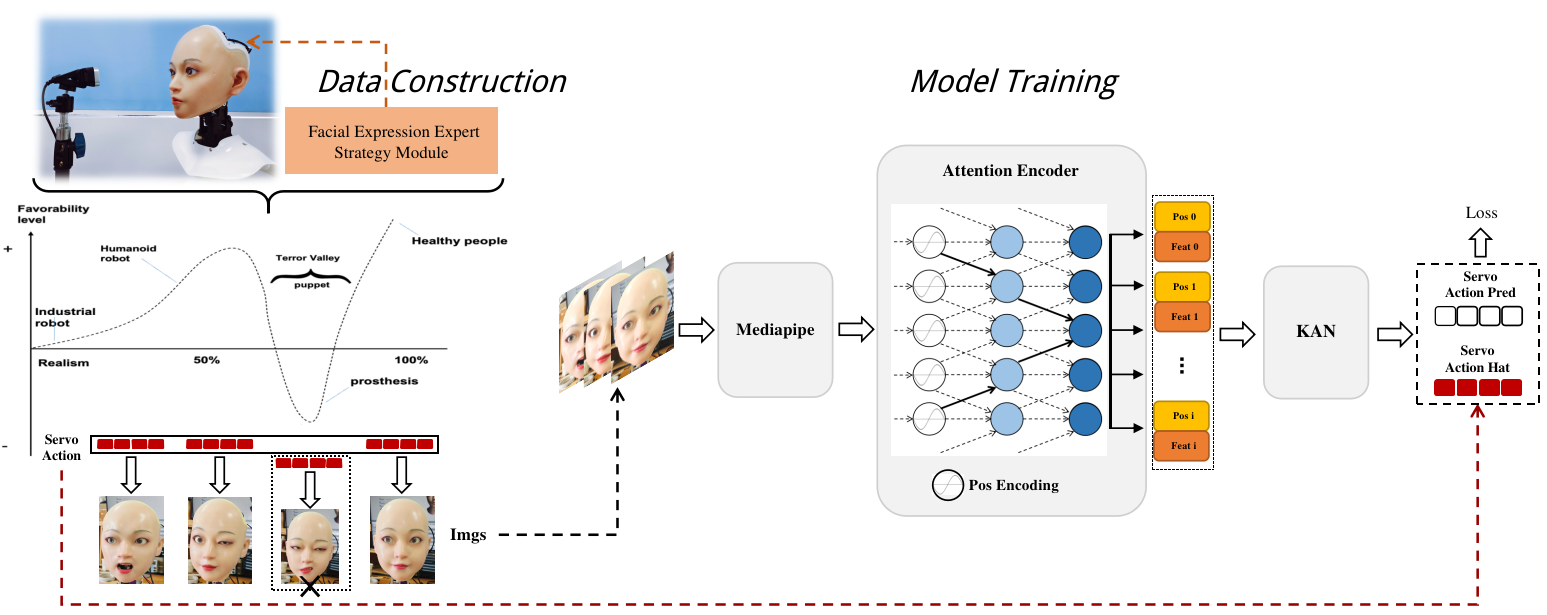

核心思路:论文的核心思路是利用深度学习,特别是Kolmogorov-Arnold Network (KAN) 和注意力机制,构建一个端到端的学习框架,使机器人能够通过自训练学习人类的面部表情。通过模仿人类表情,机器人可以自主生成各种表情,从而提高人机交互的自然性和准确性。

技术框架:整体框架包含数据采集、模型训练和表情生成三个主要阶段。首先,通过精心设计的自动数据采集系统,基于面部运动原语的专家策略构建数据集。然后,利用KAN和注意力机制构建的深度学习模型进行训练,学习面部表情与控制信号之间的映射关系。最后,将训练好的模型部署到机器人上,根据输入的情感指令生成相应的面部表情。

关键创新:论文的关键创新在于:1) 提出了基于KAN和注意力机制的端到端学习框架,能够有效学习和生成类人面部表情;2) 设计了自动数据采集系统,并构建了首个类人机器人开源面部数据集;3) 将KAN应用于机器人面部表情生成任务,探索了其在控制高自由度机器人方面的潜力。

关键设计:论文的关键设计包括:1) KAN网络结构的选择和优化,使其能够更好地拟合面部表情的复杂非线性关系;2) 注意力机制的应用,用于关注面部不同区域的重要性,提高表情生成的准确性;3) 数据集的构建,采用了面部运动原语的专家策略,保证了数据的质量和多样性;4) 损失函数的设计,可能包含表情分类损失、表情重建损失等,以保证表情生成的准确性和自然性(具体损失函数细节未知)。

🖼️ 关键图片

📊 实验亮点

论文构建了首个类人机器人开源面部数据集,并验证了基于KAN和注意力机制的端到端学习框架的有效性。实验结果表明,该方法能够准确且多样地模仿不同测试对象的面部表情,但具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可广泛应用于人机交互、情感陪护、教育娱乐等领域。例如,在医疗领域,机器人可以模拟医护人员的面部表情,缓解患者的焦虑情绪;在教育领域,机器人可以根据学生的学习状态调整表情,提高教学效果;在娱乐领域,机器人可以作为情感伙伴,与人进行互动交流,提升用户体验。该研究为构建更智能、更人性化的机器人奠定了基础。

📄 摘要(原文)

The facial expression generation capability of humanoid social robots is critical for achieving natural and human-like interactions, playing a vital role in enhancing the fluidity of human-robot interactions and the accuracy of emotional expression. Currently, facial expression generation in humanoid social robots still relies on pre-programmed behavioral patterns, which are manually coded at high human and time costs. To enable humanoid robots to autonomously acquire generalized expressive capabilities, they need to develop the ability to learn human-like expressions through self-training. To address this challenge, we have designed a highly biomimetic robotic face with physical-electronic animated facial units and developed an end-to-end learning framework based on KAN (Kolmogorov-Arnold Network) and attention mechanisms. Unlike previous humanoid social robots, we have also meticulously designed an automated data collection system based on expert strategies of facial motion primitives to construct the dataset. Notably, to the best of our knowledge, this is the first open-source facial dataset for humanoid social robots. Comprehensive evaluations indicate that our approach achieves accurate and diverse facial mimicry across different test subjects.